1 引言

随着远程办公/在线教育等应用场景兴起,屏幕内容(如PPT,文档,表格等)的编码与传输成了学术界和工业界关注焦点。屏幕内容(Screen Content, SC)不仅包含自然图像,还包括一些文本、图形、动画、游戏等由计算机产生的视觉内容[1]。相比于摄像机捕获的自然图像,这些由计算机产生的屏幕内容图像通常不包含噪声,色调离散而边缘锐利,均匀平坦区域较多,重复图案以及相同块较多。为了满足在有效带宽下屏幕内容视频的高效存储和传输需求,由视频编码专家组(Video Coding Experts Group, VCEG)和运动图像专家组(Moving Picture Experts Group, MPEG)组成的联合视频专家组(Joint Video Experts Team, JVET)制定的最新一代国际视频编码标准(H.266/VVC)涵盖了屏幕内容视频编码。该标准引入并改进了上一代高效视频编码标准HEVC屏幕内容编码扩展HEVC-SCC的一系列针对屏幕内容的编码技术,如帧内块复制(Intra Block Copy,IBC)[2]、调色板模式(Palette Mode,PLT)[3]、自适应颜色变换(Adaptive Color Transform,ACT)[4]以及自适应运动矢量分辨率(Adaptive Motion Vector Resolution,AMVR)[5]等,这些工具针对性地提高了屏幕内容编码的效率[6-7]。

为了适应更丰富的高清视频应用,H.266/VVC引用了更大尺寸划分块和更复杂的划分模式[8]。具体而言,H.266/VVC将每帧先划分为大小为128×128的编码树单元(Coding Tree Unit,CTU),再将CTU进一步划分为不同大小的编码单元(Coding Unit, CU)。引入混合叉树(Quadtree with nested multi-type tree, QTMT)的分割方式,将CU划分为宽高不等的矩形块。在QTMT结构中,一个块可以用5种方式进行分区,由四叉树(Quadtree, QT)结构、二叉树(Binary Tree, BT)结构和三元树(Ternary Tree, TT)结构组成;BT可按分割方向分为垂直二叉树(Vertical Binary Tree, BV)和水平二叉树(Horizontal Binary Tree, BH),同样,TT也可分为垂直三叉树(Vertical Ternary Tree, TV)和水平三叉树(Horizontal Ternary Tree, TH)。另外,为提高编码效率,H.266/VVC改进了各项预测技术。在多角度的帧内预测模式中,H.266/VVC将预测角从H.265/HEVC的33种扩展到65种,同时引入了矩阵加权预测(Matrix weighted Intra Prediction, MIP)[9]技术、帧内子划分(Intra Sub-Partitions,ISP)[10]技术、多参考行帧内预测技术(Multiple reference line,MRL)[7],这些预测技术提高了帧内预测的精度。

根据以上分析可知,H.266/VVC屏幕内容编码标准由于引入了更适用于屏幕内容编码的模式,较H.265/HEVC采用了更多样的编码块分割和更多的预测技术,其编码计算复杂度因需要遍历每个CU分割深度的所有模式,并计算比较率失真(Rate-Distortion,RD)代价而大大增加。如果可以精确预测模式或提前进行CU分割决策,跳过不必要的模式RD代价计算,则可以有效降低H.266/VVC屏幕内容帧内编码的计算复杂度。

近年来,针对屏幕内容编码优化的研究主要集中在HEVC编码标准上。文献[11]利用自然图像块和屏幕内容块DCT变换后系数能量分布不同的特点,结合当前预测单元梯度信息,将编码树单元分类,然后对不同CTU进行有效的模式跳过。文献[12]基于CU的内容属性将CU分类后,对各类CU跳过不必要的模式预测,并对均匀光滑的块提早终止CU分割。文献[13]基于像素精确度对部分简单CU跳过IBC和PLT模式检测,通过对RD代价的比较进行早期的CU剪枝和IBC的模式跳过,同时限定了哈希预定义区域搜索的范围,减少了编码时间。文献[14]利用屏幕内容序列颜色有限、边缘尖锐、结构复杂的特点,为不同大小的CU设计了分类标签,通过与阈值的比较判断是否跳过屏幕内容预测模式的检测。以上这些方法都从一定程度上降低了HEVC-SCC的编码复杂度。

然而,相比于上一代视频编码标准H.265/HEVC,H.266/VVC更精细的CU分割方式使得现有方法对CTU级的内容分类变得不适用,CU尺寸的增多使得对不同大小CU手动设置阈值判断的方法变得不再精确,当前CU判别为屏幕内容块或自然图像块的界限更加模糊,现有的基于H.265/HEVC屏幕内容快速模式选择方法无法直接运用到H.266/VVC上。为此,文献[15]提出了一种基于深度学习的全卷积网络,将当前的CU分为屏幕内容块和自然图像块,对不同块进行不同的模式跳过。目前针对H.266/VVC的屏幕内容视频编码快速算法研究处于起步阶段。因此,我们对这一问题进行了探索。

在本文方法中,我们采用了角点等多特征联合的方法对当前CU进行分类:1)采用角点占比将屏幕内容视频帧分成高对比度屏幕视频帧和低对比度屏幕视频帧;2)采用角点个数将当前编码CU分成前景CU和背景CU;3)采用CU活动度和平均亮度差将背景CU分成屏幕内容背景CU和自然内容背景CU。然后根据CU内容属性采取不同的模式选择策略:1)对高对比度屏幕视频的自然内容背景CU只检测传统的多角度帧内模式,屏幕内容背景CU进行穷尽模式选择,前景CU根据相邻CU的模式加以约束,跳过传统的多角度帧内模式。2)对低对比度屏幕视频帧的前景CU 进行穷尽模式检测,背景CU进行传统的多角度帧内模式检测。这样,简单的分类后可以减少每个CU的模式选择数量,降低计算复杂度。

本文其他章节安排如下: 第2节介绍本快速算法所使用的屏幕内容特征以及基于联合特征的CU分类。第3节介绍基于屏幕内容联合特征的H.266/VVC屏幕内容快速模式选择算法。实验结果在第4节中分析讨论。第5节给出结论。

2 屏幕内容特征与联合特征CU分类

通过研究屏幕内容的特征,将多个特征联合使用,对不同类型CU加以分类,有选择地跳过不必要的模式,可以有效地节省编码时间。下面对所用的联合特征进行详细的陈述。

2.1 角点特征

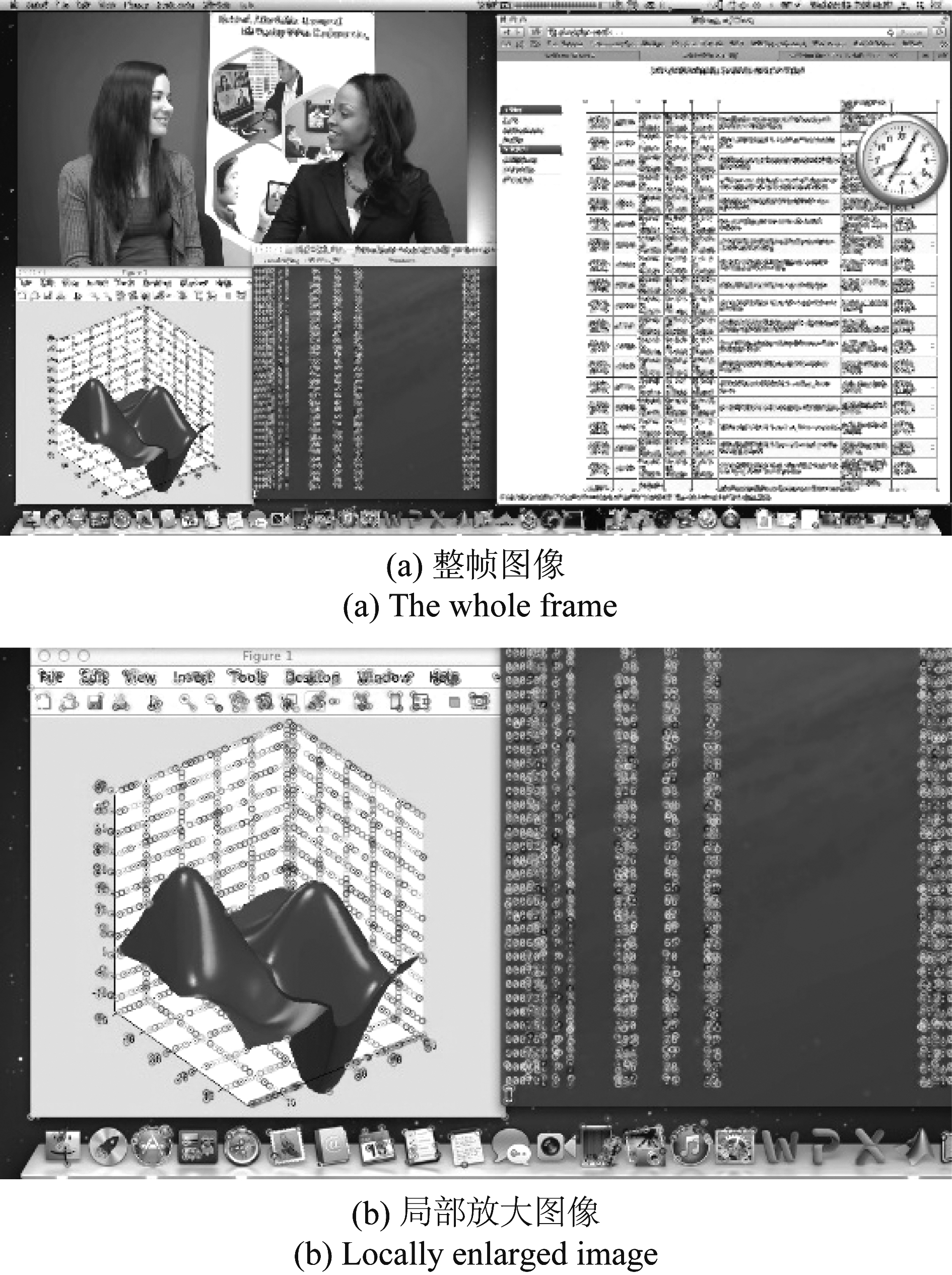

角点(Corner Point, CP)是表征屏幕内容的独特特征,屏幕内容图像块通常包含尖角,而自然图像块则趋于光滑[16]。因此我们可以用图像所含的角点个数来区分不同图像块。本文采用了SUSAN角点检测算法,如图1所示,图1(a)显示的是标准测试序列“MissionControlClip3”的首帧角点检测图,图1(b)是图1(a)的局部放大,其中,彩色的点即为所检测出的角点。从图中可以看出,角点检测检测出绝大多数的文本区域以及边框图形,在CU分割的最佳模式选择中,这类区域一般采用IBC或PLT预测模式,而在图1(a)左上方的由摄像机捕获的自然图像区域,角点个数较少,这里区域一般采用传统的自然视频帧内预测模式。

图1 “MissionControlClip3”首帧角点图

Fig.1 Corner graph for the first frame of “MissionControlClip3”

因此,我们选择视频帧的角点占比特征对当前视频帧做出分类,角点占比的计算公式为

(1)

其中,NCP为当前视频帧的角点个数,W和H分别为当前视频帧的宽和高。

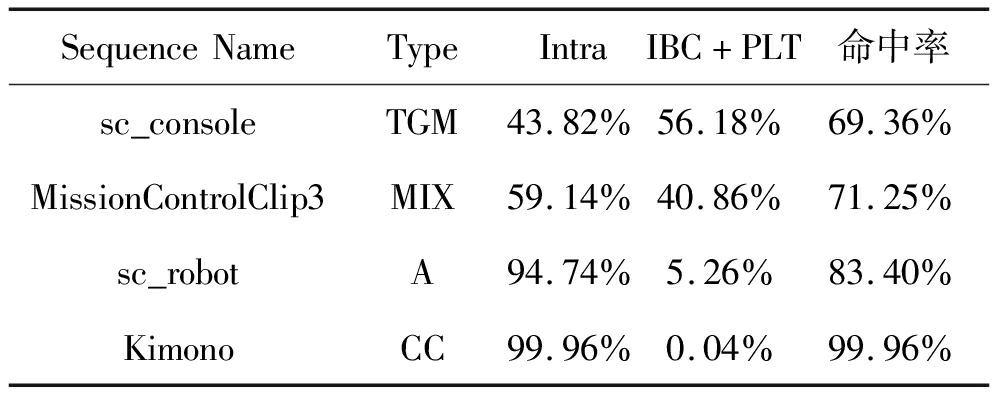

实验对21个屏幕内容标准测试序列的首帧进行角点检测,序列包含了4个类型,分别为运动的图形和文本(TGM)、混合内容(MIX)、相机拍摄内容(CC)和动画(A)。实验发现,角点占比较大的视频帧通常含有更多文本与边框图形,同时含有更多的平坦背景,前景与背景的内容对比度较高;而角点占比较少的视频帧则趋向于包含更多连续像素的背景区域,更符合自然图像的特性。图2展示了各帧的角点检测占比结果,其中横轴为各测试序列的名称,纵轴表示各序列的角点占比,其中绝大多数包含运动的图形和文本(TGM)、混合内容(MIX)的视频帧,即图中竖/横条纹柱形所代表的的视频帧,其角点占比在5![]() 之上。因此我们将角点占比P小于5

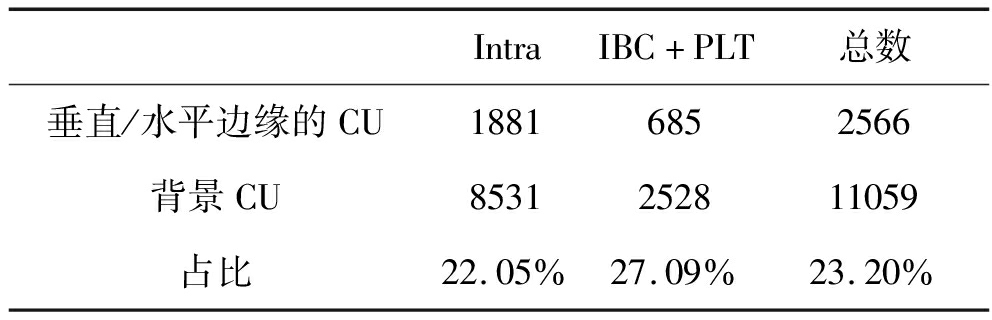

之上。因此我们将角点占比P小于5![]() 的视频帧称为低对比度屏幕视频帧,如表1所示,此类视频的最佳CU分割中IBC和PLT模式占比较少,我们对最佳CU分割的预测模式进行统计,以采用Intra模式的无角点的CU与采用IBC和PLT的有角点的CU个数和占CU总个数的比值计算命中率,发现在低对比度屏幕帧中,平均命中率达到90%以上,因此,在低对比度屏幕帧中只对检测到角点的CU检测IBC和PLT预测模式,该类CU划分为前景CU,未检测到角点的CU定义为背景CU,只进行传统帧内模式预测;其余的视频帧称为高对比度屏幕内容视频帧,如表1所示,这类视频帧的命中率值较低,说明单一角点特征对不能精确划分CU类型,我们将联合水平/垂直活动度特征与平均颜色亮度差特征对背景CU进行进一步的划分。

的视频帧称为低对比度屏幕视频帧,如表1所示,此类视频的最佳CU分割中IBC和PLT模式占比较少,我们对最佳CU分割的预测模式进行统计,以采用Intra模式的无角点的CU与采用IBC和PLT的有角点的CU个数和占CU总个数的比值计算命中率,发现在低对比度屏幕帧中,平均命中率达到90%以上,因此,在低对比度屏幕帧中只对检测到角点的CU检测IBC和PLT预测模式,该类CU划分为前景CU,未检测到角点的CU定义为背景CU,只进行传统帧内模式预测;其余的视频帧称为高对比度屏幕内容视频帧,如表1所示,这类视频帧的命中率值较低,说明单一角点特征对不能精确划分CU类型,我们将联合水平/垂直活动度特征与平均颜色亮度差特征对背景CU进行进一步的划分。

表1 最佳CU分割的模式占比表

Tab.1 The proportion of prediction modes in the best CU segmentation

SequenceNameTypeIntraIBC+PLT命中率sc_consoleTGM43.82%56.18%69.36%MissionControlClip3MIX59.14%40.86%71.25%sc_robotA94.74%5.26%83.40%KimonoCC99.96%0.04%99.96%

图2 标准测试序列角点占比统计图

Fig.2 Statistic chart of standard test sequences

2.2 水平活动度和垂直活动度特征

与摄像机捕获的内容相比,屏幕内容图像含有大量的垂直边缘或水平边缘。这些区域通常比较平坦,没有角点,出现在背景区域。这里我们统计了高对比度视频帧,即标准测试序列“MissionControlClip3”的首帧,其中使用传统帧内和使用IBC/PLT的背景CU所含垂直边缘和水平边缘CU的占比,如表2所示,在背景CU中,约23.20%的CU含有垂直/水平边缘,且这些CU在各模式的CU个数占比水平相当,在含有水平/垂直边缘的CU中26.7%选择了IBC/PLT模式。对该类CU跳过IBC/PLT模式检测进行实验,结果显示码率上升严重,说明传统帧内模式、IBC以及 PLT模式均可以很好地预测此类CU,对此类CU,IBC/PLT的模式预测不可忽略。因此,本文根据CU的水平活动度和垂直活动度,来判断是否检测IBC和PLT的预测模式。

表2 垂直/水平边缘CU在背景CU中的占比表

Tab.2 The proportion of vertical/horizontal edge CU in background CU

IntraIBC+PLT总数垂直/水平边缘的CU18816852566背景CU8531252811059占比22.05%27.09%23.20%

提取的水平活动度和垂直活动度的特征如下:

(2)

(3)

其中,l(x,y)是位置(x,y)处的亮度值,w和h为当前CU的宽和高。当ACTH和ACTV等于0时,判定当前CU需要检测IBC和PLT预测模式。所提算法将高对比度屏幕视频帧背景CU中垂直活动度或水平活动度为0,即满足ACTH=0‖ACTV=0的CU划分为屏幕内容背景CU,其不仅需要检测传统帧内模式,而且需要检测IBC和PLT模式。

2.3 平均颜色亮度差特征

屏幕内容图像通常色调离散,而颜色饱和度高,图像块像素差值较大而颜色个数较少,通常会含有较高的平均亮度差值[14]。我们联合平均亮度差值与水平/垂直活动度特征来区分高对比度屏幕视频帧的屏幕内容背景CU和自然图像的背景CU。由于VVC复杂的分割方式使得CU尺寸种类众多,最小的CU尺寸为4×4,为了使衡量不同尺寸CU的平均颜色亮度差特征,首先对当前的屏幕视频帧以4×4大小的窗口,以4为步长,计算窗口内的平均亮度差MLG(Mean Luminance Gap),其计算公示为:

(4)

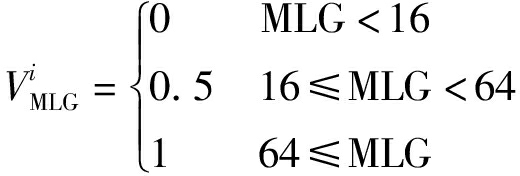

其中,Lmax为当前窗口内的亮度的最大值,Lmin为当前窗口内亮度的最小值,N为不同的颜色个数。然后对当前窗口的平均亮度差进行归一化:

(5)

对于每个CU,对其包含的4×4窗口的亮度归一化差值进行平均,得到当前CU的平均亮度归一化差值VMLG,计算公式为

(6)

其中,VMLG代表当前CU包含了n个大小为4×4的窗口的平均亮度归一化差值。

这里将背景CU中,垂直活动度和水平活动度均大于1且平均亮度归一化差值大于0.5,即满足VMLG>0.5&&ACTH>1&&ACTV>1的CU也划分为屏幕内容背景CU,要检测传统帧内、IBC和PLT模式。其余的背景CU划分为自然图像背景CU,只检测传统的帧内模式。

3 采用联合特征的H.266/VVC屏幕内容编码快速模式选择算法

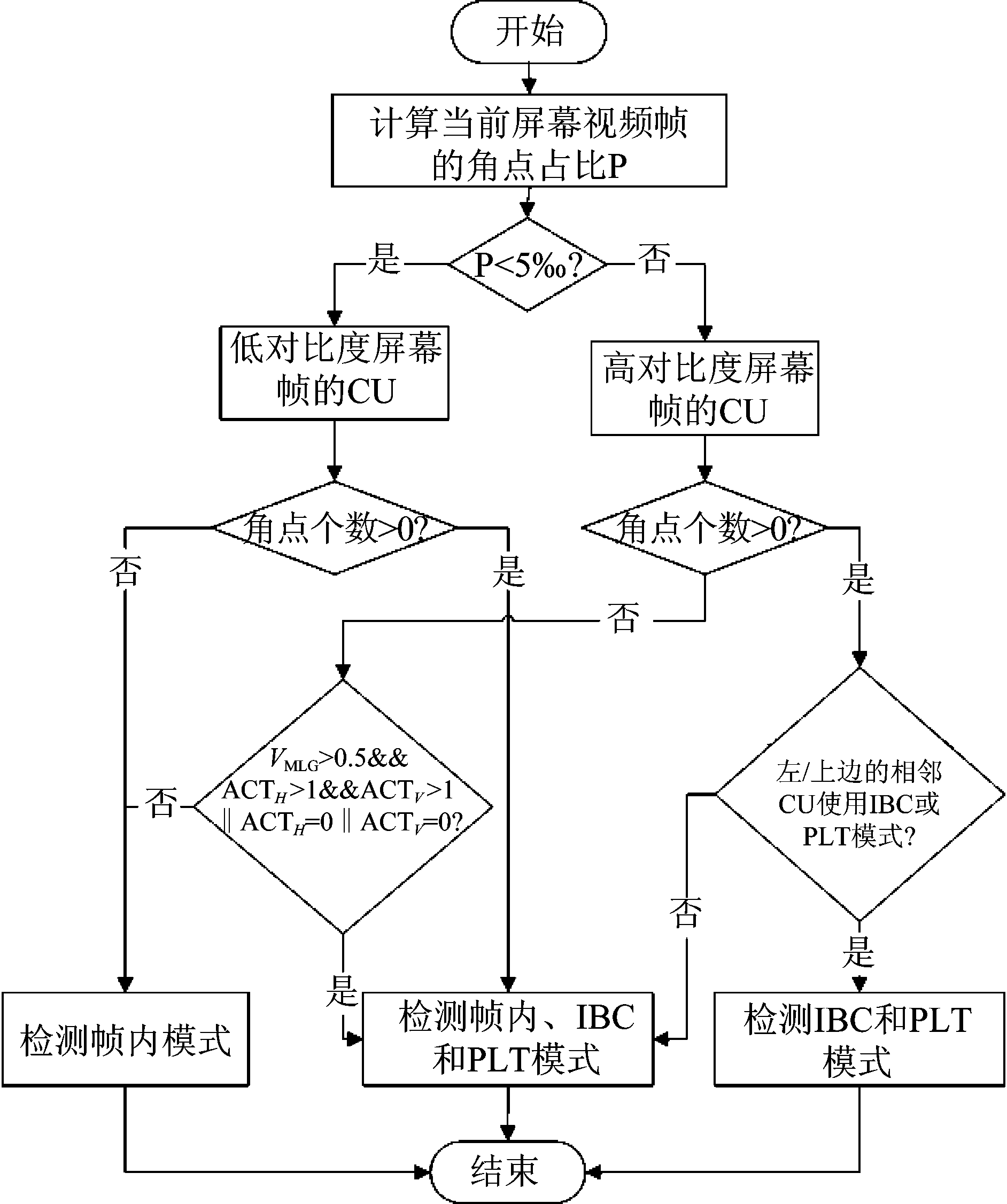

在实验测试中我们发现,仅使用单一的特征来区分屏幕内容CU和自然图像CU会使得分类准确度不高,带来严重的视频质量损失和极大的码率增加。因此我们联合使用了角点、CU的水平/垂直活动度、平均颜色亮度差特征,对视频帧的高低对比度,CU的背景/前景、屏幕/自然做了分类,并对不同分类分情况进行模式选择,减少了对应分类的模式选择数。算法框图如图3所示。

图3 本文算法流程图

Fig.3 Flowchart of the proposed algorithm

1)基于角点占比不同,我们将视频帧分为高对比度视频帧和低对比度视频帧,根据是否有角点将当前CU划分为前景CU和背景CU。对于低对比度视频帧,其背景CU通常为自然图像区域,传统帧内模式可以有效的对其进行预测,因此跳过IBC和PLT模式,前景CU通常更符合屏幕内容图像特性,因此只检测IBC和PLT模式;对于高对比度视频帧,根据水平活动、垂直活动以及平均亮度归一化差值可以将背景CU分为自然图像背景CU和屏幕内容背景CU,并对自然图像CU检测传统帧内预测模式,屏幕内容背景CU执行传统帧内模式、IBC、PLT模式预测,对检测出角点的前景CU,通过相邻左边和上边CU的预测模式加以约束,进行当前CU的模式选择。算法步骤如下:对当前输入的视频帧进行角点检测,并计算角点占比P,当角点占比小于5![]() 时,将其划分为低对比度屏幕内容视频帧,进入步骤2;否则划分为高对比度屏幕内容视频帧,进入步骤3。

时,将其划分为低对比度屏幕内容视频帧,进入步骤2;否则划分为高对比度屏幕内容视频帧,进入步骤3。

2)对于低对比度视频帧,检测当前CU是否有角点,如果未检测出角点,那么当前CU为背景CU且为自然图像CU,只进行传统帧内预测模式的检测,否则,当前CU为前景CU,检测传统帧内、IBC和PLT模式,然后进入步骤6。

3)对于高对比度屏幕视频帧,以4×4大小的窗口,4为步长,计算窗口内的平均亮度差(MLG),然后对平均亮度差进行归一化,得到归一化值![]() 检测当前CU是否有角点,如果未检测出角点,则当前CU为背景CU,转至步骤4,否则,当前CU为前景CU,转至步骤5。

检测当前CU是否有角点,如果未检测出角点,则当前CU为背景CU,转至步骤4,否则,当前CU为前景CU,转至步骤5。

4)将当前CU的平均亮度差值归一值取平均得到平均亮度归一化差值(VMLG),计算当前CU的水平活动度(ACTH)及垂直活动度(ACTV),若满足ACTH=0‖ACTV=0或VMLG>0.5&&ACTH>1&&ACTV>1时,该CU为屏幕内容背景CU,检测帧内预测模式,IBC和PLT模式,否则为自然图像背景CU,只检测传统帧内模式。

5)若相邻左边或上边CU使用了IBC或PLT预测模式,则当前CU直接跳过传统帧内的预测模式,只检测IBC和PLT模式,否则检测传统帧内、IBC和PLT模式。

6)结束模式预测。

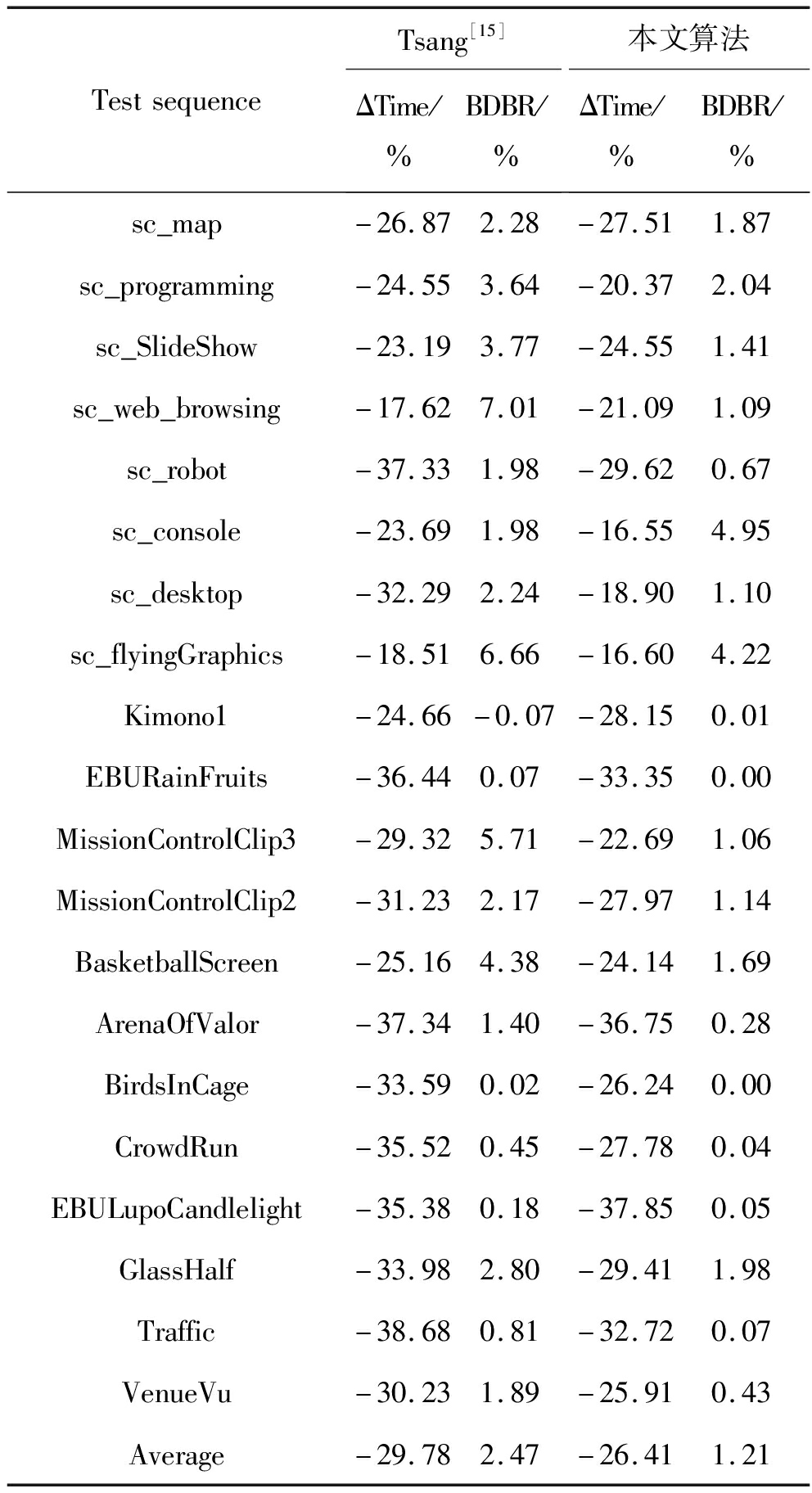

4 实验结果

为验证所提算法的有效性,我们在H.266/VVC的测试平台VTM-7.3[17]上进行测试仿真。实验遵循CTC的测试条件[18],所有视频序列均为4∶4∶4采样格式,使用全帧内(AI)的配置,QP设置为22,27,32,37。实验采用ΔTime和BDBR评价所提算法的性能,结果如表3所示,ΔTime表示所提算法较H.266/VVC标准测试平台VTM-7.3节省的时间:

表3 所提算法和其他VVC-SCC快速算法的比较

Tab.3 Comparison of the proposed algorithm with other VVC-SCC fast algorithm

TestsequenceTsang[15]ΔTime/%BDBR/%本文算法ΔTime/%BDBR/%sc_map-26.872.28-27.511.87sc_programming-24.553.64-20.372.04sc_SlideShow-23.193.77-24.551.41sc_web_browsing-17.627.01-21.091.09sc_robot-37.331.98-29.620.67sc_console-23.691.98-16.554.95sc_desktop-32.292.24-18.901.10sc_flyingGraphics-18.516.66-16.604.22Kimono1-24.66-0.07-28.150.01EBURainFruits-36.440.07-33.350.00MissionControlClip3-29.325.71-22.691.06MissionControlClip2-31.232.17-27.971.14BasketballScreen-25.164.38-24.141.69ArenaOfValor-37.341.40-36.750.28BirdsInCage-33.590.02-26.240.00CrowdRun-35.520.45-27.780.04EBULupoCandlelight-35.380.18-37.850.05GlassHalf-33.982.80-29.411.98Traffic-38.680.81-32.720.07VenueVu-30.231.89-25.910.43Average-29.782.47-26.411.21

(7)

其中,Tproposed表示本文提出算法的平均编码时间,Tanchor表示开启IBC和PLT预测模式时VTM-7.3的原始编码时间。BDBR[19]表示在同样的客观质量下码率的节省情况,BD-PSNR表示在给定的同等码率下PSNR-Y的差异。可以看出,本算法平均节省了26.41%的时间,BDBR平均增加1.21%。特别地,该快速算法对于含有文本图型的测试序列以及动画序列更为有效,如“MissionControlClip2”和“sc_robot”序列;而对于图像内容过于复杂,线条细腻,细节过多的视频序列,如“sc_console”和 “sc_flyingGraphics”序列,其编码单元倾向于分割成小尺寸的CU,在 CU分类时准确度欠佳,因此码率增加略多。Tsang[15]的算法在时间节省上虽略优于本文所提算法,但BDBR增加为所提算法的2.04倍,所提算法在BDBR的上升与时间节省中做了更好的折中。

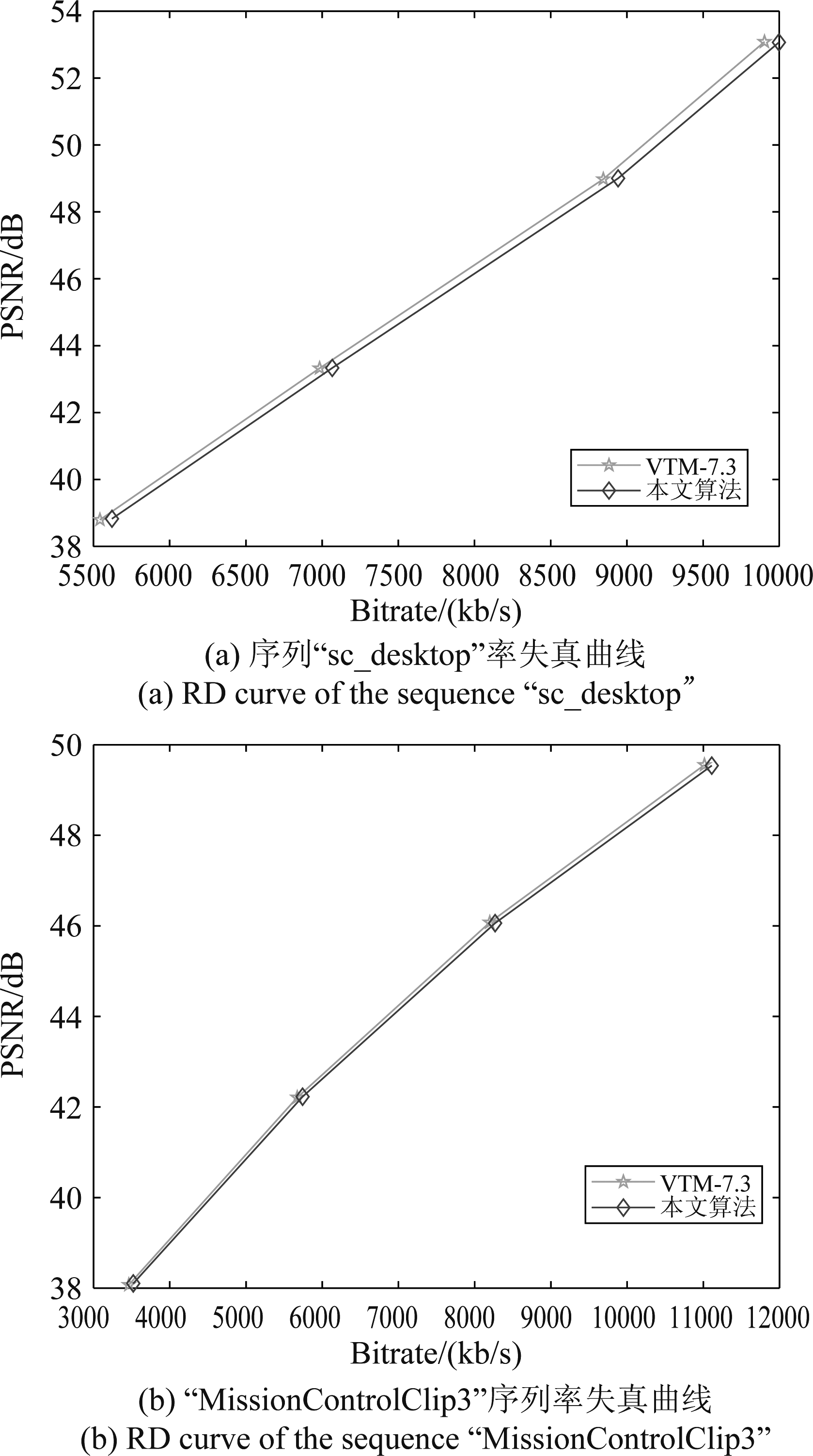

图4给出了测试序列“sc_desktop”和“MissionControlClip3”的率失真曲线,将本文算法与VVC-SCC原始算法的率失真曲线进行比较。可以看出,所提算法与原始算法的率失真曲线非常接近,说明所提算法可以有效降低编码器的计算复杂度,而视频质量损失可忽略不计。

图4 所提算法与原始算法的率失真曲线比较

Fig.4 RD curves of the proposed algorithm compared with the original algorithm

5 结论

本文首次将屏幕视频编码快速算法的研究实践到H.266/VVC的标准上。联合使用角点特征、水平/垂直活动度和平均颜色亮度差等利于表征屏幕内容视频的特征对CU进行分类,并对不同分类采用差异化的模式跳过策略,减少模式选择的代价。实验结果显示本文所提算法在全帧内的模式下,相较于H.266/VVC VTM-7.3屏幕内容视频的标准算法相比,平均节省26.41%的编码时间,只增加1.21%的比特率,有效降低了H.266/VVC屏幕内容的编码复杂度。

[1] PENG W H, WALLS F G, COHEN R A, et al.Overview of screen content video coding: Technologies, standards, and beyond[J].IEEE Journal on Emerging and Selected Topics in Circuits and Systems, 2016, 6(4): 393-408.

[2] XU Xiaozhong, LI Xiang, LIU Shan.Intra block copy in versatile video coding with reference sample memory reuse[C]∥2019 Picture Coding Symposium(PCS).Ningbo, China.IEEE, 2019: 1-5.

[3] SUN Yuchen, LOU Jian, CHAO Y H, et al.Analysis of palette mode on versatile video coding[C]∥2019 IEEE Conference on Multimedia Information Processing and Retrieval(MIPR).San Jose, CA, USA.IEEE, 2019: 455-458.

[4] KEATING S,KONDO K.Use of ACT with IBC.Document JVET-S0170, Jun.2020.

[5] LIU Hongbin, ZHANG Li, ZHANG Kai, et al.Adaptive motion vector resolution for affine-inter mode coding[C]∥2019 Picture Coding Symposium(PCS).Ningbo, China.IEEE, 2019: 1-4.

[6] 丁佳军, 陈婧, 曾焕强, 等.结合时空梯度感知特征的HEVC-SCC码率控制算法[J].信号处理, 2019, 35(3): 402-409.

DING Jiajun, CHEN Jing, ZENG Huanqiang, et al.Rate control algorithm for HEVC-SCC with perceptual features of spatial and temporal gradient[J].Journal of Signal Processing, 2019, 35(3): 402-409.(in Chinese)

[7] PFAFF J, STALLENBERGER B, SCH FER M, et al.CE3: Affine linear weighted intra prediction.Document JVET-N0217, March.2019.

FER M, et al.CE3: Affine linear weighted intra prediction.Document JVET-N0217, March.2019.

[8] SALDANHA M, SANCHEZ G, MARCON C, et al.Complexity analysis of VVC intra coding[C]∥2020 IEEE International Conference on Image Processing(ICIP).Abu Dhabi, United Arab Emirates.IEEE, 2020: 3119-3123.

[9] DE-LUX N-HERN

N-HERN NDEZ S, GEORGE V, MA J, et al.An intra subpartition coding mode for VVC[C]∥2019 IEEE International Conference on Image Processing(ICIP).Taipei, Taiwan, China.IEEE, 2019: 1203-1207.

NDEZ S, GEORGE V, MA J, et al.An intra subpartition coding mode for VVC[C]∥2019 IEEE International Conference on Image Processing(ICIP).Taipei, Taiwan, China.IEEE, 2019: 1203-1207.

[10] CHEN Jianle, YE Yan, KIM S.Algorithm description for Versatile Vi iption for Versatile Video Coding and Test Model 10, Document JVET-S2002-v1,Jul.2020.

[11] 欧健珊, 陈婧, 曾焕强, 等.结合内容特性与纹理类型的HEVC-SCC帧内预测快速算法[J].信号处理, 2020, 36(3): 382-388.

OU Jianshan, CHEN Jing, ZENG Huanqiang, et al.Fast intra prediction algorithm for HEVC-SCC based on the content property and texture mode[J].Journal of Signal Processing, 2020, 36(3): 382-388.(in Chinese)

[12] LEI Jianjun, LI Dongyang, PAN Zhaoqing, et al.Fast intra prediction based on content property analysis for low complexity HEVC-based screen content coding[J].IEEE Transactions on Broadcasting, 2017, 63(1): 48-58.

[13] TSANG S H, CHAN Y L, KUANG Wei, et al.Reduced-complexity intra block copy(IntraBC)mode with early CU splitting and pruning for HEVC screen content coding[J].IEEE Transactions on Multimedia, 2019, 21(2): 269-283.

[14] BADRY E, SHALABY A, SAYED M S.Intra mode decision acceleration for HEVC screen content coding[C]∥2019 7th International Japan-Africa Conference on Electronics, Communications, and Computations,(JAC-ECC).Alexandria, Egypt.IEEE, 2019: 92-95.

[15] TSANG S H, KWONG N W, CHAN Y L.FastSCCNet: fast mode decision in VVC screen content coding via fully convolutional network[C]∥2020 IEEE International Conference on Visual Communications and Image Processing(VCIP).Macao, China.IEEE, 2020: 177-180.

[16] KUANG Wei, CHAN Y L, TSANG S H, et al.Online-learning-based Bayesian decision rule for fast intra mode and CU partitioning algorithm in HEVC screen content coding[J].IEEE Transactions on Image Processing, 2020, 29: 170-185.

[17] VTM-7.3[online].Available: https:∥vcgit.hhi.fraunhofer.de/jvet/VVCSoftware_VTM/-/tree/VTM-7.3.

[18] BOYCE Y, SUEHRING K, LI Xiang, et al.JVET common test conditions and software reference configurations,Document JVET-J1010-v1, Apr.2018.

[19] BJONTEGAARD G.Calculation of Average PSNR Differences between RD-curves.Document VCEG-M33 Apr.2001.