1 引言

超宽带雷达相比于窄带雷达具有宽频和低频的特点,可获取更为丰富的目标散射信息,可对墙体、挡板、树叶等非透明介质进行穿透探测,在目标成像、目标识别、穿墙探测、叶簇透视等方面广泛应用[1-2]。在人体目标探测方面,根据应用场景的不同,超宽带雷达系统可以分为一维、二维和三维超宽带雷达系统。其中一维超宽带雷达可以提供目标的距离信息,在利用微多普勒效应进行行为识别方面也有应用[3-4]。而二维和三维超宽带雷达借助多输入多输出(MIMO)技术实现了目标多维信息的获取,二维超宽带雷达的收发单元一般采用线阵排列方式,可以提供目标的距离和方位信息,主要用于目标的定位和跟踪[5];三维超宽带雷达的收发单元采用面阵排列方式,可以提供目标的距离、方位和高度三维空间信息,进而获取更详细的人体目标身体结构及行为姿态信息,在反恐维稳、城市巷战、震后救援等领域的应用具有重大的意义。

2008年Ahmad等人最早开始展开三维超宽带雷达成像技术的研究,使用基于波束形成的方式实现了对近场目标的三维成像[6]。2009年电子科技大学的孔令讲等采用1 GHz-2 GHz的低频大型二维面阵雷达对近距离目标进行三维成像,但是由于系统分辨率的限制,成像结果并不理想[7]。2015年MIT的Fadel等提出了一种基于“T”字形阵列的“RF-capture”方法,该方法根据人体运动模型进行了散射点对齐技术研究,得到了清晰的人体轮廓像[8],但仅可分辨较少的动作种类。2020年国防科技大学的戴永鹏等利用卷积神经网络(convolutional neural network, CNN)对多帧积累的人体目标成像结果进行增强,使人体目标的主瓣锐化,栅旁瓣受到抑制,实现了多种动作的分辨[9-10]。经过数十年的研究,三维超宽带雷达成像技术已经取得了较大的进步,然而这些成像方法本质上仍然属于二维成像,难以反映人体目标在三维空间中的身体结构信息。同时,也未解决随着人体目标距离的变远,可视化能力逐渐变差的问题。

近年来,深度学习技术在光学图像领域得到了快速发展[11-12],其中人体姿态重构是一项热点研究。多种深度学习方法利用卷积神经网络去提取图像中人体目标的关节信息,实现了高精度的人体姿态重构,效果明显优于基于手工提取特征的传统方法,该技术在人机交互、机器人技术、监控和虚拟现实等领域广泛应用[13]。

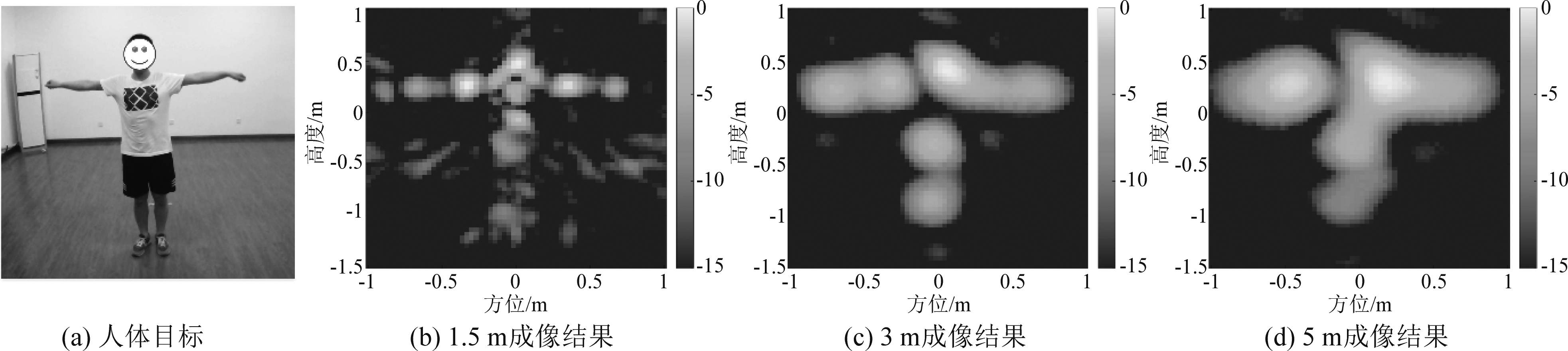

针对雷达图像面临的问题,参考基于光学图像的人体姿态重构领域的研究成果,本文设计了一种基于距离辅助的超宽带MIMO雷达图像人体姿态重构网络。首先,使用三维超宽带雷达对人体目标进行探测成像,获得人体目标的距离信息和三维雷达图像。其次,根据距离选择合适的距离模块化网络参数,将三维雷达图像输入训练好的姿态重构网络,依次进行特征提取和姿态重构得到人体目标的关节位置的三维概率置信热图。最后,使用soft-argmax函数从概率置信图中提取人体目标的关节点位置坐标,得到人体目标的三维姿态图。本文利用实际系统构建数据集训练,并进行实测验证,实验结果表明,本文提出的方法可以从三维雷达人体图像中重构出准确的人体目标的姿态。相比于传统的增强成像结果,本方法的适应性更强,更便于可视化。

2 基础原理

2.1 MIMO雷达成像原理

MIMO雷达有多个发射天线和多个接收天线,因此可以获得较大的探测范围和更高的信号增益,在目标识别和分类方面广泛使用。目前常见的MIMO阵列有线阵和面阵两种,其中线阵可以获取目标的距离和方位二维信息,而面阵可以获取目标的距离、方位和高度三维信息,本文所使用的MIMO雷达阵列即为面阵排布[14-15]。

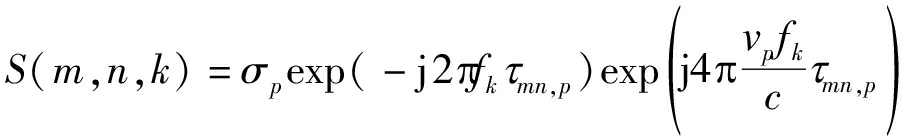

本文采用步进频连续波作为发射信号,该信号相比于窄脉冲雷达信号有更大的发射功率和更远的作用距离。对于图1中人体目标上的一点p,接收到的雷达回波可以表示为:

(1)

其中,σp为点p的散射系数,vp为点p的运动速度, fk为第k个频点对应的频率,τmn,p是信号从第m个发射天线到点p再到第n个接收天线之间的时延,即τmn,p=(LTm+LRn)/c,其中c为光速。另外,m=1,2,...,M,n=1,2,...,N,其中M和N分别为发射天线和接收天线的数量。

后向投影算法(Back-projection, BP)是一种最常用的成像算法,适用于各种阵列排布形式。其基本成像原理是,计算目标点到发射天线和接收天线之间的时延,然后将所有的回波信号相参叠加,在目标点所在空间位置形成一个聚焦的点[16]。对于目标点p的回波信号S(m,n,k)进行BP成像的过程可以表示为

(2)

其中,K是总的频点数,MN为总的天线通道数。由式(2)可知,BP成像的过程本质上是一种离散傅里叶变换,通过计算空间中的像素点到收发天线的传播延时来确定相位补偿因子,使处理后的信号在目标位置出现峰值。对于图1中的点p来说,对MN个通道的回波信号进行相位补偿后相参叠加,信号能量在p点所在的空间位置聚焦。人体目标是由多个散射点组成的扩展目标,对人体目标的所有散射点进行遍历计算,即可得到人体目标在空间位置上的方位、距离、高度三维轮廓像。当目标被墙体遮挡时,信号的传输路径会发生改变,需要根据墙体的材料采取相应的墙体补偿算法将目标补偿到正确的位置。墙体补偿的研究较多相对成熟,且不是本文的研究重点,所以这里不再具体介绍。

图1 MIMO雷达成像几何原理图

Fig.1 Geometric principle diagram of MIMO radar imaging

2.2 成像分辨率

二维面阵排布的超宽带MIMO雷达的宽带信号决定了系统具有距离向信息获取能力,方位向和高度向的天线排布决定了系统具有方位向和高度向信息的获取能力,因此可以通过成像处理得到探测场景的三维成像结果,其中三个维度的成像分辨率计算如式(3)所示:

(3)

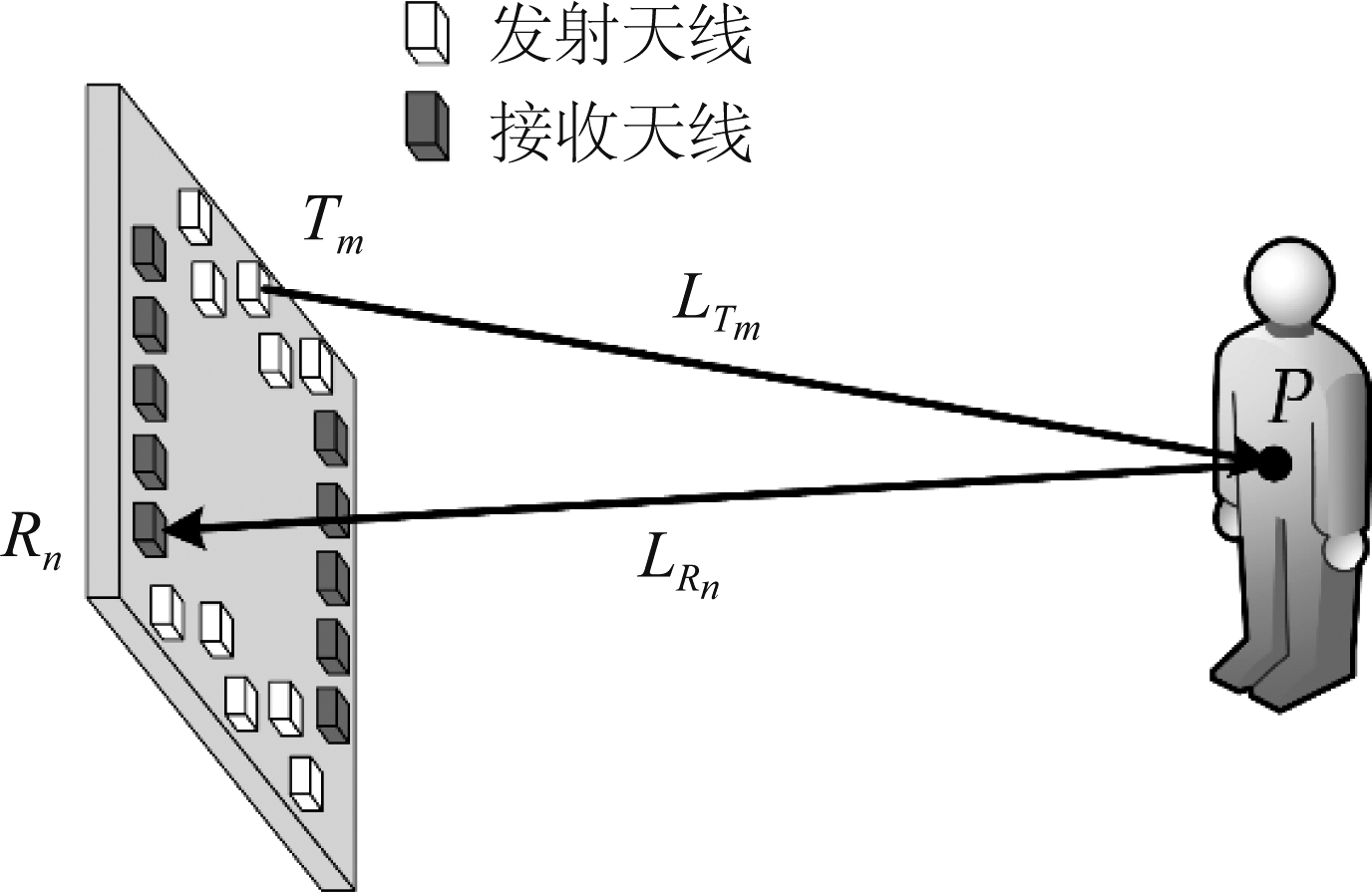

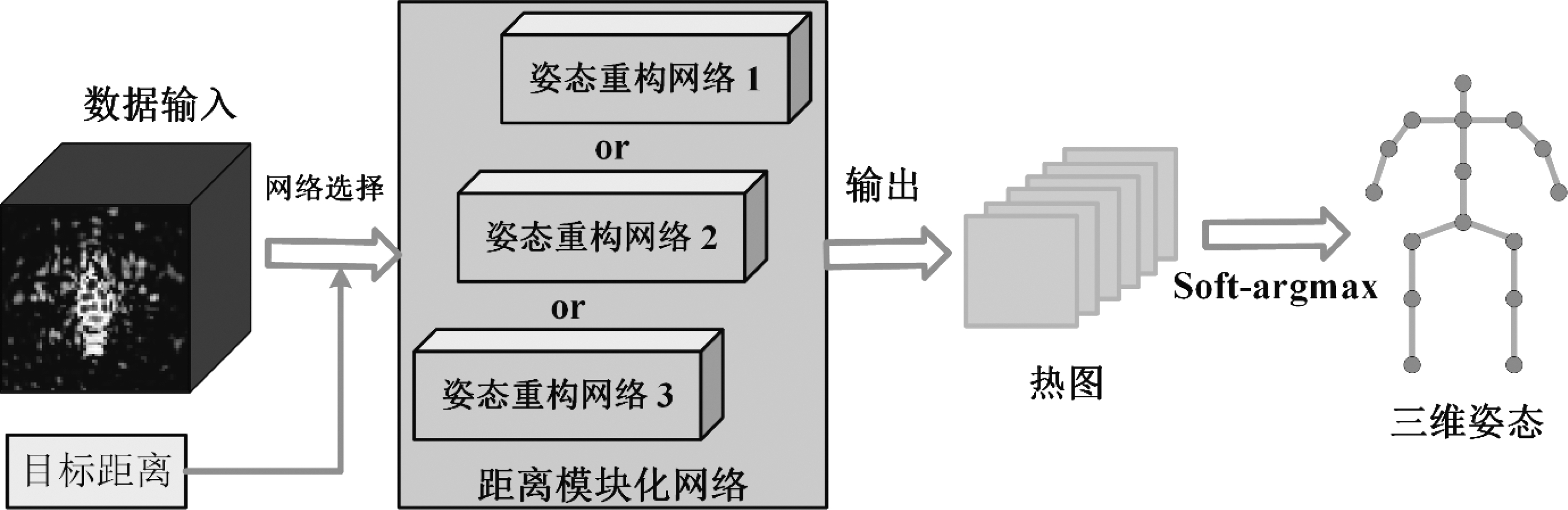

式中,δr、δa、δe分别为MIMO雷达的距离分辨率、方位分辨率和高度分辨率,其中,B是信号带宽,λ=c/f为波长, f为信号频率,da为MIMO阵列孔径宽度,de为MIMO阵列孔径高度。显然,更高的载频、更大的带宽和更大的等效孔径意味着超宽带雷达系统拥有更高的成像空间分辨率。然而,在实际的应用中,综合考虑成本、便携性及使用场景等因素,超宽带MIMO雷达的成像分辨率通常比较低,成像结果不便于可视化。同时,随着距离的变远,方位分辨率和高度分辨率逐渐降低,成像质量变差。使用超宽带雷达系统对不同距离的同一姿态的人体目标进行探测并三维成像,得到结果如图2所示,其中图2(a)为人体目标姿态,图2(b)、(c)、(d)分别是人体目标距离雷达系统1.5 m、3 m、5 m时的三维成像结果的投影。由图2可知,随着目标距离的变远,MIMO雷达成像质量逐渐变差,且比较抽象,很难直接对远处人体目标的姿态进行判断。因此需要采取一些超分辨算法或者借助深度学习工具提升雷达成像结果的可读性。

图2 不同距离人体雷达成像结果

Fig.2 The radar imaging results of human targets with different distance

3 本文方法

3.1 整体算法框架

光学图像与三维雷达图像的不同点是光学图像有较好的分辨率,三维雷达图像包含了人体目标的三维空间信息;相同点是都包含了可以用于姿态重构的人体目标的身体结构信息。与光学图像相比,虽然三维雷达图像的分辨率较低,但其包含了更多维度的目标信息,因此从三维雷达图像中重构人体目标的姿态存在可能性。同时,考虑超宽带雷达的应用场景一般是建筑物内、隐蔽空间,探测空间大小一般是在近场距离范围内(<10 m)。所以,通过以距离作为辅助信息,建立距离段模块化网络,以克服距离增大带来的精度下降问题,具有实用性。

根据光学图像人体姿态重构网络的设计思路并结合三维雷达图像的特性,本文设计了三维超宽带雷达图像人体姿态重构方法,该算法的整体流程图如图3所示。算法的整体功能是由低分辨率的三维图像得到易于理解的三维姿态。考虑到人体目标的三维成像结果在不同距离段存在较大的差异,本文将人体目标的距离信息作为约束,建立距离段模块化网络,即不同距离目标的三维雷达图像选择不同的距离模块化姿态重构网络模型进行处理,得到各个关节点位置的概率置信热图;最后通过soft-argmax函数从热图中提取人体目标的三维姿态。需要说明的是,距离模块化网络包含多个使用不同距离段的三维雷达图像和标签训练好的姿态重构网络,具体如图3所示。其中距离模块化网络中的姿态重构网络结构相同,由于不同姿态重构网络的训练数据不同,所以不同网络内部参数存在差异。在实际使用的过程中,检测得到人体目标的距离和三维雷达图像,以目标距离作为辅助信息选择相应距离段的姿态重构网络模型进行姿态重构。下面几个小节介绍该算法流程的具体内容。

图3 算法框架流程图

Fig.3 Flow chart of the proposed framework

3.2 三维雷达图像获取

获取人体目标的三维雷达图像最直接的方法是对这个探测区域进行三维BP成像,但是考虑到成像范围较大,直接三维成像运算量巨大。因此,本文采用首先对整个探测场景进行距离-方位平面的二维成像,再检测、聚类、跟踪锁定目标位置,获得目标的距离和方位信息,然后在目标所在小范围区域进行高网格密度的三维成像。在适用于超宽带雷达使用的低人数密度场景中,本文的三维雷达图像获取方法兼顾了成像效率和成像质量。

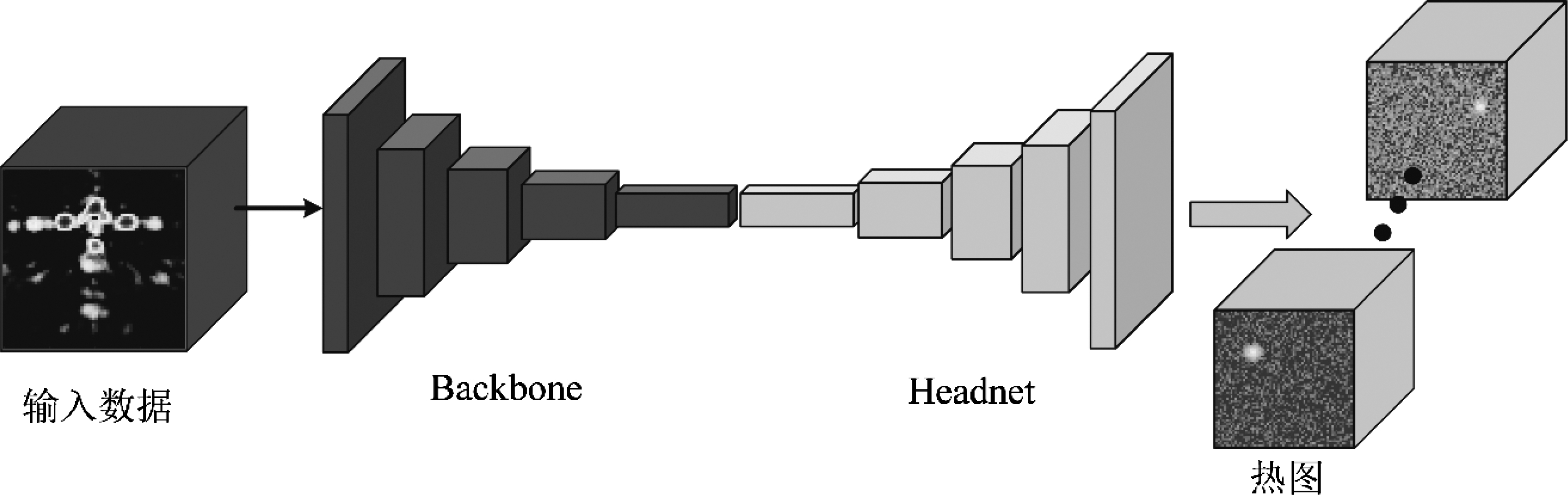

3.3 姿态重构网络

本文采用一种基于CNN的沙漏网络进行超宽带雷达图像人体姿态重构,该网络结构图如图4所示,是一种典型的端到端全卷积神经网络。该网络主要由backbone模块和headnet模块组成,其中backbone模块是基于Resnet网络设计的,避免了训练过程中的梯度弥散或爆炸的问题,该模块主要用于进行输入数据的特征提取。而headnet模块由多个反卷积组成,用于人体三维姿态的重构。网络的输入数据为三维雷达图像,包含目标的距离、方位和高度三个维度的信息,首先通过backbone模块中的多个残差块逐层提取雷达图像的人体目标的信号强度和关节点位置信息。假设输入的雷达图像为x,则backbone模块中第一个残差块的输出可以表示为:

图4 人体姿态重构网络图

Fig.4 Human pose reconstruction network structure

y=W2σ(W1x)+x

(4)

其中W1和W2为残差块的两层权重,σ为Relu激活函数。依次对输入数据进行多层残差处理后得到人体目标雷达图像的深层特征,然后将这些深层特征经过headnet模块处理,最终输出是各个关节点在空间位置的三维概率置信图。

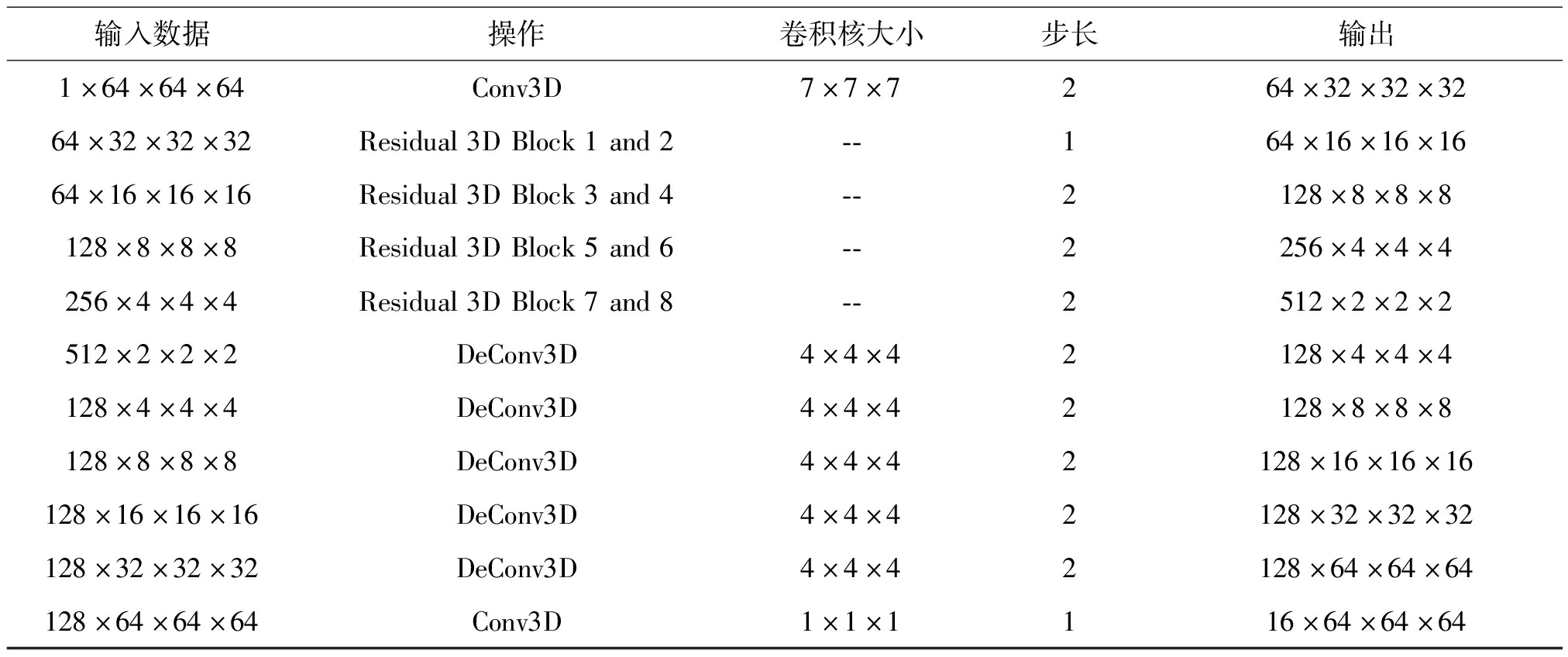

本文设计的姿态重构网络的具体结构参数如表1所示,输入数据首先经过一个Conv3D模块进行特征提取,然后通过8个Residual 3D模块得到更深层的特征。最后通过5个deConv3D模块和一个Conv3D得到各个关节点的位置概率置信图,其中,概率最大的点的位置即为该关节点在空间中的三维坐标位置。

表1 整体网络结构参数表

Tab.1 Overall network structure parameters

输入数据操作卷积核大小步长输出1×64×64×64Conv3D7×7×7264×32×32×3264×32×32×32Residual 3D Block 1 and 2--164×16×16×1664×16×16×16Residual 3D Block 3 and 4--2128×8×8×8128×8×8×8Residual 3D Block 5 and 6--2256×4×4×4256×4×4×4Residual 3D Block 7 and 8--2512×2×2×2512×2×2×2DeConv3D4×4×42128×4×4×4128×4×4×4DeConv3D4×4×42128×8×8×8128×8×8×8DeConv3D4×4×42128×16×16×16128×16×16×16DeConv3D4×4×42128×32×32×32128×32×32×32DeConv3D4×4×42128×64×64×64128×64×64×64Conv3D1×1×1116×64×64×64

3.4 Soft-argmax

本文使用soft-argmax函数求人体关节点位置的最大置信度坐标,相比于常用的argmax函数,soft-argmax函数是可微的,可以计算梯度,提供了更高精度的位置估计方法。设姿态重构网络输出的人体目标各个关节点置信概率分布为Hk(p),其中k是指第k个关节点,p是成像空间中的一点,soft-argmax函数的作用即是将该概率分布中置信度最大的位置索引作为该关节点的三维位置坐标Jk,其表达式为:

(5)

其中

(6)

式(6)即为Hk(p)进行softmax函数指数归一化处理的结果,Ω是指整个人体成像空间域,D、W、H分别是人体成像空间网格中对应的距离向、高度向和方位向长度。

3.5 损失函数

本文在训练过程中通过将真实关节点坐标与重构关节点坐标之间的 2距离作为损失函数来控制网络的收敛,该损失函数式为:

2距离作为损失函数来控制网络的收敛,该损失函数式为:

(7)

其中,T为训练过程中的batch size,N为人体关节点总个数,![]() 为第n个关节点位置真值,

为第n个关节点位置真值,![]() 为第n个重构关节点的位置。该损失函数又简称MPJPE(mean per joint position error),是在三维姿态重构领域最常用的评价指标,同时也作为本文的测试误差指标。

为第n个重构关节点的位置。该损失函数又简称MPJPE(mean per joint position error),是在三维姿态重构领域最常用的评价指标,同时也作为本文的测试误差指标。

4 实验设置及结果分析

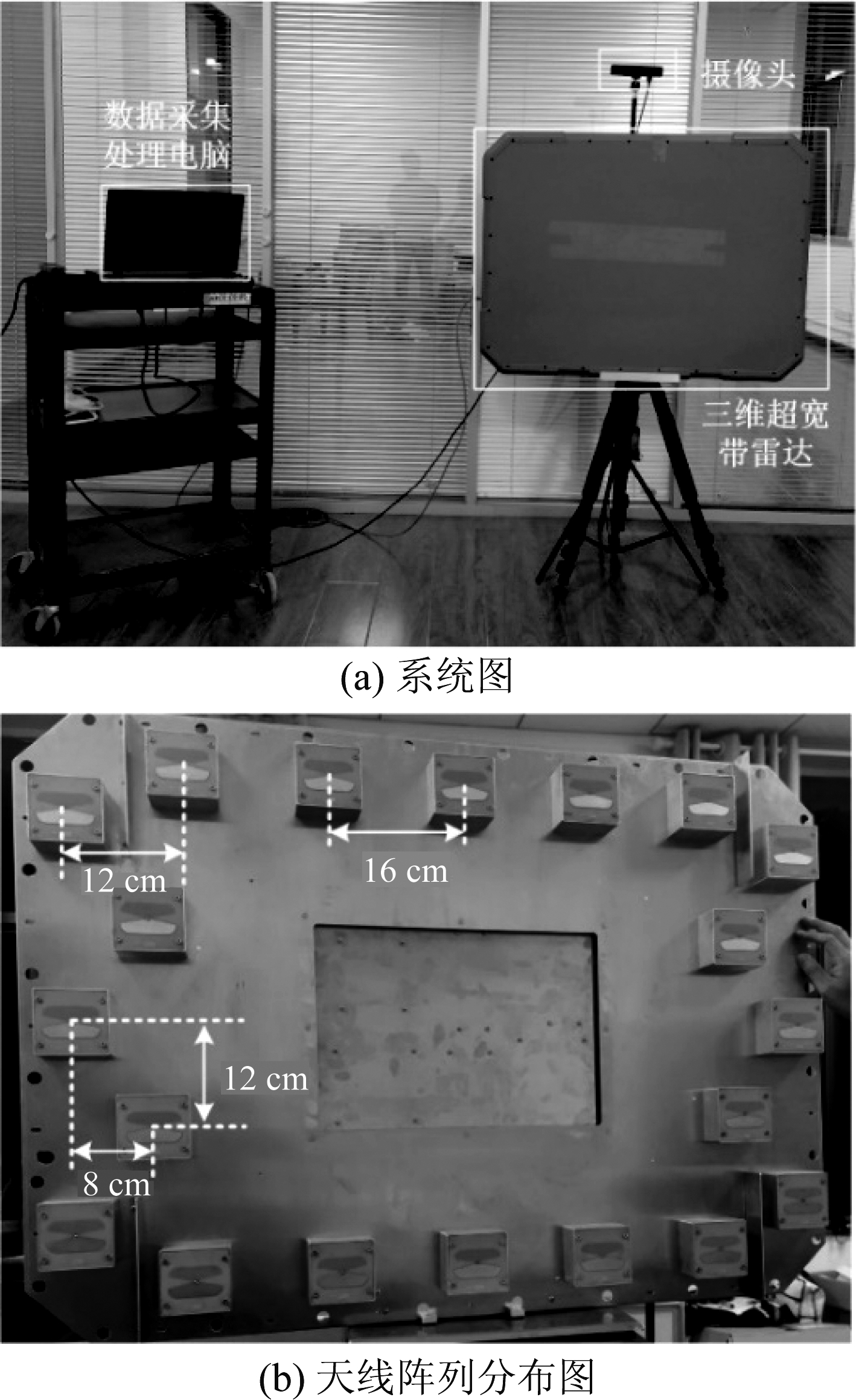

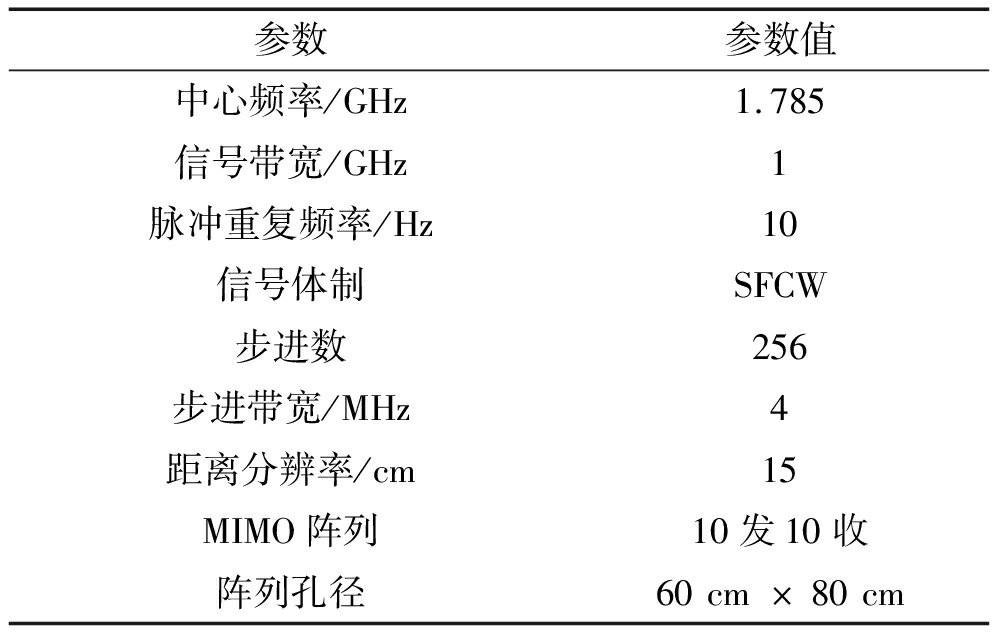

4.1 系统参数设置

本文所使用的系统如图5(a)所示,包括三维超宽带雷达、摄像头和数据采集处理电脑三部分,其中摄像头只在数据集生成的过程中使用,不参与到实际的应用中。三维超宽带雷达的具体参数如下表2所示,由表2可知,我们采用了低频超宽带的雷达体制保证了系统具备一定的穿透性,可以应用于更复杂的遮挡场景。同时,我们也给出了超宽带系统的距离分辨率,方位和高度分辨率与目标的距离相关,可由公式(3)计算得到。本文所使用的超宽带雷达采用了10发10收的MIMO阵列形式,结合MIMO阵列优化技术,设计得到的阵列排布及阵元间距如图5(b)所示,其中左右两边的10个阵列为发射天线,上下的10个阵列为接收天线。另外,为了避免相邻发射天线与接收天线之间的相互干扰,在收发天线之间加了电磁隔离板。

图5 系统实物图

Fig.5 System diagram

表2 雷达系统参数

Tab.2 Radar system parameters

参数参数值中心频率/GHz1.785信号带宽/GHz1脉冲重复频率/Hz10信号体制SFCW步进数256步进带宽/MHz4距离分辨率/cm15MIMO阵列10发10收阵列孔径60cm×80cm

4.2 数据集生成

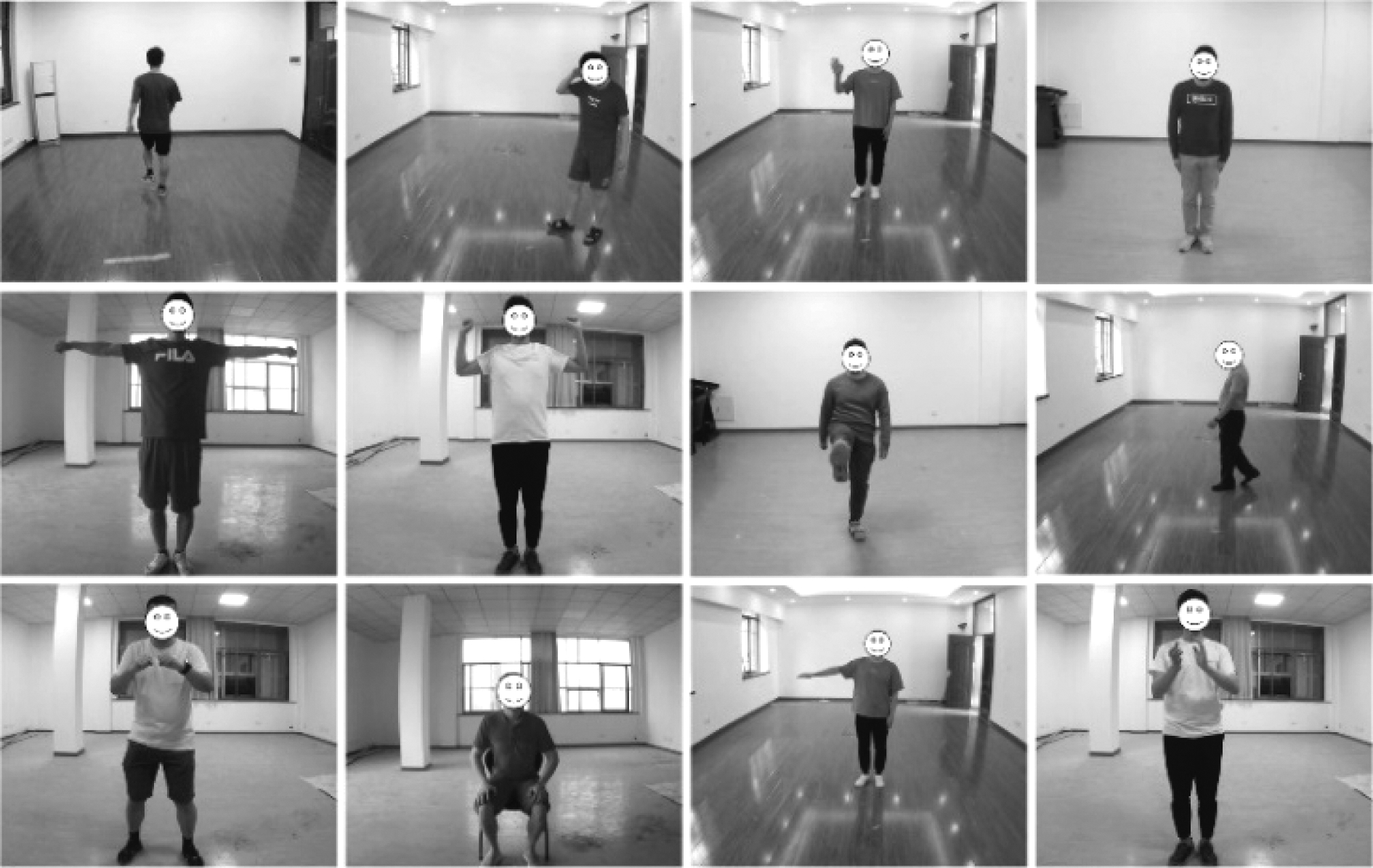

本文的数据集采用超宽带雷达和RGB摄像头联合采集的方法,超宽带雷达用于采集人体目标的雷达数据,RGB摄像头采集人体目标光学图像,通过时间标记将雷达数据和光学图像进行同步。根据雷达系统的脉冲重复频率可知,本系统每秒可以采集10帧数据。对雷达数据进行预处理获得目标的三维雷达图像和距离信息作为样本存入数据集,使用光学领域已经相对成熟的姿态重构网络从RGB图像中重构出人体目标的三维姿态[11],并作为标签真值与三维雷达图像和距离信息一一对应存入数据集。本数据集共包括12万帧数据,其中0~2 m、2~4 m、4~6 m三个距离段各4万帧。每个距离段的数据都包含多人、多场景和多种日常动作信息,具体动作有站立、静坐、走路、跑步、打拳、挥手、踢腿等,部分动作样例如下图6所示。

图6 数据库包含的多种人体动作

Fig.6 Multiple human actions in our dataset

4.3 网络训练

本文的网络训练采用距离模块化网络分别训练的方式,对于某一距离段的训练过程,80%的数据用于网络的训练,20%的数据用于网络的测试,其中训练数据和测试数据来自于不同的人体目标和动作数据。本文采用Adam优化函数来优化网络参数,该函数集合了AdaGrad和RMSProp函数的优点,在各个领域都表现出了较好的自适应学习性能。采用Relu作为激活函数,相比于Sigmoid函数,Relu有较少的计算量,且不存在梯度消失问题,同时也缓和了网络训练中的过拟合问题。网络训练的初始学习率为1×10-3,并且在第20和第30轮训练分别减小10倍,网络共训练50轮。本文所提方法的训练平台的系统内存为32 GB,显卡为NVIDIA GeForce GTX 2070(6 GB),操作系统为Ubuntu 18.04,实现框架为Pytorch深度学习框架。

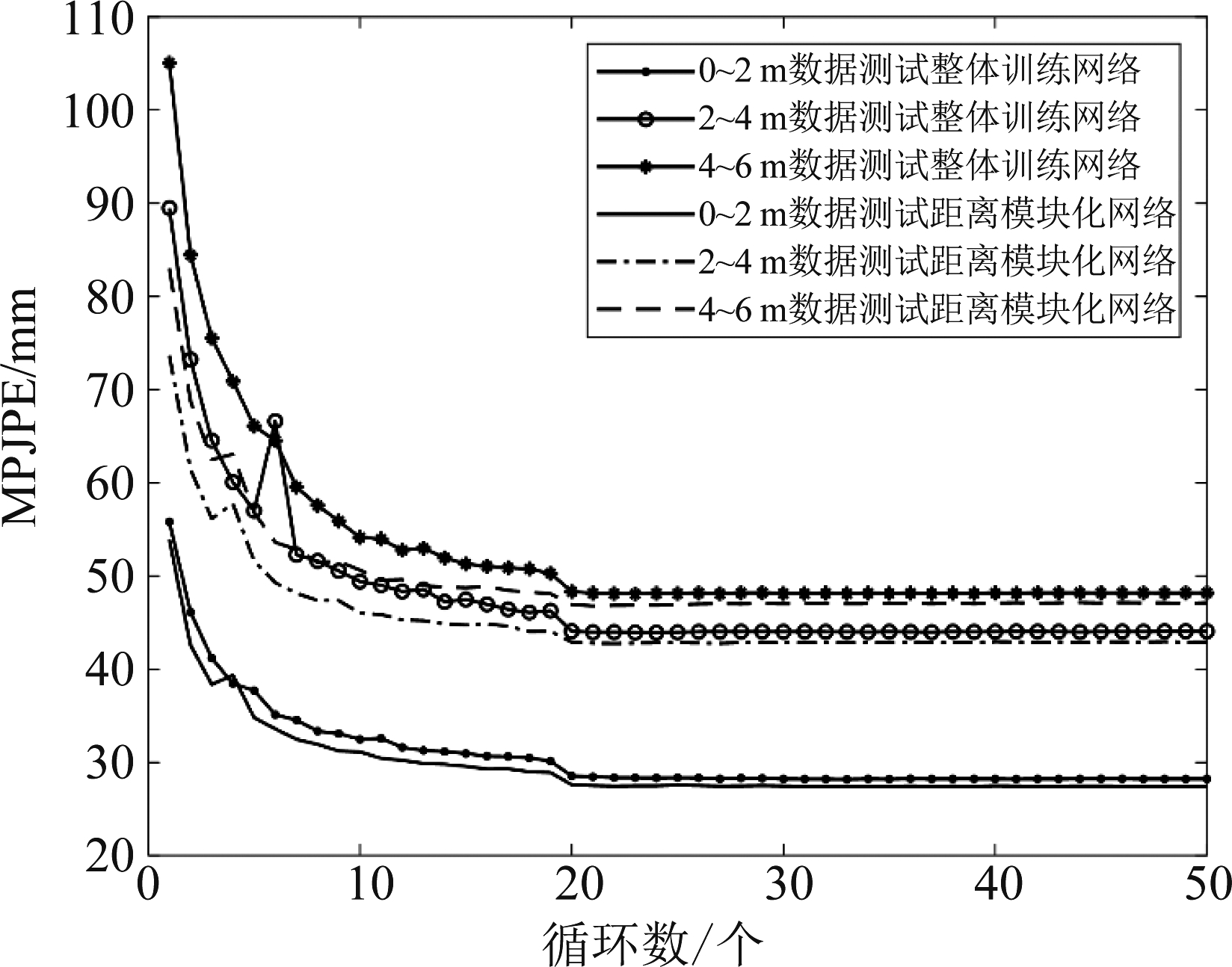

4.4 测试性能分析

为了分析本文设计超宽带MIMO雷达图像人体姿态重构网络的性能,以及距离辅助信息所带来的测试精度改善,本文设计了整体训练网络和距离模块化网络的对比试验,实验以网络预测的人体三维姿态的关节点位置与真值之间的MPJPE作为误差衡量指标,其中真值是从对应的光学图像中估计出的。实验包括整体训练网络和距离模块化网络的训练和测试,本文对网络进行了四组训练和六组测试,其中四组训练包括了三组距离模块化网络的训练分别是0~2 m数据训练、2~4 m数据训练、4~6 m数据训练,以及一组整体训练即0~6 m数据的训练;六组测试分别是,0~2 m、2~4 m、4~6 m三个距离段的测试数据分别测试整体训练网络和距离模块化网络,以此来模拟距离辅助选择网络的过程。多组测试结果的MPJPE曲线如下图7所示,其中每组训练都是50轮,分别对50轮训练保存的模型参数进行测试,由测试结果可知,随着训练的进行,姿态重构误差逐渐减小,并在训练第二十轮左右开始收敛。同时对比不同距离的姿态重构结果可知,随着目标距离的变远,姿态重构的误差呈逐渐上升的趋势。对比距离模块化网络的测试结果和整体训练网络的测试结果可知,距离模块化网络的姿态重构精度高于直接进行全距离段的训练的网络,其人体关节点坐标的拟合能力更强。总的来说,本文设计的网络在各个距离段都有较好的姿态重构性能。

图7 测试误差曲线

Fig.7 Test error curves

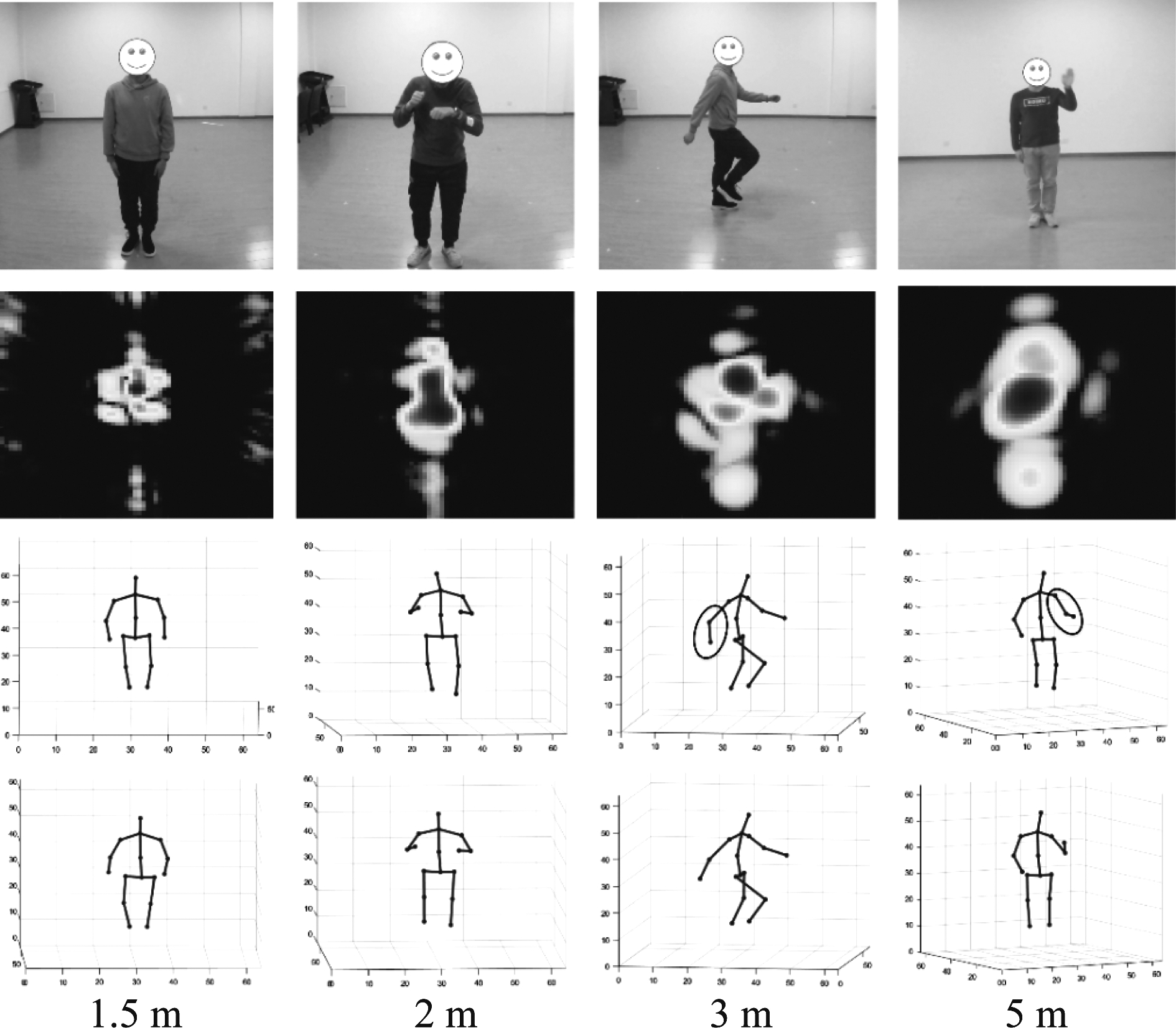

4.5 实测实验分析

本节进行实测实验来验证网络的实际使用性能,同时对比了有无距离信息辅助网络的姿态重构性能。实验对四个不同距离、不同姿态的人体目标进行探测,雷达成像和姿态重构的结果如下图8所示,其中第一行是测试目标姿态图,第二行是超宽带MIMO雷达三维成像结果的二维投影图,第三行是没有距离信息辅助的姿态重构结果,第四行是有距离辅助的姿态重构结果。由图8可知,雷达图像抽象难懂,很难直接从中判断目标的状态。通过超宽带雷达图像人体姿态重构网络处理之后得到第三行和第四行的三维人体姿态图,这些三维姿态图相比于雷达图像可以更直接地反映人体目标的姿态信息,增强了传统雷达图像的可读性。同时,对比算法处理结果和光学图像可知,本文算法可以相对准确的重构出人体目标的姿态,与目标真实姿态基本一致。为了验证不同距离目标的姿态重构性能,本文对不同距离的目标进行探测试验,其中图8的第一列的目标在1.5 m处,其他列依次是2 m、3 m、5 m处的目标探测结果。对比不同距离目标的姿态重构结果可知,对于距离较近的目标,有无距离辅助的姿态重构网络都有较好的姿态重构结果;而对于距离较远的目标,本文设计的基于距离辅助的姿态重构网络有更好的拟合能力,该网络对于自由度较高且散射面较小的手臂有更好的姿态重构性能。另外,图8中3 m目标相对于雷达侧身运动,雷达无法获取身体外侧回波,造成自身遮挡,由重构结果可知,本文方法依然可以实现对此类自身遮挡目标的探测和姿态重构。

图8 实际测试结果

Fig.8 Field experiment results

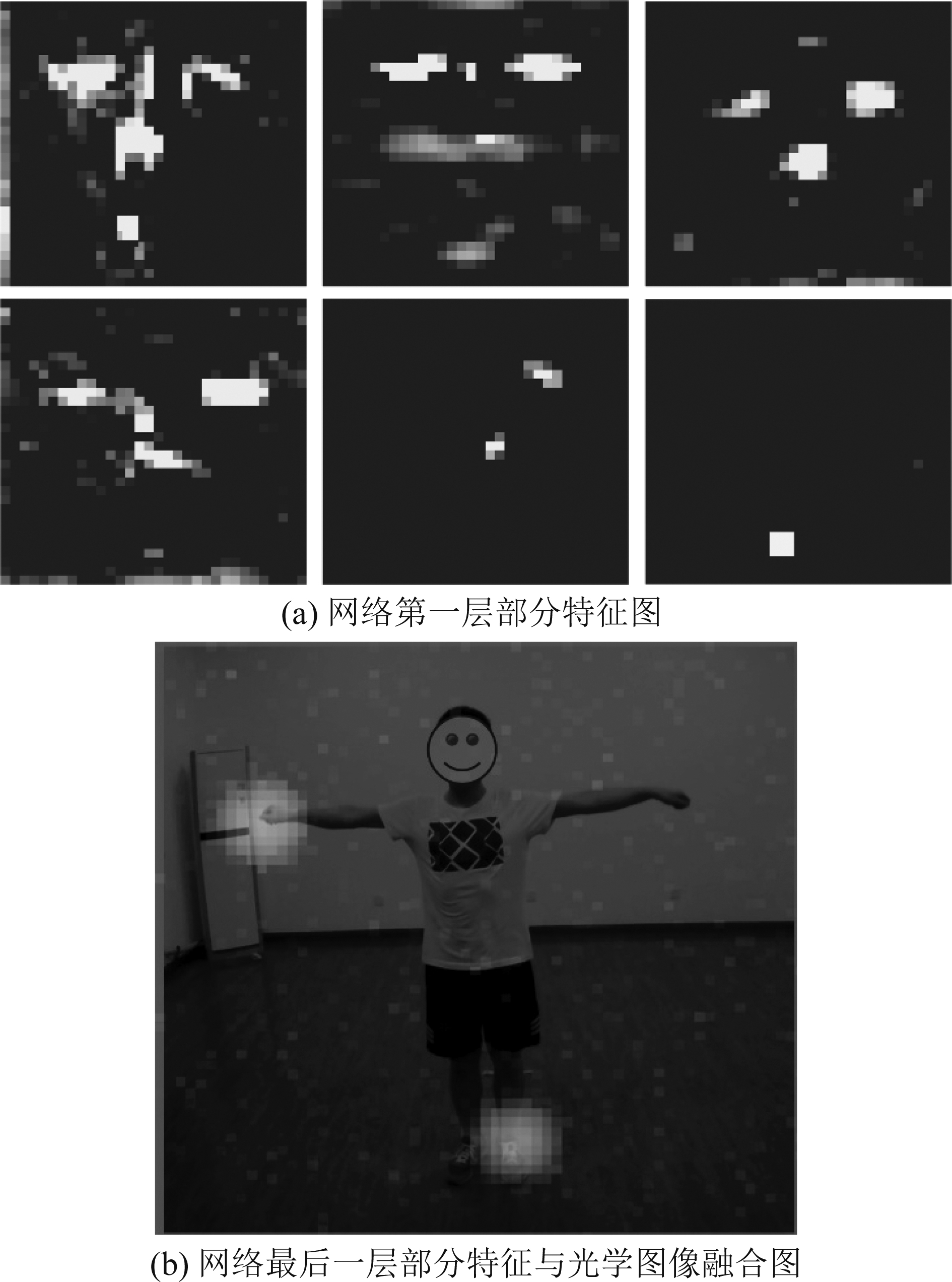

4.6 网络特征可视化

为了展示本文所设计的人体姿态重构网络的工作过程,我们对网络的部分特征进行可视化。将距离雷达3 m处张开双臂的人体目标的三维雷达数据输入训练好的网络,提取网络第一层的64个特征图中的部分特征并进行投影显示,如图9(a),由图可知,神经网络提取了人体雷达图像的轮廓和关节点位置信息。网络的最后一层的输出的特征是网络预测的人体目标的各个关节点在空间中的位置概率,我们对右手和左脚的特征进行投影并可视化,如图9(b)所示与光学图像融合的结果。由图9(b)可知,本文所设计的网络可以相对准确的重构出人体目标各个关节点在空间中的位置。

图9 特征可视化结果

Fig.9 Feature visualization results

4.7 讨论

本文通过测试集验证和实测验证两部分来评估所提算法的性能,在4.4节使用测试数据集对训练好的网络进行测试,测试误差曲线表明本文设计的基于距离辅助的超宽带雷达人体姿态重构网络具有较好的姿态重构性能。4.5节进行了一些实测实验,实验包括不同距离段的人体目标,实验结果表明本文所提算法可以显著提高传统人体雷达图像的可读性。同时,在4.6节对网络特征进行可视化,进一步证明了本文所提网络的有效性。

需要说明的是,在姿态重构网络的基础上,本文根据目标的距离进行分段训练和分段测试,该方法在数据较难获取的雷达图像领域具有一定的改善效果;当训练数据量足够大时,姿态重构网络可以对各个距离段的人体成像结果都有较好的拟合能力,基于分距离段处理的方法对网络重构精度的改善会削弱。另外,考虑到雷达系统的尺寸和成本,本文所采用的MIMO雷达系统分辨率有限,所以只对6 m以内的人体目标进行探测和姿态重构,重点是对所设计的网络和方法进行验证。同时,实验中的距离分段也并不是唯一的,可根据不同的实际系统进行划分。当然,本文所提出的是一个通用网络,不仅适用于本文所采用的系统,也可以应用于其他频段的雷达系统。

5 结论

本文提出了一种基于距离辅助的超宽带MIMO雷达图像人体姿态重构网络,该网络可以提取三维雷达图像中人体目标的各个关节点的位置特征,再通过卷积神经网络重构出对应的人体目标的三维姿态。结合雷达成像结果随距离变化的特性,将距离作为辅助信息,构造距离模块化的网络模型,在实际应用的过程中,根据距离信息选择合适的网络进行姿态重构。实验结果表明,本文所提出的算法可以从低分辨的雷达图像中提取人体三维姿态,同时基于距离辅助的网络设计进一步增强了姿态重构的精度,使雷达图像更易于理解,辅助使用者对探测人体目标的姿态信息进行更加详细的判读,也在一定程度上推进了超宽带MIMO雷达的实用化进程。

[1] YAROVOY A G, LIGTHART L P, MATUZAS J, et al.UWB radar for human being detection[J].IEEE Aerospace and Electronic Systems Magazine, 2006, 21(3): 10-14.

[2] MA Yangyang, LIANG Fulai, WANG Pengfei, et al.An accurate method to distinguish between stationary human and dog targets under through-wall condition using UWB radar[J].Remote Sensing, 2019, 11(21): 2571.

[3] QI Fugui, LV Hao, LIANG Fulai, et al.MHHT-based method for analysis of micro-Doppler signatures for human finer-grained activity using through-wall SFCW radar[J].Remote Sensing, 2017, 9(3): 260.

[4] 李俊侠, 张秦, 郑桂妹.超宽带雷达人体姿态识别综述[J].计算机工程与应用, 2021, 57(3): 14-23.

LI Junxia, ZHANG Qin, ZHENG Guimei.Overview of human posture recognition by ultra-wideband radar[J].Computer Engineering and Applications, 2021, 57(3): 14-23.(in Chinese)

[5] LV Hao, QI Fugui, ZHANG Yang, et al.Improved detection of human respiration using data fusion basedon a multistatic UWB radar[J].Remote Sensing, 2016, 8(9): 773.

[6] AHMAD F, ZHANG Yimin, AMIN M G.Three-dimensional wideband beamforming for imaging through a single wall[J].IEEE Geoscience and Remote Sensing Letters, 2008, 5(2): 176-179.

[7] KONG Lingjiang, CUI Guolong, YANG Xiaobo, et al.Three-dimensional human imaging for through-the-wall radar[C]∥2009 IEEE Radar Conference.Pasadena, CA, USA.IEEE, 2009: 1-4.

[8] ADIB F, HSU C Y, MAO Hongzi, et al.Capturing the human figure through a wall[J].ACM Transactions on Graphics, 2015, 34(6): 1-13.

[9] DAI Yongpeng, JIN Tian, LI Haoran, et al.Imaging enhancement via CNN in MIMO virtual array-based radar[J].IEEE Transactions on Geoscience and Remote Sensing, 2020, PP(99): 1-10.

[10] DAI Yongpeng, JIN Tian, SONG Yongkun, et al.Convolutional neural network with spatial-variant convolution kernel[J].Remote Sensing, 2020, 12(17): 2811.

[11] TOME D, RUSSELL C, AGAPITO L.Lifting from the deep: Convolutional 3D pose estimation from a single image[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition(CVPR).Honolulu, HI, USA.IEEE, 2017: 5689-5698.

[12] 刘强, 张文英, 陈恩庆.基于异构多流网络的多模态人体动作识别[J].信号处理, 2020, 36(9): 1422-1428.

LIU Qiang, ZHANG Wenying, CHEN Enqing.Multimodal human action recognition based on heterogeneous multi-stream network[J].Journal of Signal Processing, 2020, 36(9): 1422-1428.(in Chinese)

[13] GUO Yangyang, HE Dongjian, CHAI Lilong.A machine vision-based method for monitoring scene-interactive behaviors of dairy calf[J].Animals, 2020, 10(2):190.

[14] HU Zhipeng, ZENG Zhaofa, WANG Kun, et al.Design and analysis of a UWB MIMO radar system with miniaturized vivaldi antenna for through-wall imaging[J].Remote Sensing, 2019, 11(16): 1867.

[15] 靳科, 赖涛, 李公全, 等.近距离超宽带调频连续波雷达非线性校正研究[J].信号处理, 2017, 33(2): 158-167.

JIN Ke, LAI Tao, LI Gongquan, et al.Nonlinearity correction of short range wideband FMCW radar[J].Journal of Signal Processing, 2017, 33(2): 158-167.(in Chinese)

[16] SETLUR P, ALLI G, NUZZO L.Multipath exploitation in through-wall radar imaging via point spread functions[J].IEEE Transactions on Image Processing, 2013, 22(12):4571-4586.