1 引言

利用无人机(unmanned aerial vehicles,UAV)可控的机动性,可以解决物联网(Internet of Things,IoTs)覆盖范围受限的问题,IoTs与UAV的组合可实现更多样化的物联网应用[1-2]。在一些地理环境复杂的地方,如灾区,高速公路和闹市等,物联网设备中的地面传感器节点(ground sensor nodes,GSN)到基站(base station,BS)的直达链路受损,UAV可以作为中继,辅助地面网络顺利通信[3]。然而,无线电传播的广播性质使得UAV通信易遭受敌意干扰攻击[4],一旦无线链路被干扰,影响正常通信。

现有的UAV抗敌意干扰方案通常采用单一的飞行轨迹或者跳频等策略,可抵御固定干扰功率的攻击[5],却对干扰信号强度可变的智能干扰机束手无策。其次,现有方案假设UAV对外界环境变化信息已知,由于无线信道的时变性,UAV的高移动性,以及随时可变的干扰强度,UAV无法精确获知当前信道增益或干扰信号强度等信息。相应的,UAV也无法及时调整自己的轨迹或者发射功率来抵抗智能干扰[6]。强化学习是机器学习的重要分支,被应用在隐私保护,抗敌意干扰与防电子欺骗等无线网络通信安全中[7]。在不完全信息的情况下,可引入强化学习技术自适应学习最优防御策略,Peng J等人[8]通过多参数规划和强化学习的方法,提高无人机群在干扰存在下的通信性能;Wang W等人[9]基于实时信道条件和历史中继经验,提出了一种基于强化学习的无人机中继方案来提高无人机网络的抗干扰能力;Xiao L等人[10]在未知信道模型的水下通信场景中,提出了基于强化学习的抗干扰中继方案。博弈论在攻防事件研究中表现亮眼,被广泛地应用在无人机抗敌意干扰中,Mbazubgwa E等人[11]研究了博弈论在解决各种无人机辅助网络挑战中的应用,并对相关博弈进行了分类和简要介绍,最后提出了用于大型无人机辅助通信网络干扰管理的先进分布式方案,Xiao L等人[12]研究了大型协同认知无线电网络中次级用户抗干扰功率控制问题,利用强化学习算法实现最优功率分配。

本文研究了智能干扰机存在的情况下,无人机辅助物联网系统的抗干扰问题,将GSN和UAV当作两个智能体,同时优化各自的传输功率,且为UAV加入了最优轨迹选择策略,利用多智能体强化学习算法,提高整个物联网系统的抗干扰性能。第2节介绍系统模型。第3节构建抗干扰Stackelberg博弈模型,推导博弈均衡点与存在条件,从理论层面揭示了UAV与BS的距离等参数对系统性能的影响。第4节引入分别基于Q_learning和WoLF-PHC(win or learn fast-policy hill climbing)的抗敌意干扰算法,具体介绍其学习过程,并且进行参数仿真,验证了所提算法的性能。第5节总结全文。

2 系统模型

如图1所示,系统模型中包含了UAV、GSN和智能干扰机(Jammer)。在时隙k内,UAV在初始位置![]() 收到GSN发送的信息,然后以速度

收到GSN发送的信息,然后以速度![]() 直线飞行到目标位置L(k),将信息转发给位于LB的BS,Jammer对BS实施干扰。定义Ai为功率集,i∈{s,u, j},其中s表示GSN,u表示UAV,j表示Jammer,D为UAV飞行距离动作集,|Ai|表示功率集中元素的个数,|D|表示动作集中元素的个数。GSN首先以发射功率

直线飞行到目标位置L(k),将信息转发给位于LB的BS,Jammer对BS实施干扰。定义Ai为功率集,i∈{s,u, j},其中s表示GSN,u表示UAV,j表示Jammer,D为UAV飞行距离动作集,|Ai|表示功率集中元素的个数,|D|表示动作集中元素的个数。GSN首先以发射功率![]() 将信息传给UAV,UAV通过信号功率与飞行轨迹控制策略提高转发质量,具体而言,UAV设置当前信号发射功率

将信息传给UAV,UAV通过信号功率与飞行轨迹控制策略提高转发质量,具体而言,UAV设置当前信号发射功率![]() 之后控制目标飞行距离

之后控制目标飞行距离![]() 飞到

飞到![]() 和LB之间的最优位置转发信息,其中Du是UAV的最大可达飞行距离,Jammer在地面固定的位置,以功率

和LB之间的最优位置转发信息,其中Du是UAV的最大可达飞行距离,Jammer在地面固定的位置,以功率![]() 向BS持续发送干扰信号,降低UAV与BS之间的通信质量。

向BS持续发送干扰信号,降低UAV与BS之间的通信质量。

图1 无人机辅助物联网抗干扰系统模型

Fig.1 The anti-jamming system model for UAV-aided IoTs

将GSN的策略选择记为![]() 的策略选择为

的策略选择为![]() 的策略选择为

的策略选择为![]() 根据自由空间路径损耗模型[13],信道增益计算公式为:

根据自由空间路径损耗模型[13],信道增益计算公式为:

(1)

![]() 分别表示GSN和UAV,UAV和BS,Jammer和BS的欧氏距离,Dr表示系统的参考距离,hr表示UAV或者Jammer与BS的距离为参考距离Dr时的参考信道增益,ηi是路径损耗因子,对于GSN-UAV和UAV-BS信道,ηs=ηu=2,Jammer-BS信道ηj=4[14-15]。UAV初始位置

分别表示GSN和UAV,UAV和BS,Jammer和BS的欧氏距离,Dr表示系统的参考距离,hr表示UAV或者Jammer与BS的距离为参考距离Dr时的参考信道增益,ηi是路径损耗因子,对于GSN-UAV和UAV-BS信道,ηs=ηu=2,Jammer-BS信道ηj=4[14-15]。UAV初始位置![]() 与BS位置LB之间的欧式距离记作DB,取Du=DB-Dr。

与BS位置LB之间的欧式距离记作DB,取Du=DB-Dr。

3 抗敌意干扰Stackelberg博弈

假定Jammer在确定干扰策略之前能够快速的学习GSN和UAV的传输策略,GSN和UAV要权衡传输损耗和策略收益,Jammer也要权衡干扰损耗和收益,GSN和UAV相互协作,它们和Jammer是竞争关系,三者之间的先后交互可以建模为Stackelberg博弈模型,目的是最小化Jammer造成的最大干扰。Stackelberg博弈又被称为主从博弈,包含了两种类型的参与者:领导者(leader)和追随者(follower)。论文将GSN定为leader,UAV为副leader,Jammer为follower,3个参与者的目的均为最大化自己的效用函数。

3.1 抗敌意干扰博弈模型

博弈论中参与者的效用函数可用来评估收益,反应了参与者对选择某一策略后的满意程度[16]。BS接收信号的信干噪比(Signal to Interference plus Noise Ratio, SINR)可表示为:

(2)

考虑SINR和参与者的能量损耗,抗敌意干扰博弈中GSN和UAV在k时隙下的效用函数分别为:

(3)

(4)

Jammer的目的是以较低的攻击成本,降低SINR并加快UAV的能量损耗,效用函数为:

(5)

其中,Cs和Cu分别表示GSN和UAV的单位信号功率损耗系数,Cr表示UAV的单位飞行距离损耗系数,Cj表示Jammer的单位干扰信号功率损耗系数,σ为噪声功率。

假设参与者均为理性的,皆可获知环境中的所有信息,以此为前提确定自己的策略,最大化自身效用,达到均衡状态。下面在不引起混淆的情况下省略时隙上标(k)。定义抗敌意干扰Stackelberg博弈均衡(Stackelberg equilibrium, SE)点为![]() 表示如下:

表示如下:

(6)

(7)

(8)

(9)

3.2 抗敌意干扰博弈的Stackelberg均衡

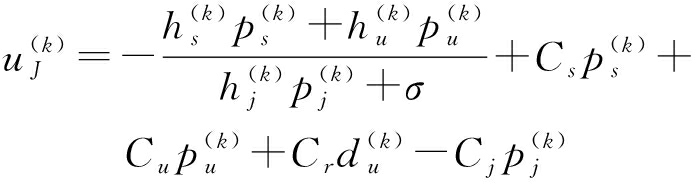

在博弈过程中,GSN首先根据功率对其他参与者的影响,选择最优的发射功率,令式(3)的效用最大化,考虑GSN的策略以及UAV发射功率和移动距离对Jammer的影响,UAV选择最优的发射功率和移动距离,使公式(4)效用最大,最后,对上述行为充分掌握的Jammer选择最优的干扰功率,使公式(5)获得最大值,最后达到均衡状态。可根据式(10)推导出定理1。

(10)

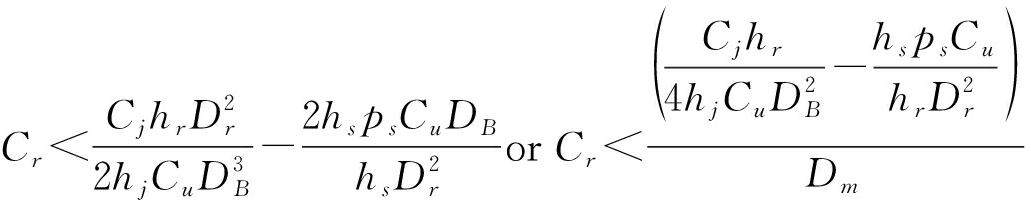

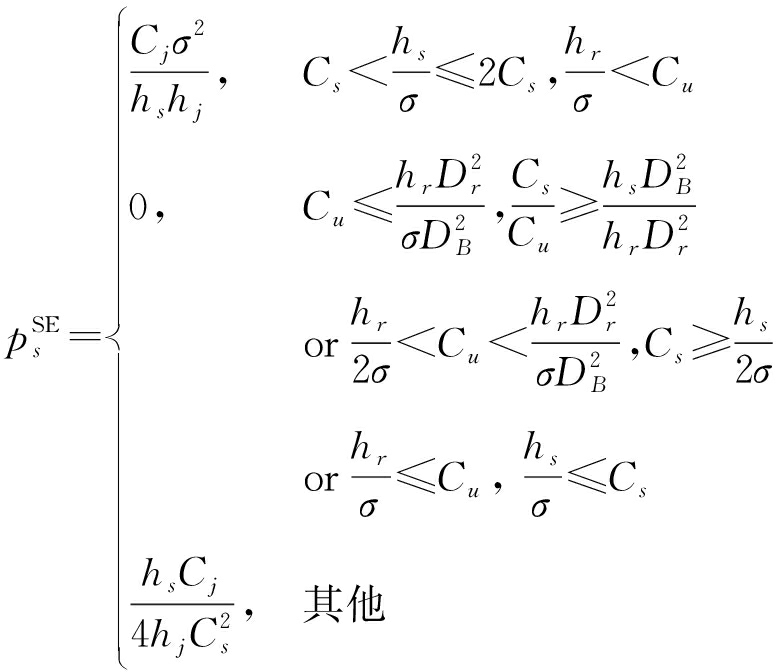

定理1 Jammer的最优干扰功率为:

(11)

证明 公式(5)的一、二阶导数分别为:

(12)

(13)

由式(12)和(13)可知,uJ是pj的凸函数。式(12)为0时,得到![]() 若

若![]() 则uJ在pj=0处取得最大值,因此,当满足hsps+hupu<(Cjσ2/hj)时,

则uJ在pj=0处取得最大值,因此,当满足hsps+hupu<(Cjσ2/hj)时,![]() 若hsps+hupu≥(Cjσ2/hj),uJ在

若hsps+hupu≥(Cjσ2/hj),uJ在![]() 递减,则

递减,则![]() 则式(11)为最优干扰策略。

则式(11)为最优干扰策略。

由定理1知,若干扰增益难以弥补其损耗,Jammer将选择沉默,即![]() 如果当前的发射功率超出某一阈值,如hsps+hupu≥(Cjσ2/hj),则最优的干扰功率随发射功率调整。

如果当前的发射功率超出某一阈值,如hsps+hupu≥(Cjσ2/hj),则最优的干扰功率随发射功率调整。

根据式(14)推导出定理2。

(14)

定理2 UAV的最优发射功率为:

(15)

其中,

![]()

![]()

其他:![]()

定理2推导证明和定理1的过程一样,不再赘述。由式(15)可知,UAV的最优功率策略取决于ps和它本身的传输损耗。当得知ps足够大时,或者当ps低的同时Cu足够大时,pu的最优值为0,UAV保持沉默;除此之外,UAV根据ps的值来调整自己的最优功率值,比如ps在一定范围时,或者ps低的同时Cu也低,![]()

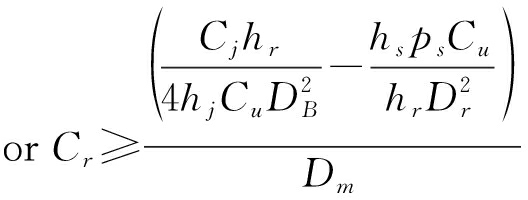

根据式(16)推导出定理3。

(16)

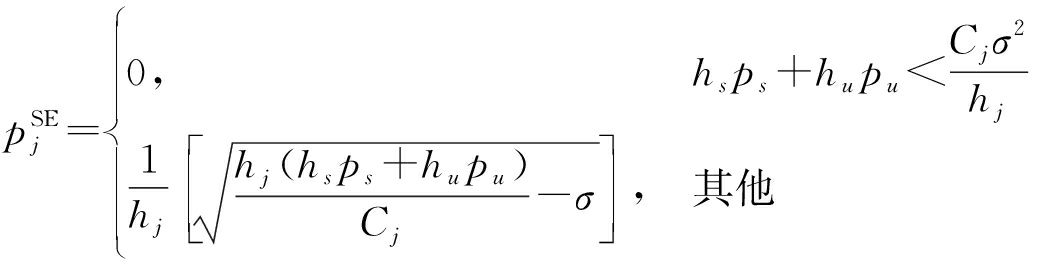

定理3 UAV的最优移动距离为:

(17)

其中,

![]()

![]()

![]()

其他:![]()

可根据式(18)推导出定理4。

(18)

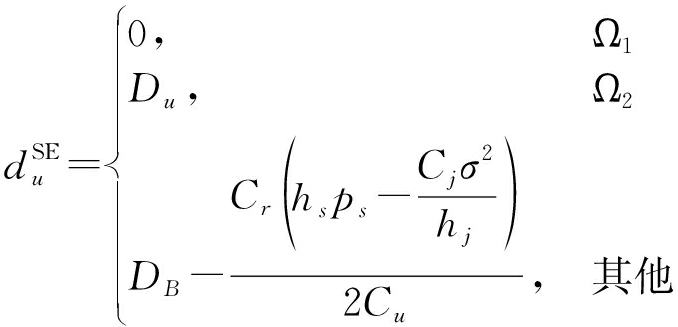

定理4 GSN的最优发射功率为:

(19)

定理1、2、3和4共同构成了抗敌意干扰博弈的SE策略。

3.3 抗敌意干扰博弈性能分析

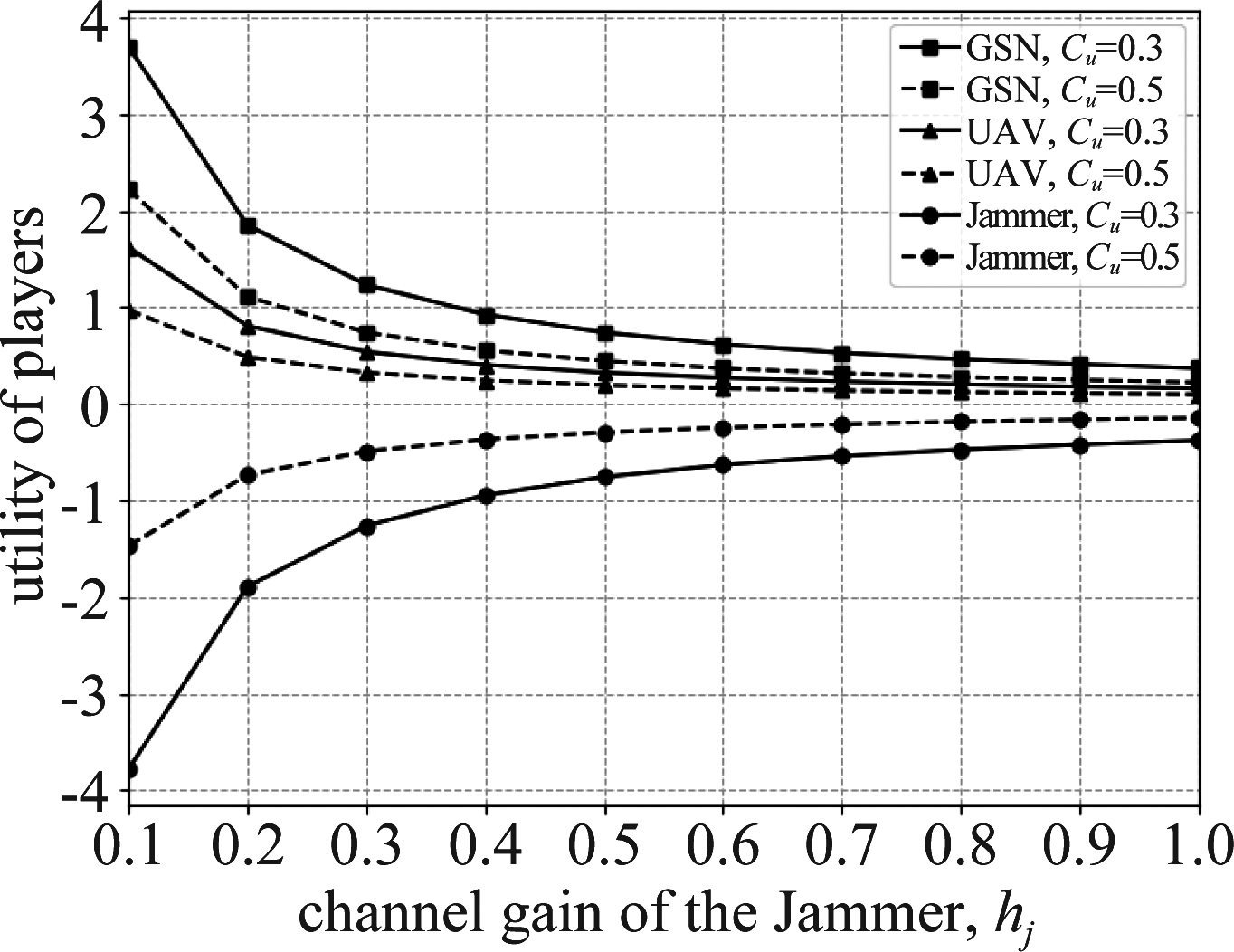

图2 SE策略下,GSN、UAV和Jammer的效益

Fig.2 The utility of GSN, UAV, Jammer under the SE strategy

利用仿真分析抗敌意干扰博弈的性能,其中仿真参数设置为:Cs=Cr=Cj=0.5,hs=0.3,hu=0.5,σ=0.4,图2表示干扰增益hj变大和UAV损耗系数改变对参与者效用的影响。hj增大代表干扰信道条件变好,所以GSN和UAV效用降低,Jammer效用提高。当hj=0.1,Cu从0.5变为0.3时,对应UAV的效用从1增加到1.6,上涨了60%,UAV的损耗成本越低,收益就越高。

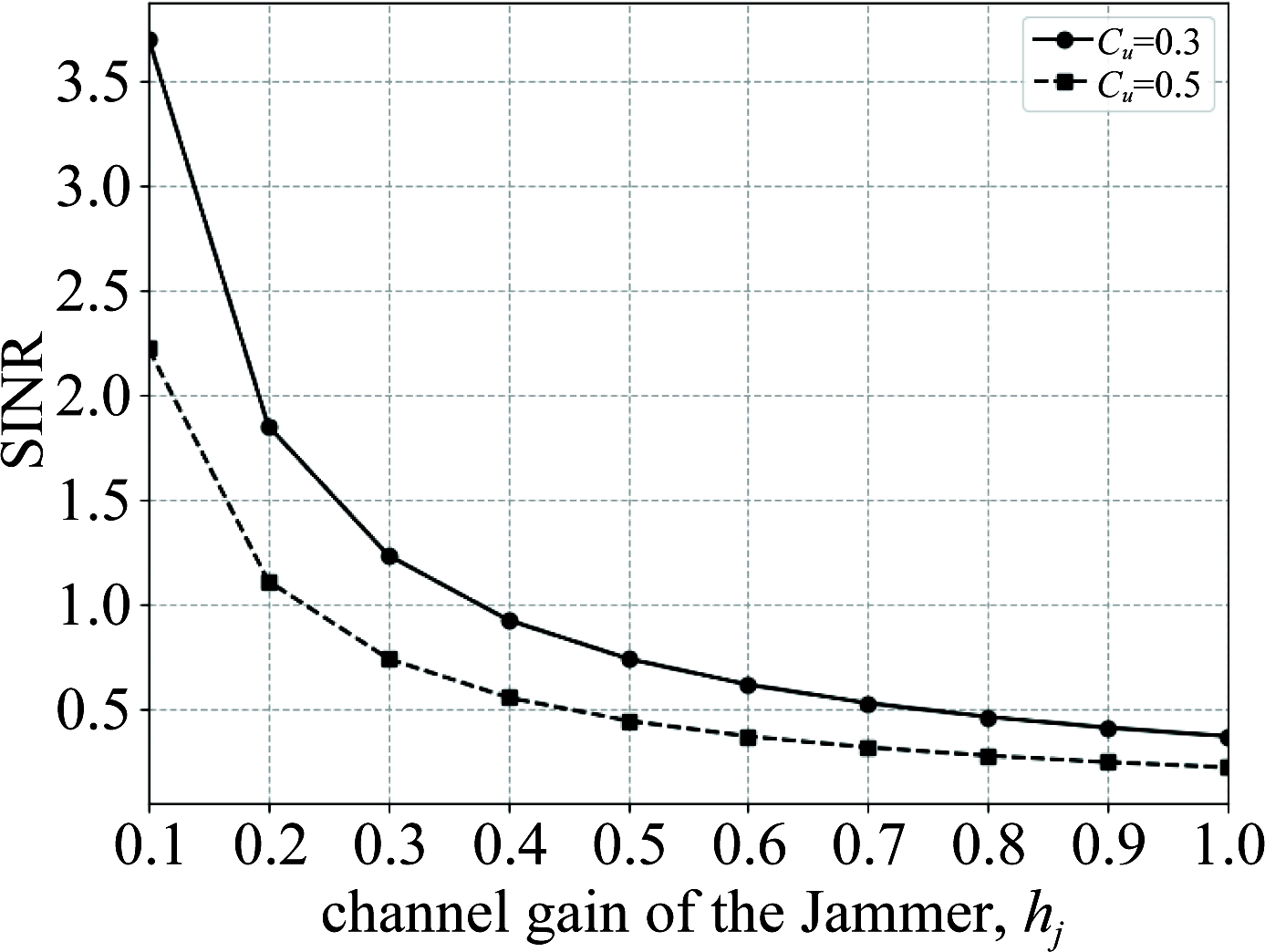

图3表明了BS接收信号的SINR随干扰增益hj增大而降低。比如,在UAV损耗成本Cu=0.5的情况下,hj从0.1增大到1时,SINR从3.7降低至0.4,下降了约89%。因为随着hj的增大,干扰功率逐渐接近最佳干扰策略,严重干扰UAV和BS之间的传输。此外,UAV的损耗成本越低,BS接收信号的SINR越高。在hj=0.3,Cu=0.3时,其SINR值是hj=0.3,Cu=0.5时的166.2%。

图3 SE策略下的SINR

Fig.3 The SINR under the SE strategy

4 基于强化学习的抗干扰攻击策略

SE策略推导的前提是所有信息已知,但是一个节点的传输信息(比如信道增益和损耗系数)通常是未知的,强化学习算法可以在动态环境中帮助智能体以最大化其累计回报为目的采取决策。论文提出了基于强化学习(Q_learning和WoLF-PHC)的抗敌意干扰算法,将GSN和UAV视为两个智能体,在传输信息和干扰模型未知的情况下,应用强化学习算法优化GSN的发射功率、UAV的发射功率和移动距离。具体的算法流程为:GSN根据(k-1)时隙的状态![]() 通过强化学习算法确定

通过强化学习算法确定![]() 同样的,UAV观察到

同样的,UAV观察到![]() 后,根据状态

后,根据状态![]() 和

和![]() 确定

确定![]() 和

和![]() 最后,基于

最后,基于![]() 通过公式(10)确定

通过公式(10)确定![]() 个参与者根据公式(3),(4)和(5)获得相应的即时效用。

个参与者根据公式(3),(4)和(5)获得相应的即时效用。

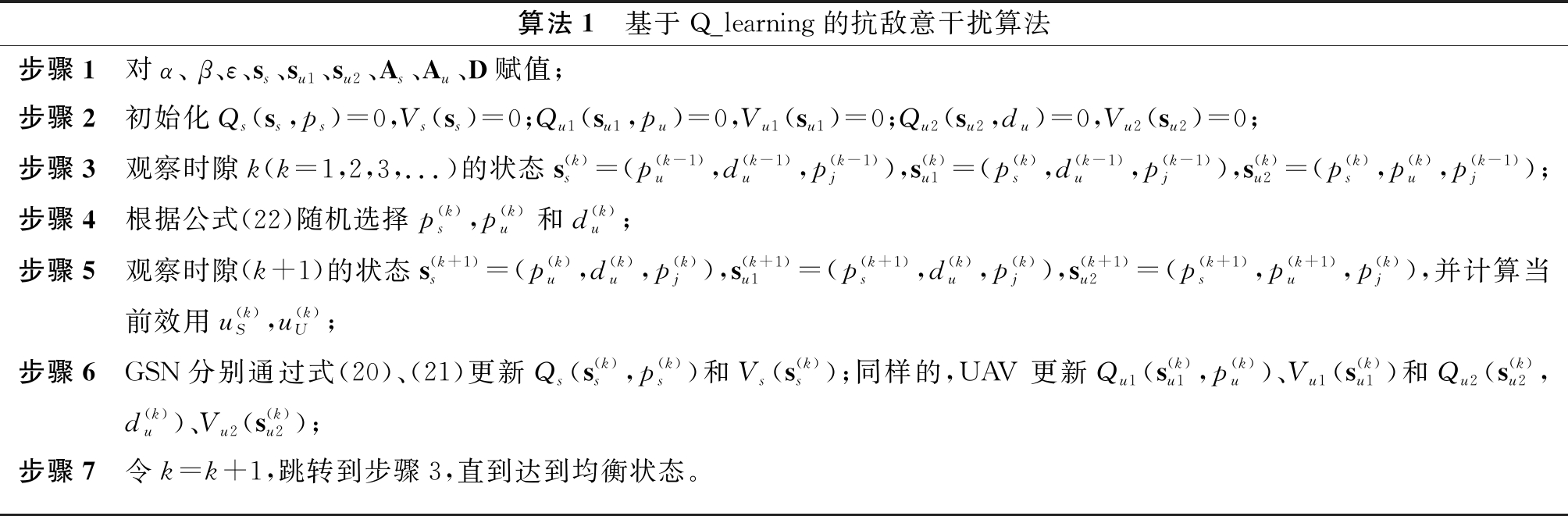

4.1 基于Q_learning的抗敌意干扰算法

GSN在状态![]() 下选择

下选择![]() 的估计Q值表示为

的估计Q值表示为![]() 其更新公式为:

其更新公式为:

(20)

(21)

其中,学习速率α∈(0,1],折扣因子![]() 为GSN在状态

为GSN在状态![]() 下的最大Q值。GSN通过ε-贪婪策略选择发射功率,以(1-ε)的概率选择最大Q值对应的发射功率

下的最大Q值。GSN通过ε-贪婪策略选择发射功率,以(1-ε)的概率选择最大Q值对应的发射功率![]() 的概率随机选择其他概率,可用公式表示为:

的概率随机选择其他概率,可用公式表示为:

(22)

其中,

(23)

接下来,参照上述式(20)~(23)的学习更新过程,将UAV分别在状态![]() 和

和![]() 下选择

下选择![]() 和

和![]() 的估计Q值记为

的估计Q值记为![]() 和

和![]() 其中

其中![]() 和

和![]() 分别为UAV在状态

分别为UAV在状态![]() 和

和![]() 下的最大Q值;UAV同样利用ε-贪婪策略选择发射功率和移动距离。

下的最大Q值;UAV同样利用ε-贪婪策略选择发射功率和移动距离。

表1 基于Q_learning的抗敌意干扰算法

Tab.1 Anti-jamming algorithm based on Q_learning

算法1 基于Q_learning的抗敌意干扰算法步骤1 对α、 β、ε、ss、su1、su2、As、Au、D赋值;步骤2 初始化Qs(ss,ps)=0,Vs(ss)=0;Qu1(su1,pu)=0,Vu1(su1)=0;Qu2(su2,du)=0,Vu2(su2)=0;步骤3 观察时隙k(k=1,2,3,...)的状态s(k)s=(p(k-1)u,d(k-1)u,p(k-1)j),s(k)u1=(p(k)s,d(k-1)u,p(k-1)j),s(k)u2=(p(k)s,p(k)u,p(k-1)j);步骤4 根据公式(22)随机选择p(k)s,p(k)u和d(k)u;步骤5 观察时隙(k+1)的状态s(k+1)s=(p(k)u,d(k)u,p(k)j),s(k+1)u1=(p(k+1)s,d(k)u,p(k)j),s(k+1)u2=(p(k+1)s,p(k+1)u,p(k)j),并计算当前效用u(k)S,u(k)U;步骤6 GSN分别通过式(20)、(21)更新Qs(s(k)s,p(k)s)和Vs(s(k)s);同样的,UAV更新Qu1(s(k)u1,p(k)u)、Vu1(s(k)u1)和Qu2(s(k)u2,d(k)u)、Vu2(s(k)u2);步骤7 令k=k+1,跳转到步骤3,直到达到均衡状态。

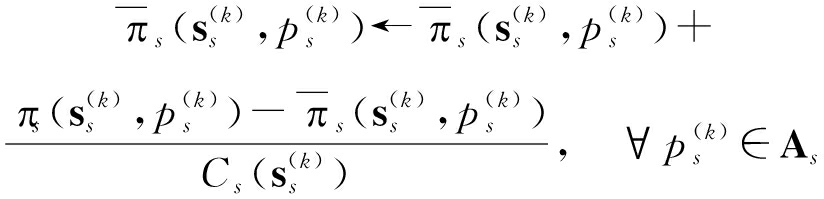

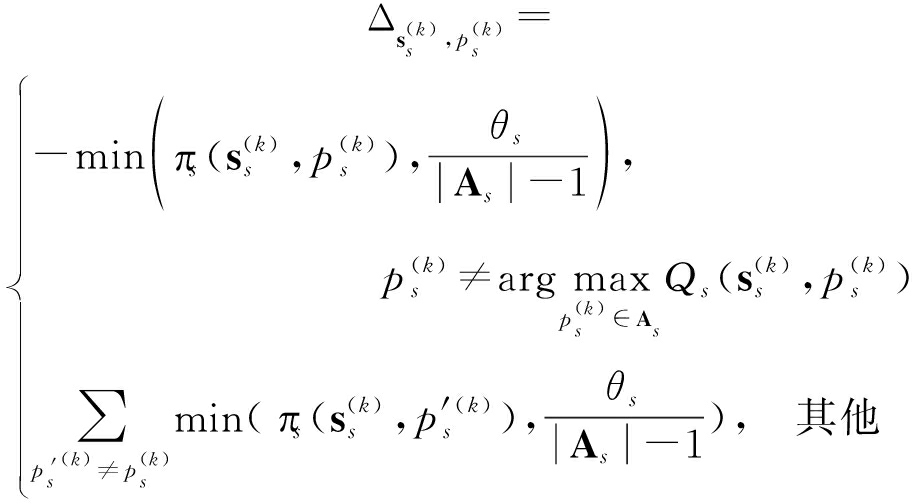

4.2 基于WoLF-PHC的抗敌意干扰算法

WoLF-PHC是一种多智能体算法,将“要么赢要么学的快”原则和爬山算法相结合。 WoLF-PHC算法的Q函数更新规则和Q_learning算法一致(公式(20)和(21)),除此之外,算法定义了策略πs,其中![]() 为GSN在状态

为GSN在状态![]() 下选择

下选择![]() 的概率,为了更新πs,引入平均策略

的概率,为了更新πs,引入平均策略![]() 和两个学习参数:

和两个学习参数:![]() 通过比较πs与

通过比较πs与![]() 的期望值大小来选择学习参数,即:

的期望值大小来选择学习参数,即:

(24)

其中,![]()

(25)

(26)

(27)

其中,

(28)

Cs是状态![]() 的发生计数向量,通过式(25)进行更新,

的发生计数向量,通过式(25)进行更新,![]() 由式(26)更新,式(27)和(28)是πs的更新方式。接下来,参照上述式(24)~(28)的学习更新过程,定义策略πu1和πu2,其中

由式(26)更新,式(27)和(28)是πs的更新方式。接下来,参照上述式(24)~(28)的学习更新过程,定义策略πu1和πu2,其中![]() 和

和![]() 分别为UAV在状态

分别为UAV在状态![]() 和

和![]() 下选择

下选择![]() 和

和![]() 的概率;为了更新策略πu1和πu2,分别引入平均策略

的概率;为了更新策略πu1和πu2,分别引入平均策略![]() 和

和![]() 学习参数

学习参数![]() 和

和![]() 以及状态

以及状态![]() 和

和![]() 的发生计数向量Cu1和Cu2。

的发生计数向量Cu1和Cu2。

表2 基于WoLF-PHC的抗敌意干扰算法

Tab.2 Anti-jamming algorithm based on WoLF-PHC

4.3 仿真结果及分析

为验证论文所提算法的性能,设置仿真参数为:![]()

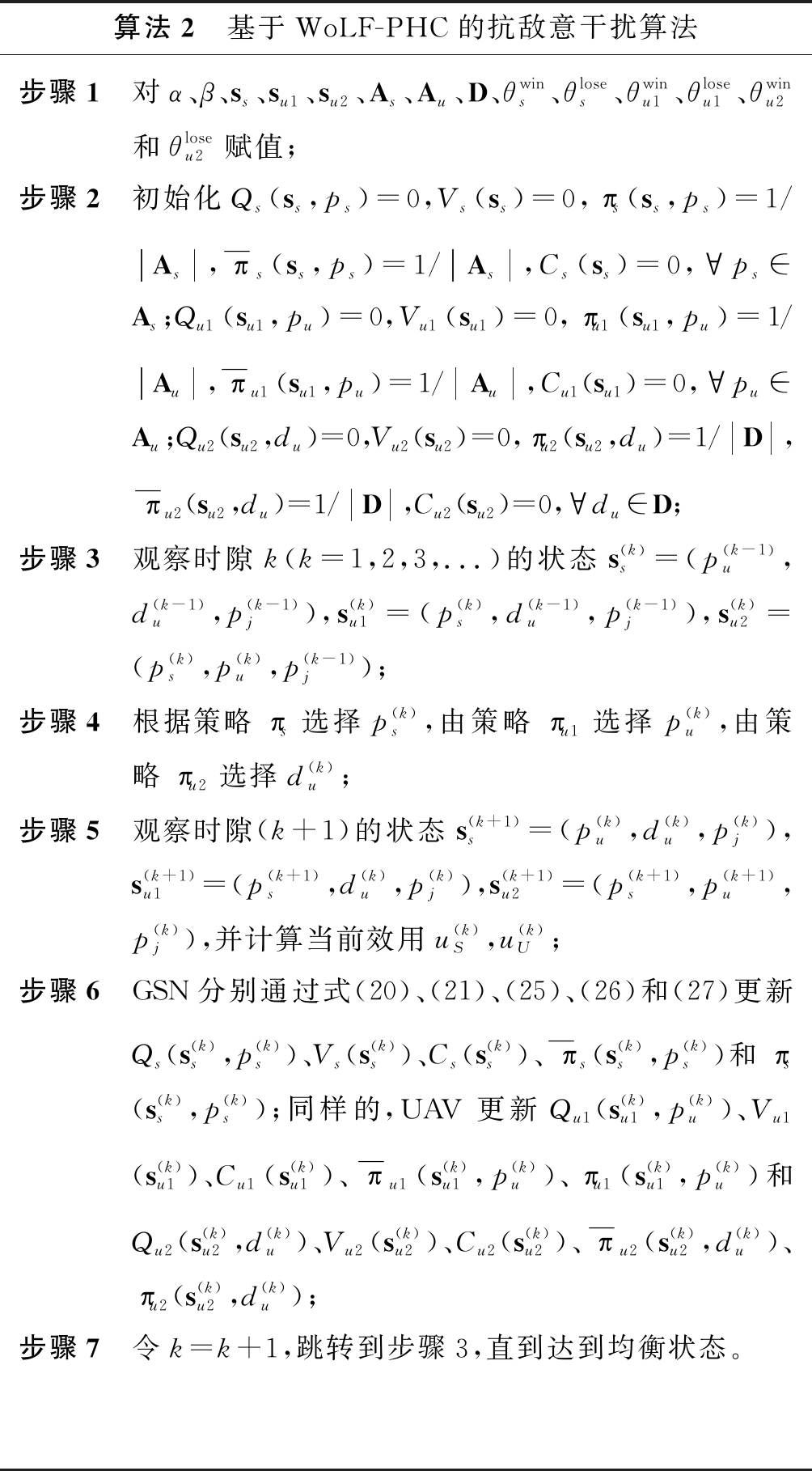

图4验证了所提的两种算法能够有效提高系统的抗干扰性能,分析指标为GSN和UAV的效用,以及BS接收信号的SINR。如图4(a)所示,对比Q_learning算法,改进的WoLF-PHC算法的GSN效用随时间明显升高,如经过4000个学习时间周期后,基于WoLF-PHC的抗敌意干扰算法的GSN效用为2,比利用Q_learning的算法效用提高了66.7%,同样的时间周期,UAV效用提高了84.8%,接收信号的SINR提高了38.2%。

图4 基于WoLF-PHC的抗敌意干扰算法性能

Fig.4 The performance of the anti-jamming algorithm based on WoLF-PHC

5 结论

本文研究了无人机辅助物联网中存在敌意干扰攻击的安全问题。将GSN,UAV和Jammer之间的行为建模为抗敌意干扰Stackelberg博弈,推导出了博弈的均衡点及其存在条件,在传输信息和干扰模型未知的动态环境中,引入强化学习算法提高系统抗干扰性能,且提出的基于WoLF-PHC的抗敌意干扰算法,相较于基于Q_learning的抗敌意干扰算法,通信质量得到了明显提高。

[1] 刘鑫胜. 无人机网络的性能分析与优化研究[D]. 北京: 北京邮电大学, 2019.

LIU Xinsheng. Research on performance analysis and optimization of UAV network[D]. Beijing: Beijing University of Posts and Telecommunications, 2019.(in Chinese)

[2] 宋庆恒, 郑福春. 基于无人机的物联网无线通信的潜力与方法[J]. 物联网学报, 2019(1): 82- 89.

SONG Qingheng, ZHENG Fuchun. Potential and methods of wireless communications for Internet of things based on UAV[J]. Chinese Journal on Internet of Things, 2019(1): 82- 89.(in Chinese)

[3] TONG Peng, LIU Juan, WANG Xijun, et al. Deep reinforcement learning for efficient data collection in UAV-aided Internet of Things[C]∥ICC 2020-2020 IEEE International Conference on Communication Workshops (ICC Workshops). IEEE, 2020: 1- 6.

[4] WU Qingqing, MEI Weidong, ZHANG Rui. Safeguarding wireless network with UAVs: a physical layer security perspective[J]. IEEE Wireless Communications, 2019, 26(5): 12-18.

[5] XIAO Liang, XIE Caixia, MIN Minghui, et al. User-centric view of unmanned aerial vehicle transmission against smart attacks[J]. IEEE Trans. Vehicular Technology, 2018, 67(4): 3420-3430.

[6] CHAKARESKI J. UAV-IoT for Next Generation Virtual Reality[J]. IEEE Trans. Image Processing, 2019, 28(12): 5977-5990.

[7] SILVER D, HUBERT T, SCHRITTWIESER J, et al. A general reinforcement learning algorithm that masters chess, shogi, and Go through self-play[J]. Science, 2018, 362(6419): 1140-1144.

[8] PENG Jinlin, ZHANG Zixuan, WU Qinhao, et al. Anti-jamming communications in UAV swarms: a reinforcement learning approach[J]. IEEE Access, 2019, 7: 180532-180543.

[9] WANG Weihang, LU Xiaozhen, LIU Sicong, et al. Energy efficient relay in UAV networks against jamming: a reinforcement learning based approach[C]∥VTC 2020-Spring IEEE 91st Vehicular Technology Conference. IEEE, 2020: 1-5.

[10] XIAO Liang, JIANG Donghua, CHEN Ye, et al. Reinforcement-Learning-Based Relay Mobility and Power Allocation for Underwater Sensor Networks Against Jamming[J]. IEEE Journal of Oceanic Engineering, 2019, 45(3): 1148-1156.

[11] MKIRAMWENI M E, YANG C, LI J, et al. A survey of game theory in unmanned aerial vehicles communications[J]. IEEE Communications Surveys & Tutorials, 2019, 21(4): 3386-3416.

[12] XIAO Liang, LI Yan, LIU Jinliang, et al. Power control with reinforcement learning in cooperative cognitive radio networks against jamming[J]. Journal of Supercomputing, 2015, 71(9): 3237-3257.

[13] WANG Qian, CHEN Zhi, MEI Weidong, et al. Improving physical layer security using UAV-enabled mobile relaying[J]. IEEE Wireless Communications Letters, 2017, 6(3): 310-313.

[14] ERCEG V, GREENSTEIN L J, TJANDRA S Y, et al. An empirically-based path loss model for wireless channels in suburban environments[J]. IEEE Journal on Selected Areas Communication, 1999, 17(7): 1205-1211.

[15] PALAT R C, ANNAMALAU A, REED J R. Cooperative relaying for ad-hoc ground networks using swarm UAVs[C]∥MILCOM 2005-2005, IEEE Military Communications Conference. IEEE, 2005: 1588-1594.

[16] YANG Dejun, ZHANG Jin, FANG Xi, et al. Optimal transmission power control in the presence of a smart jammer[C]∥2012 IEEE Global Communications Conference (GLOBECOM). IEEE, 2012: 5506-5511.