1 引言

随着数字媒体技术的迅速展开,图像数目剧增,导致图像的处理与检索面对巨大的挑战。基于内容的图像标注能够通过视觉上的相似性进行图像的检索,但是利用视觉词汇检索到的图像往往不能满足人们的需求。基于文本的图像标注快捷便利,但是此方法须要图像的语义标注。手动标注费时费力且昂贵繁琐,因此自动图像标注为当下趋势所需。

曾经盛行的图像标注方法是基于概率统计的方法[1-2]。这些方法首先定义图像特征和标注词之间的概率分布,然后再定义训练集来求解概率分布参数,最后根据图像特征估计每个关键词的匹配概率。例如Lan等[3]提出了一种基于标签先验概率的自动图像注释算法,首先根据现有的生成模型计算出初始标注词,然后再考虑在标注词的基础上计算图像相似度,以提高标注效果。这些标注方法可以扩展并应用于大规模数据集。但是,图像和关键字之间的分布的假设不能准确表示真实图像环境中的分布。此外,假设分布与实际分布之间的差异可能会限制这些标注方法在实际应用中的性能。

后来,有学者提出了基于图的图像标注方法[4-5]。这些方法使用图结构来表示图像之间的相似性或者标签之间的相似性。例如,Amiri等[6]提出利用多模融合进行基于图的图像标注。首先通过标签相似性构建子图,然后将子图融合为一个超图,利用学习框架来推断超图上测试图像的标签。然而,图的构造过程很复杂。构建图后,遍历图并添加新节点非常耗时。复杂的构造过程和耗时的节点插入使这些方法难以在实际应用中处理大型数据。

近年来,基于机器学习的图像标注方法[7- 8]取得了很大的进展。例如Xu等[9]提出多模态多概念的深度神经网络的图像标注方法。首先构建多模式深度神经网络(DNN)作为视觉图像和上下文标签的概念分类器,然后将其用于注释未标记的图像。如果网络训练有佳,则可以使用这些方法,对图像进行快速标注。然而,当前的机器学习算法大多是浅层结构算法。此外,基于深度学习的方法用于大量图像的注释方法,有时具有过度拟合和较弱的泛化能力的缺点。

因此,现有的方法很难有效并且准确地检索所需要的图像。为了解决以上复杂度高和泛化能力弱等问题,本文提出了基于偏序结构的图像标注。偏序结构[10]是基于形式概念分析,对数据的普遍性和特异性结构进行分析的算法。形式概念分析[11]是以数学的模式叙述概念与概念之间的关系,将组成本体的概念、属性以及关系等用形式化的语境表述出来。本文中,首先利用形式概念分析的背景知识以二进制码的形式表述图像与标签之间的关系。利用图像和标签的关系,分别构建属性偏序结构图和对象偏序结构图。属性偏序结构图是以节点为属性,边为对象。对象偏序结构图是以节点为对象,边为属性。通过属性偏序结构图,增强标签的丰富度,提高语义的完整性。

2 偏序结构

2.1 形式背景

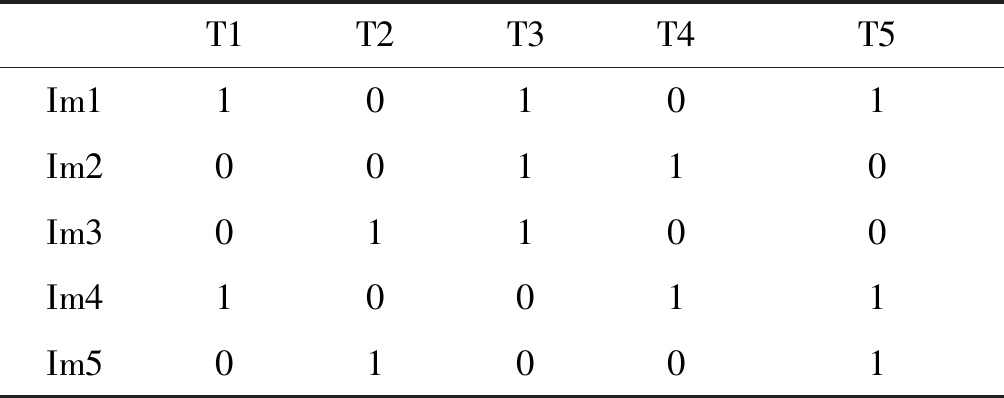

形式概念分析的首要工作即构建形式背景。本文以图像为对象,以标签为属性构建形式背景,如表1所示。其中Im1-Im5表示图像,T1-T5表示标签,通过将数据以二进制编码的形式进行划分,来表示属性与对象之间的关系。横向栏为属性,纵向栏为对象,若交叉处为1,则表示对象有此对应属性,若交叉处为0,则表示没有对应属性。

表1 图像的形式背景

Tab.1 Formal context of the image

T1T2T3T4T5Im110101Im200110Im301100Im410011Im501001

2.2 偏序结构图

偏序结构图[12]是根据事物关系构造的一种不循环的图形,根据人类利用不同思维对数据的不同方向的认知,可以将偏序结构分为属性偏序结构和对象偏序结构。

许多已经提出的利用多个标签对图像进行注释的方法[13]分别为每一个标签学习独立的分类器,却未考虑标签之间的关系。而许多研究工作表明每个目标的语义之间不是相互独立的,充分利用标签之间的相互关系会提高标注的准确性。于是构建了属性偏序结构图,充分挖掘标签之间相互关联的关系。

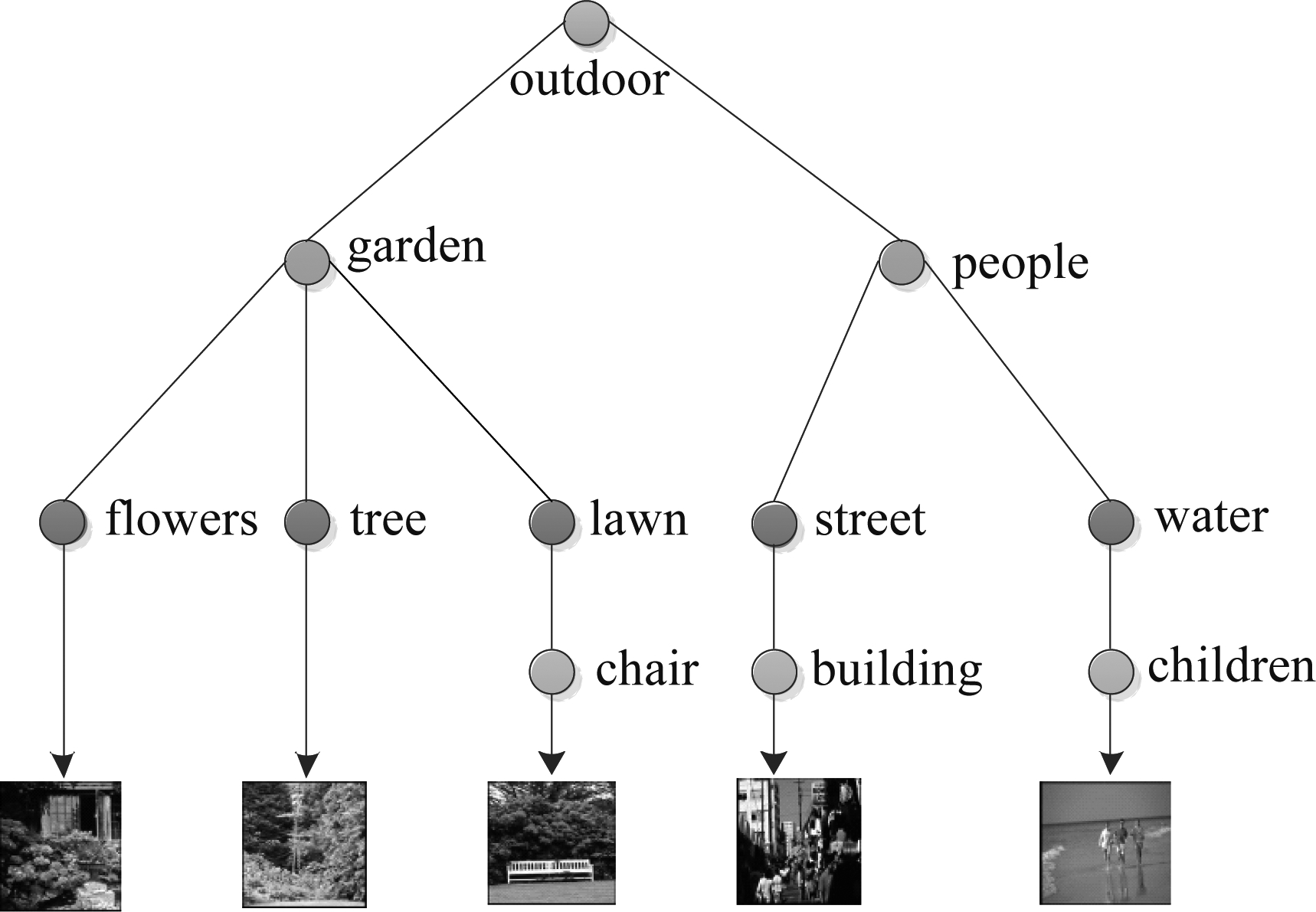

属性偏序结构可以发现属性之间的相关性。本文中,以标签为节点,以图像为边构建属性偏序结构图。每一条支路上所有的标签都作为底端图像的标签,越靠近图片的标签越特质,越远离图片的标签,表示的范围越大,越广泛。同时,标签之间相连的节点,也体现了标签之间的相互关联的特性。标签之间连接的边的数目越少,则标签之间属性越相似,相关性越强。在本文,为了提高标签语义的完整性和丰富性,利用已有的视觉邻近集中的已有的标签L1,根据属性偏序结构图得到已有标签的相关标签L*。如图1所示,例如garden的相关标签outdoor,flowers,tree和lawn,lawn的相关标签garden和chair。

图1 属性偏序结构图

Fig.1 Attributes partial order structure (APOS) diagram

对象偏序结构图可以反映出数据对象之间的相似程度,以及数据对象的特异性。以图像为节点,标签为边,构建对象偏序结构图。如图2所示,同一条支路上的图片都有共同的标签,体现图片的共性。不同支路,体现不同标签下的图像的特异性。越接近标签的图像,目标越少,标签目标越明确。本文首先将训练集中的图像按照对象偏序结构图,将图像分别分配到对应的每一类下,然后根据测试图与训练图视觉相似度分数的降序排序,取每一类下的前若干张图片,作为最终测试图像的候选集。

图2 对象偏序结构图

Fig.2 Object partial order structure (OPOS) diagram

3 图像标注

图像标注主要分为四部分:首先,提取图像特征,得到4096维特征向量;然后通过图像相似性得分构建初始邻近集,根据偏序结构得到图像候选集;最后设置词频,选择词频大于阈值的标签作为标注关键词,如图3所示。

图3 图像标注流程图

Fig.3 The flowchart of image annotation

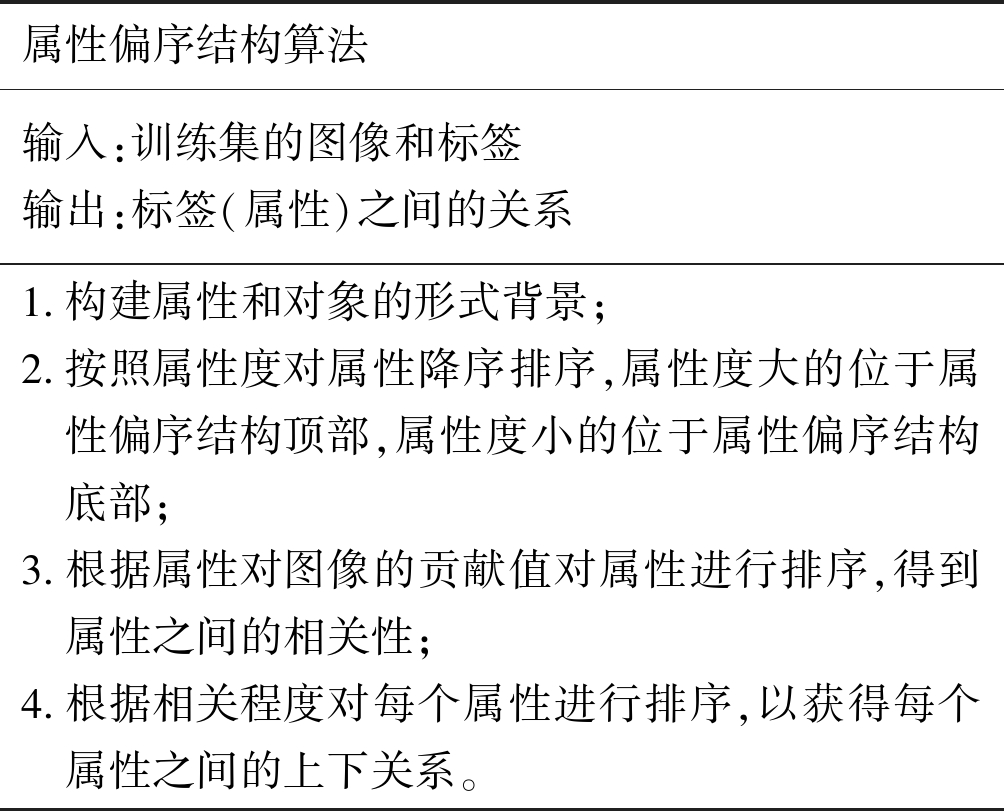

3.1 构建偏序结构

为了充分利用标签之间的相互影响的关系,本文提出了基于偏序结构的图像标注。在偏序结构图中,标签作为属性,图像作为对象。以标签为节点,以图像为边构建属性偏序结构图。首先,构建属性与对象的形式背景,并按照属性度对属性进行降序排序;然后按照属性对图像的贡献值对属性排序;最终得到属性之间的关系,见如下算法:

属性偏序结构算法输入:训练集的图像和标签输出:标签(属性)之间的关系1.构建属性和对象的形式背景;2.按照属性度对属性降序排序,属性度大的位于属性偏序结构顶部,属性度小的位于属性偏序结构底部;3.根据属性对图像的贡献值对属性进行排序,得到属性之间的相关性;4.根据相关程度对每个属性进行排序,以获得每个属性之间的上下关系。

以图像为节点,以属性为边构建对像偏序结构图。将形式背景中的得到的矩阵转置,进行算法步骤1之后的步骤,得到对象偏序结构图。通过对象偏序结构图,可以得到同一标签下的所有图像。计算测试图像与每一类训练图像的距离,并按照降序排序,取前n幅图像作为测试图像的候选集。

3.2 图像标注

3.2.1 提取图像特征

在深度卷积神经网络(CNN)[14]结构在图像分类和标注的成功启发下,本文使用预训练的CNN提取特征。CNN模型是一个有着强学习能力和特征表达能力的多层网络,初始层检测图像的简单和局部特征,然后将其输入到下一层,使之检测出更多的抽象特征。通过CNN网络传递每幅图像,本文利用全连接层的输出作为图像的特征向量。实验中采用卷积神经网络中VGG-19[15]结构,利用其第17层全连接层,得到了每幅图像的4096维特征向量。

3.2.2 计算图像相似性

训练集由训练图像I与训练标签W组成,测试集由测试图像I*组成。为了得到测试图像I*的初始邻近集,首先利用已经训练好的VGG-19网络提取出的4096维向量,计算测试图像I*与训练图像I的视觉相似性得分,然后将图像相似性得分进行降序排序。计算公式[16]如下:

(1)

β=15,Ia∈Ib,Dis(Ia,,I*)表示为Ia与I*的图像相似性距离。

(2)

L(Ia,,I*)代表Ia与I*的相关联距离,Cov(Ia,I*)为 Ia 和 I*的协方差, D(Ia)和 D(I*)分别为 Ia 和 I*的方差。

(3)

通过图像相似性得分的降序排序,获取前m幅图像作为初始邻近集,并且得到其标签集L1。

3.2.3 获取相关语义

为了提高语义的丰富度同时增加召回率,通过属性偏序结构得到标签L1的相关标签L*。首先根据得到的相似性图像的标签L1,在图1中,确定 L1标签的所在位置,然后根据属性偏序结构图的分支延伸方向,选择标签L1相邻节点的标签,作为图像的相关语义L*。例如,garden的相关语义outdoor,flowers,tree和lawn,street的相关语义people和building。

根据以上得到的标签集合L*,利用对象偏序结构(图2),每个训练图像被分配给几个语义标签。将测试图像I*与标签集合L*下的训练图像I进行相似性距离度量,并按照降序排序。为了提高标注过程的准确率,取前n张图片,构成测试图像最终的候选集Q。

特征提取主要提取图像的低级特征。本文通过图像间的视觉相似性得到初始邻近集与邻近标签,充分利用了图像的视觉相似性。根据邻近标签,构建属性偏序结构图。通过属性偏序结构图挖掘出标签语义间相互关联的特性,并且将图像视觉标签进行充分的语义扩展,减小了低级特征与抽象语义间的鸿沟问题,提高了标注的准确率和召回率。

3.2.4 词频设置

通过得到的候选集图像Q,得到所有候选集标签Lz。为了提高标注的准确率,防止不相关语义的传播,在候选集标签Lz中筛选出现次数较多,频率较大的标签作为测试图像的标注词。给f设置阈值,其中选择大于阈值的标签作为最终的标注词。

词频的选择对于最终标注结果十分重要。词频过高,会降低标注的召回率;词频太低,会降低标注的准确率。通过权衡评价指标,选择代表综合性能的F值作为衡量标准。本文选择最大的F值对应的词频f作为阈值,选择大于词频f的作为测试图像的关键词。

4 实验结果

4.1 实验数据集

本次实验采用三个数据集:Corel5k[17],Espgame[18]和Iaprtc12[19]。Corel5k数据集是常用的图像处理领域的数据集,它包含5000张图像和260个标签。Espgame数据集包含20770张图像和268个标签,包含人文风景,交通工具等。Iaprtc12数据集包含19627张图像和291个标签。

实验中采用卷积神经网络中VGG-19结构,得到每幅图像的4096维特征向量。

4.2 评估标准

评价标准有:准确率P,召回率R,F和N+(被准确预测过得标签的个数)。

(4)

(5)

(6)

公式中的M为测试集中测试图像的总体数目,Correct(wa)是第a幅图像生成的所有标注词wa中标注正确的数目,Predicted(wa)是第a幅图像数生成的所有标签的wa的总体数目,Ground(wa)是测试集中第a幅图像的实际标注词的数目。

(1)参数m和n

m:视觉邻近集中选择的图像数目。

n:通过对象偏序结构在每一类中选择的图像数目。

通过实验,m和n的选择在一定范围内对实验结果几乎没有影响。本文中m选择5,n选择3。

(2)参数f

频率f是候选集中标签出现次数。本文对f设置一个阈值,选择出现次数较多的标签,作为最终的标注关键词。频率f值的选择对于实验至关重要,因为,它直接决定了最终的标注关键词,影响图像标注的性能。

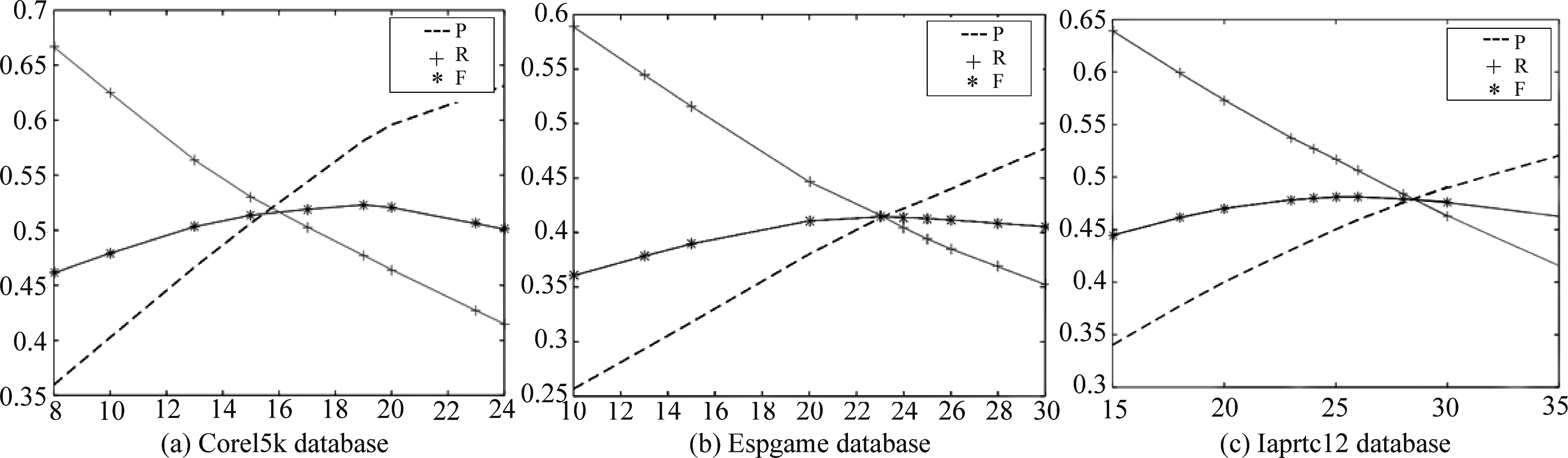

频率与评价指标的关系曲线如图4所示,横轴代表频率(f),纵轴分别代表准确率(P),召回率(R)和F值。随着频率的增加,准确率P不断增加,召回率R不断减小,F先增加后减小。

本次研究中,为了权衡准确率和召回率,使得实验的综合性能较好,三个数据库均选择F值较高的数据进行记录。 在Corel5k数据集,f选择19;Espgame数据集,f选择24;Iaprtc12数据集,f选择25。

4.3 实验结果及分析

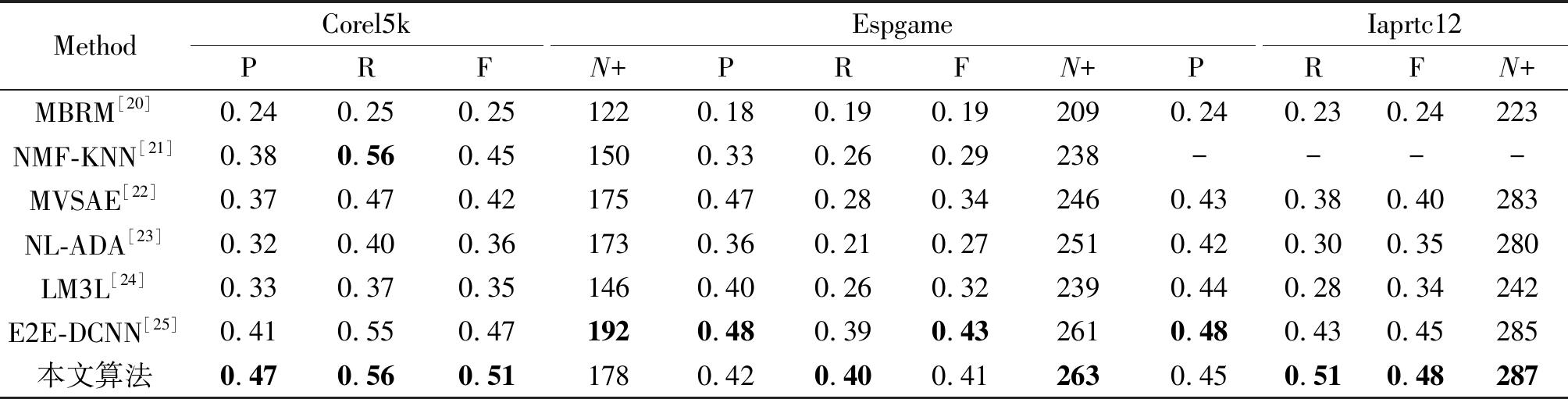

为了证明实验的有效性,本文在三个数据集上与经典的图像标注方法做了比较,如表2所示。

由表2可以看出,本文方法P和R基本高于其他方法,证明了本文方法的有效性。这是因为利用对象偏序结构图发现事物的特异性的优势,本文根据越靠近标签的图像,特异性越强的特点,在每一类下取若干图像,作为最终的候选集图像。利用对象偏序结构图的方法,增强候选集的准确度,提高了标注的准确率P。此外,本文还利用频率选择的方法筛选出频率较大的标签,防止错误标签的传递,同样提高了标注准确率P。属性偏序结构图是以形式概念分析为基础,能够表示属性的共有性和特异性关系的图。本文利用属性偏序结构图,充分挖掘出标签之间的相关性,扩展了标签的语义,增强标签的完整性,提高标注的召回率R。

图4 准确率P、召回率R及F的趋势图

Fig.4 The trend of the precision, recall and F

表2 三个数据集上标注性能的比较

Tab.2 Performance comparison of image annotation methods on three datasets

MethodCorel5kPRFEspgameN+PRFN+PIaprtc12RFN+MBRM[20]0.240.250.251220.180.190.192090.240.230.24223NMF-KNN[21]0.380.560.451500.330.260.29238----MVSAE[22]0.370.470.421750.470.280.342460.430.380.40283NL-ADA[23]0.320.400.361730.360.210.272510.420.300.35280LM3L[24]0.330.370.351460.400.260.322390.440.280.34242E2E-DCNN[25]0.410.550.471920.480.390.432610.480.430.45285本文算法0.470.560.51178 0.420.400.412630.450.510.48287

从表2可以看出,经典的模型MBRM有着较低的性能,后来不断有学者改进模型,例如NMF-KNN,MVSAE, NL-ADA, LM3L等方法,在性能方面有了很大的改进,但是依然没有达到最优。本文利用属性偏序结构,拓展了标签丰富度,极大提高了标签的召回率。利用设置阈值,选择出现次数较多的标签,提高了标注的准确率。例如,与LM3L相比,在Corel5k中,F由37%增加到51%;在Espgame数据集,F 由32%增加到41%;在Iaprtc12数据集,F由34%增加到48%。

E2E-DCNN方法利用可变形卷积网络实现数据增强和标注。该模型在较大的数据集Espgame上,准确率P和F实现了最佳,但是,在Corel5k数据集和Iaprtc12数据集上,本文方法在R 和F指标上均高于E2E-DCNN方法,也展示了本文方法性能的提高。

图像标注性能的提高,能够有效地推动语义理解方向工作的进步。本文中最后用词频选择的方法,选择出现次数较多的词汇,作为图像的最终标签。通过词频的验证,得到标注的P和R呈反比趋势。在一定范围内,词频越大,标注的准确率越高,召回率越低。词频越小,准确率越低,召回率越高。根据不同的应用需求,可以选择合适的阈值f。

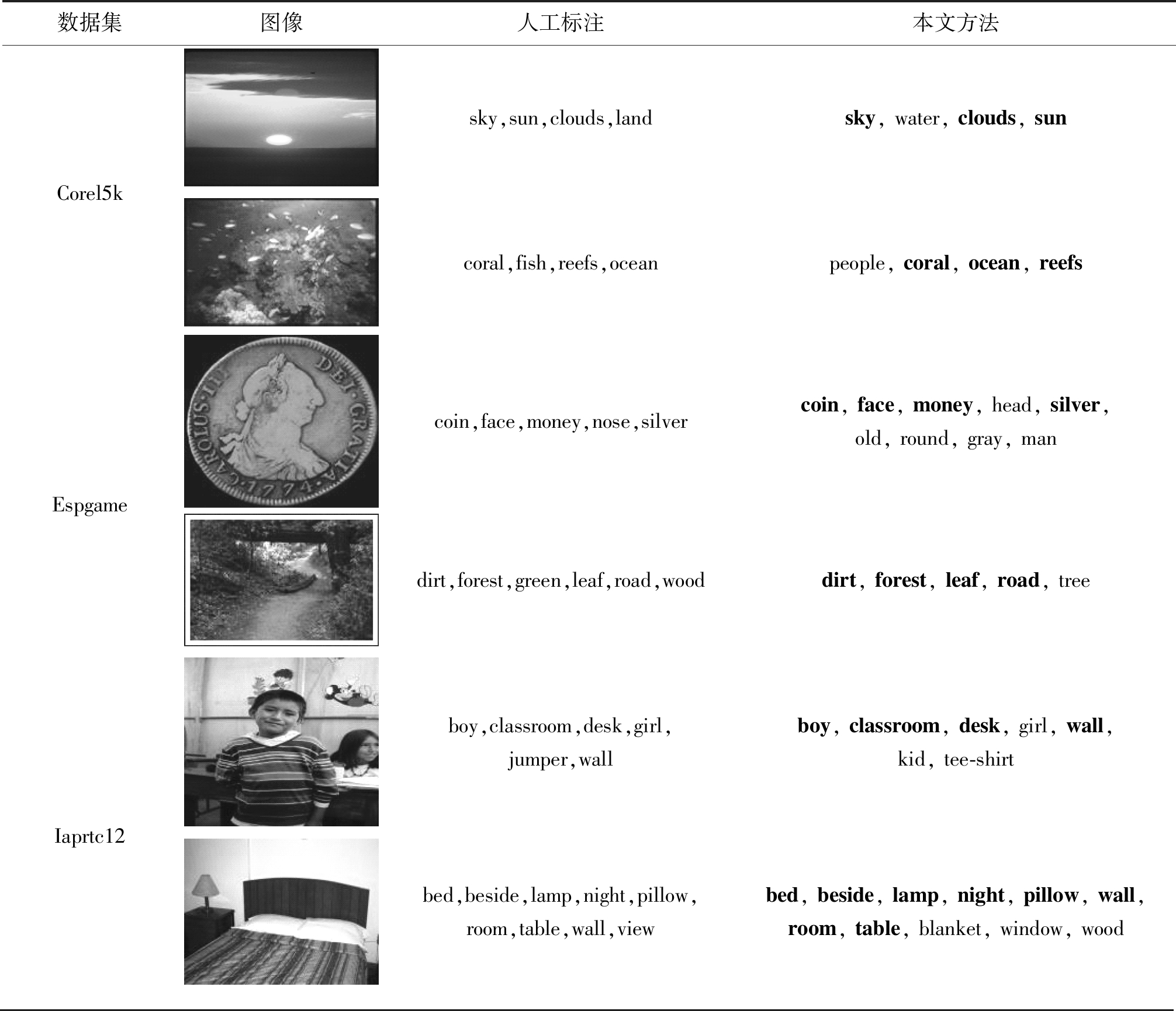

本文提供了三个数据集上的部分标注实例,如下表3所示。

表3 三个数据集上图像标注实例

Tab.3 The annotation instance of the image on three databases

数据集图像人工标注本文方法Corel5ksky,sun,clouds,landsky, water, clouds, suncoral,fish,reefs,oceanpeople, coral, ocean, reefsEspgamecoin,face,money,nose,silvercoin, face, money, head, silver,old, round, gray, mandirt,forest,green,leaf,road,wooddirt, forest, leaf, road, treeIaprtc12boy,classroom,desk,girl, jumper,wallboy, classroom, desk, girl, wall,kid, tee-shirtbed,beside,lamp,night,pillow,room,table,wall,viewbed, beside, lamp, night, pillow, wall, room, table, blanket, window, wood

表3是本文方法标注的部分实例。第一列是本文使用的数据集,第二列是每个数据集中包含的部分图片,第三列为数据集中提供的人工标注,第四列为本文标注的关键词。其中粗体为与人工标注相同的标签,非粗体为不同于人工标注的标签,但是部分也是图像中存在或非常相关的合理标签。例如,第四行的第一张图,其中,标签“head, round, old, gray, man”虽然不存在于手工标注中,但是图片内容确实与这些标注词相关。人工标注可能会丢失图像中的一些对象的标注,并且可能当不同的人标注时,存在主观差异。相同的图像,不同的人标注得到不同结果。因此,本文方法不仅有效地扩展了标签的丰富度,减少了标签的丢失,还可以作为原始图像人工标注的有用补充。

5 结论

为了解决图像标注中的语义鸿沟问题,本文提出了基于偏序结构的自动图像标注的方法。此方法结合形式概念分析,利用属性与对象间的关系,分别构造属性偏序结构图和对象偏序结构图。通过偏序结构图,充分利用标签之间和图像之间的相互关联的特性,增加了标签的丰富度,提高召回率。此外,利用频率值选择筛选出最终的标签,提高标注的准确率。但实验依然存在一定的不足,利用频率选择难以解决标签不平衡问题,这也是本文须要继续研究的问题。

[1] Laib Lakhdar, Allili Mohand Saïd, Ait-Aoudia Samy. A probabilistic topic model for event-based image classification and multi-label annotation[J]. Signal Processing: Image Communication, 2019, 76(C): 283-294.

[2] Seyed Navid Mohammadi Foumani, Ahmad Nickabadi. A probabilistic topic model using deep visual word representation for simultaneous image classification and annotation[J]. Journal of Visual Communication and Image Representation, 2019, 59: 195-203.

[3] Lan Zongyu, Li Shaozi, Cao Donglin, et al. Automatic image annotation based on vocabulary prior probability [C]∥2010 IEEE International Conference on Intelligent Computing and Intelligent Systems, Xiamen, 29-31 October 2010, 3: 720-724.

[4] Zhang Jing, Tao Ti, Mu Yakun, et al. Web image annotation based on tri-relational graph and semantic context analysis[J]. Engineering Applications of Artificial Intelligence, 2019, 81: 313-322.

[5] Khitem Amiri, Mohamed Farah. Graph of concepts for semantic annotation of remotely sensed Images based on direct neighbors in RAG[J]. Canadian Journal of Remote Sensing, 2018, 44(6): 551-574.

[6] Hamid Amiri S, Mansour Jamzad. Leveraging multi-modal fusion for graph-based image annotation[J]. Journal of Visual Communication and Image Representation, 2018, 55: 816- 828.

[7] Li Xue, Shen Bin, Liu Baodi, et al. Ranking-preserving low rank factorization for image annotation with missing labels[J]. IEEE Transaction Multimedia, 2018, 20(5): 1169-1178.

[8] Servajean M, Joly A, Shasha D, et al. Crowd sourcing thousands of specialized labels: A Bayesian active training approach[J]. IEEE Transaction Multimedia, 2017, 19(6): 1376-1391.

[9] Xu Haijiao, Huang Changqin, Huang Muxiong, et al. Multi-modal multi-concept-based deep neural network for automatic image annotation[J]. Multimedia Tools and Applications, 2019, 78(21): 30651-30675.

[10]洪文学, 栾景民, 张涛, 等. 基于偏序结构理论的知识发现方法[J]. 燕山大学学报, 2014, 38(5): 394- 402.

Hong Wenxue, Luan Jingmin, Zhang Tao, et al. A new method for knowledge discovery based on partial ordered structure theory[J]. Journal of Yanshan University, 2014, 38(5): 394- 402.(in Chinese)

[11]Wille R. Formal Concept Analysis: Tutorial on Formal Concept Analysis[J]. Electronic Notes in Discrete Mathematics, 1999, 2(3): 199-200.

[12]洪文学, 李少雄, 张涛, 等. 大数据偏序结构生成原理[J]. 燕山大学学报, 2014, 38(5): 388-393, 402.

Hong Wenxue, Li Shaoxiong, Zhang Tao, et al. Generation principle of partial ordered structure towards big data[J]. Journal of Yanshan University, 2014, 38(5): 388-393, 402.(in Chinese)

[13]Ding Xinmiao, Li Bing, Xiong Weihua, et al. Multi-instance multi-label learning combining hierarchical context and its application to image annotation[J]. IEEE Transaction Multimedia, 2016, 18(4): 1616-1627.

[14]朱继洪, 裴继红, 赵阳. 卷积神经网络(CNN)训练中卷积核初始化方法研究[J]. 信号处理, 2019, 35(4): 641- 648.

Zhu Jihong, Pei Jihong, Zhao Yang. Research on convolution kernel initialization method in convolutional neural network (CNN) training[J]. Journal of Signal Processing, 2019, 35(4): 641- 648.(in Chinese)

[15]Carvalho T, Rezende E R S, Alves M T P, et al. Exposing computer generated Images by eye’s region classification via transfer learning of VGG19 CNN[C]∥16th IEEE International Conference on Machine Learning and Applications (ICMLA), Cancun, 18-21 December 2017: 866- 870.

[16]顾广华, 曹宇尧, 李刚, 等. 基于语义标签生成和偏序结构的图像层级分类[J]. 软件学报, 2020, 31(2): 531-543.

Gu Guanghua, Cao Yuyao, Li Gang, et al. Image level classification based on semantic label generation and partial order structure[J]. Journal of Software, 2020, 31(2): 531-543.(in Chinese)

[17]Sun Liang, Ge Hongwei, Shinichi Yoshida, et al. Support vector description of clusters for content-based image annotation[J]. Pattern Recognition, 2014, 47(3): 1361-1374.

[18]Guillaumin M, Mensink T, Verbeek J, et al. Tagprop: Discriminative metric learning in nearest neighbor models for image autoannotation [C]∥IEEE 12th International Conference on Computer Vision, ICCV 2009, Kyoto, Japan, September 27-October 4, 2009: 309-316.

[19]Zhang Shaoting, Huang Junzhou, Li Hongsheng, et al. Automatic image annotation and retrieval using group sparsity[J]. IEEE Transactions on Systems, 2012, 42(3): 838- 849.

[20]Feng S L, Manmatha R, Lavrenko V. Multiple Bernoulli relevance models for image and video annotation[C]∥Proceedings of the 2004 IEEE Computer Society Conference on Computer Vision Pattern Recognition, CVPR 2004, Washington, DC, USA, 27 June-2 July 2004, 2: 1002-1009.

[21]Kalayeh M M, Idrees H, Shah M. NMF-KNN: Image Annotation Using Weighted Multi-view Non-negative Matrix Factorization[C]∥2014 IEEE Conference on Computer Vision and Pattern Recognition, Columbus, OH, 23-28 June 2014: 184-191.

[22]Yang Yang, Zhang Wensheng, Xie Yuan. Image automatic annotation via multi-view deep representation[J]. Journal of Visual Communication and Image Representation, 2015, 33: 368-377.

[23]Ke Xiao, Zhou Mingke, Niu Yuzhen, et al. Data equilibrium based automatic image annotation by fusing deep model and semantic propagation[J]. Pattern Recognition, 2017, 71: 60-77.

[24]Niu Yuzhen, Zhong Yini, Guo Wenzhong, et al. 2D and 3D image quality assessment: A survey of metrics and challenges[J]. IEEE Access, 2019, 7: 782- 801.

[25]Ke Xiao, Zou Jiawei, Niu Yuzhen. End-to-End Automatic Image Annotation Based on Deep CNN and Multi-Label Data Augmentation[J]. IEEE Transactions on Multimedia, 2019, 21(8): 2093-2106.