1 引言

在现实生活中,语音在通信过程中不可避免地会受到周边环境的影响。通信中的机械声、交通鸣笛和其他说话人的话音等背景噪声严重影响语音信号的质量,需要从这些被“污染”的含噪语音信号中提取出尽可能纯净的语音信号,从而实现语音增强。传统的基于短时谱估计的语音增强算法有谱减法、维纳滤波法和基于统计模型的方法。近年来,在单通道语音增强领域基于子空间[1]和小波变换[2]的增强方法也备受关注。特别是压缩感知理论[3]被提出来后,基于稀疏表示和字典学习的语音增强算法[4- 5]在语音增强和语音分离领域得到了广泛的研究和应用。

稀疏表示是指在某个信号的原子集合中选取少数原子进行线性组合还原出该信号。这里需要尽可能保留与信号特性最相关的原子来表征信号的所有信息。选取的原子数越少则信号表示越稀疏,也就意味着信号能够被更好地稀疏表达。所以在字典学习中需要寻找信号原子集合的最优解,使得原子集合能够较好地反映出信号的语音特性,从而实现稀疏地表示。一般稀疏字典主要分为两类:一种是利用数据训练的字典,例如K奇异值分解(K-singular value decompostion,K-SVD)字典[6];还有一种是固定的基构造的字典,例如离散余弦变换(Discrete cosinetransform,DCT)字典[7]。许多学者将稀疏表示和字典学习方法用在语音分离[8]和语音增强[9]等领域,并取得了丰富的成果。其中,Sigg[10]将含噪语音在由纯净语音字典和噪声语音字典组合的联合字典上投影,含噪信号中的语音成分和噪声成分分别被对应子字典所解释,从而可以估计出纯净语音信号。Mohammadiha[11]提出基于贝叶斯非负矩阵分解的语音增强方法,使用了新的非负矩阵分解的字典学习和更新方法,以适应信噪比大小变化。Baby[12]提出了基于双字典的语音增强及自动语音识别算法,利用语音样本作为字典原子训练离散傅里叶变换域字典和相应的特征域字典,重构阶段含噪信号在特征域字典上投影时具有更少的运算维度及更优的增强效果。Sprechmann[13]提出可学习的低秩系数模型的语音增强算法,约束重构的语音及噪声是低秩的,并简化低秩系数的复杂度,基于神经网络更精确地得到稀疏表示系数,具有较好的增强效果,但是语音字典和噪声字典之间的区分性不够好,导致增强后的语音存在一定的残余噪声和失真。Zhang[14]考虑了语音、噪声和含噪语音的关系以及对应字典间的交叉干扰,提出了新的约束函数训练字典,从而使得联合字典的区分性得到了提高。但由于含噪信号中表示语音成分的原子仍然有部分会投影在干扰噪声子字典上,从而导致语音增强性能未能达到最佳。后来,Zhang又提出基于比率掩码和联合字典的单通道语音增强算法[15],通过引入语音比例掩码和干扰掩码提供了新的区分信息,构造了新的框架一定程度上提高了增强性能。贾[16]提出一种交替优化稀疏系数和字典的语音增强算法,利用费舍尔准则约束字典学习的目标函数,得到具有区分性的字典与最优稀疏系数,进一步解决了联合字典间的交叉干扰问题。但某种程度上来说,语音和噪声信号之间存在一定的相似成分,尤其是在诸如车载噪声这类非平稳噪声与语音信号之间,共性尤其突出。针对该问题,本文基于区分性约束和抗混淆约束的优化函数训练双层联合字典,并提出一种基于双层字典学习的单通道语音增强方法。

2 基于单层字典的语音增强

2.1 信号模型

本文所讨论的单通道语音增强问题的信号模型:

y(k)=x(k)+n(k), 1≤k≤T

(1)

式(1)中,k为离散时间,y(k)、x(k)和n(k)分别表示含噪语音、干净语音和干扰噪声的离散时间信号。我们的目标是降低噪声信号n(k)的干扰,从含噪信号y(k)提取出尽可能纯净的语音信号x(k)。

2.2 单层区分性字典学习原理

传统的基于联合字典的语音增强方法利用源信号的训练样本训练相应信号对应的子字典,然后联合重构实现增强。此方法利用了源信号自身的特性,但没有考虑源信号之间的干扰,导致含噪语音信号在联合字典上稀疏表示时,噪声对语音信号的增强干扰较大。本文在文献[14]的基础上,进一步联合约束信号和噪声的重构误差,针对语音样本基于区分性目标约束函数训练单层联合字典。

假设Y是纯净语音和噪声混合后的含噪语音信号训练集,X是纯净语音信号在时域上的训练集,N是噪声信号在时域上的训练集。Y、X和N之间的关系如式(2)所示:

Y=X+N

(2)

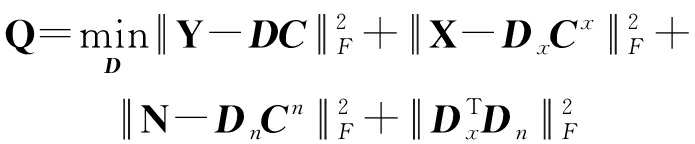

本文充分考虑含噪信号的特性,通过区分性约束的优化函数训练单层联合字典,得到具有区分性的单层联合字典。字典学习的目标函数如式(3)所示:

(3)

这里的Dx和Dn分别是语音和噪声信号对应的子字典,D是由Dx和Dn拼接而成的联合字典,即D=[Dx,Dn]。设定含噪信号训练集Y在联合字典D上的编码矩阵为C=[(Cx)T,(Cn)T]T,其中Cx、Cn分别表示Y在信号子字典Dx和噪声子字典Dn对应的稀疏编码系数。

式(3)中的第一项是为了控制含噪信号与其在单层联合字典上的稀疏表示,使得重构信号与其尽可能相近。第二项和第三项分别约束了纯净语音信号和噪声信号在对应的信号子字典和噪声子字典上进行稀疏表达的近似误差,使得含噪信号中的语音成分能够尽可能投影在信号子字典上而不是在噪声子字典上。如果信号和噪声子字典之间相关性越大,则语音信号在噪声字典上的投影越多,容易造成“交叉投影”现象的发生。因此,在最后一项公式中,我们通过约束信号与噪声子字典的内积,控制两者的相关性,使得子字典间的区分性更大。该单层联合字典学习方法考虑了含噪信号以及源信号的重构误差,通过约束目标函数来训练单层联合字典,使得含噪信号中的语音成分能够尽可能地在语音子字典上稀疏表示。

3 基于双层字典的语音增强

3.1 双层字典的构造

基于单层联合字典的语音增强,我们已经考虑了含噪信号以及源信号之间的特性,通过在具有区分性的单层联合字典上投影可以一定程度避免源混扰。但是现实生活中,有时信号之间存在一定的相似性,例如车载噪声信号和语音信号。当我们在这些噪声环境下基于单层字典学习语音增强时,含噪信号中的语音成分仍然有部分投影在噪声子字典上,需要进一步抑制易混淆的“交叉投影”。因此我们提出利用不同目标优化函数的约束性构造双层联合字典,语音信号和噪声信号的可区分成分在第一层字典上稀疏表达,其易混淆成分在第二层字典上稀疏表达。

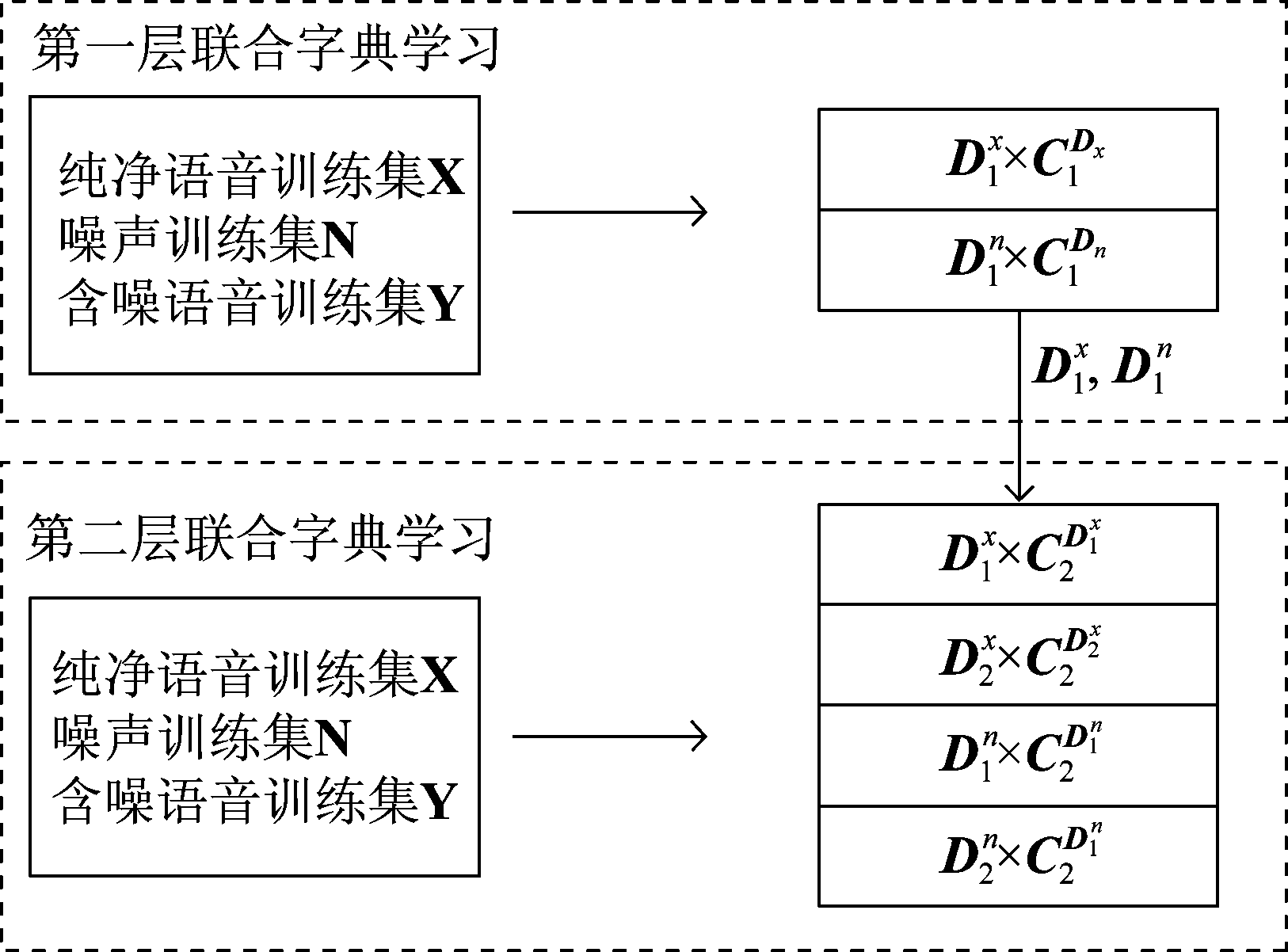

双层字典的训练过程如图1所示。首先利用训练样本学习第一层联合字典![]() 并得到含噪信号Y在联合字典D上的稀疏编码系数

并得到含噪信号Y在联合字典D上的稀疏编码系数![]() 然后在第二层字典学习中,保持第一层学习的子字典

然后在第二层字典学习中,保持第一层学习的子字典![]() 和

和![]() 不变,约束目标优化函数更新第二层的子字典

不变,约束目标优化函数更新第二层的子字典![]() 和

和![]() 最后将第一层和第二层的子字典合并得到双层联合字典

最后将第一层和第二层的子字典合并得到双层联合字典![]() 其中,

其中,![]() 和

和![]() 分别表示第一层和第二层所学习的信号子字典,

分别表示第一层和第二层所学习的信号子字典,![]() 和

和![]() 分别表示第一层和第二层所学习的噪声子字典。

分别表示第一层和第二层所学习的噪声子字典。

图1 双层字典训练过程

Fig.1 Training process of the double-layer dictionary

如果第一层表示的两个源交叉干扰的易混淆成分可以由第二层相应的子字典![]() 表示,则含噪信号集Y在联合字典

表示,则含噪信号集Y在联合字典![]() 上的稀疏表示关系式为:

上的稀疏表示关系式为:

(4)

其中![]() 是含噪信号Y在双层联合字典

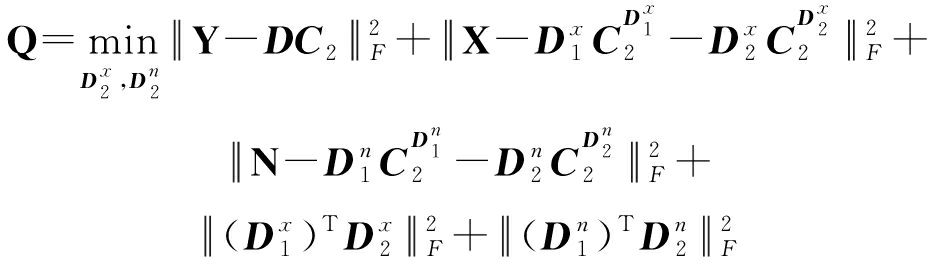

是含噪信号Y在双层联合字典![]() 上的稀疏编码系数。在第二层字典学习中,联合考虑重构信号的误差和两层字典间的相关性,从而得到抗混淆的子字典。目标函数如式(5)所示:

上的稀疏编码系数。在第二层字典学习中,联合考虑重构信号的误差和两层字典间的相关性,从而得到抗混淆的子字典。目标函数如式(5)所示:

(5)

式(5)的第一项是为了控制含噪信号在双层联合字典的稀疏表示,使得重构信号与其尽可能相近。第二项抑制了语音成分在双层联合字典中语音信号对应的子字典![]() 和

和![]() 上稀疏表示的误差,其中在信号子字典

上稀疏表示的误差,其中在信号子字典![]() 和

和![]() 分别表示的是语音信号的可区分成分和易混淆成分,保证含噪信号中的语音分量的可区分成分和易混淆成分都能够尽可能投影在信号子字典上而不是噪声子字典上,从而避免造成“交叉干扰”。第三项通过范数约束噪声信号在双层联合字典上尽可能稀疏表示,在第一层学习的区分子字典

分别表示的是语音信号的可区分成分和易混淆成分,保证含噪信号中的语音分量的可区分成分和易混淆成分都能够尽可能投影在信号子字典上而不是噪声子字典上,从而避免造成“交叉干扰”。第三项通过范数约束噪声信号在双层联合字典上尽可能稀疏表示,在第一层学习的区分子字典![]() 和第二层的子字典

和第二层的子字典![]() 上分别表示的是噪声信号的可区分成分和易混淆成分。最后两项公式中,我们通过最小化第一层学习的区分子字典与第二层学习的能表达混淆成分的子字典之间的内积,限制两层子字典之间的相干性。这里值得强调的是,本文方法与文献[17]方法的不同点在于,本文方法不仅联合考虑了语音信号和噪声的重构误差,而且增加了对两层字典相关性的约束,这样更利于表达源信号的可区分分量和易混淆成分。

上分别表示的是噪声信号的可区分成分和易混淆成分。最后两项公式中,我们通过最小化第一层学习的区分子字典与第二层学习的能表达混淆成分的子字典之间的内积,限制两层子字典之间的相干性。这里值得强调的是,本文方法与文献[17]方法的不同点在于,本文方法不仅联合考虑了语音信号和噪声的重构误差,而且增加了对两层字典相关性的约束,这样更利于表达源信号的可区分分量和易混淆成分。

3.2 双层字典学习的步骤3.2.1 第一层区分性字典学习的步骤

第一层字典采用2.2节单层字典的优化函数学习,字典的每次迭代包含以下三个阶段:首先初始化联合字典![]() 基于K-SVD算法训练样本得到初始化信号子字典

基于K-SVD算法训练样本得到初始化信号子字典![]() 和噪声子字典

和噪声子字典![]() 然后基于字典稀疏编码。固定初始D时,用式(6)的目标函数得到稀疏系数矩阵C1:

然后基于字典稀疏编码。固定初始D时,用式(6)的目标函数得到稀疏系数矩阵C1:

min![]() C1

C1![]() 1s.t.Y=DC

1s.t.Y=DC

(6)

这里我们使用BP算法求解稀疏表示。最后基于优化函数字典更新。固定稀疏系数矩阵C1,通过式(3)的优化函数更新字典,得到具有区分性的联合字典。为了联合优化每个子字典,我们考虑引入矩阵![]() 和

和![]() 其中0表示全零矩阵,I表示单位矩阵。因此,式(3)的变换形式为:

其中0表示全零矩阵,I表示单位矩阵。因此,式(3)的变换形式为:

![]()

![]() N-DP2C1

N-DP2C1![]() +

+![]() (DP3)TDP4

(DP3)TDP4![]()

(7)

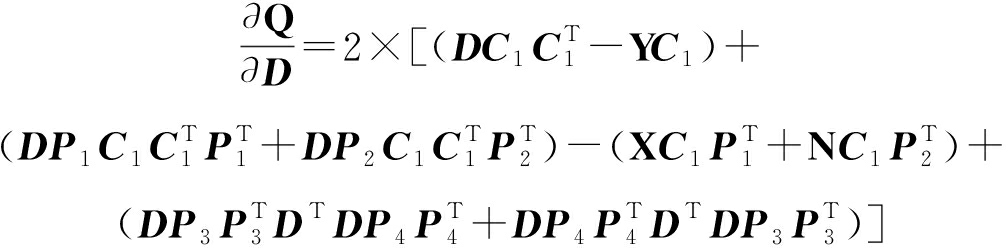

针对式(7)的求解问题,我们采用最优化问题常用的拟牛顿法中的有限记忆BFGS算法(L-BFGS)来处理。同时,需要对目标函数求梯度函数:

(8)

3.2.2 第二层区分性字典学习的步骤

第二层区分性字典的学习同样分为三个步骤。字典学习的第一步是初始化双层联合字典![]()

![]() 其中,第一层联合字典

其中,第一层联合字典![]() 按照3.2.1的步骤学习得到,第二层初始化信号子字典

按照3.2.1的步骤学习得到,第二层初始化信号子字典![]() 和噪声子字典

和噪声子字典![]() 由源信号基于K-SVD算法训练得到。字典学习的第二步是稀疏编码,固定初始字典D,针对式(6)的优化函数,我们利用BP算法求解稀疏编码矩阵。值得注意的是,这里使用的字典是双层联合字典

由源信号基于K-SVD算法训练得到。字典学习的第二步是稀疏编码,固定初始字典D,针对式(6)的优化函数,我们利用BP算法求解稀疏编码矩阵。值得注意的是,这里使用的字典是双层联合字典![]() 而不是

而不是![]()

字典学习的第三步是字典更新。固定稀疏编码系数,我们通过式(9)的优化函数来更新![]() 和

和![]()

![]()

![]()

![]()

(9)

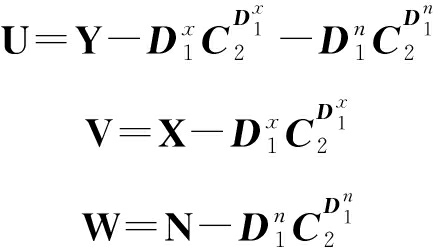

定义变量:

(10)

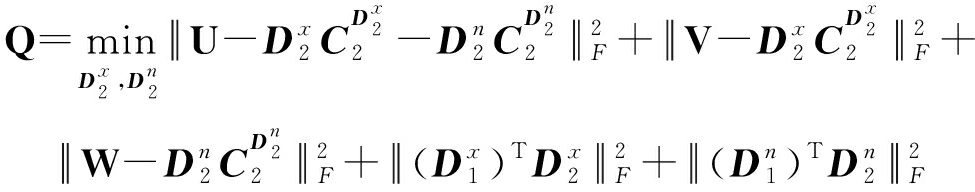

将式(10)代入式(9)中,目标优化函数可写成:

(11)

为了联合优化第二层联合字典,我们定义![]() 并引入矩阵:

并引入矩阵:![]() 和

和![]() 其中0表示全零矩阵,I表示单位矩阵。因此,式(11)可以写成:

其中0表示全零矩阵,I表示单位矩阵。因此,式(11)可以写成:

(12)

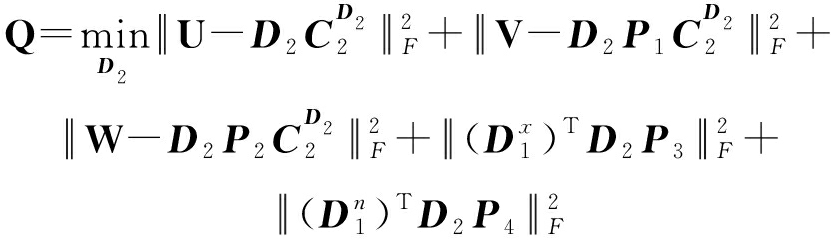

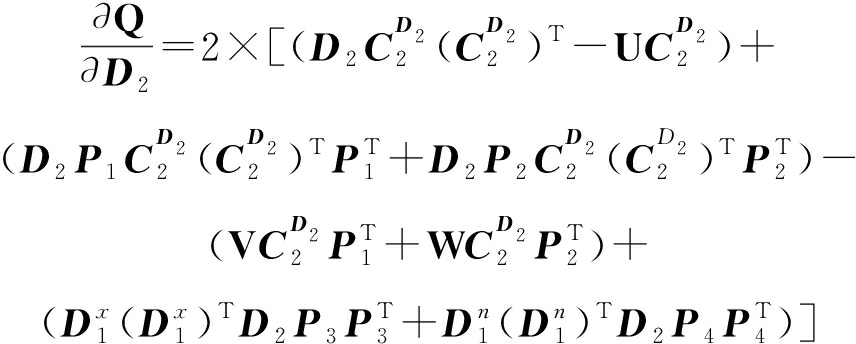

我们采用拟牛顿法中的有限记忆BFGS算法(L-BFGS)来求解,并求得目标函数的偏导:

(13)

最后,将第二层字典![]() 与第一层字典

与第一层字典![]() 拼接成双层联合字典

拼接成双层联合字典![]()

3.3 基于双层字典学习的语音增强

基于双层字典学习的单通道语音增强方法分为两个阶段:在训练阶段,首先采用干净语音、噪声和含噪语音在区分性约束下训练第一层联合字典,然后基于抗混淆的优化函数训练第二层联合字典;在增强阶段,根据含噪语音信号在双层联合字典上投影的稀疏系数矩阵,还原增强后的语音。双层联合字典可以表达语音和噪声信号的可区分分量和易混淆成分,从而减少“交叉投影”现象的发生,降低联合字典的混淆对重构的影响。

图2显示了基于双层字典的含噪语音信号增强模块,其中双层联合字典![]() 包含四个子字典。

包含四个子字典。![]() 和

和![]() 是表达语音信号和噪声信号可区分分量的区分子字典,而

是表达语音信号和噪声信号可区分分量的区分子字典,而![]() 和

和![]() 是表达语音信号和噪声信号易混淆成分的抗混淆子字典。我们可以利用BP算法求得含噪信号s在双层联合字典D的稀疏系数矩阵

是表达语音信号和噪声信号易混淆成分的抗混淆子字典。我们可以利用BP算法求得含噪信号s在双层联合字典D的稀疏系数矩阵![]() 在求得双层联合字典的编码矩阵C后,我们可以通过两层的语音子字典

在求得双层联合字典的编码矩阵C后,我们可以通过两层的语音子字典![]() 和

和![]() 以及对应的稀疏矩阵

以及对应的稀疏矩阵![]() 和

和![]() 来重构语音信号。即通过式(14)我们可以得到增强后语音信号

来重构语音信号。即通过式(14)我们可以得到增强后语音信号![]()

(14)

图2 基于双层联合字典的含噪语音信号增强模块

Fig.2 Module of speech enhancement based on double-layer dictionary

4 实验仿真

本文实验的语音信号采用的是LibriSpeech数据库,语料库为16 kHz采样的英文有声读物。噪声信号取自NOISEX-92数据库,实验选用了车载噪声(Volvo)、白噪声(White)和机舱噪声(F16)三种噪声。训练阶段的含噪信号为80 s干净语音数据和噪声数据分别按信噪比-10 dB,-5 dB,0 dB,5 dB, 10 dB加性组合形成。测试阶段,含噪信号为20条与训练阶段不重合的长度10 s的干净语音数据和噪声数据分别按信噪比-10 dB,-5 dB,0 dB,5 dB, 10 dB加性组合形成,且实验结果取平均值。实验中我们对语音信号和噪声信号采用矩形窗进行分帧。本文采用全局信噪比(SNR)、主观语音质量评估(PESQ)和对数频谱距离(LSD)作为衡量单通道语音增强的效果的客观和主观评价标准。

4.1 本文算法的语音增强效果

采用的信噪比为-10 dB,-5 dB,0 dB,5 dB, 10 dB的含白噪语音作为数据样本,改变字典的冗余度和帧长大小,分析其对语音增强性能的影响。我们将使用全局信噪比的提升值来判断本文算法的语音增强效果。这里的提升值是指含噪信号在语音增强前后的指标值的差值,提升值越大则表明语音增强效果越好。

(1)改变帧长大小比较增强性能

子字典冗余度为1,帧长分别为128、256、512点,训练对应大小的字典,并测试基于区分单层字典学习的单通道语音增强方法和本文的基于双层字典学习的单通道语音增强方法的算法性能。实验数据如表1,由第2到7列可以发现:1)取相同帧长时,相比于单层区分字典方法,本文算法都有较好的增强效果。2)帧长取256点时,本文算法的信噪比提升值大于其他帧长的情况。后续实验中帧长取256。

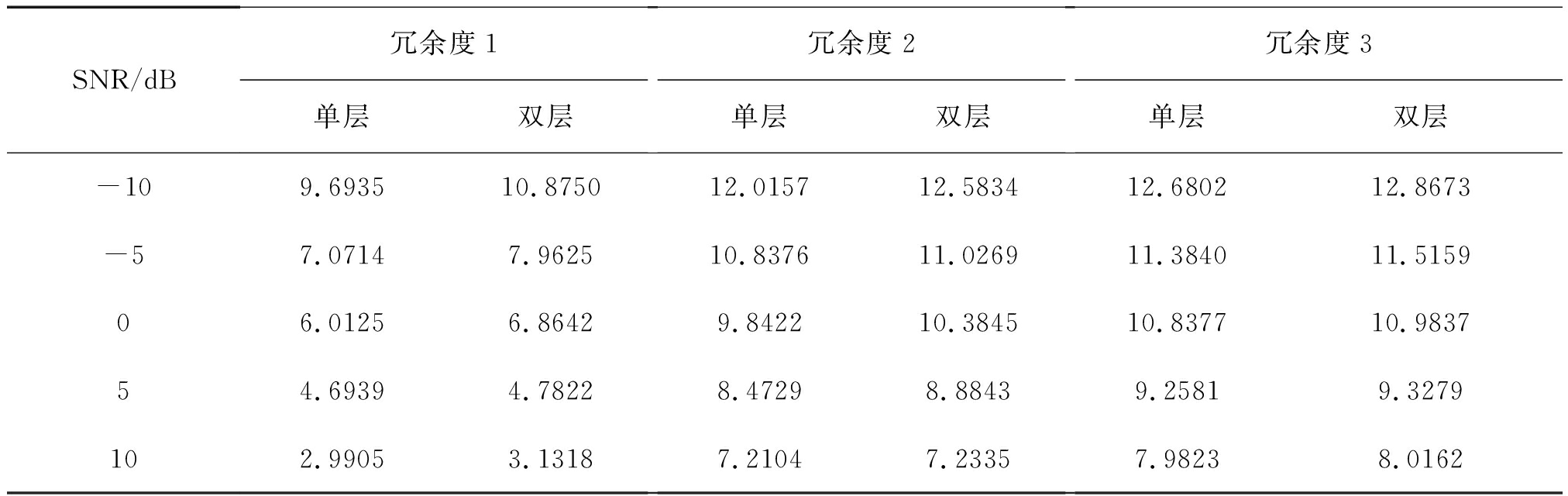

(2)改变字典冗余度比较增强性能

子字典帧长为256,冗余度分别为1、2、3时,训练对应字典并测试基于区分单层字典学习的单通道语音增强方法和本文的基于双层字典学习的单通道语音增强方法的算法性能。实验数据如表2,可以看出:1)同样冗余度下,相同输入信噪比时,基于双层字典学习方法增强后语音信噪比的提升值相较于单层字典学习方法都有所提高:2)基于区分单层字典学习和基于双层字典学习的单通道语音增强方法,其字典冗余度越大,语音增强效果越好;3)冗余度由1提升为2,单、双层字典增强后语音信噪比提升值都较大,冗余度由2提升为3,单、双层字典增强后语音信噪比提升值较小。实验中还发现子字典冗余度越大,联合字典的冗余度越大,训练字典和增强的时间越长,因此实际应用中需综合性能要求和运算速度两方面来考虑字典的冗余度。

表1 白噪声环境下不同帧长时增强后语音信噪比提升值

Tab.1 SNR boost value of the enhanced speech with different frame lengths in white noise

SNR/dB帧长128单层双层帧长256单层双层帧长512单层双层-108.738910.06839.693510.87509.01939.9526-55.45266.44187.07147.96256.72847.690804.89775.14576.01256.86425.52356.700553.40623.64854.69394.78224.29634.3147101.29831.30572.99053.13182.51372.6370

表2 白噪声环境下不同字典冗余度时增强后语音信噪比提升值

Tab.2 SNR boost value of the enhanced speech with different dictionary redundancy in white noise

SNR/dB冗余度1单层双层冗余度2单层双层冗余度3单层双层-109.693510.875012.015712.583412.680212.8673-57.07147.962510.837611.026911.384011.515906.01256.86429.842210.384510.837710.983754.69394.78228.47298.88439.25819.3279102.99053.13187.21047.23357.98238.0162

4.2 与其他算法语音增强效果的对比

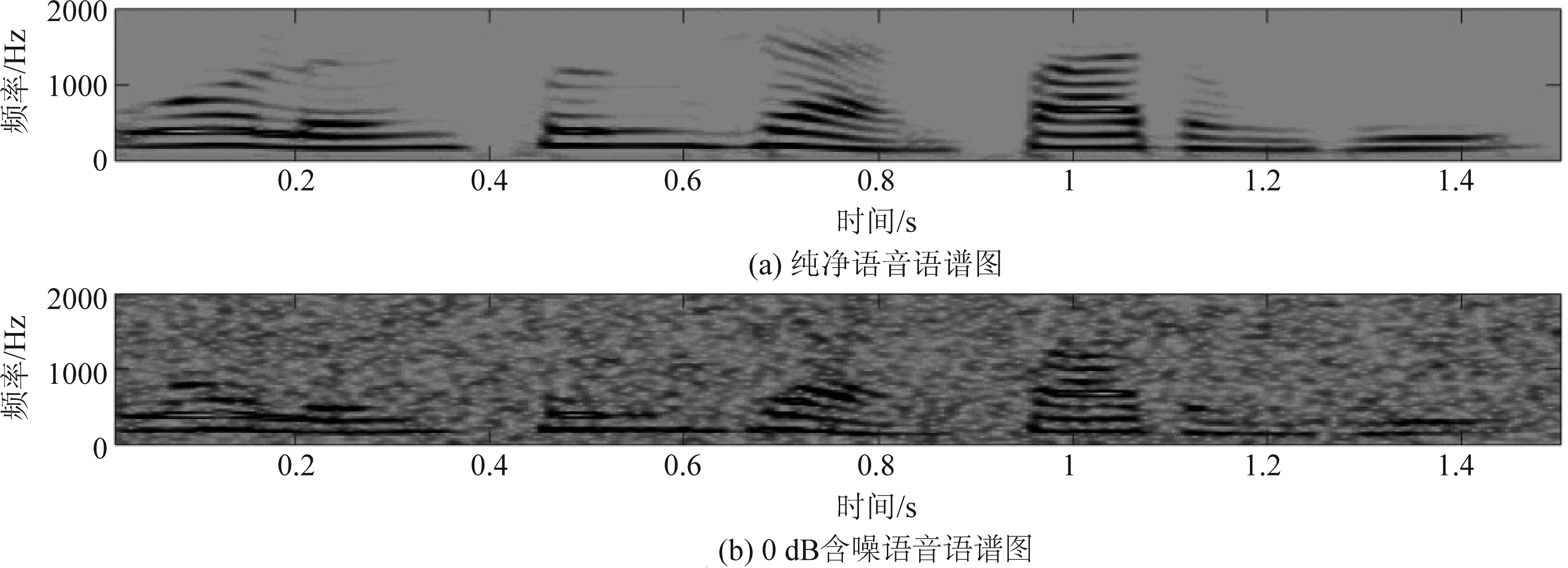

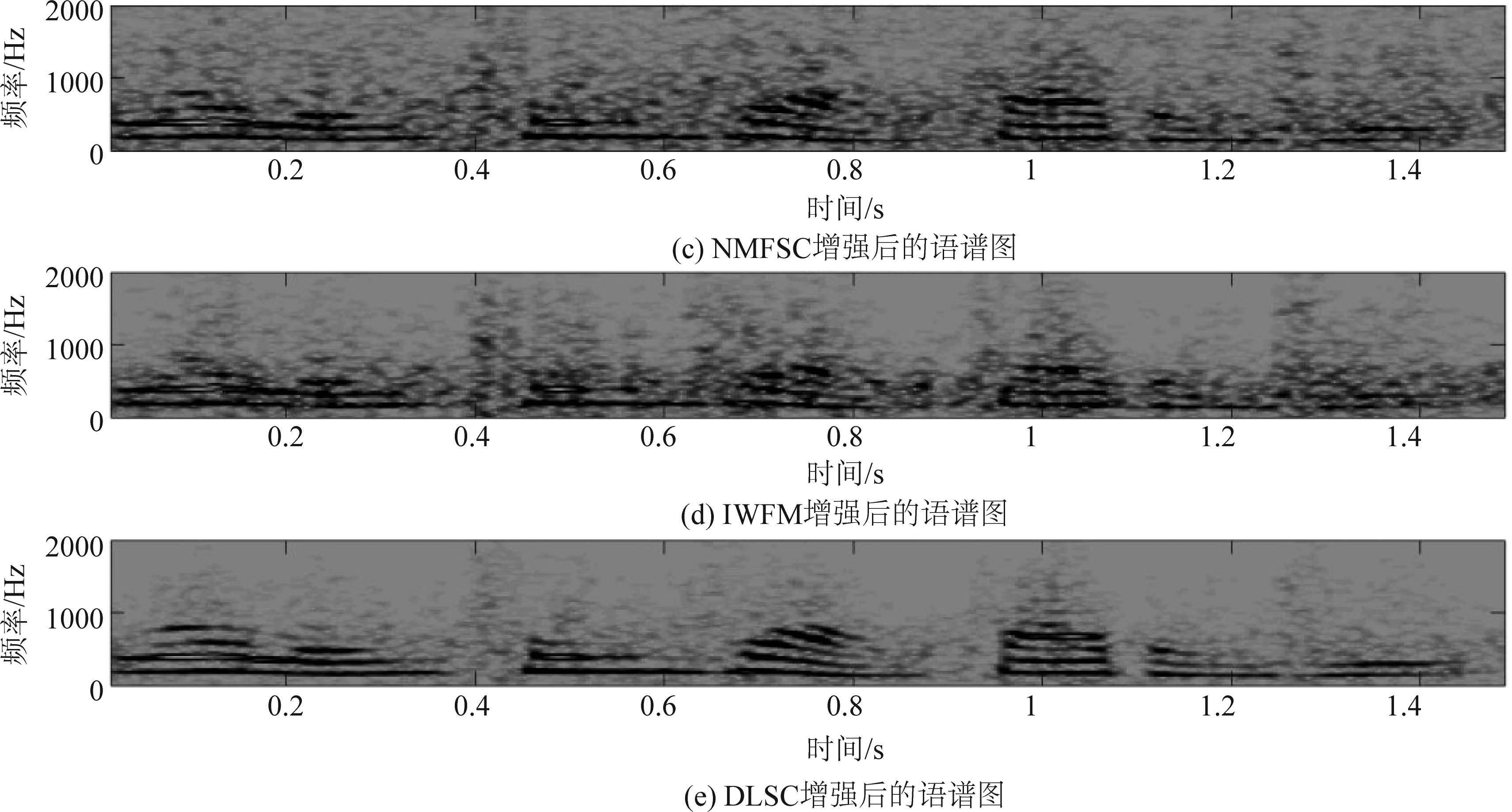

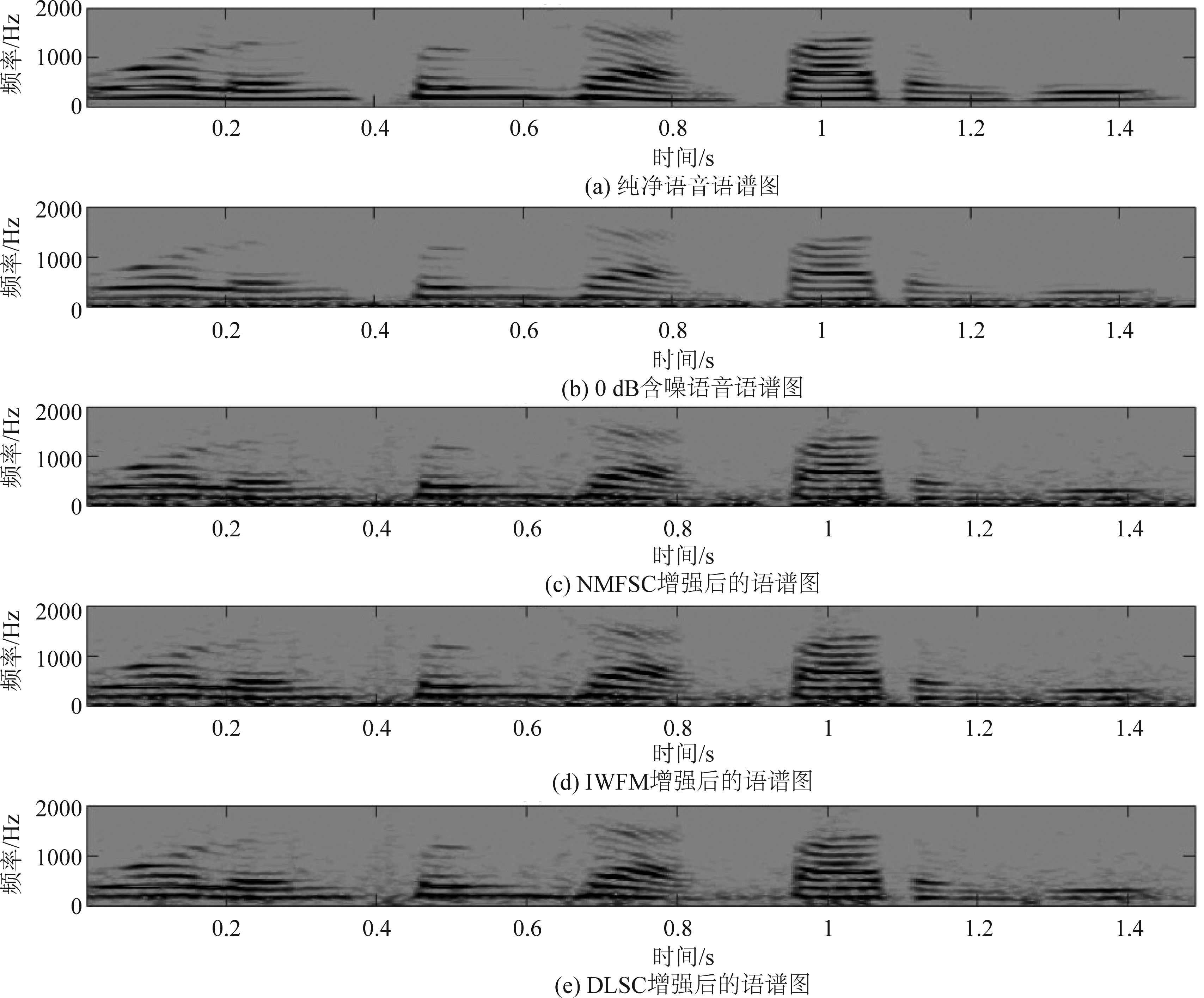

(1)为了更好地证明本文方法的增强效果,在白噪声和有色噪声环境下将基于稀疏约束非负矩阵分解语音增强方法[18](Non-Negative Matrix Factorization with Sparsity-regularized Constraints, NMFSC)、基于改进的维纳滤波语音增强方法[19](Improved Wiener Filtering Method, IWFM)和本文基于双层字典学习方法(Dictionary Learning and Sparse Coding, DLSC)增强性能进行对比。其中改进的维纳滤波法是基于MFCC谱距离端点检测的改进语音增强方法。实验中帧长取256,子字典大小为256×256。图3和图4是在白噪声和车载噪声下0 dB的语音基于不同增强算法增强后的效果图。

图3(a)、(b)、(c)、(d)、(e)分别是纯净语音、信噪比为0 dB的含白噪声语音基于NMFSC、IWFM、DLSC算法增强后语音的语谱图。通过图3可以观察到,NMFSC算法增强后的语音中残留噪声依然较多,语音增强效果并不理想;IWFM算法增强后的语音残留的噪声相对较少,但是在低频带的谐波结构不明显,增强后的语音的信息成分有所丢失;DLSC算法增强后的语音在去除残留噪声的同时又保持了很好的谐波结构,增强后的语音质量相比于其他两个算法有较大提升,本文基于双层字典学习的语音增强算法在白噪声环境下具有良好的增强效果。

图4是在输入0 dB的车载噪声语音时,基于不同算法增强后语音的语谱图。车载噪声的能量主要集中在影响语音的可懂度的低频带。从图4中同样可以观察到基于本文双层字典学习算法增强后的语谱图相比于其他两个算法,在低频带和干净语音的语谱图更为相近,信息成分保留地也更为清晰,说明本文基于双层字典学习的语音增强算法在车载噪声环境下同样具有良好的增强效果。

图3 白噪声下0 dB语音的不同算法增强效果

Fig.3 Performance comparison of the enhanced speech at SNR of 0 dB in white noise

图4 车载噪声下0 dB语音的不同算法增强效果

Fig.4 Performance comparison of the enhanced speech at SNR of 0 dB in volvo noise

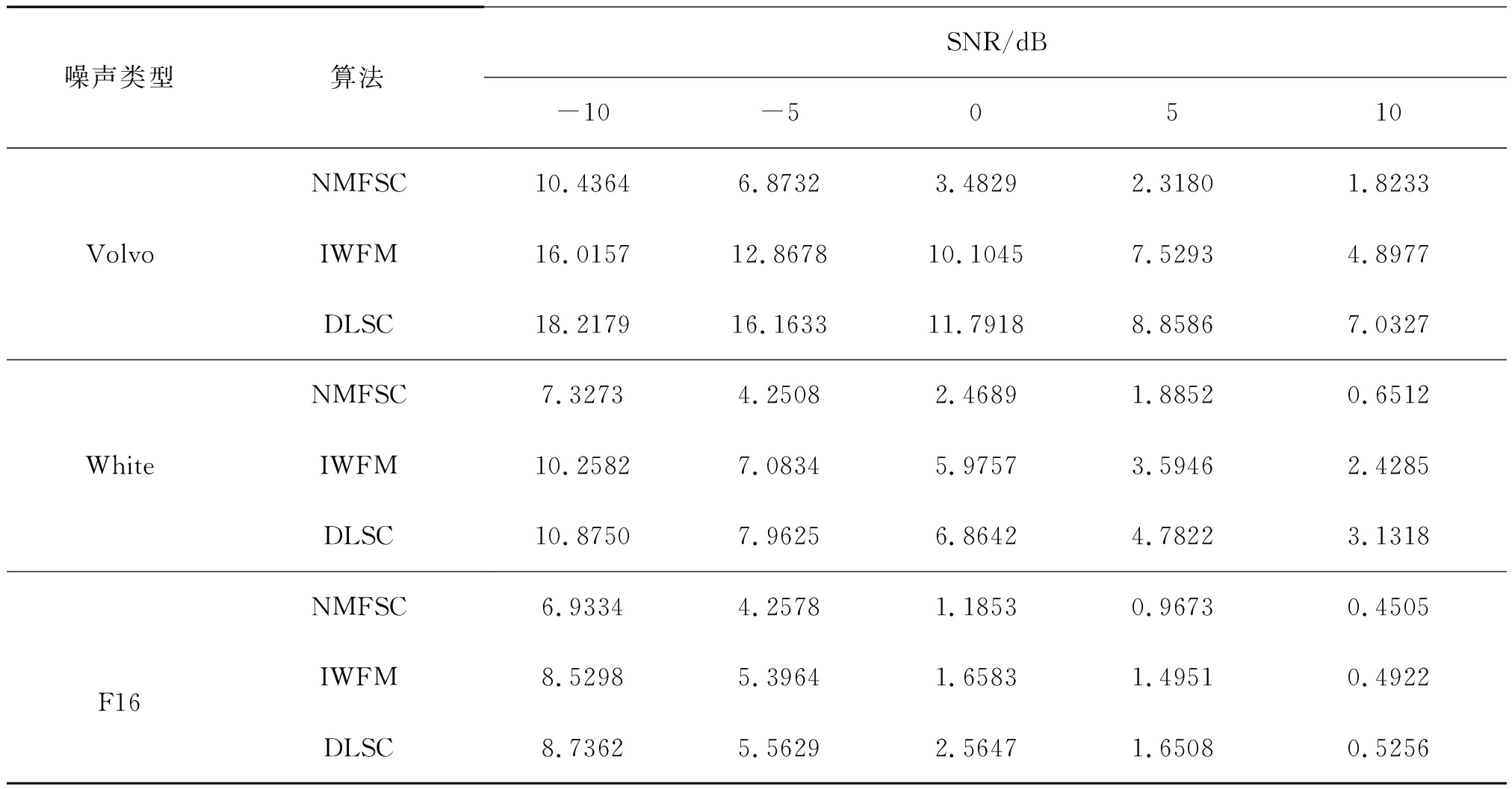

表3 不同噪声环境下语音增强信噪比提升值比较

Tab.3 SNR boost value of the enhanced speech in different noise

噪声类型算法SNR/dB-10-50510VolvoNMFSC10.43646.87323.48292.31801.8233IWFM16.015712.867810.10457.52934.8977DLSC18.217916.163311.79188.85867.0327WhiteNMFSC7.32734.25082.46891.88520.6512IWFM10.25827.08345.97573.59462.4285DLSC10.87507.96256.86424.78223.1318F16NMFSC6.93344.25781.18530.96730.4505IWFM8.52985.39641.65831.49510.4922DLSC8.73625.56292.56471.65080.5256

(2)为了更好地比较不同算法的语音增强效果,表3展示了不同噪声环境下的语音增强信噪比提升值。由表3中可以得出:相比于NMFSC和IWFM算法,在任意信噪比的噪声环境下,DLSC算法的信噪比提升值都更高。特别是在车载噪声环境下,基于本文方法增强的信噪比提升值远远高于其他两个语音增强算法。因为DLSC算法利用稀疏字典的特性并充分考虑了含噪语音和源信号之间的内在关系,通过双层字典的第一层稀疏表达语音和噪声信号的可区分分量,第二层稀疏表达语音和噪声信号的易混淆成分,从而减少“交叉投影”现象的发生,降低联合字典的混淆对重构的影响。因此,同一信噪比的噪声环境中,本文提出的DLSC算法可以得到更高信噪比的增强后语音,具有更佳的增强效果。

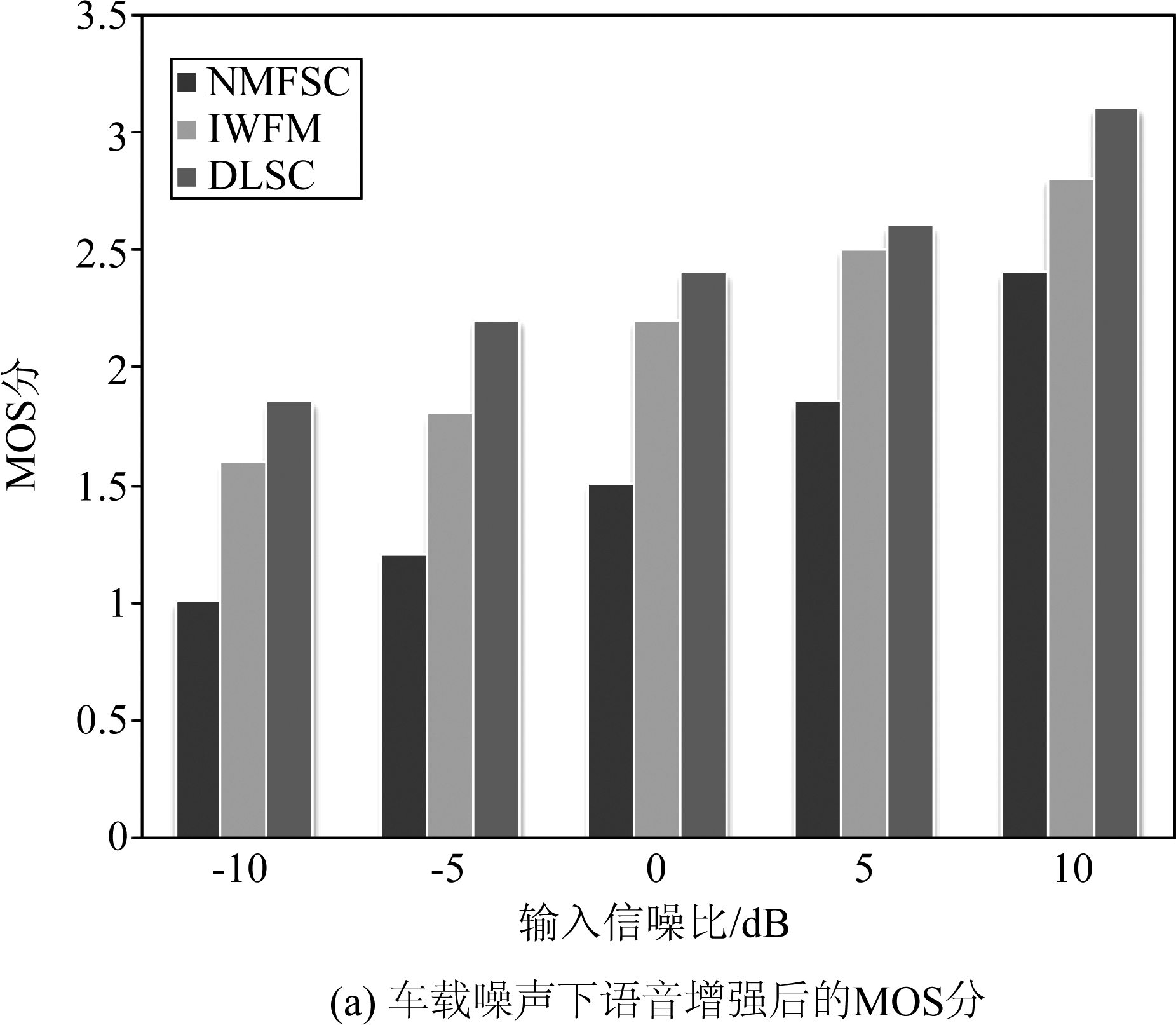

(3)为了更好的比较各种方法的语音增强效果,我们将进一步从PESQ计算的MOS分来衡量本文算法的增强性能。语音的MOS分与语音的可懂度成正比,MOS分越高语音质量越好。图5(a)、(b)、(c)分别表示车载噪声、白噪声、机舱噪声下不同输入信噪比时各方法的MOS分结果。可以发现相比于NMFSC和IWFM算法,本文算法在车载噪声和白噪声环境下都有较高的MOS分,语音清晰度和可懂度都有一定的提高。而在机舱噪声环境中,当信噪比为10 dB时,三种算法的MOS分较为接近,但DLSC算法仍然比其他两种算法的MOS分高。我们通过比较MOS分的大小,可以得出:在同一信噪比的噪声环境中,本文提出的基于双层字典学习的语音增强方法都具有更好的增强效果。

图5 不同噪声环境下MOS分的结果

Fig.5 MOS of the enhanced speech in different noise

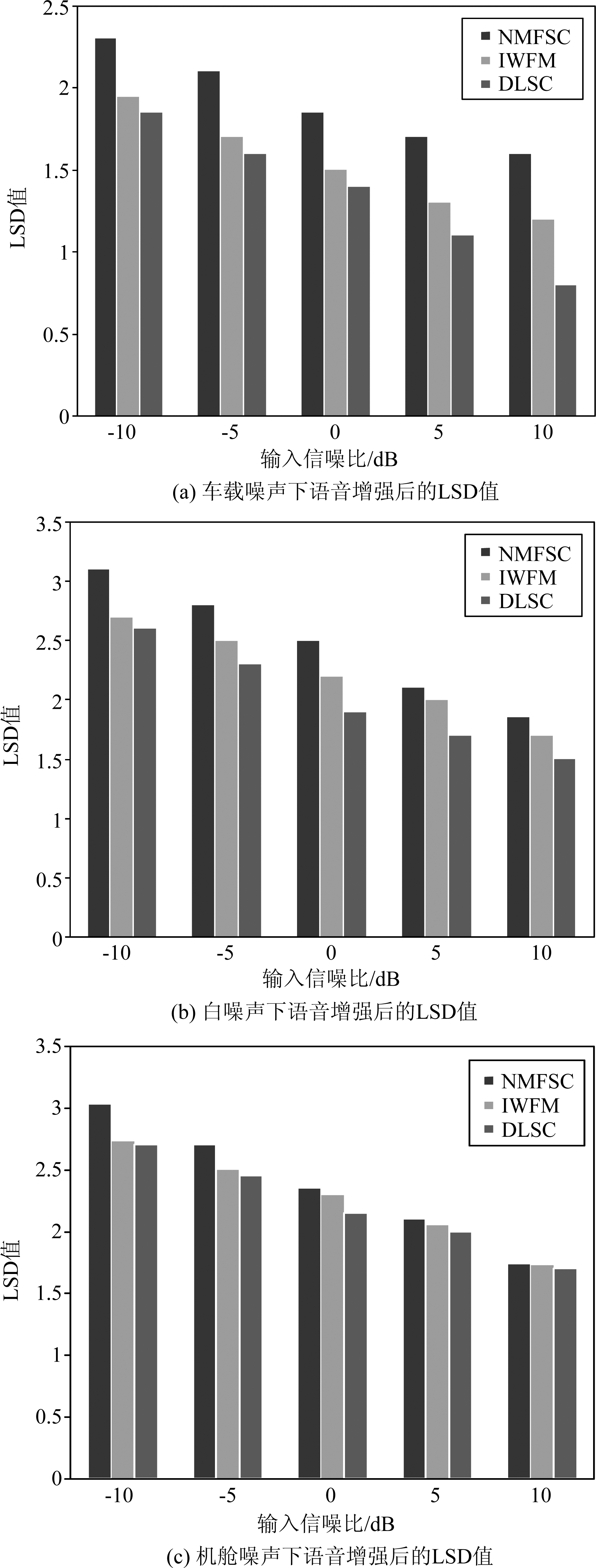

(4)为了更好的比较各种方法的语音增强效果,我们将从LSD值的大小来衡量本文算法增强后语音的失真度。LSD值越小表示增强后的语音信号的频谱失真越小,信号更接近干净语音,语音增强效果越好。图6(a)、(b)、(c)分别表示车载噪声、白噪声、机舱噪声下不同输入信噪比时各方法的LSD值的结果。可以看出相比于其他两种算法,本文算法在车载噪声、白噪声环境下都有更小的LSD值,增强后语音的失真度更小。在机舱噪声环境中,当信噪比为10 dB时,三种算法的LSD值较为接近,但DLSC算法的LSD值仍低于其他算法。因此,通过比较LSD值的大小表明,本文提出的DLSC算法在同一信噪比的噪声环境中可以更好地描述稀疏字典和系数矩阵的分布,能够更准确地还原出干净语音,具有更佳的增强效果。

图6 不同噪声环境下LSD值的结果

Fig.6 LSD of the enhanced speech in different noise

5 结论

本文主要研究了单通道语音增强问题,针对白噪声和有色噪声提出了基于双层字典学习的单通道语音增强方法。该方法通过构造新的优化函数,约束信号的重构误差和子字典的相关性,来构建双层联合字典,并且基于此双层联合字典实现语音增强。本文算法考虑了语音信号和噪声的重构误差,增加了对双层字典相关性的约束,使得源信号的可区分分量和易混淆成分的区分性得到了提高,重构后语音的质量得到了增强。实验结果表明,本文所提方法可以提高单通道语音增强的可懂度和清晰度,有效地提高语音的感知质量。

[1] Boll S F.Suppression of acoustic noise in speech using spectral subtraction[J]. IEEE Transactions on Acoustics, Speech, and Signal Processing, 1979, 27(2): 113-120.

[2] 刘凤山, 吕钊, 张超, 等. 改进小波阈值函数的语音增强算法研究[J]. 信号处理, 2016, 32(2): 203-213.

Liu Fengshan, Lv Zhao, Zhang Chao, et al. Research on Speech Enhancement Algorithm Based on Modified Wavelet Threshold Function[J]. Journal of Signal Processing, 2016, 32(2): 203-213.(in Chinese)

[3] Haneche H, Boudraa B, Ouahabi A. A new way to enhance speech signal based on compressed sensing[J]. Measurement, 2020, 151: 107-117.

[4] 李轶南, 张雄伟, 曾理, 等. 改进的稀疏字典学习单通道语音增强算法[J]. 信号处理, 2014, 30(1): 44-50.

Li Yinan, Zhang Xiongwei, Zeng Li, et al. An Improved Monaural Speech Enhancement Algorithm Based on Sparse Dictionary Learning[J]. Journal of Signal Processing, 2014, 30(1): 44-50.(in Chinese)

[5] 孙林慧, 杨震. 基于数字驱动字典和稀疏表示的语音增强[J]. 信号处理, 2011, 27(12): 1793-1800.

Sun Linhui, Yang Zhen. Speech enhancement based on data-driven dictionary and sparse representation[J]. Signal Processing, 2011, 27(12): 1793-1800.(in Chinese)

[6] Aharon M, Elad M, Bruckstein A. K-SVD: An algorithm for designing overcomplete dictionaries for sparse representation[J]. IEEE Transactions on Signal Processing, 2006, 54(11): 4311- 4322.

[7] Gowreesunker B V, Tewfik A H. Learning Sparse Representation Using Iterative Subspace Identification[J]. IEEE Transactions on Signal Processing, 2010, 58(6): 3055-3065.

[8] Sun L, Xie K, Gu T, et al. Joint dictionary learning using a new optimization method for single-channel blind source separation[J]. Speech Communication, 2019, 106: 85-94.

[9] Islam M, Zhu Y, Hossain M I, et al. Supervised single channel dual domains speech enhancement using sparse non-negative matrix factorization[J]. Digital Signal Processing, 2020, 100:102697.

[10] Sigg C D, Dikk T, Buhmann J M. Speech enhancement using generative dictionary learning[J]. IEEE Transactions on Audio, Speech and Language Processing, 2012, 20(6): 1698-1712.

[11] Mohammadiha N, Smaragdis P, Leijon A. Supervised and Unsupervised Speech Enhancement Using Nonnegative Matrix Factorization[J]. IEEE Transactions on Audio Speech & Language Processing, 2017, 21(10): 2140-2151.

[12] Baby D, Virtanen T, Gemmeke J F, et al. Coupled Dictionaries for Exemplar-Based Speech Enhancement and Automatic Speech Recognition[J]. IEEE Transactions on Audio, Speech, and Language Processing, 2015, 23(11): 1788-1799.

[13] Sprechmann P, Bronstein A, Bronstein M, et al. Learnable low rank sparse models for speech denoising[C]∥2013 IEEE International Conference on Acoustics, Speech and Signal Processing, IEEE, 2013.

[14] Zhang L, Bao G, Luo Y, et al. Monaural speech enhancement using joint dictionary learning with cross-coherence penalties[C]∥International Symposium on Computational Intelligence & Design, IEEE, 2016.

[15] Zhang L, Bao G, Zhang J, et al. Supervised single-channel speech enhancement using ratio mask with joint dictionary learning[J]. Speech Communication, 2016, 82: 38-52.

[16] 贾海蓉, 王卫梅, 王雁, 等. 区分性联合稀疏字典交替优化的语音增强[J]. 西安电子科技大学学报, 2019, 46(3): 74- 81.

Jia Hairong, Wang Weimei, Wang Yan, et al. Speech enhancement based on discriminative joint sparse dictionary alternate optimization[J]. Journal of Xidian University, 2019, 46(3): 74- 81.(in Chinese)

[17] Bao G, Xu Y, Xu X, et al. Learning a hierarchical dictionary for single-channel speech separation[C]∥Statistical Signal Processing, IEEE, 2014.

[18] 蒋茂松, 王冬霞, 牛芳琳, 等. 稀疏正则非负矩阵分解的语音增强算法[J]. 计算机应用, 2018, 38(4): 1176-1180.

Jiang Maosong, Wang Dongxia, Niu Fanglin, et al. Speech enhancement algorithm for sparse regular non-negative matrix factorization [J]. Computer Applications, 2018, 38(4): 1176-1180.(in Chinese)

[19] 苏敏. 低信噪比环境下语音增强及相关技术研究[D]. 南京:南京邮电大学, 2018.

Su Min. Speech enhancement and related technology research in low SNR environment [D]. Nanjing: Nanjing University of Posts and Telecommunications, 2018.(in Chinese)