1 引言

为了在沉浸式系统得到更好的听觉体验,空间声重放至关重要[1]。空间声重放分为方向性声源再现与扩散环境声源再现,即所谓的相干声再现与环境声再现。相干声代表通道间相关信号,听者可以感受到是从特定方向发出的,比如歌曲中的人声;环境声代表通道间不相关的信号,听者不能感受到确定方向,比如鼓掌声、欢呼声等。相干声与环境声的感知不同,因此需要对这两种成分进行不同的渲染处理,使得内容的重现不仅能够兼容各个重放系统,而且能够达到最佳的重放效果。然而,目前存在的音频格式通常是相干声与环境声混合录制或存储的[2]。为了实现准确灵活的空间声重放,相干声与环境声的提取(Primary-Ambient Extraction, PAE)显得尤为重要[3-9]。

迄今为止,已经提出了多种相干声与环境声提取方法。Faller提出的最小二乘法(Least-Squares, LS)[10]通过最小均方误差提取相干声与环境声,并将提取的各个成分重新合成音频信号,以实现多通道扬声器系统重放。最小二乘法提取的环境声具有统计独立性,因此无需使用人工混响器对环境声进行去相关处理。由Goodwin提出的主成分分析法(Principal Component Analysis, PCA)[11-12]在相干声与环境声提取中得到广泛应用。此方法通过计算通道间的相关值估计输入信号的相关成分作为相干声,剩余的不相关成分作为环境声。然而,传统的主成分分析法在没有明显相干声存在的情况下,会将部分环境声误判为相干声。对其进行修正,使用加权因子判断相干声是否存在之后进行提取[13],以提高提取各个成分的准确性。除以上两种方法外,Avendano和Jot使用时频掩蔽的方法(下文简称掩蔽法)[14-15]实现了在立体声信号中提取环境声成分。此方法利用通道间的自相关和互相关估计环境声掩蔽值,通过各自通道的输入信号与环境声掩蔽值提取环境声,并将剩余成分作为相干声。何建军等人利用相干声的稀疏性估计环境声相位(Ambient Phase Estimation with a Sparsity constraint, APES)[16],实现相干声与环境声的提取。

不同方法的提取效果可以通过客观指标和主观测听进行对比。客观对比可以使用提取误差作为评估指标,即用不同方法对混合录制信号进行提取,并将提取结果与实际成分对比,求出误差值。提取误差与原始信号的比值(Error-to-Signal Ratio, ESR, 单位dB)越小提取效果越好[16-17]。此外,亦可通过计算提取各个成分的通道间相关值(Inter-channel Cross Correlation, ICC)判定提取性能。相干声的通道间相关值越大提取效果越好,环境声的通道间相关值越小提取效果越好[18]。主观测听时,可直接对提取成分进行测听,亦可将提取成分用于不同数量扬声器重放或耳机重放。

一般来说,主观测听更接近实用场景,更具说服力。因此不同方法的提取效果可以通过主观测听证实。但是主观测听耗时长、效率低,而客观指标仅需计算获得,评估效率高。因此探究客观评价与主观测听的关联性[1],可以实现通过客观指标反映主观评价,有利于优化算法、提高效率、保证算法评估的可靠性。

本文针对相干声与环境声的提取,选择最小二乘法[10]、主成分分析法[11]、掩蔽法[14-15]和环境声相位估计法[16]进行客观评估、主观评估及主客观关联研究。内容安排如下:第2节具体介绍了信号模型以及四种相干声与环境声分离方法;第3节对四种方法提取成分的提取误差值和通道间相关值两项指标进行了客观评估;第4节将四种方法的提取成分应用于双耳渲染,并对渲染后的音质和声像宽度进行了主观评估;第5节给出了主客观评估结果的关联性分析。

2 信号模型及方法介绍

2.1 信号模型

在相干声与环境声的提取算法中,通常将每个通道的输入信号表示为相干声与环境声的叠加。根据相干声与环境声的特性,假设通道间的相干声是完全相关的,相干声与每个通道的环境声以及通道间的环境声均是不相关的。时域输入信号xL(n)、xR(n)定义为:

xL(n)=pL(n)+aL(n)xR(n)=pR(n)+aR(n)

(1)

其中pL(n)、pR(n)分别表示左右通道的相干声成分,aL(n)、aR(n)分别表示左右通道的环境声成分。由于pL(n)与pR(n)是完全相关的,因此pR(n)可由pL(n)线性表示。记pL(n)=s(n),则pR(n)=β(n)s(n),其中s(n)表示相干声成分,β(n)表示左右通道相干声成分的幅度差异因子。此时,式(1)可以表示为:

xL(n)=s(n)+aL(n)

xR(n)=β(n)s(n)+aR(n)

(2)

为了能更好地应用在非平稳状态以及多个声源同时存在的场景,通常需要将信号模型转换至短时傅里叶变换域中处理,必要时可进行子带分解。本文所介绍的提取方法均是在傅里叶变换域中完成。输入信号在傅里叶变换域中表示为:

XL(i,k)=S(i,k)+AL(i,k)

XR(i,k)=Β(i,k)S(i,k)+AR(i,k)

(3)

其中i表示时间帧索引,k表示频点索引。为了简洁,不必要时可省去(i,k)。在已知输入立体声信号XL和XR的情况下,估计参数S、Β、AL和AR便可完成相干声与环境声的提取。输入信号XL的短时能量估计为:![]() 其中E{·}表示期望。输入信号XR使用同样的方法得到其短时能量,即PXR。假设式(3)中左右通道的环境声具有相同的短时能量,记为PA,相干声的短时能量记为PS。结合相关假设,式(3)可以表示为:

其中E{·}表示期望。输入信号XR使用同样的方法得到其短时能量,即PXR。假设式(3)中左右通道的环境声具有相同的短时能量,记为PA,相干声的短时能量记为PS。结合相关假设,式(3)可以表示为:

PXL=PS+PA

PXR=Β2PS+PA

(4)

2.2 四种提取方法介绍

2.2.1 最小二乘法

最小二乘法(Least-Squares, LS)[10]利用输入信号估计提取成分,当估计误差与输入信号不相关时为最优估计,结合模型假设求出估计权重,完成提取。

首先定义输入信号的归一化通道间互相关系数:

(5)

将式(3)代入式(5)中并结合信号模型中的假设,可得:

(6)

式(4)和式(6)中,Β、PS和PA是关于PXL、PXR和Φ的函数,因此可以得到Β、PS和PA:

(7)

其中,

(8)

接下来以估计相干声S为例,对用于相干声与环境声分离的最小二乘方法展开介绍。相干声S的估计可以表示为:

![]()

wL(S+AL)+wR(ΒS+AR)

(9)

其中,wL和wR表示待求的估计权重。S的估计误差σS表示为:

![]()

(1-wL-wRΒ)S-wLAL-wRAR

(10)

在最小二乘算法中,当估计误差与输入立体声信号完全不相关时,得到的权重为最优估计,即:

E{σSXL}=0

E{σSXR}=0

(11)

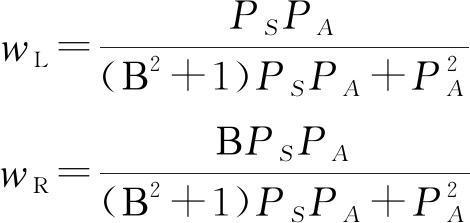

此时,最优估计为:

(12)

在式(7)中,PS、PA及Β均已得出,因此可以计算出权重wL和wR,便可完成使用输入信号对相干声成分的估计,同样的方法可以估计左右通道的环境声成分。

2.2.2 主成分分析法

主成分分析法(Principal Component Analysis, PCA)[11]根据两个通道的相关性提取出输入信号的相关成分作为相干声,剩余不相关的成分作为环境声。

将输入信号变换至短时傅里叶变换域内并定义向量:

XL(i,k)=[XL(i,k),XL(i-1,k),…]T

(13)

以同样的方式对式(3)中的其他参数进行向量表示,且假设相干声向量对应的单位向量为V,即:

XL=ρLV+AL

XR=ρRV+AR

(14)

其中ρL、ρR表示将输入信号投影至单位向量V上的幅度。

输入信号可以用矩阵X表示,即

X=[XL,XR]H

(15)

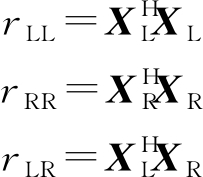

通过矩阵分析,输入信号的协方差矩阵XXH的最大特征值对应的特征矢量即为所要求的单位向量V。此最大特征值可通过输入信号的自相关和互相关直接求出[11]。输入信号的自相关和互相关定义为:

(16)

输入信号的协方差矩阵的最大特征值为:

(17)

因此,单位向量V为:

V=rLRXL+(λ-rLL)XR

(18)

当求出单位向量V,将输入信号在单位向量V上做投影便可求出ρL、ρR。由单位向量V和ρL、ρR便可得到所需提取的相干声,输入信号中剩余部分即为环境声。

2.2.3 掩蔽法

掩蔽法[14-15]中,只要求出掩蔽值即可完成提取。左通道的环境声由左通道的输入信号以及左通道环境声掩蔽值求得,右通道亦然,即:

AL=αLXL

AR=αRXR

(19)

其中环境声提取掩蔽值αL、αR是与输入信号的自相关和互相关有关的量。为了实现提取,限制αL、αR为正实数。在式(4)中已假设各个通道环境声具有相同的能量,且记为PA。于时,式(16)可以转化为:

(20)

其中,PA在式(7)中已求。因此得到掩蔽值αL、αR,可以完成从输入信号中提取环境声成分。将输入信号的剩余成分作为相干声成分,即可完成提取。

2.2.4 环境声相位估计法

何建军等人通过探索不相关的环境声的性质完成相干声与环境声的提取,即环境声相位估计法(Ambient Phase Estimation with a Sparsity constraint, APES)[16]。该方法是通过模型及假设,探究出环境声相位存在着约束关系,并利用相干声的稀疏性估计环境声相位,完成成分提取。

假设环境声在各个通道具有相同的能量,即可假设环境声幅度相同:

AL=|A|FL

AR=|A|FR

(21)

其中,

FL=ejθL

FR=ejθR

(22)

式中,θL、θR分别表示左右通道环境声的相位角。将式(21)带入式(3)中,可得:

(23)

由于|A|是非负实数,因此可以得出左右通道的环境声相位存在以下约束关系:

(24)

其中,θ表示XR-ΒXL所对应的相位角。Β在式(7)中已经求得,因此在式(23)中,输入信号XL、XR和幅度差异因子Β均已确定,当求出θL与θR中的一个,便可完成相干声与环境声的提取。由于相干声具有稀疏性,这一特性在许多语音和音乐信号中得到了广泛的应用。因此,可利用相干声的稀疏性确定一个环境声相位(θL、θR均可,本文以确定θL为例),即:

(25)

式(25)中的目标函数是非凸的,本文使用离散寻优的方法确定θL。由于θL的范围在区间(-π,π]内,离散的相位值定义为:

(26)

其中d∈{1,2,…,D},D是离散相位值总数,本文D=100。在确定个数的离散相位值中,选取使得相干声成分幅度最小的相位值作为θL。根据θL依次确定θR、AL、AR以及S,完成相干声与环境声的提取。

3 客观对比

3.1 提取误差ESR对比

3.1.1 ESR对比方法

将完全相关的相干声与完全不相关的环境声按照一定比例合成混合立体声信号,使用不同PAE方法进行提取。将提取出的相干声、环境声分别与合成混合立体声信号使用的原始相干声、环境声做差,计算提取误差[16]。

在对比提取误差的过程中,使用了两组混合输入信号,分别是纯净语音作为相干声、海浪声作为环境声的混合信号(记为混合信号1)以及纯净音乐声作为相干声、森林环境声作为环境声的混合信号(记为混合信号2)。使用的原始相干声、环境声的采样率均为44.1 kHz。为了得到完全相关的相干声,立体声的左通道相干声pL为单通道纯净语音或纯净音乐,右通道相干声pR是通过左通道相干声幅度放大β倍得到的。将单通道海浪声或森林环境声作为左通道环境声aL。为了达到环境声完全不相关的目的,使用带有随机相位的全通滤波器对环境声进行去相关处理,得到右通道的环境声aR。将完全相关的相干声与去相关处理后的环境声按照特定的相干声能量占比混合。相干声能量占比(Primary Power Ratio, PPR)定义为相干声能量与总能量的比值[16],记为γ,即:

(27)

混合时,相干声幅度差异β取值分别为1、2,相干声能量占比γ取值为0.05至0.95(间隔为0.1)。

对合成的多组混合信号,使用四种提取方法进行提取。选用误差信号比(Error-to-Signal Ratio, ESR,单位dB)[16]作为评判提取误差的标准,记为ε,即:

(28)

由于本实验的目的是探究各个提取方法在通道间相干声存在不同幅度差异以及混合信号存在不同相干声能量占比时的准确度,因此在合成混合信号时,原始相干声能量不能过低。本实验选取了10帧(每帧长度为4096个采样点)能量较高的相干声对应的混合信号进行提取并计算ESR的平均值。

3.1.2 ESR对比结果

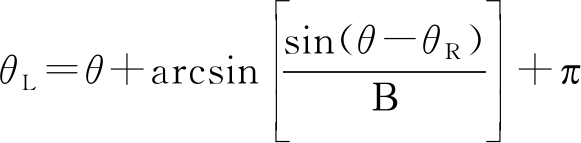

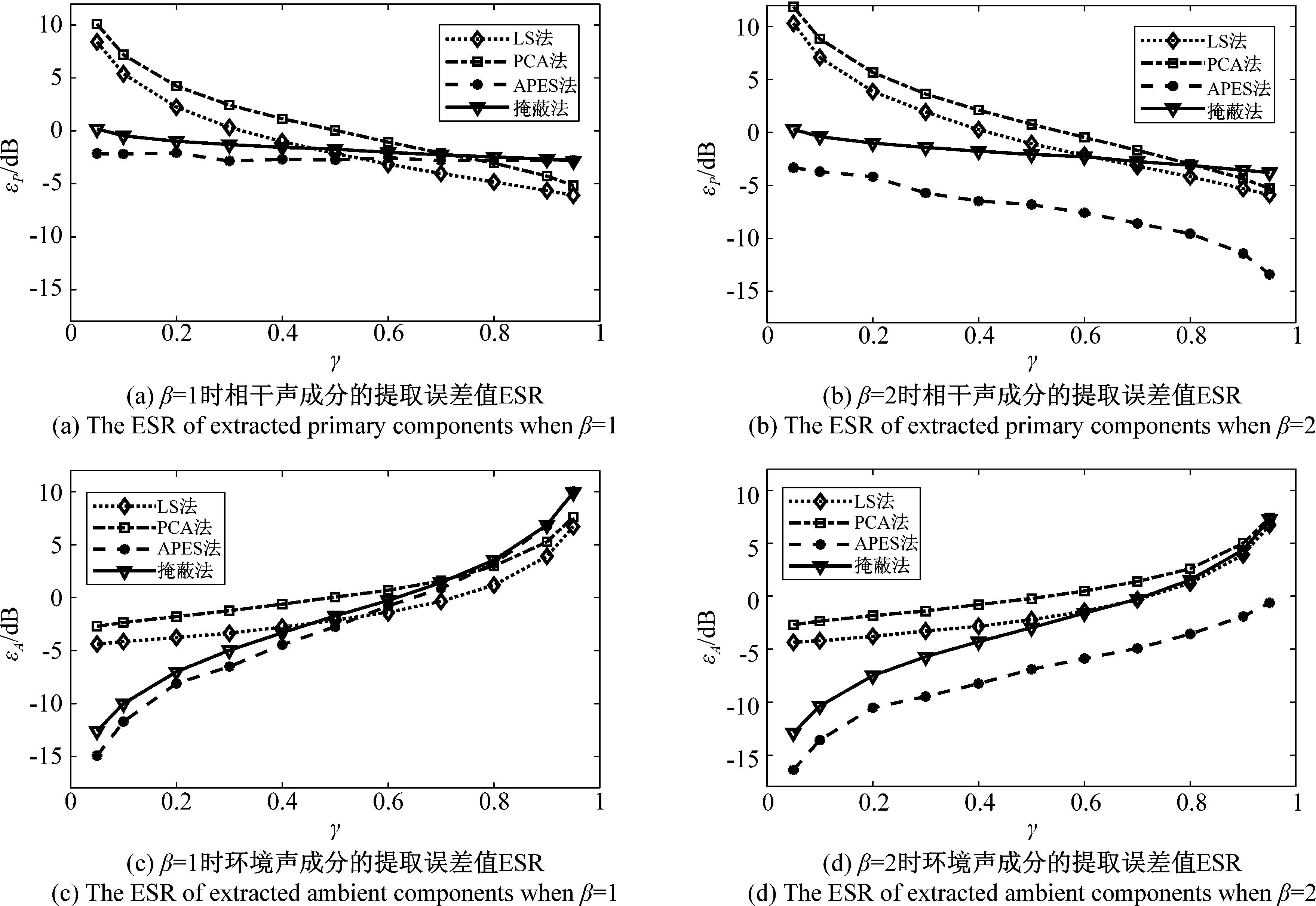

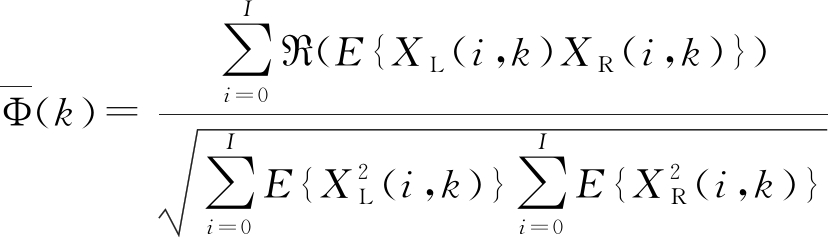

图1和图2分别给出了不同β和γ情况下,四种方法对混合信号1、混合信号2的提取结果。可以看出,当通道间的相干声存在着幅度较大差异(即β=2)以及相干声能量相当且占比较小(即β=1且γ<0.5)时,无论是相干声还是环境声APES的提取误差均是最小的。掩蔽法提取误差次之,LS法和PCA法的提取误差较大。其次,当两通道能量相当(β=1)且相干声能量占比较大(即γ>0.7)时,LS法和PCA法的提取误差是最小的。由于实际录制、播放的立体声音频的主要内容(比如歌声、人声)的相关性较强,被认定为相干声,而少量用于烘托气氛、增加沉浸感的成分相关性较弱,被认定为环境声。也就是说,实际立体声音频一般均为相干声能量占比较大,而诸如混响、背景渲染声等环境声的能量占比较小。因此,针对大部分立体声音频中相干声能量占比较大的特点,可以得出对一般立体声音频LS法和PCA法提取相干声和环境声的提取误差最小。

图1 提取出混合信号1相干声、环境声的ESR值

Fig.1 The ESR of the primary and ambient components extracted from the mixed audio 1

图2 提取出混合信号2相干声、环境声的ESR值

Fig.2 The ESR of the primary and ambient components extracted from the mixed audio 2

3.2 通道间相关值ICC对比

3.2.1 ICC评估方法

在空间声重放中,通常使用相干声与环境声的提取方法,将提取的相关成分和不相关成分用于不同的渲染处理。因此,为了进一步探究影响主观测听的客观指标,本文通过计算提取相干声与环境声的相关性对比提取效果。提取出相干声成分的相关性越强,提取效果越好。提取出环境声成分的相关性越弱,提取效果越好。针对通道间的相关性(Inter-channel Cross Correlation,ICC)评估,有两种评估方法[18]。其一是逐个频点计算通道间相关值Φ,计算公式同式(6),此时通道间相关值是关于时间、频率的函数。其二是将Φ在时间上求平均,得到通道间相关值关于频率的函数![]() 计算公式为:

计算公式为:

(29)

其中,I表示输入信号总帧数,R表示取实数。为了方便表述,将式(6)得到的Φ记为ICC的时频函数,将式(29)得到的![]() 记为ICC的频率函数。

记为ICC的频率函数。

3.1中的混合信号1、混合信号2均是按照不同相干声幅度比β以及不同相干声占比γ混合得到的多组信号。而在3.1.2中已分析出大多数立体声音频具有相干声占主要能量的特点,因此在对比ICC的实验中,选取β=1,γ=0.8 的混合信号1、混合信号2进行处理。本节中仅展示混合信号1的ICC对比结果,混合信号2的ICC对比结果和混合信号1类似,在这里不做过多展示。考虑到实际录制的立体声信号更具有实用价值,相比合成的混合信号,是检验PAE效果的更合适音频类型。实际录制的立体声信号由于没有原始相干声和环境声的素材,无法开展ESR的客观评估,但是可以开展ICC的客观评估。因此本节还对实际录制立体声音频进行了ICC评估,包括电影《霍比特人》中环绕人声、电影《地心引力》中机械环绕声、英语广播以及足球直播现场音频共四组音频,并展示了电影《霍比特人》中环绕人声的ICC对比结果。处理时,混合信号与实际录制立体声音频的长度均为7.3秒。

3.2.2 ICC对比结果

对所选取的混合信号和四组实际录制立体声音频使用四种提取方法依次提取相干声与环境声,并展示出混合信号1和电影《霍比特人》中环绕人声的原始信号的ICC以及提取成分ICC的时频函数值和频率函数值。

图3~图8显示了各个信号ICC的时频函数值,其色彩条状图给出了不同颜色对应ICC数值大小,即通道间相关性的大小。图3、图4和图5分别显示了混合信号1及四种方法对其提取的相干声、环境声的ICC时频分布。图3中颜色接近暗色的区域表示混合信号1在此时频段相关性较弱,这是由于合成混合信号时该时频段的相干声能量较低。与图3对比,图4(a)、图4(b)和4(d)的信号相关性增强,图4(c)信号相关性没有明显变化。图5(b)的信号非相关性明显增强,图5其他三幅图信号相关性无明显变化。

图3 混合信号1的ICC的时频函数值

Fig.3 The ICC as a function of time and frequency of the mixed audio 1

图4 提取出混合信号1的相干声ICC的时频函数值

Fig.4 The ICC as a function of time and frequency for the primary components extracted from the mixed audio 1

图5 提取出混合信号1的环境声ICC的时频函数值

Fig.5 The ICC as a function of time and frequency for the ambient components extracted from the mixed audio 1

图6 电影《霍比特人》的ICC的时频函数值

Fig.6 The ICC as a function of time and frequency of the audio in Hobbitt

同样,图6、图7和图8分别显示了电影《霍比特人》及四种方法对其提取的相干声、环境声的ICC时频分布。对比图6、图7和图8可以得到与提取混合信号1的分析结果相同的结论,在此不再赘述。

因此,可以得出:与原始混合信号相比,PCA法、APES法和LS法提取出的相干声的相关性明显增加,PCA法提取出环境声成分的非相关性明显增加。相比PCA法、掩蔽法和APES法,LS法提取的相干声更好地保留了原始信号的相关性,这与LS法的提取误差ESR值较小相吻合。掩蔽法在提取过程中会将部分相干声认定为环境声,提取误差较大。APES法提取的相干声几乎完全相关,但是提取的环境声的相关性较强。结合ESR的对比结果,APES法在通道间相干声差异较小且相干声能量占比较大时提取误差较大。本文通过非正式实验探究出APES法的提取误差主要来源是将部分相干声遗漏在环境声中,即虽然APES法提取的相干声相关性很强,但是提取相干声时并不彻底,会将部分相干声误判为环境声。

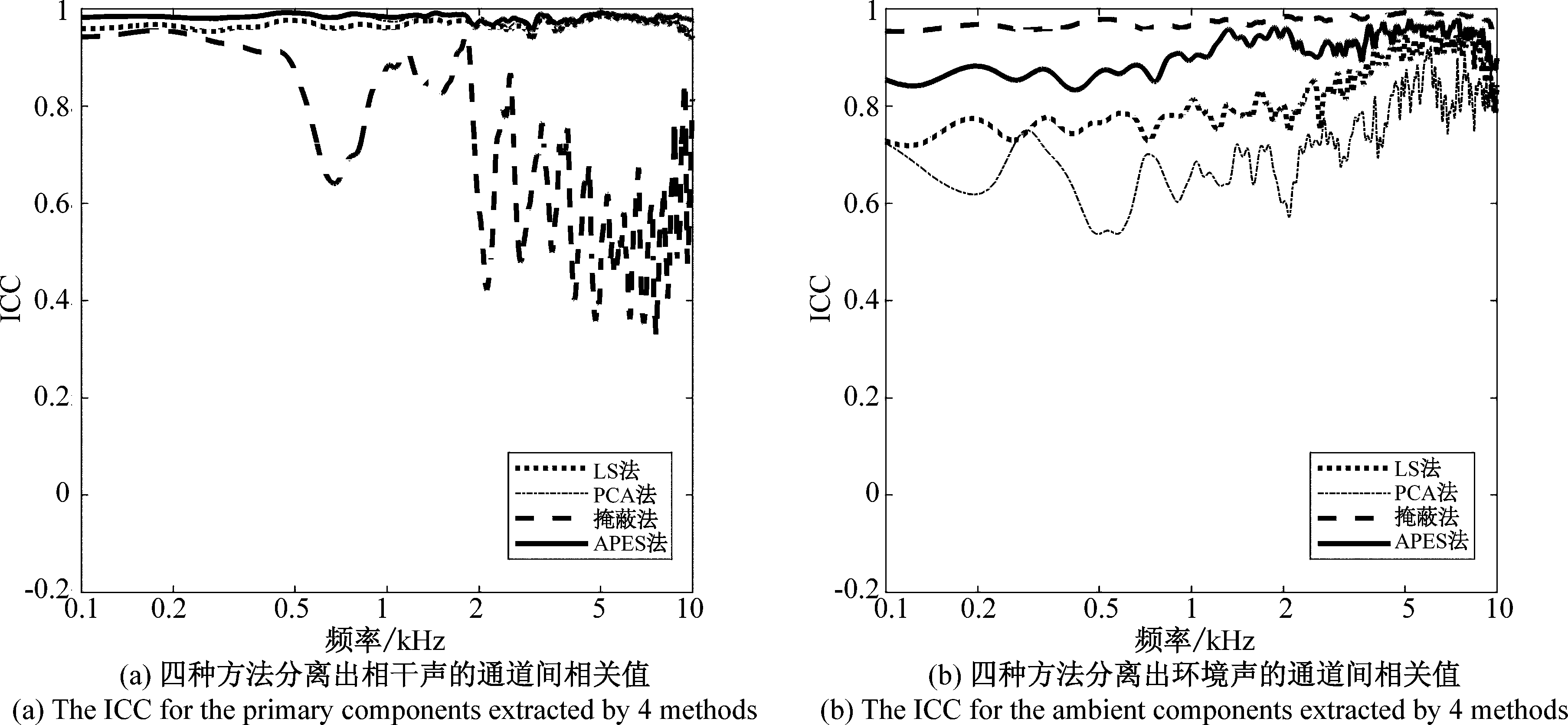

图9、图10分别显示了四种方法对混合信号1、电影《霍比特人》环绕人声提取的相干声、环境声ICC随频率的变化,此ICC是通过式(29)求得的。与图3~图8得到的ICC的时频函数相比,图9~图10的ICC频率分布可以直观、定量地看出不同方法处理后提取成分通道间相关值随频率的变化[18]。图9(a)中APES法提取相干声的ICC在各个频段均高于其他三者,图9(b)中PCA法和LS法提取环境声的ICC整体上低于其他两者。图10(a)中,APES法、PCA法以及LS法提取的相干声相关性均较强,掩蔽法提取的相干声相关性较弱。图10(b)中,PCA法、LS法、APES法、掩蔽法提取环境声的非相关性依次减弱。结合图3和图6可知,电影《霍比特人》环绕人声中相干声成分明显多于混合信号1中的相干声成分,即在此电影《霍比特人》环绕人声中相干声占比大于0.8。也就是说,相比混合信号1,电影《霍比特人》环绕人声更符合相干声占主要能量的条件且能量的时域分布更加均匀,因此图10更能看出不同方法处理后的ICC大小顺序。

图7 提取出电影《霍比特人》的相干声ICC的时频函数值

Fig.7 The ICC as a function of time and frequency for the primary components extracted from the audio in Hobbitt

图8 提取出电影《霍比特人》的环境声ICC的时频函数值

Fig.8 The ICC as a function of time and frequency for the ambient components extracted from the audio in Hobbitt

图9 提取出混合信号1的相干声、环境声ICC的频率函数值

Fig.9 The ICC as a function of frequency for the primary and ambient components extracted from the mixed audio 1

图10 提取出电影《霍比特人》的相干声、环境声ICC的频率函数值

Fig.10 The ICC as a function of frequency for the primary and ambient components extracted from the audio in Hobbitt

由以上得出,APES法提取相干声的相关性在整个频率范围内均最强,但是由于APES将部分相干声遗漏在环境声中,使得其提取的环境声的相关性不够弱;PCA法提取的相干声的相关性较强,且其提取出的环境声的非相关性在整个频率范围内均明显较强;LS法提取的相干声的相关性与PCA法相比接近,且其提取的环境声的非相关性仅低于PCA法。

4 主观对比

4.1 合成双耳声信号

将四种方法得到的相干声与环境声用于立体声向耳机声重放的转换系统中[18],通过主观测听进行结果评估。转换过程中,对相干声与环境声进行了不同的渲染处理,处理时基于人耳听觉模型划分子带。对于相干声,首先根据左右通道相干声的能量比例关系,计算出每个子带中相干声源的方向。然后根据MIT的头相关传输函数(Head Related Transfer Function, HRTF)数据库拟合出与此角度对应的双耳时间差(Interaural Time Difference, ITD)和双耳声级差(Interaural Level Difference, ILD)。按照所得的ITD和ILD对相干声进行幅度和相位修正,完成相干声成分的渲染。对于环境声,在不改变环境声成分能量的前提下,调整环境声的耳间相关性使其接近原始混响场的耳间相关性。这样可以在双耳渲染中将环境声处理的更自然[18-19]。最终通过主观测听对四种相干声与环境声提取方法用于此系统的音质和声像宽度进行评估。

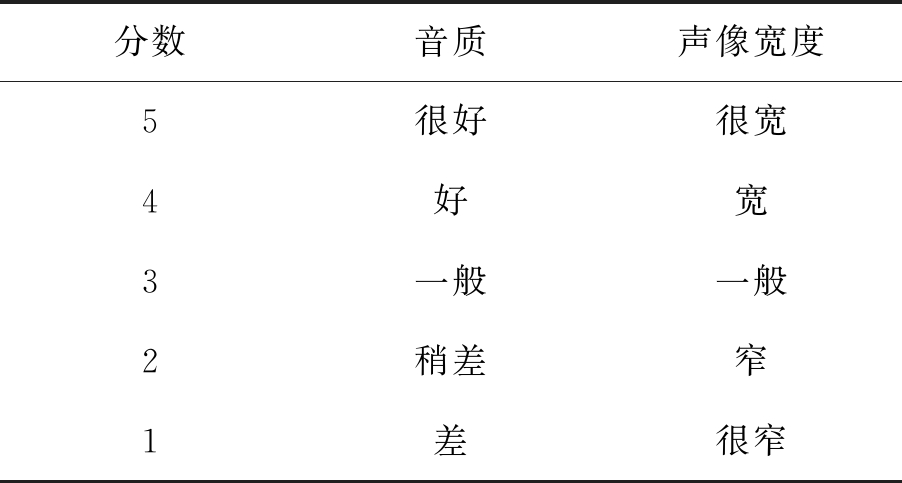

合成的混合信号左右通道相干声幅度差异为常数,即混合信号仅存在固定声像。因此,合成的混合信号不便于用于主观测听中对声像宽度的判断。考虑到实际录制的立体声信号更具实用价值,是检验PAE效果的最合适音频类型。因此主观测听中使用实际录制的四组立体声信号,包括电影《霍比特人》中环绕人声、电影《地心引力》中机械环绕声、英语广播以及足球直播现场音频共四组音频,长度均为10 s。以各项听力指标正常的人士(11男9女,年龄在22~35之间)作为受试者。将LS法、PCA法、掩蔽法以及APES法得到的相干声和环境声用于双耳渲染,并比较渲染后双耳声信号的音质和声像宽度。对应的音质和声像宽度的评分标准如表1所示。主观实验在测听室内进行,测试耳机型号为SennheiserHD380pro。正式测听实验开始之前,需要对受试者进行训练,使受试者熟悉实验流程。正式测听过程中,受试者每听完一组音频需要根据主观测听实验评分标准表对音质和声像宽度分别打分。针对四种PAE方法提取的各个成分用于双耳渲染的处理结果,将20名受试者对音质和声像宽度的评分和偏差均做平均处理,得到各个方法对应的音质和声像宽度的最终得分。打分时,以原始立体声作为参考,设定原始立体声音质为5分,声像宽度为3分。

表1 主观测听实验评分标准

Tab.1 Subjective listening experiment scoring criteria

分数音质声像宽度5很好很宽4好宽3一般一般2稍差窄1差很窄

4.2 客观对比结果

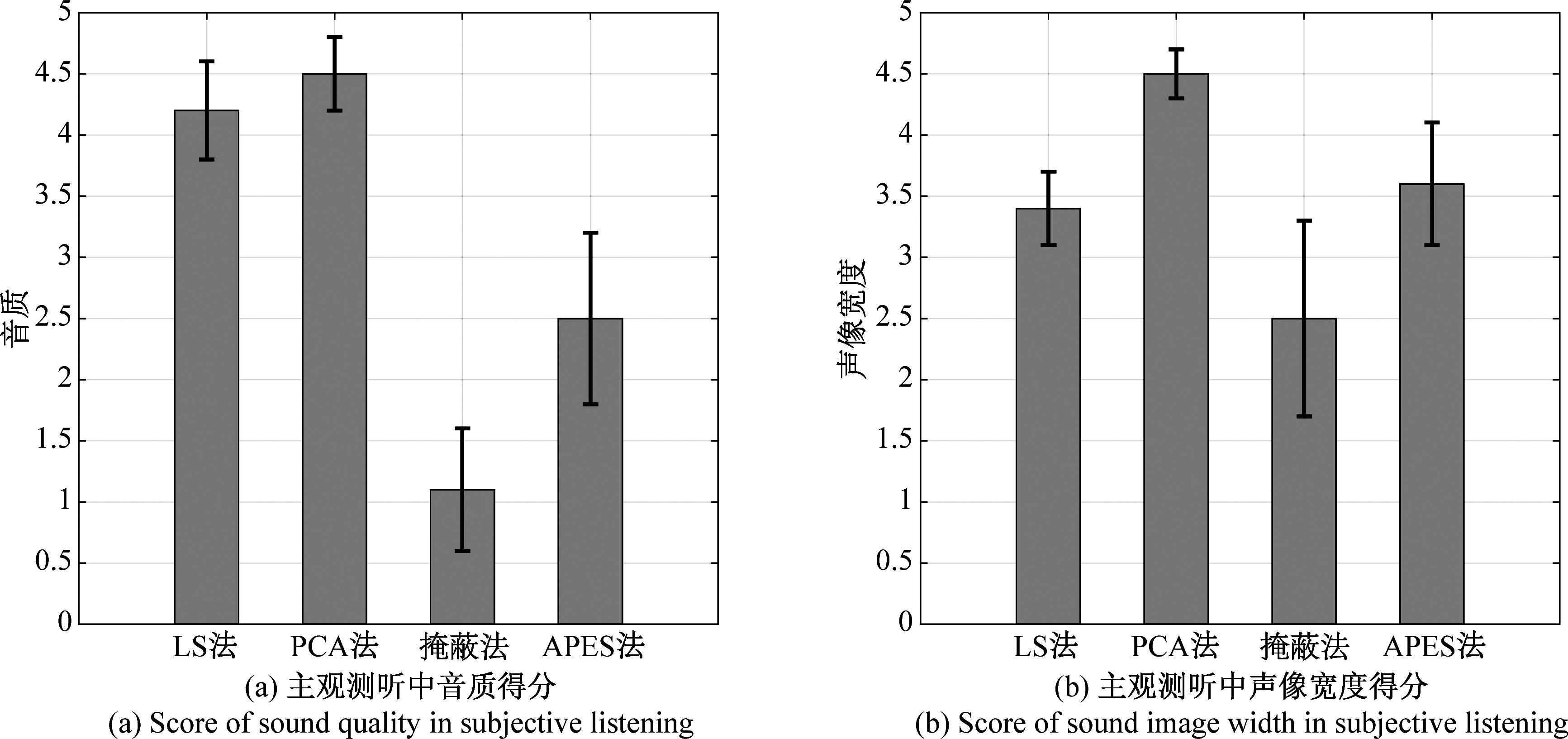

四种相干声与环境声提取方法用于双耳渲染系统中的测听结果如图11所示。

图11 主观测听中音质和声像宽度得分

Fig.11 The score of sound quality and image width in subjective listening

图11(a)和(b)分别是20名受试者对四组音频测听后对音质和声像宽度的打分结果。将不同方法提取的相干声与环境声用于双耳渲染后,音质和声像宽度得分有所差别。LS法和PCA法的提取成分,在双耳渲染中音质得分较高,且得分的均方差较小。LS法的提取成分在双耳渲染中声像宽度得分略低。PCA法的声像宽度得分最高。掩蔽法得到的音质最差,声像宽度得分一般。掩蔽法在ESR和ICC的客观对比中结果较差,将其提取成分用于双耳渲染后音质和声像宽度得分均较低亦是自然。APES法在声像宽度的评分中得分较高,但是其音质得分较低且偏差较大。APES法提取的成分用于双耳渲染中音质会受到影响,尤其是在英语广播这类相干声成分能量较高的音频。在ICC的客观评估中,已经得出APES法在相干声能量占比较大时会将部分相干声遗漏在环境声中,而双耳渲染处理时对环境声进行了模仿混响场的处理,由此影响了APES法提取成分用于双耳渲染的音质。

在客观对比中,当通道间相干声不存在幅度差异或幅度差异较小且相干声占比较大时,LS法和PCA法的提取误差较小。而主观测听中,LS法和PCA法在音质方面都得分较高。因此,可以得出,提高提取相干声的准确度,可以提高双耳渲染的音质。此外,客观对比中,除掩蔽法以外的三种方法得到的相干声的相关性相差不大,但是PCA法得到的环境声的非相关性明显强于其他三种。PCA在双耳渲染中可以得到更宽的声像宽度。因此,可以得出在双耳渲染中,环境声的非相关性利于拓宽声像宽度。

5 结论

本文针对相干声与环境声的提取,对比了最小二乘法、主成分分析法、掩蔽法和环境声相位估计法的提取效果。通过提取误差ESR以及提取出的各个成分的通道间相关值ICC进行评价对比,得出主成分分析法和最小二乘法在通道间相干声能量相当且相干声占主要能量时提取误差较小,且主成分分析法提取环境声的非相关性最强。双耳渲染的主观测听结果表明,最小二乘法和主成分分析法提取成分的音质较好,而主成分分析法提取成分的声像最宽。通过主客观评价对比,可以得出:提取相干声成分的误差较小时,在渲染中可得到更好的音质;环境声的去相关性与拓宽的声像宽度正向相关。

[1] He J J. Spatial audio reproduction with primary ambient extraction[M]. Springer Singapore, 2017.

[2] Avendano C, Jot J M. Ambience extraction and synthesis from stereo signals for multi-channel audio up-mix[C]∥2002 IEEE International Conference on Acoustics, Speech, and Signal Processing. IEEE, 2002: 1957-1960.

[3] Breebaart J, Schuijers E. Phantom Materialization: A Novel Method to Enhance Stereo Audio Reproduction on Headphones[J]. IEEE Transactions on Audio, Speech and Language Processing, 2008, 16(8): 1503-1511.

[4] Goodwin M M, Jot J M. Binaural 3-D audio rendering based on spatial audio scene coding[C]∥Audio Engineering Society Convention 123. Audio Engineering Society, 2007.

[5] Bai M R, Shih G Y. Upmixing and downmixing two-channel stereo audio for consumer electronics[J]. IEEE Transactions on Consumer Electronics, 2007, 53(3): 1011-1019.

[6] Jeon S W, Park Y C, Lee S P, et al. Robust representation of spatial sound in stereo-to-multichannel upmix[C]∥Audio Engineering Society Convention 128. Audio Engineering Society, 2010.

[7] Faller C, Breebaart J. Binaural reproduction of stereo signals using upmixing and diffuse rendering[C]∥Audio Engineering Society Convention 131. Audio Engineering Society, 2011.

[8] Gan W S, Tan E L, Kuo S M. Audio projection: Directional sound and its application in immersive communication[J]. IEEE Signal Processing Magazine, 2010, 28(1): 43-57.

[9] Kaushik S, He J J, Tan E L, et al. Natural sound rendering for headphones: integration of signal processing techniques[J]. IEEE Signal Processing Magazine, 2015, 32(2): 100-113.

[10] Faller C. Multiple-loudspeaker playback of stereo signals[J]. Journal of the Audio Engineering Society, 2006, 54(11): 1051-1064.

[11] Goodwin M M, Jot J M. Primary-ambient signal decomposition and vector-based localization for spatial audio coding and enhancement[C]∥2007 IEEE International Conference on Acoustics, Speech and Signal Processing-ICASSP. IEEE, 2007.

[12] Goodwin M M. Geometric signal decompositions for spatial audio enhancement[C]∥2008 IEEE International Conference on Acoustics, Speech and Signal Processing. IEEE, 2008: 409- 412.

[13] Ibrahim K M, Allam M. Primary-ambient extraction in audio signals using adaptive weighting and principal component analysis[C]∥Proceedings of the 13th Sound and Music Computing Conference, 2016: 227-232.

[14] Avendano C, Jot J M. A frequency-domain approach to multichannel upmix[J]. Journal of the Audio Engineering Society, 2004, 52(7/8): 740-749.

[15] Merimaa J, Goodwin M M, Jot J M. Correlation-based ambience extraction from stereo recordings[C]∥Audio Engineering Society Convention 123. Audio Engineering Society, 2007.

[16] He J, Gan W S, Tan E L. Primary-ambient extraction using ambient phase estimation with a sparsity constraint[J]. IEEE Signal Processing Letters, 2014, 22(8): 1127-1131.

[17] He J, Gan W S, Tan E L. Time-Shifting Based Primary-Ambient Extraction for Spatial Audio Reproduction[J]. IEEE Transactions on Audio Speech and Language Processing, 2015, 23(10): 1576-1588.

[18] Menzer F, Faller C. Stereo-to-binaural conversion using interaural coherence matching[C]∥Audio Engineering Society Convention 128. Audio Engineering Society, 2010.

[19] Menzer F, Faller C.Investigations on modeling BRIR tails with filtered and coherence-matched noise[C]∥Audio Engineering Society Convention 127.Audio Engineering Society, 2009.