Reference format: Ding Dazhi, Yang Jie, Yang Baojin, et al.Research on Recognition of Maritime Targets Based on the SBR Imaging Algorithm[J]. Journal of Signal Processing, 2020, 36(12): 1998-2006. DOI: 10.16798/j.issn.1003- 0530.2020.12.005.

对于沿海国家而言,海洋目标的探测和防御具有重要的战略意义。合成孔径雷达是一种主动式微波遥感器,可以保证全天候、全天时的主动工作状态,其图像分辨率不受载机飞行高度,工作波长的影响,非常适合应用在海洋目标探测的领域,目标检测与识别作为图像解译的关键一环对高分辨率的雷达图像有大量的需求。20世纪50年代,学者们提出了合成孔径雷达的概念,L.J.Cutrona[1]对SAR成像展开了系统的研究,并且通过实验获得SAR成像结果。随后,研究人员发现,对目标的逆合成孔径雷达(ISAR)成像能够获取其散射点的位置信息,ISAR成像技术得以飞速发展[2]。

随着SAR成像技术的成熟,利用SAR图像的自动识别技术也取得了进一步的发展。近年来,深度学习在图像识别、语音识别、自然语言处理等方面的出色表现,使得深度学习成为了应用在SAR图像自动识别技术方向的热点。美国麻省理工学院的林肯实验室在二十世纪八十年代中末期首先开展了SAR ATR(Automatic Target Reconition,ATR)的研究;MATAR联合美国多所研究所一起研究并且提供了目前SAR ATR算法测试的常用数据集[3]。对SAR图像的不同应用对其分辨率有着不同的要求,目前的机载SAR的分辨率为0.3 m,满足对飞机等目标进行检测、识别的要求[4]。根据林肯实验室提出的SAR ATR处理的三个流程:检测、鉴别和分类/识别,人们对合成孔径雷达的成像与目标识别做了大量研究[5- 8]。深度学习在遥感领域自2016年起快速发展,研究者们将深度学习应用到SAR图像的目标识别领域中。Du K等人利用卷积神经网络从MSTAR训练集中提取特征并且完成了目标识别的任务[9]。Malmgren-Hansen D等研究了在卷积神经网络平台与其他分类器上进行SAR图像目标识别的鲁棒性对比研究,证明卷积神经网络在SAR图像识别方面更具优势[10]。邵嘉琦将不同架构的卷积神经网络分别应用到SAR图像目标识别上,着重对比不同卷积神经网络模型对SAR图像目标识别的综合性能[11]。李建伟等人建立并公开了用于舰船目标检测的SAR图像数据集SSDD,并使用Faster RCNN目标检测算法完成对SAR图像中舰船目标的检测任务,取得较好的检测精度[12]。陈小龙等人利用经典的VGG16和ResNet101网络对目标进行特征提取,并对传统的Faster R-CNN加以改进,最终达到94.2%的平均检测精度[13]。

传统的SAR仿真图像或是ISAR仿真图像基于对一定频带范围和一定角度范围的回波数据进行逆傅里叶变换获得,因此需要计算大量不同频率和不同方位角下的单站回波数据,当目标为电大尺寸目标时计算困难。1989年Ling等第一次提出了弹跳射线法[14]。弹跳射线法结合了物理光学法(PO)和几何光学法(GO)的核心思想,将电磁波等效为一根根射线管,然后在射线的尽头根据PO的原理求出远场的积分,这样既解决了PO方法忽略目标表面各部件之间电磁流耦合作用的弊端,散射场空间的离散分布的问题也被很好地解决。本文针对以上问题,探究利用基于弹跳射线法(SBR)的快速成像技术构建舰船目标的SAR图像数据集,相对于传统成像方法成像效率显著提升。考虑到舰船目标在实际情景下的海面背景,将舰船目标的SAR图像与海面背景的SAR图像进行拼接生成任意海况下多种舰船目标的图像训练集。另外,传统的目标识别网络Faster RCNN识别准确率不高,为了增强SAR图像目标识别算法的检测性能,在Faster RCNN网络中加入特征金字塔结构(Feature pyramid networks,FPN),同时选用性能更为强大的深度残差网络Resnet-50作为特征提取网络来进一步提高检测识别性能,并通过具体的算例验证改进模型的有效性。

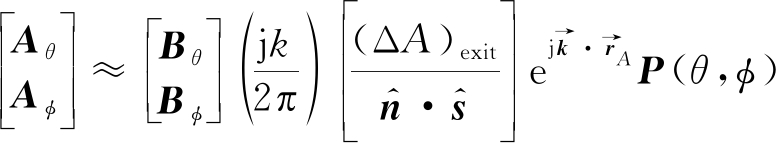

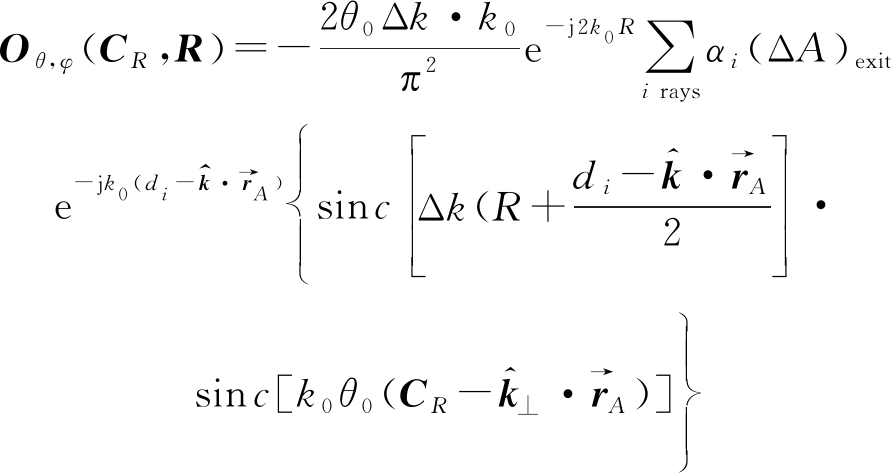

在SBR方法中,每根射线管对任意观测点(r,θ,φ)处的远区散射电场被描述为:

(1)

其中:

(2)

式中,![]() 为射线管离开目标表面的最后一次反射方向,

为射线管离开目标表面的最后一次反射方向,![]() 为观察方向,

为观察方向,![]() 为目标表面法向量,

为目标表面法向量,![]() 为(ΔA)exit的中心点A处的位置矢量。

为(ΔA)exit的中心点A处的位置矢量。![]() 处的电场和磁场为

处的电场和磁场为![]() 和

和![]()

假定平面波沿-z方向入射,观察方向位于φ=0°的平面内,在θ=0°的小角度范围内的散射场,如图1所示。在这一条件下cos θ≈1,sin θ≈θ,sin φ≈0,cos φ=1,在小角度近似下可以将Bθ,Bφ写成如下统一形式:

图1 双站ISAR成像

Fig.1 Bistatic ISAR imaging

Bθ=fe[-s1cos φE3-s2sin φE3+s3(cos φE1+sin φE2)]+

fh[s1(cos θsin φH3+sin θH2)+s2(-sin θH1-

cos θcos φH3)+s3(cos θcos φH2-cos θsin φH1)]

Bφ=fe[n1(cos θsin φE3+sin θE2)+n2(-sin θE1-

cos θcos φE3)+n3(cos θcos φE2-cos θsin φE1)]+

fh[n1cos φH3+n2sin φH3+n3(-cos φH1-sin φH2)]

Bθ,φ=(α+θβ)e-jkdi

(3)

(4)

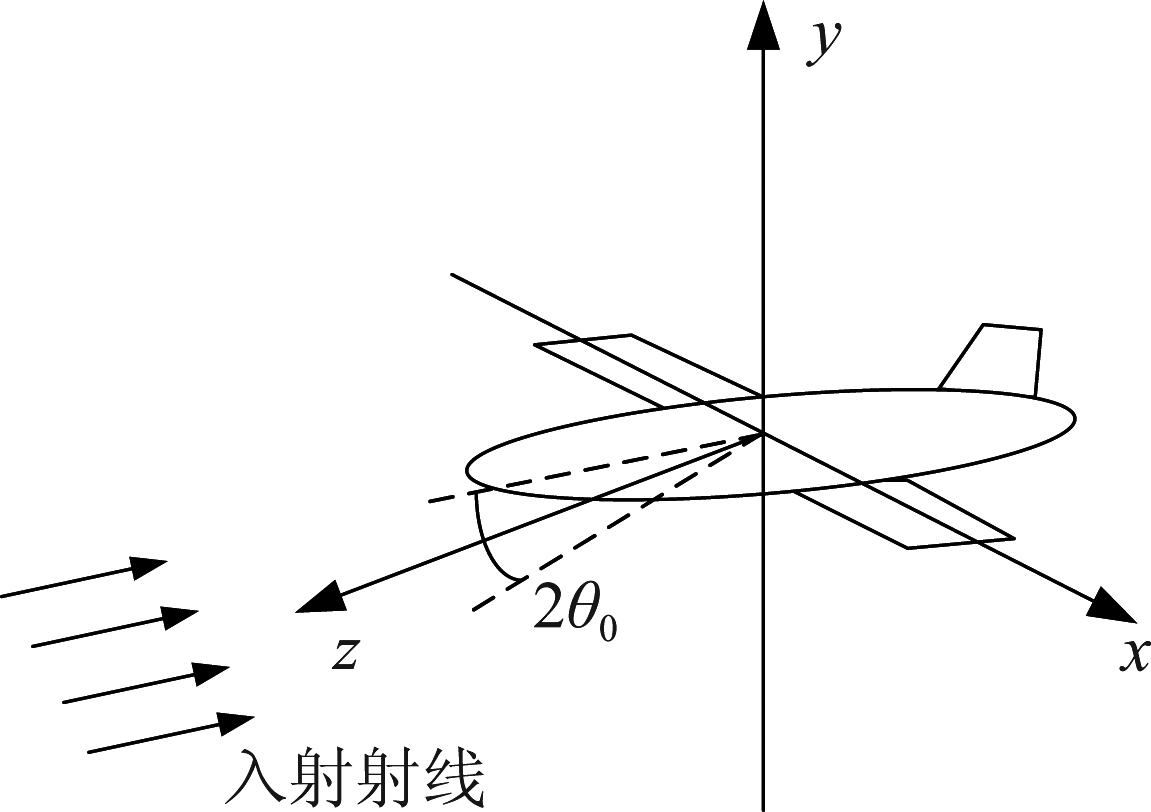

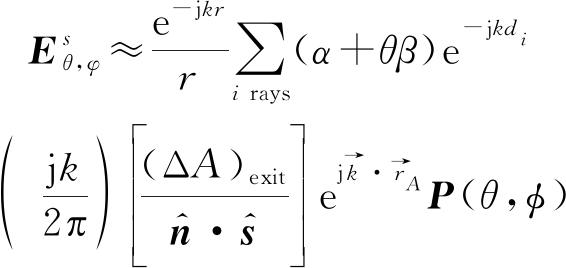

di为第i根射线从入射点到出射点之间的路径长度。则远区场可表示为:

(5)

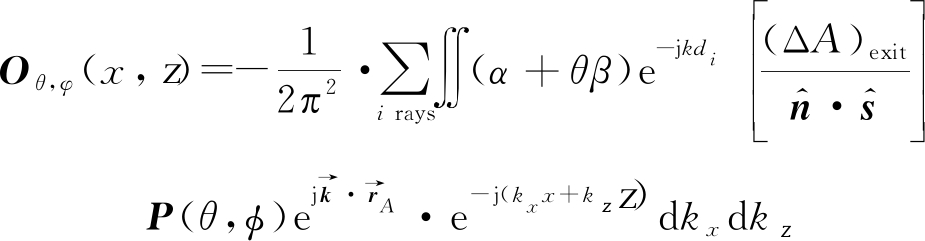

选取xoz平面为成像平面,二维成像公式为:

(6)

推广到任意角度、任意成像平面上的二维快速成像公式:

(7)

其中,![]() 和

和![]() 分别代表距离向和方位向上的坐标,

分别代表距离向和方位向上的坐标,![]() 为观察点波矢量,

为观察点波矢量,![]() 为与

为与![]() 垂直的单位矢量。

垂直的单位矢量。

高频计算方法相对于数值方法计算速度有了很大提升,但是考虑到海面以及电大尺寸目标在剖分后未知量个数将达到百万级,因此考虑利用GPU并行加速技术和MPI并行加速技术进一步减少计算时间。

弹跳射线法计算需要利用大量射线管进行射线追踪,这将耗费大量时间,考虑到弹跳射线法中每根射线的计算都是相对独立的,因此可以通过GPU并行进行加速计算。在GPU并行计算之前,首先在CPU读取剖分面元的信息,对这些面元数据进行八叉树分组,分组后的数据拷贝到GPU中,GPU将每个面元分配给一个线程计算。

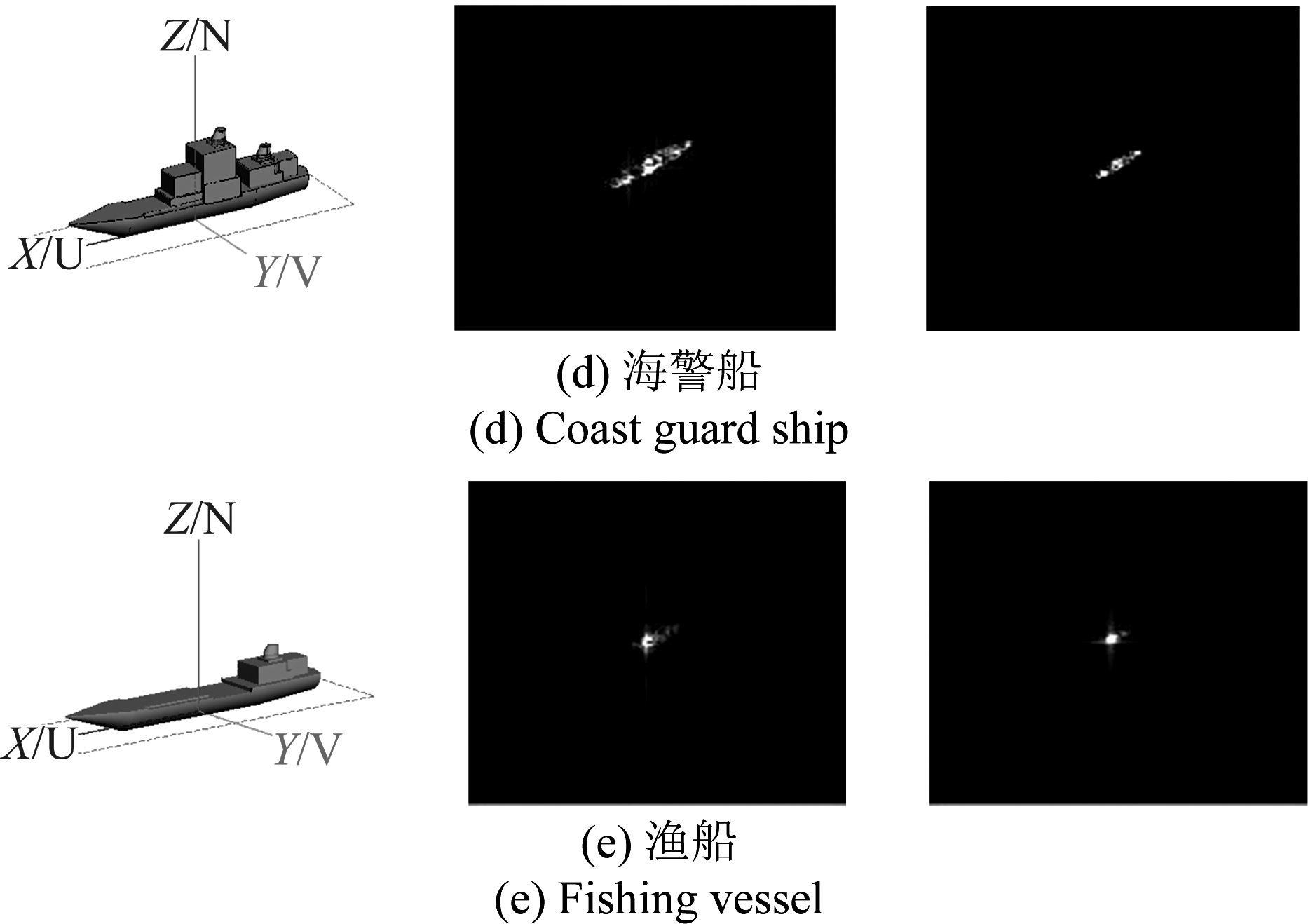

SAR图像舰船识别仿真数据集包含五种舰船目标,分别为伯克利驱逐舰(Burke class destroyer),朱姆沃尔特级驱逐舰(Zumwalt-class destroyer),航母(Aircraft carrier),海警船(Coast guard ship),渔船(Fishing vessel)。为获得不同观测角度、不同分辨率的舰船目标的SAR图像,使用基于SBR的快速成像技术对这五类舰船模型进行SAR图像仿真。图2为在入射波中心频率为10 GHz,分辨率分别为3 m,5 m时,部分观测角度的五类舰船目标的SAR仿真图像。

图2 五种类别舰船目标在3 m(左)、

5 m(右)分辨率时的SAR仿真图像

Fig.2 SAR simulation images with five kinds of ship targets at 3 m (left) and 5 m (right) resolutions

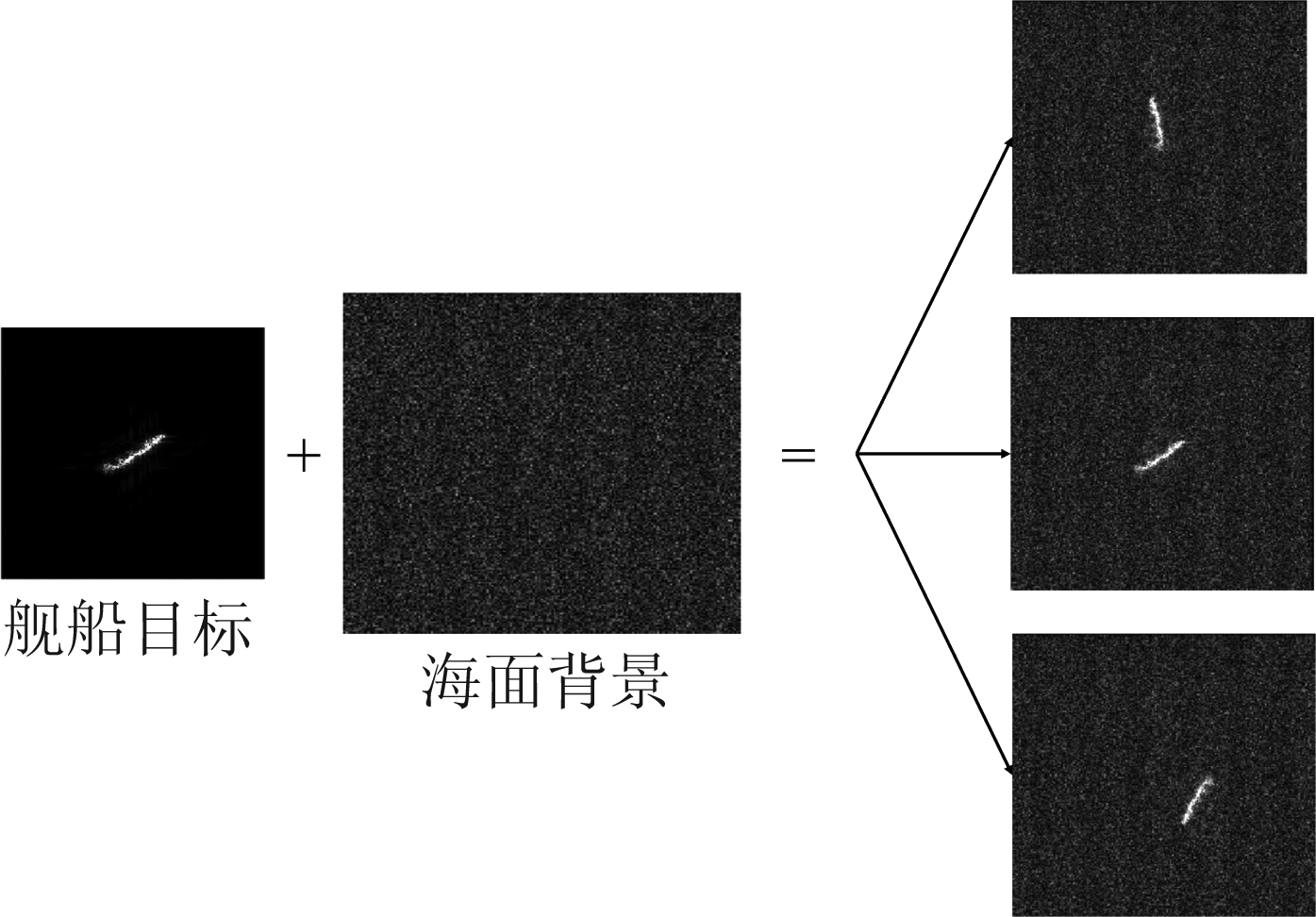

将选取的不同观察角、不同分辨率下的舰船目标SAR图像与不同海况下的海面SAR图像进行各种姿态合成[15],如图3所示。

图3 舰船目标及海面背景的合成

Fig.3 Synthesis of ship target and sea background

为了增加SAR图像舰船识别仿真数据集的真实性和多样性,在使用不同海况下的海面SAR图像作为背景的基础上,同时使用SSDD数据集中具有复杂背景的SAR图像作为背景与舰船目标SAR仿真图像进行各种姿态合成,如图4所示。

图4 SSDD数据集中海面背景与仿真舰船目标合成图

Fig.4 Composite image of sea background and simulated ship target in SSDD data set

训练目标检测网络时,需要知道SAR图像数据集中目标的类别信息和位置信息,所以需要使用标注软件来标注出SAR图像目标的类别信息和位置信息。本文使用开源标注软件LabelImag对SAR图像进行标注,使用该软件完成标注后,将生成包含SAR图像中所有目标的类别信息和位置信息的XML文件,其具体流程如图5所示。

图5 SAR图像标注示意图

Fig.5 Schematic diagram of SAR image annotation

通过上述步骤最终共获得917张标注的SAR图像,其中700张用于训练,217张用于测试。

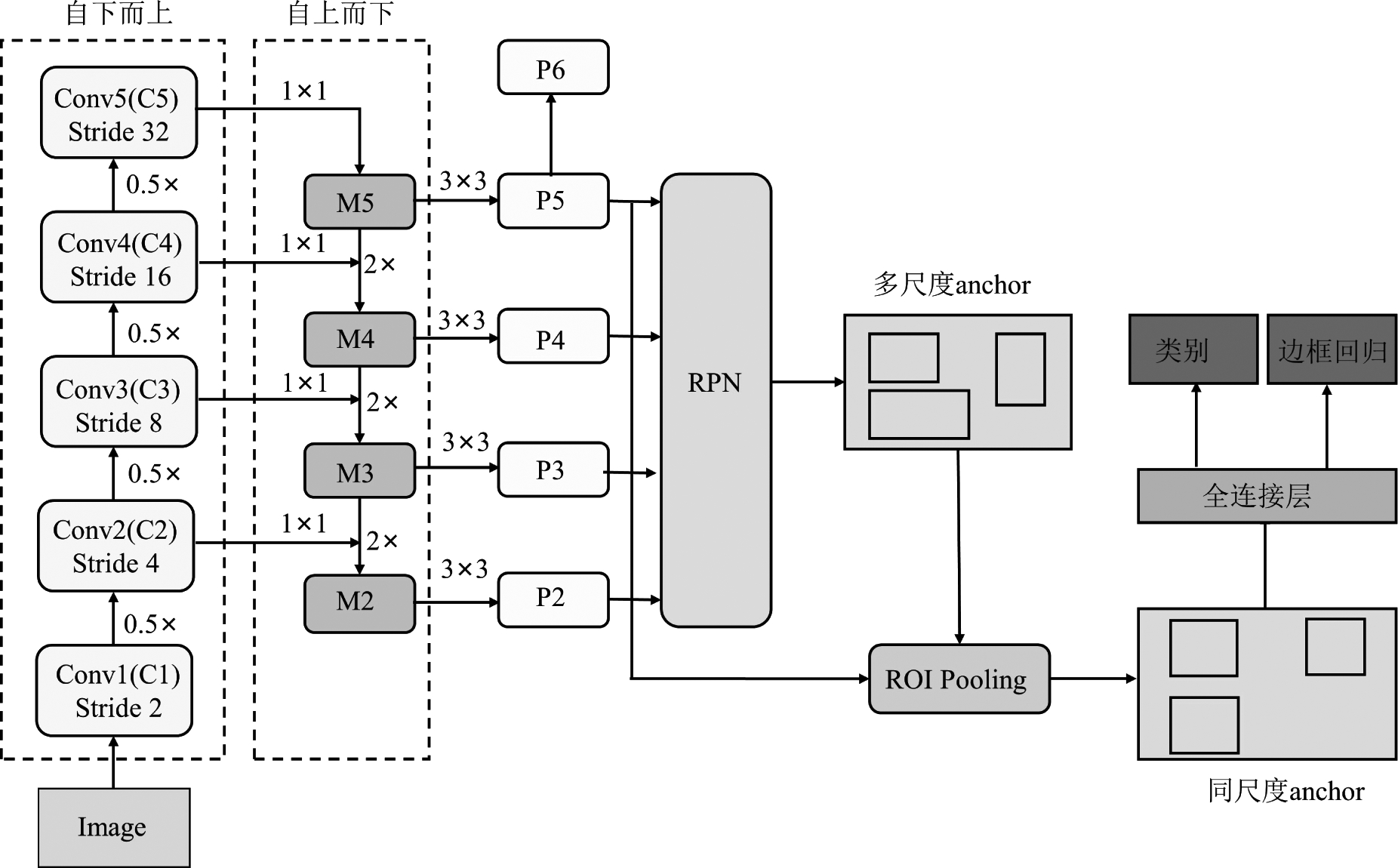

Faster RCNN是基于区域的深度卷积神经网络的目标检测算法。其目标检测分为两步,首先确定目标位置,其次确定目标的类别。输入一张SAR图像,Faster RCNN网络模型首先利用特征提取网络经过一系列的卷积、池化操作得到图像的特征图,然后区域建议网络(Region Proposal Network,简称RPN网络)利用特征图生成候选区域,并判别候选区域属于背景(不包含目标)还是前景(包含目标),同时通过位置回归参数调整候选区域的边界框,之后提供一些修正位置的建议区域送入Fast RCNN网络中训练,最终实现目标的类别识别和位置检测[16]。

传统Fast RCNN网络只利用了VGG16特征提取网络最深层的特征图,缺少较浅特征图中目标的局部细节、位置等信息。学者们基于以上想法产生了特征金字塔结构(FPN),FPN结构的核心思想为:将不同大小的卷积层进行跨层连接,连接后得到的卷积层融合了高层网络特征和底层网络特征,据此实现对不同尺度大小的目标的检测[17-18]。本文在Fast RCNN网络中首先对Anchor的初始尺寸利用K-means聚类算法改进,使得初始Anchor的生成尺寸更加拟合SAR图像中舰船尺寸的分布,解决了由于数据集差异导致训练中Anchor尺寸无法较好匹配SAR图像中舰船目标而引起的检测精度下降的问题;其次,融合不同的卷积层特征来提高对SAR图像中目标的检测效果,改进后的结构图如图6所示。

图6 基于FPN的Faster RCNN网络架构示意图

Fig.6 Schematic diagram of Faster RCNN network architecture based on FPN

网络工作的主要步骤:(1)首先对输入的SAR图像利用VGG神经网络架构进行特征提取;(2)其次通过RPN网络计算出可能存在目标的区域坐标并且将目标区域通过池化层得到其特征向量;(3)最后,将步骤一和步骤二得到的两个特征向量接入softmax实现目标的分类与定位。

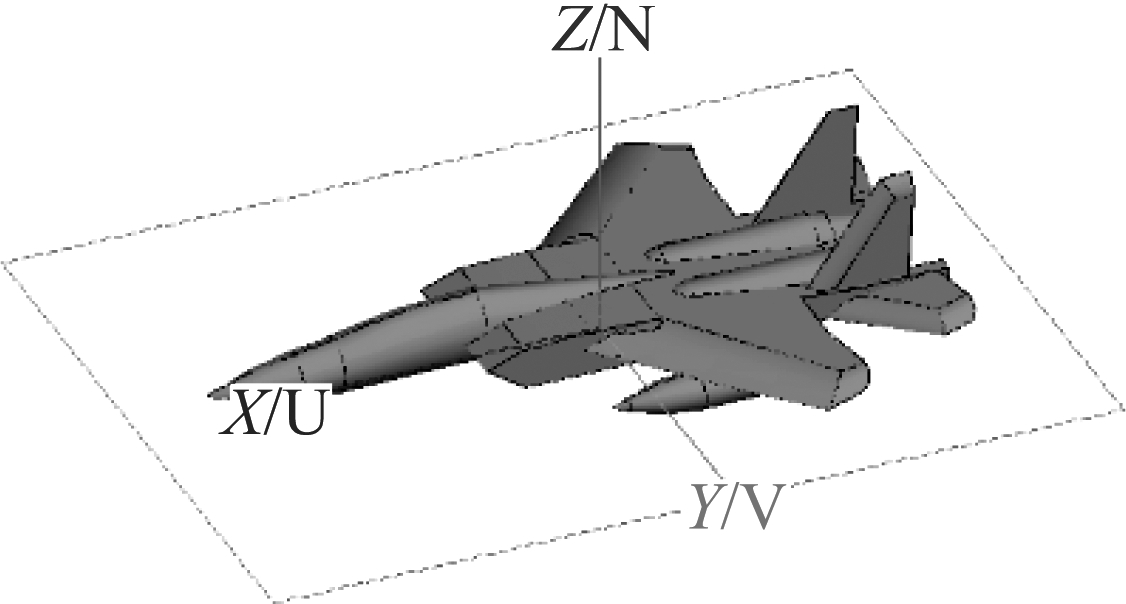

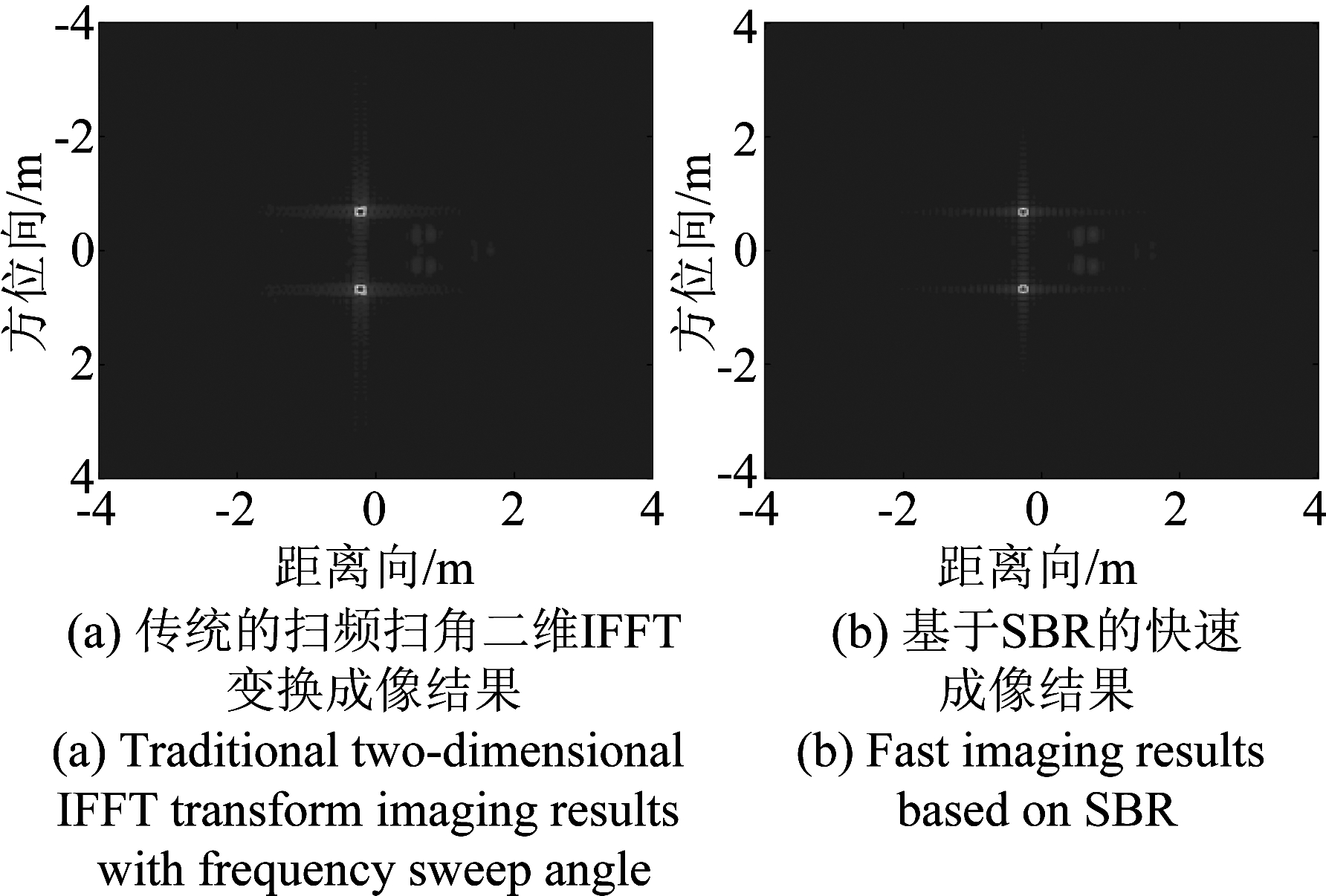

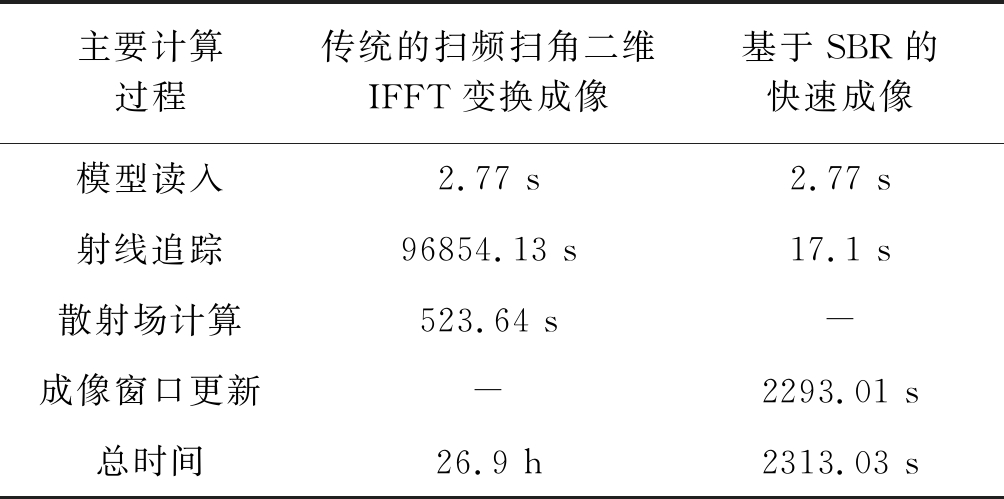

算例1 图7为缩比的F15飞机模型,分别用传统的扫频扫角二维IFFT变换成像方法和基于SBR的快速成像技术对其进行雷达图像仿真。缩比后的F15总长为3.7 m,翼展为2.6 m,入射波沿θ=90°,φ=0°方向入射,成像平面为xoy平面,成像窗口为8 m×8 m,距离向和方位向的分辨率分别设置为0.1 m和0.107 m。首先用传统的扫频扫角二维IFFT变换成像方法对模型进行成像,设置扫描频率为9.25 GHz到10.75 GHz共采样81个频点,单站扫描角度设置为-4°到4°采样81个角度,接着使用基于SBR的快速成像技术对模型进行成像,设置入射波中心频率为10 GHz,带宽为1.5 GHz,双站扫描角度设置为8°,对成像窗口进行256×256规格的网格划分。两种方法的成像结果如图8所示。

图7 F15飞机模型

Fig.7 F15 aircraft model

图8 F15模型仿真雷达图像对比

Fig.8 Comparison of F15 model simulation radar images

图8中的 (a)和(b)可以看出两种成像方法的成像结果吻合良好,表明使用快速成像技术后的成像时间由26.9 h下降到2313.03 s,成像速度大幅提高。

表1 不同成像方法计算时间对比

Tab.1 Comparison of calculation time of different imaging methods

主要计算过程传统的扫频扫角二维IFFT变换成像基于SBR的快速成像模型读入2.77 s2.77 s射线追踪96854.13 s17.1 s散射场计算523.64 s-成像窗口更新-2293.01 s总时间26.9 h2313.03 s

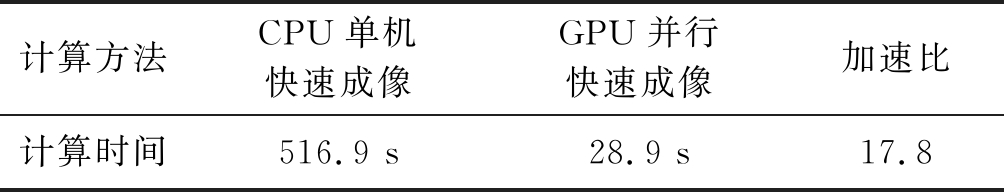

算例2 基于Intel Xeon E7- 4850处理器,512 GB内存工作站的平台测试GPU并行加速的快速成像技术对海面航母目标的成像加速效果,其所用的GPU为NVIDIA GTX 1080Ti。表2对比了单机CPU快速成像与GPU并行快速成像的计算时间对比。

表2 基于单机的快速成像和基于GPU并行加速的快速成像计算时间对比

Tab.2 Comparison of computing time between fast imaging based on single machine and parallel acceleration based on GPU

计算方法CPU单机快速成像GPU并行快速成像加速比计算时间516.9 s28.9 s17.8

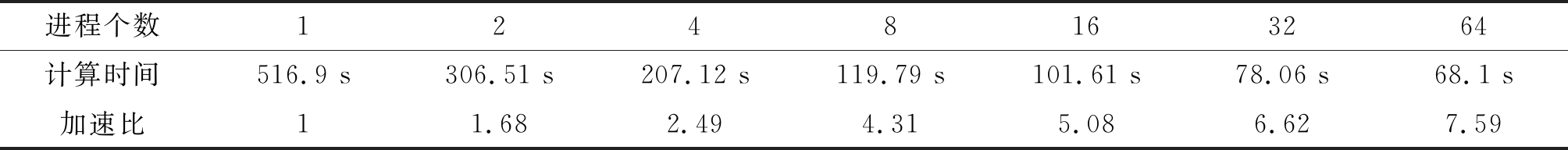

由表2可以看出,GPU并行快速成像较CPU单机快速成像加速了约17.8倍。基于以上平台,测试基于CPU并行加速的快速成像效果,表3为单机的快速成像与不同进程个数下CPU并行快速成像的计算时间的对比结果。

表3 基于单机的快速成像和基于CPU并行加速的快速成像计算时间对比

Tab.3 Comparison of computing time between fast imaging based on single machine and parallel acceleration based on CPU

进程个数1248163264计算时间516.9 s306.51 s207.12 s119.79 s101.61 s78.06 s68.1 s加速比11.682.494.315.086.627.59

由上表的加速比对比可以看出,基于GPU的并行快速成像与基于CPU的并行快速成像在成像速度上均有良好效果,同时,GPU并行加速较CPU并行加速而言,加速比更高。

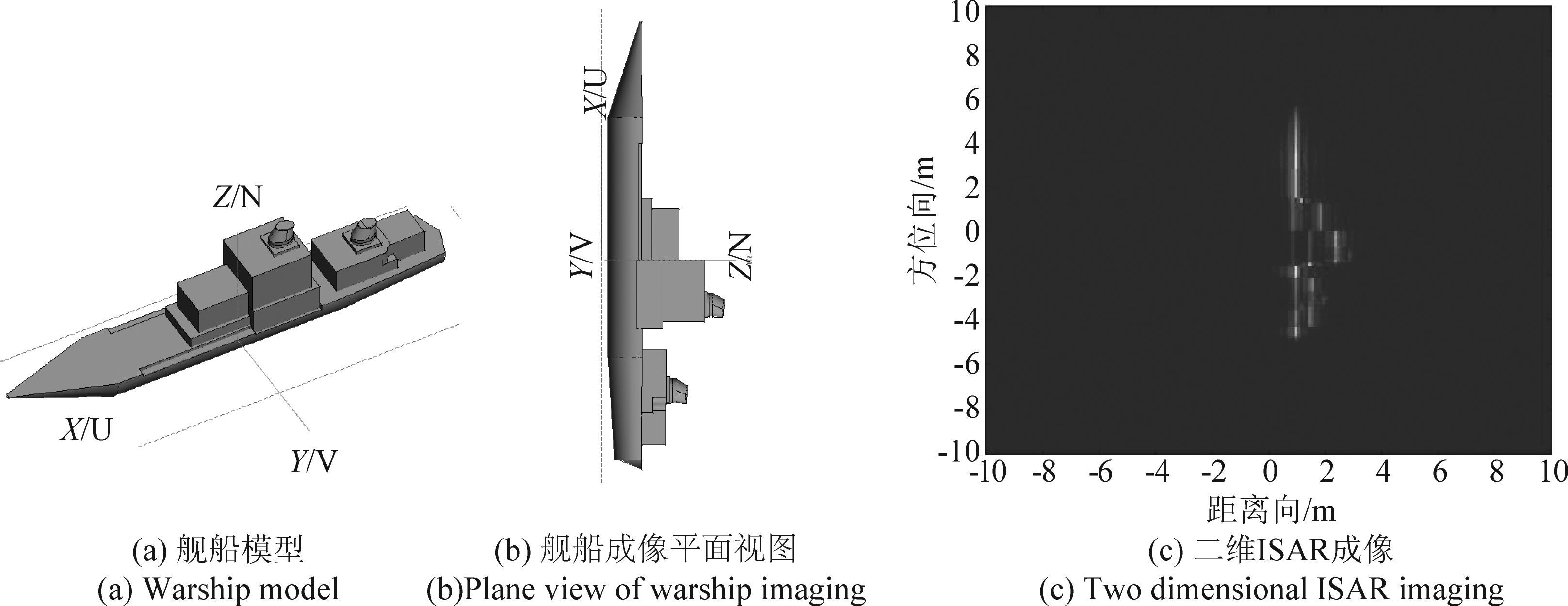

算例3 对如图9(a)中的舰船模型进行二维ISAR成像,舰船总长10.46 m,宽1.6 m,高2.72 m。中心频率10 GHz,带宽为2 GHz;平面波入射方向φ=0°,θ=0°,双站扫描角度±12°;成像平面选择X-Z平面如图9(b),方位向分辨率0.075 m,距离向分辨率为0.072 m,成像窗口为20 m×20 m,将成像窗口进行256×256划分。

该舰船模型剖分三角形个数为2556081,SBR弹跳次数为3。二维ISAR成像如图9(c)所示,较为清晰地反映了该舰船模型的外形,计算时间为96.32 s。

图9 舰船模型二维ISAR成像

Fig.9 Two dimensional ISAR imaging of ship model

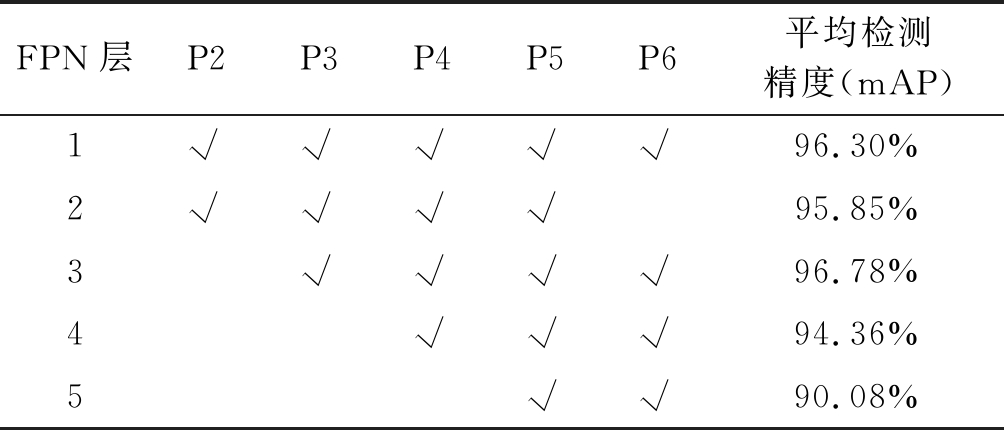

算例4 基于Tensorflow深度学习平台,使用在Imagenet数据集上预训练过的Resnet模型作为特征提取网络,在Faster RCNN网络中加入特征金字塔结构(FPN)。训练过程中,SAR图像的最短边尺寸缩放为600像素点,最长边不超过1000像素点,网络训练迭代次数为150000次,初始学习率为0.001。当网络模型训练次数迭代到50000和80000步时,学习率分别变为0.0001和0.00001。基于FPN结构的Faster RCNN网络分别提取FPN结构中不同层的特征信息来进行预测,训练模型在测试集上的测试结果如表4所示。

表4 融合不同特征层预测的模型的测试结果

Tab.4 Test results of models incorporating predictions from different feature layers

FPN层P2P3P4P5P6平均检测精度(mAP)1√√√√√96.30%2√√√√95.85%3√√√√96.78%4√√√94.36%5√√90.08%

表4中,每行表示添加FPN结构后,采用不同层的特征进行预测,训练模型的检测结果。从表中可以看出,基于FPN结构的Faster RCNN结合P3-P6层的特征信息能达到最好的预测结果。同时结果表明,检测模型仅利用高层特征信息难以得到更好的检测结果。

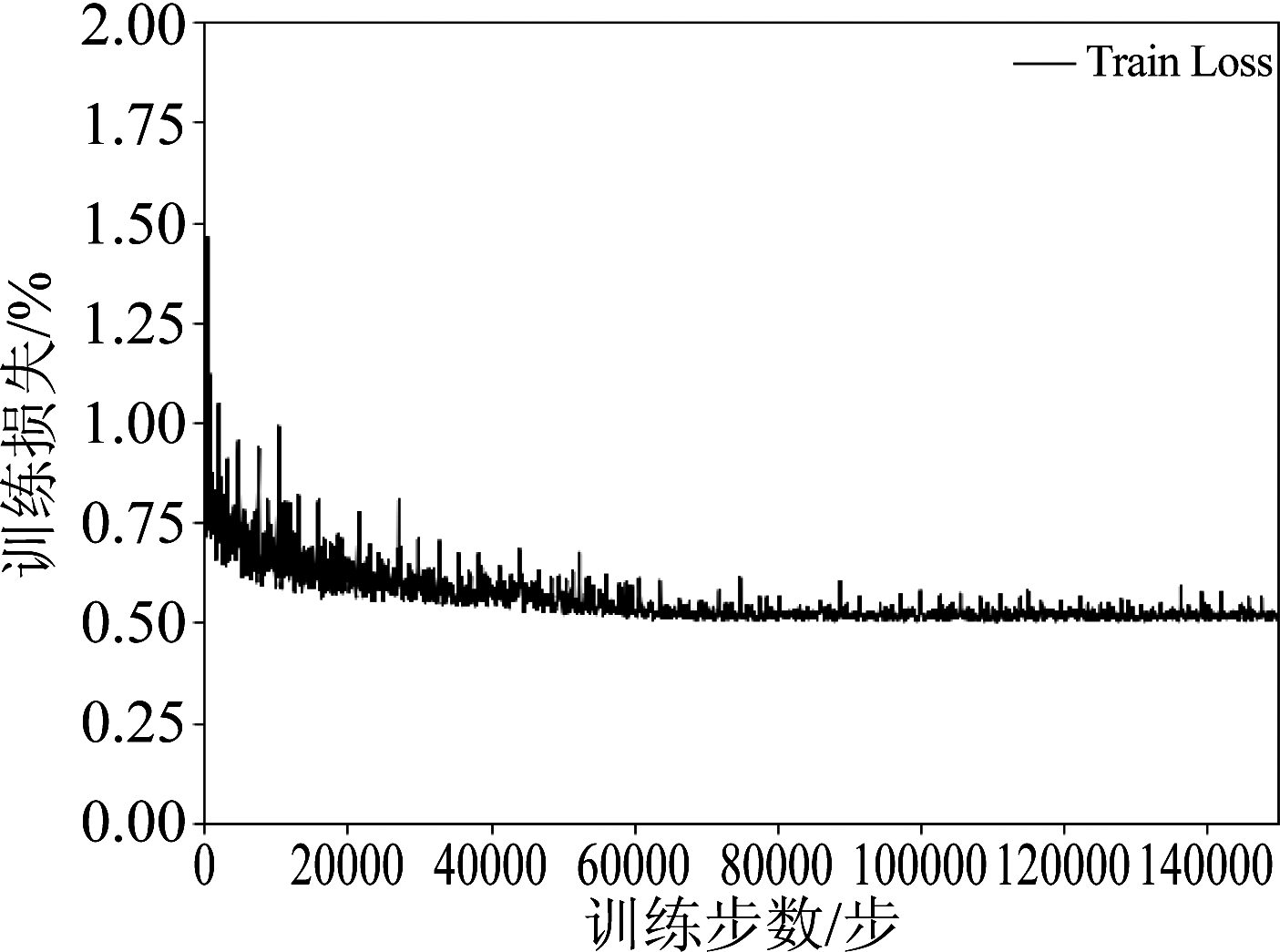

当基于FPN结构的Faster RCNN网络结合P3-P6层的特征信息进行预测时,其平均准确率最高达到96.78%。网络在训练过程中训练损失值如图10所示。

图10 基于FPN结构的Faster RCNN网络训练损失

Fig.10 Faster RCNN network training loss based on FPN structure

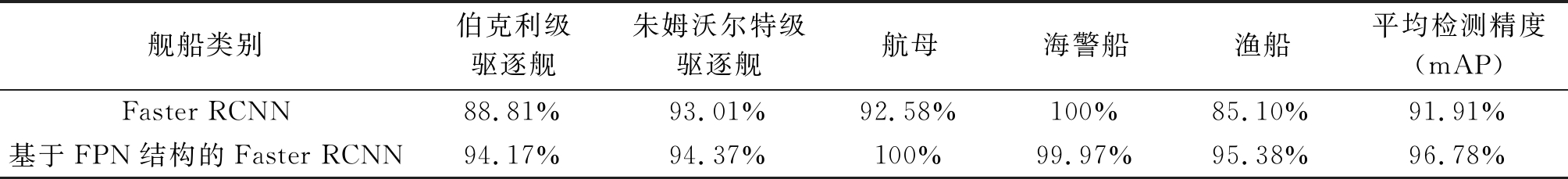

基于FPN结构的Faster RCNN网络在训练结束后,利用测试集来评估网络模型对SAR图像中舰船目标的检测性能,表5为不同模型网络在测试集上检测结果对比。

从表5对比结果可知,基于FPN结构的Faster RCNN网络模型的平均检测精度提高至96.78%。针对各类舰船目标的检测效果大致实现了一定的提升,由于FPN结构的Faster RCNN网络融合了来自低级卷积层的细节信息和高层卷积层的抽象语义信息,渔船这样的小目标的检测效果提升较大,同时也提升了伯克利级驱逐舰目标的识别准确率。但是,由于特征提取信息量的增多,存在将相似的海面背景误识别为朱姆沃尔特级驱逐舰目标的可能,这导致朱姆沃尔特级驱逐舰识别准确率出现下降。

表5 不同模型在测试集上检测结果对比

Tab.5 Comparison of test results of different models on the test set

舰船类别伯克利级驱逐舰朱姆沃尔特级驱逐舰航母海警船渔船平均检测精度(mAP)Faster RCNN88.81%93.01%92.58%100%85.10%91.91%基于FPN结构的Faster RCNN94.17%94.37%100%99.97%95.38%96.78%

图11展示了基于改进的Faster RCNN网络模型和基于FPN结构的Faster RCNN网络模型的检测结果。从图中可以看出,改进的Faster RCNN遇到密集的小尺寸渔船目标和相距较近的目标时会出现漏检的状况,而基于FPN结构的Faster CNN网络模型对于距离较近的目标没有出现漏检,同时对渔船目标的检测识别率相比改进的Faster RCNN网络要高。

图11 不同模型检测结果示例

Fig.11 Examples of detection results of different models

本文利用基于SBR的快速成像技术以及并行加速技术和MPI并行加速技术对不同舰船目标和海面进行快速成像,以更低成本构建用于目标识别的仿真数据集。之后使用改进的目标识别算法即基于FPN的Faster RCNN网络完成对SAR图像中舰船目标进行检测识别以及定位,并通过具体的算例验证提出方法的有效性。

深度学习网络的SAR数据集是通过仿真的舰船目标与仿真的海面和SSDD数据集中真实海面背景合成,在将来可加入舰船目标的实测SAR图像,提高数据的多样性和真实性,进一步提升目标检测网络的泛化能力。

[1] Ausherman D A, Kozma A, Walker J L, et al. Developments in Radar Imaging[J]. IEEE Transactions on Aerospace & Electronic Systems, 2008, AES-20(4): 363- 400.

[2] Brown W M, Fredricks R J. Range-Doppler Imaging with Motion through Resolution Cells[J]. IEEE Trans. Aerosp & Electron. Syst, 1969, 5(1): 98-102.

[3] 杜兰, 王兆成, 王燕, 等. 复杂场景下单通道SAR目标检测及鉴别研究进展综述[J]. 雷达学报, 2020, 9(1): 34-54. doi: 10.12000/JR19104.

Du Lan, Wang Zhaocheng, Wang Yan, et al. Survey of research progress on target detection and discrimination of single-channel SAR images for complex scenes[J]. Journal of Radars, 2020, 9(1): 34-54. doi: 10.12000/JR19104.(in Chinese)

[4] 张翠. 高分辨率SAR图像自动目标识别方法研究[D]. 长沙:国防科学技术大学,2003.

Zhang Cui. Research on Automatic Target Recognition in High Resolution SAR Imagines[D]. Changsha: National University of Defense Technology, 2003.(in Chinese)

[5] Zhou Jianxiong, Shi Zhiguang, Cheng Xiao, et al. Automatic Target Recognition of SAR Images Based on Global Scattering Center Model[J]. IEEE Transactions on Geoscience and Remote Sensing, 2011,49(10):3713-3729.

[6] Wissinger J, Washburn R B, Friedland N S, et al. Search algorithms for model-based SAR ATR[C]∥Algorithms for Synthetic Aperture Radar Imagery III. International Society for Optics and Photonics, 1996, 2757: 279-293.

[7] Yu X, Li Y, Jiao L C. SAR automatic target recognition based on classifiers fusion[C]∥2011 International Workshop on Multi-Platform/Multi-Sensor Remote Sensing and Mapping. IEEE, 2011: 1-5.

[8] 韩萍, 吴仁彪, 王兆华, 等. 基于KPCA准则的SAR目标特征提取与识别[J]. 电子与信息学报, 2003, 25(10): 1297-1301.

Han Ping, Wu Renbiao, Wang Zhaohua, et al. SAR Automatic Target Recognition Based on KPCA Criterion[J]. Journal of Electronics and Information Technology, 2003, 25(10): 1297-1301.(in Chinese)

[9] Du K, Deng Y, Wang R, et al. SAR ATR based on displacement-and rotation-insensitive CNN[J]. Remote Sensing Letters, 2016, 7(9): 895-904.

[10] Malmgren-Hansen D, Engholm R, Pedersen M O. Training convolutional neural networks for translational invariance on SAR ATR[C]∥Proceedings of EUSAR 2016: 11th European Conference on Synthetic Aperture Radar. VDE, 2016: 1- 4.

[11] 邵嘉琦, 曲长文, 李健伟. 卷积神经网络对 SAR 目标识别性能分析[J]. 雷达科学与技术, 2018, 16(5): 525-532.

Shao Jiaqi, Qu Changwen, Li Jianwei. A Performance Analysis of Convolutional Network Neural Network Models in SAR Target Recognition[J]. Radar Science and Technology, 2018, 16(5): 525-532.(in Chinese)

[12] Li J, Qu C, Shao J. Ship detection in SAR images based on an improved faster R-CNN[C]∥2017 SAR in Big Data Era: Models, Methods and Applications (BIGSARDATA). IEEE, 2017: 1- 6.

[13] Mou X, Chen X, Guan J, et al. Marine Target Detection Based on Improved Faster R-CNN for Navigation Radar PPI Images[C]∥2019 International Conference on Control, Automation and Information Sciences (ICCAIS). IEEE, 2019: 1-5.

[14] Hao Ling, Ri-Chee Chou. Shooting and bouncing rays: calculating the RCS of an arbitrarily shaped cavity[J]. IEEE Transactions on Antennas and Propagation,1989,37(2):194-205.

[15] 王晨, 王军锋. 一种舰船目标SAR图像的仿真方案[J]. 信息技术, 2007, 31(8): 130-132.

Wang Chen, Wang Junfeng. A scheme for simulating SAR images of ships[J]. Information Technology, 2007, 31(8): 130-132.(in Chinese)

[16] 许艇. 基于改进的Faster R-CNN物流车辆特征识别研究[D]. 杭州:浙江工业大学,2019.

Xu Ting. Study on Logistic Vehicle Feature Recognition Based on Improved Faster R-CNN[D]. Hangzhou: Zhejiang University of Technology, 2019.(in Chinese)

[17] 李靓, 贺柏根, 霍家道. FPN在遥感图像检测中的应用[J]. 指挥控制与仿真, 2019, 41(2): 130-136.

Li Liang, He Baigen, Huo Jiadao. Application of FPN in Remote Sensing Image[J]. Command Control & Simulation, 2019, 41(2): 130-136.(in Chinese)

[18] 王旭阳. 基于深度学习的食道癌图像检测技术的研究[D]. 兰州:兰州大学, 2017.

Wang Xuyang. Research on Image Detection Technology of Esophageal Cancer Based on Deep Learning[D]. Lanzhou: Lanzhou University, 2017.(in Chinese)

丁大志 男, 1979年生, 江苏人。南京理工大学电子工程与光电技术学院教授, 博士。研究方向为电磁理论与计算电磁学。

E-mail: dzding@njust.edu.cn

杨 婕 女, 1996年生, 江苏人。南京理工大学电子工程与光电技术学院, 博士生。主要研究方向为计算电磁学与智能识别方法研究。

E-mail: yangjienj@outlook.com

杨宝金 男, 1995年生, 江苏人。南京理工大学电子工程与光电技术学院, 硕士。研究方向为电磁理论与计算电磁学。

E-mail: 18801595867@163.com

何 姿 女, 1988年生, 江苏人。南京理工大学电子工程与光电技术学院副教授, 博士。研究方向为计算电磁学、特征提取、目标识别。

E-mail: 15850554055@163.com

樊振宏 男, 1978年生, 江苏人。南京理工大学电子工程与光电技术学院教授, 博士。研究方向为电磁理论与计算电磁学。

E-mail: zhfan@njust.edu.cn

陈如山 男, 1965年生, 江苏人。南京理工大学电子工程与光电技术学院教授, 博士, 研究方向为电磁理论与计算电磁学。

E-mail: eerschen@njust.edu.cn