1 引言

静脉识别相比其他生物特征识别如指纹、虹膜、人脸、语音、掌纹具有活体识别、体内特征、非接触检测和安全性高等独特优势,被逐渐应用在高设防、高安全环境下的身份认证系统中[1-5]。而在使用静脉信息进行识别身份识别时,其高质量以及丰富的图像信息是其能够得到广泛应用的关键。然而由于静脉生物特征信息采集是根据活体状态进行采集的,静脉信息图像的质量会受限于人体状态、设备状态、光源污染、传输丢失等现象引起的图片质量低下、噪声污染、图像信息大面积缺失等问题。因此,在生物特征信息进行应用时,丰富完整的图像信息就显得尤为重要。

在图像修复技术发展过程中,传统的图像修复技术主要是基于人工标注,其程序复杂容易耗费大量的人力劳动[6-7]。在缺失图像修复效果上,传统方式在图像局部小块缺失时能够较好的表现,但是在图像出现大部分缺失时,传统方式就表现得力不从心,不仅修复难度大、工作繁琐,其图像的修复效果更是出现图像坍塌严重的现象。随着深度卷积神经网络的出现,其利用计算机在图像特征学习能力更是超越了人类,无需繁琐的标注工程,整个图像信息的学习能力就能达到一个全面状态[8-9]。因此,基于深度学习的图像修复算法研究成为当前的热门工作,其优秀的修复能力让图像修复工作更趋于高效。

目前,虽然在图像修复领域已经存在诸多算法,但是关于手部静脉血管网络修复的研究却是很少。一些已经存在的静脉图像修复算法主要是用在视网膜血管的研究上,基于图搜索算法搜索断开血管段的重连路径[10];从视网膜血管网络的几何结构提出利用自组织特征映射神经网络训练代价函数用以评估血管连接可行性[11];利用流体动力学建模来确定血管间的连通性[12];在手部静脉血管图像残缺的修复方面却还是研究的较少,在修复方面采用的是基于分形理论的修复方法,但是对于多个交叉点同时残缺或者较大区域残缺时就显得困难[13-14]。因此,为了得到完整、质量高的手部静脉图像用在生物特征识别就需要探索出新的手部静脉缺失图像的修复方法。为此,本文在手部静脉图像的修复上进行研究与设计,结合深度学习技术探索生成针对生物特征信息修复的网络架构。

本文基于生成对抗网络在图像生成方面的优异表现,提出分层级联生成对抗网络用于手背静脉图像修复。根据手背静脉图像信息的分布特性,采用了级联与并行分层生成对抗网络修复框架将多种静脉图像进行有效特征融合,有效地利用静脉血管图像的关键信息;为了有效的挖掘手背静脉图像以及分割图像的几何信息特征,在修复网络中引入空洞卷积核与非局部注意力网络块;采用全局与局部对抗损失与图像感知损失以保证生成静脉图像整体与细节与原始图像的一致性,进而完成对手部静脉缺失图像的修复。

2 分层级联生成对抗网络框架

随着近年来人工智能的快速发展,深度学习亦是得到了很好的发展与应用,尤其深度卷积神经网络(Deep Convolutional Neural Networks,DCNN)在计算机视觉图像处理任务取得的效果更是令人惊叹。而最近的研究表明,在图像修复方面深度神经网络亦表现出了其优异的性能,尤其是生成对抗网络(Generative Adversarial Network,GAN)的出现使得图像生成方面质量有了很大的提高[15]。

本文提出分层级联生成对抗网络用于手背静脉图像修复的方法(HC-GAN: Hand-dorsal Vein Image Inpainting Using Hierarchical Cascade Generative Adversarial Networks)。算法实现静脉图像与其分割图像相融合进行缺失区域的补全,在纹理与静脉纹络上达到了与原始图像相匹配的程度。相对于存在的算法,本算法高效的利用了静脉特征分布特点,修复效果得到较好的提升。

2.1 生成对抗网络技术

近年来随着深度学习的研究越来越深入,基于深度卷积的生成对抗网络的研究也得到了快速的发展,尤其更深更复杂的生成网络以及判别网络的结合更是有效地减少了传统生成对抗网络中容易出现训练崩溃的现象,使得生成对抗网络在许多方面得到了有效地应用。

随着生成对抗网络的不断发展,新的理论与研究更是丰富了生成对抗技术的理论与应用,目前深度生成对抗网络俨然已经成为深度学习领域热门的研究方向之一。生成对抗网络在得到有效的训练后,可以具备强大的数据生成能力,生成的数据同时具有多样性,基于其强大的数据生成能力,生成对抗网络的应用也变得多样性。

2.2 修复网络框架

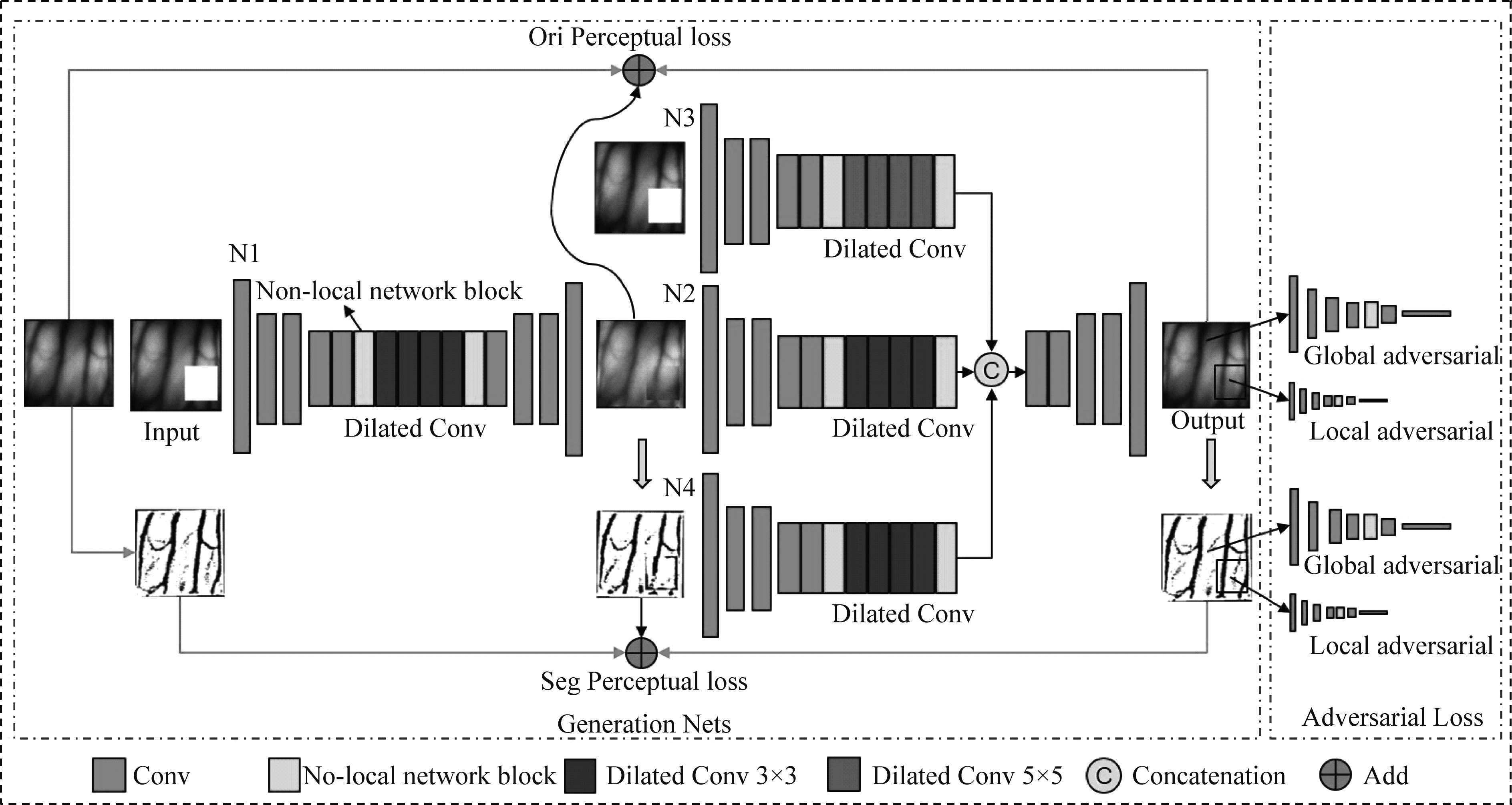

本文提出的HC-GAN算法是根据静脉图像的静脉血管分布特征进行设计的。如图1所示,生成网络模型是基于自编码网络,与简单的自编码不同的是该算法具有更深的网络。同时为了有效地提取手背静脉图像的纹理特征与几何特征,分别在网络中间编码层采用了空洞卷积(Dilated Convolutions)与非局部注意力网络[16]。在网络中判别网络用于引导生成真实的高质量图像,同时还采用了感知损失。

修复网络整体架构是一个类似于编码器与解码器的网络,编码器用于图像的下采样以捕获更抽象的信息,解码器用于对图像进行上采样,以便于恢复图像空间信息。从图1可以看出,缺失的静脉图像首先经过一个生成网络N1,生成具有初步修复效果的静脉修复图像。在接下来本文引入分层式的网络N2、N3、N4,首先,N2、N3、N4都相同地引入了空洞卷积与非注意力机制来捕捉不同级别的特征信息,不同的是N2、N4的空洞卷积核大小为3×3,N3网络中的空洞卷积核大小为5×5,其作用是扩大其卷积感受野以便较好地获取其整体语义信息。然后,将N2、N3、N4网络得到的特征层在特定维度上进行了叠加,以便高效地利用静脉特征信息。最后,将叠加后的特征层进行上采样以得到最终的修复图像。在网络中增加了局部上下文损失(Local discriminator)与全局上下文损失(Global discriminator)判别网络,在这个训练中,判别网络被训练来确定生成图像的真实性。而为了减少修复图像与原始图像之间的差异,本文分别同时对静脉图像以及静脉分割图像加入了感知损失(Perceptual Loss)以优化生成图像的细节信息。

2.3 空洞卷积

生成对抗网络中的生成网络主要结构是基于深度卷积神经网络,虽然卷积神经网络在计算机视觉领域已经具有很好的表现,但是在卷积采样操作时,尤其是在池化层的操作容易造成一些关键信息的丢失。因此,由于上下文信息的重要性,在本文的修复网络中使用了空洞卷积(Dilated Convolution),空洞卷积使用的是分散的卷积核,可以保证每个输出像素具有更大的感受野,以捕获多尺度的上下文信息。

空洞卷积是指其每一层的卷积核中设置一个空洞率,减少计算量的同时而不会降低分辨率或覆盖范围。在本文中,N1、N2、N4网络层中添加的空洞卷积是2倍、4倍、8倍、16倍的空洞率,卷积核大小为3×3,而N3网络层中卷积核为大小5×5。

2.4 非局部网络模块

受Buades等人提出的非局部均值算法影响[17],为了更好的使神经网络能够捕捉图像细节信息以及像素间的互信息,Wang等人提出了非局部神经网络结构(Non-local Neural Network)作为计算机视觉领域捕获长范围依赖的通用构件[18]。由此,Zhang提出了Self-Attention GAN(SA-GAN),其中Non-local Neural Network已经验证可以有效地集成到GANs中[19]。

图1 HC-GAN算法整体模型

Fig.1 The overall model of proposed method HC-GAN

在Non-local Neural Network的作用下,生成对抗网络可以根据像素位置的关系来学习传统卷积神经网络学习不到的图像细节。此外,判别器可以检查图像的远端细节是否与其他细节一致。在本文的模型中,生成器和判别器中都使用了Non-local Neural Network模块。

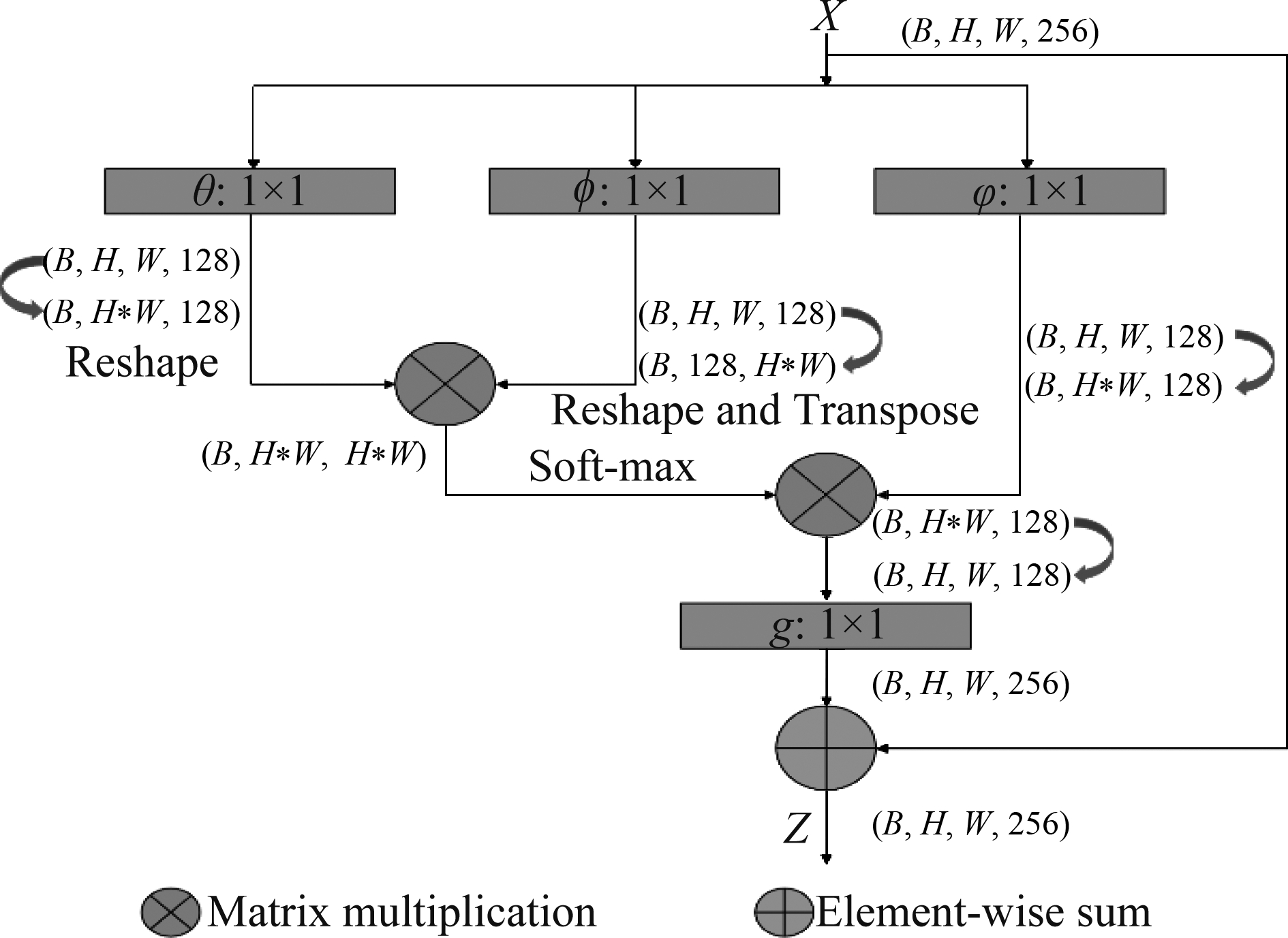

如图2所示,在前层网络提取到特征图后输入到非局部神经网络块中,该块可以捕获长距离依赖关系,采用1×1卷积核、重塑(Reshape)、转置(Transpose)、矩阵乘法和Soft-Max等操作进行运算,如式(1)

(1)

i是输出特征图的其中一个位置,通用来说这个位置可以是时间、空间和时空。j是所有可能位置的索引,x是输入的特征图像,通常是特征图。y是和x尺度一样的输出图, f是配对计算函数,计算第i个位置和其他所有位置的相关性,g是一元输入函数,目的是进行信息变换,C(x)是归一化函数,保证变换前后整体信息不变。本文的Non-local Neural Network 的在图中,B、H、W分别为图像样本数、高、宽。

图2 非局部神经网络结构

Fig.2 Non-local Neural Network

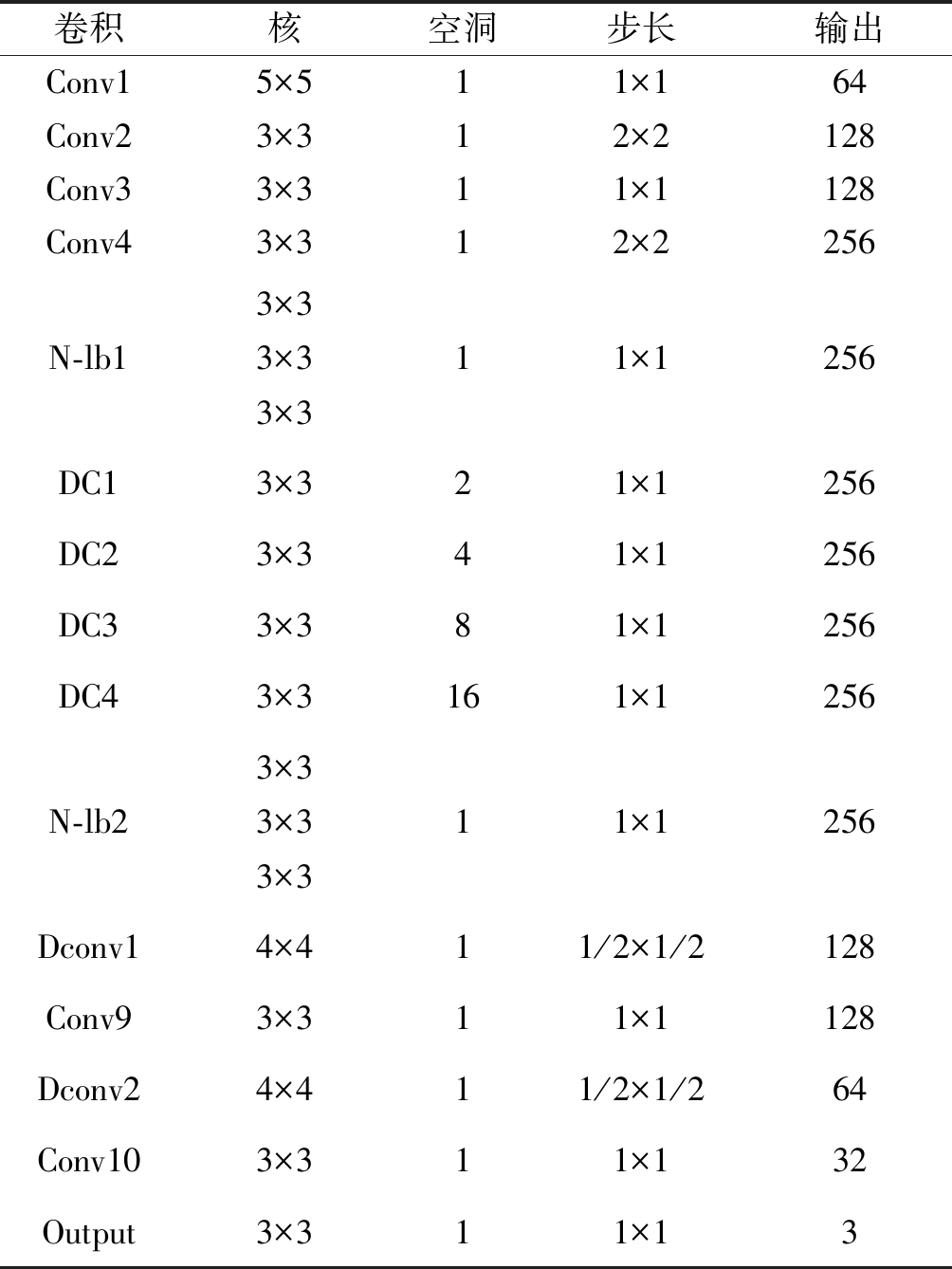

生成网络N1、N2、N4的网络层参数如表1所示,本文分别在Dilated Convolution网络模块DC1、DC2、DC3、DC4前后加入了Non-local模块N-lb1与N-lb2。

表1 生成网络参数

Tab.1 Image inpainting network

卷积核空洞步长输出Conv15×511×164Conv23×312×2128Conv33×311×1128Conv43×312×2256N-lb13×33×33×311×1256DC13×321×1256DC23×341×1256DC33×381×1256DC43×3161×1256N-lb23×33×33×311×1256Dconv14×411/2×1/2128Conv93×311×1128Dconv24×411/2×1/264Conv103×311×132Output3×311×13

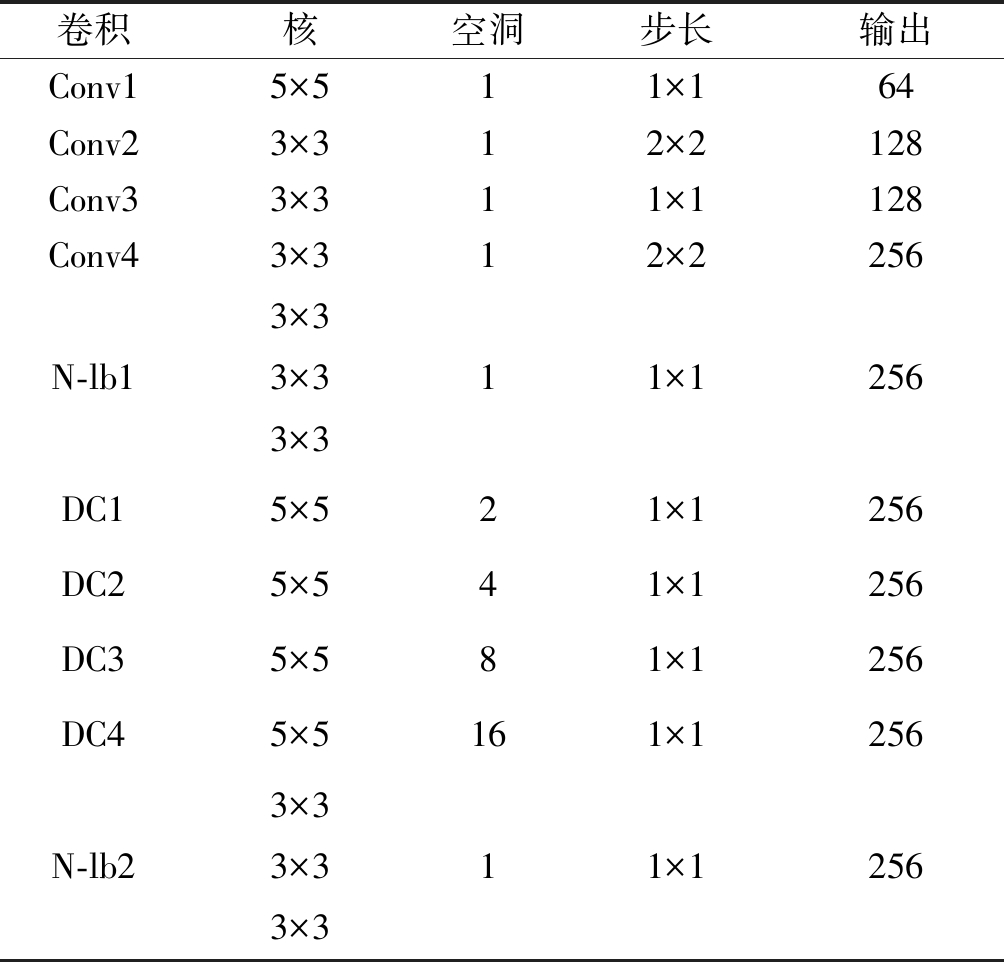

表2 N3生成网络参数

Tab.2 Image inpainting network of N3

卷积核空洞步长输出Conv15×511×164Conv23×312×2128Conv33×311×1128Conv43×312×2256N-lb13×33×33×311×1256DC15×521×1256DC25×541×1256DC35×581×1256DC45×5161×1256N-lb23×33×33×311×1256

在级联网络中,由于N3编码网络采用了与其他网络不同的空洞卷积率,其参数如表2所示。

2.5 损失函数

在本文提出的修复网络训练过程中,为了更好地对生成模型进行约束从而生成高质量的手背静脉图像,在网络结构中加入了对抗损失与感知损失。对抗损失可以判定生成图像的真伪,感知损失可以从高级语义信息方面保证图像与原始图像的一致性。

在生成对抗网络中,判别器主要是对生成的图像进行真实性的鉴别。本文所采用的基于全局上下文和局部上下文的判别网络是由Iizuka S首次提出[20],旨在判别修复图像的真实性。如图1中的Adversarial Loss部分所示,该卷积网络是将图像进行网络编码,网络最终编码输出通过连接层进行融合,最后进行图像的真实性判断,本文对静脉图像以及静脉分割图像采用了双重对抗损失。

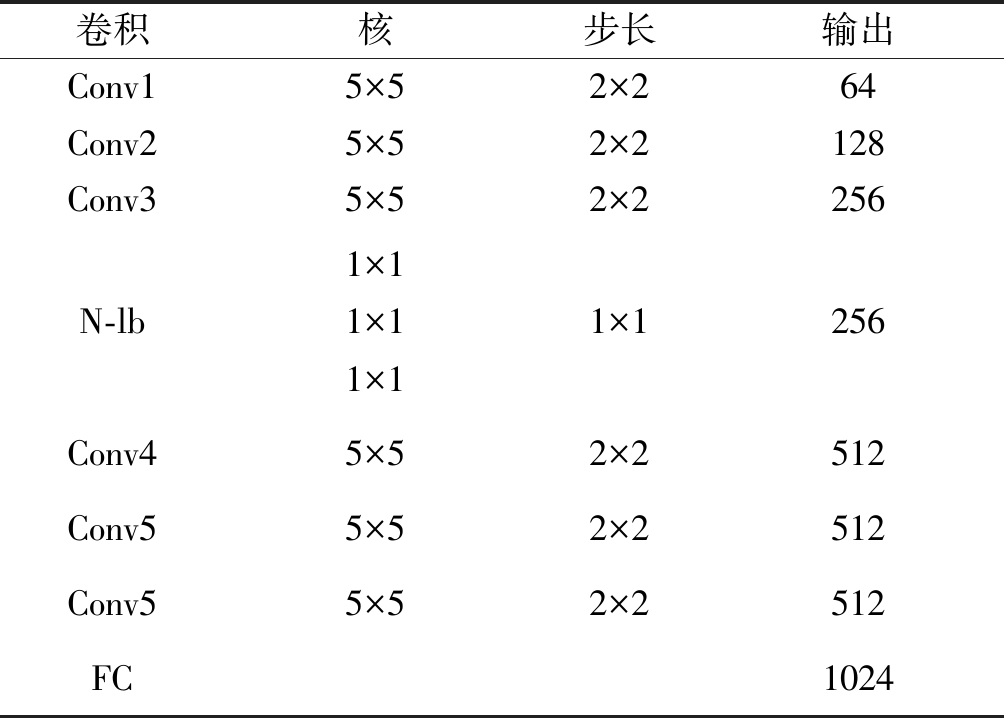

全局上下文判别器将完整图像作为输入,判别其全局一致性。网络层参数如表3所示,它经过卷积层输出一个1024维矢量的单个完全连接层组成。所有卷积层都采用2×2像素的步幅,以降低图像分辨率,同时增加输出滤波器的数量。与生成网络相反,所有卷积都使用5×5内核。

表3 全局判别网络

Tab.3 Global discriminator

卷积核步长输出Conv15×52×264Conv25×52×2128Conv35×52×2256N-lb1×11×11×11×1256Conv45×52×2512Conv55×52×2512Conv55×52×2512FC1024

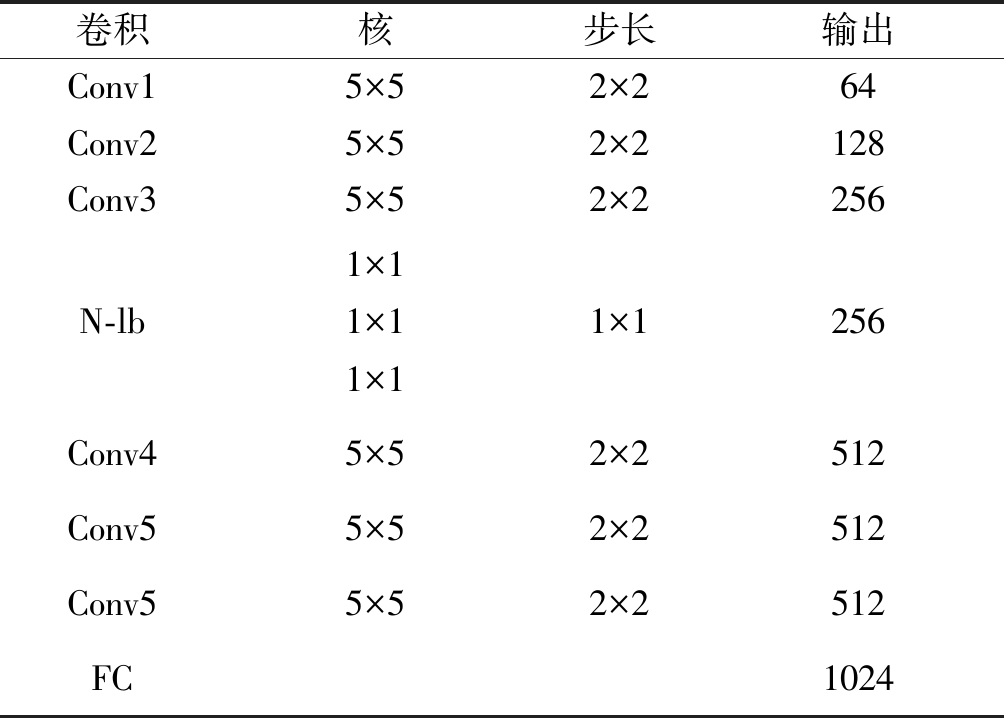

局部上下文判别器,是一个以填充区域为中心的图像进行观测,判别其局部一致性。如表4所示,经过5×5内核与2×2像素的步幅,输出仍是一个1024维向量。

表4 局部判别网络

Tab.4 Local discriminator

卷积核步长输出Conv15×52×264Conv25×52×2128Conv35×52×2256N-lb1×11×11×11×1256Conv45×52×2512Conv55×52×2512Conv55×52×2512FC1024

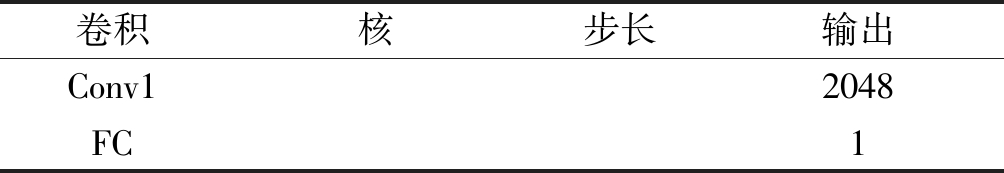

如表5所示,全局与局部的编码串联在一起成为一个2048维向量。然后由单个完全连接的层进行处理,以输出连续值,最后经过Sigmoid激活函数,将变量映射在[0,1]范围内,其值代表图片是真实性。在本文分别对静脉图像以及分割图像采用全局与局部判别器。

表5 链接网络

Tab.5 Concatenation layer

卷积核 步长输出Conv12048FC1

对于判别损失是生成对抗网络训练过程中重要的组成部分,静脉图像对抗损失为:

(2)

式中:Md为随机的掩码模块,Mc是输入掩码,x为训练数据集,![]() 为训练数据的期望。

为训练数据的期望。

静脉分割图像的对抗损失为:

(3)

在本文算法中,分别对最终的生成的修复图像与分割图像进行判别,对抗总损失为

(4)

式中:λo、λs分别为静脉图像与静脉分割图像的权重参数。

感知损失(Perceptual Loss)是在图像风格转换应用方面被提出来的,感知损失被验证可以作为图像在生成方面的辅助工具[21]。由于GANs中的对抗损失考虑的是自然图像的整体分布,并不适用于静脉图像在光感、细节阴影等方面的细节修复。因此,在修复网络框架同时引入感知损失对图像高级语义信息以及图像细节进行约束优化。本文也同时引入了双重感知损失,其中静脉感知损失函数Ori Perceptual loss定义为如式(5)所示

![]()

||φj(Io)-φj(If )![]()

(5)

式中:φl表示图像在CNN网络中的第l层的特征图,φj表示图像在CNN网络中的第j层的特征图,Io与If分别表示原始图像与修复图像。

静脉分割图像感知损失Seg Perceptual loss定义为:

![]()

||φj(Io)-φj(If )![]()

(6)

最终修复图像和原始分割图像间的感知损失的和,如式

(7)

整个目标损失为式(2)到式(7)的加权损失之和:

(8)

式中:λd、λp分别为对抗损失与感知损失权重值,根据训练经验,本文将超参数分别设置的值为:λd=1,λp=0.1,λo=1,λs=0.1。

因此,最终的损失函数为:

(9)

3 实验与结果分析

为了验证本文算法对于手背静脉血管图像修复的有效性,并与已有经典算法进行了对比实验,本文所用数据集主要是以实验室自制数据集为主,另外使用了两个公开的掌纹和指纹数据集对算法进行泛化验证。

3.1 数据集

在训练数据集方面,本文使用了自制的手背静脉数据集以及公开的掌纹与指纹数据集来验证算法的有效性。本文自制的静脉实验数据集是建立的一个包含200个个体的综合手背静脉数据库,其中男性和女性的采集人数分别为100,每个人采集10张右手背静脉图像。本文数据库中的所有手背静脉图像都是在两个特定的时间段内采集的,间隔时间超过10天,每次采集5个样本,波长为850 nm。为了充分利用手背静脉信息,本文将图像的大小设置为460*680,具有较高的质量。针对该数据库设计的ROI提取过程,进行灰度和大小归一化。对于每个图像,提取感兴趣的区域,并将其标准化为256*256像素。为确保网络的性能,本文将使用自制数据集通过多种数据增强的方式,如平移、旋转、拉伸等,将手背静脉数据集扩充到20000张。选取前180人为训练数据集,占比例0.9,测试图像为后20人,所占比例为0.1,样图如图3所示。

图3 自制数据集样图

Fig.3 Samples of self-made dataset

图4 掌纹与指纹数据集样图

Fig.4 Samples of hand print and finger print

为验证本文提出算法修复性能的泛化性,分别在掌纹与指纹两种开源的数据集进行了测验。一个是香港理工大学的开放掌纹数据库,它由来自不同主题的掌纹纹理感兴趣区域(ROIs)组成,为每个受试者提供一个ROI,并将其标准化为256×256像素[22]。另一个数据库是FVC-2004,它是一个开放的指纹数据库[23]。如图4中可以看到掌纹和指纹,第一行是掌纹图像,第二行是指纹图像。

本文的主要任务是对缺失的手部静脉图像进行修复。因此,为了能够得到有效的训练结果,在缺失图像生成方面,采用随机生成局部缺失的手背静脉信息的图像,输入的缺失图像Im的生成如式所示:

Im=Igt⊙(I-M)

(10)

式中:Igt是完整的静脉图像,M是一个0~1的掩码矩阵,局部缺失部分是0,其他地方是1,M是随机生成的,I全为1的矩阵,⊙代表对应元素相乘。如图5所示,采用随机掩码矩阵生成的局部缺失手背静脉图像。

图5 手背静脉随机缺失样图

Fig.5 Samples of random missing hand-dorsa vein images

3.2 对比试验

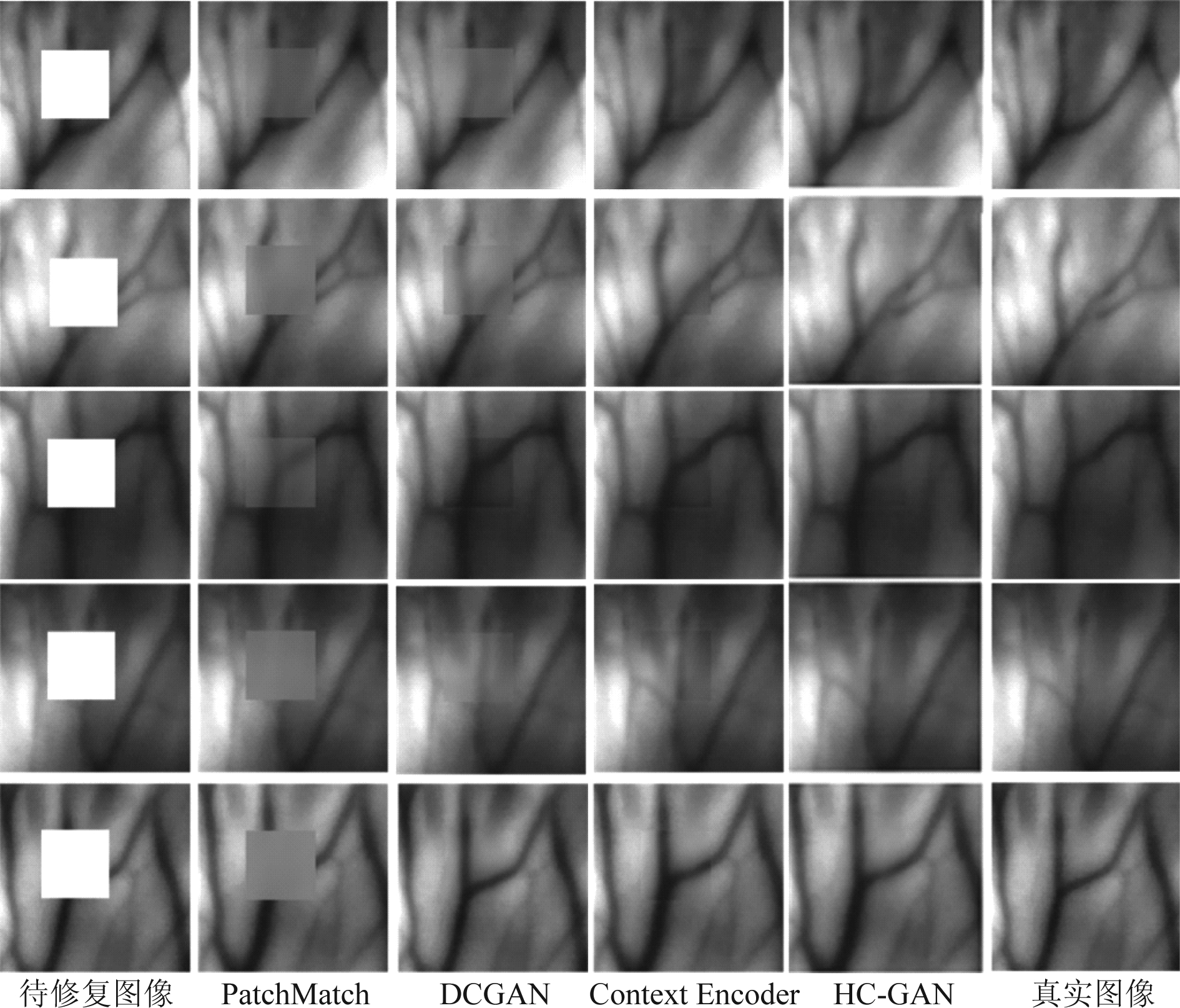

为了验证手背静脉修复方法的有效性,本文对一些存在的修复算法进行了对比测验,如Patch Match[24]、DCGAN[25]、Context Encoder[26]。

从图6中可以看出,在修复效果上如第一列所示,在Patch Match算法上主要采用的是近似最近邻的方法来寻找临近像素关系以确保缺失部分与原始图像之间的连续性,但是在大部分缺失的情况下Patch Match就不能发挥其搜索的优势,在算法收敛上就显得较为困难,这就导致其生成的修复手背静脉血管网络图像与原始图像有很大的差异,在被修复图像之间的整体匹配度上也表现的较差,图像风格差异较大。DCGAN的方法在修复方面仍存在一定水印块现象,该算法是基于生成对抗网络模型,在潜在空间中搜索与图像“最接近”的需要修复图像的编码,但是有时候会存在很难在潜在空间中找到正确的学习变量的问题。从Context Encoder算法结果可以看出,该算法对于缺失的手背静脉血管网络图像修复有了一定的还原效果,在Context Encoder的算法网络中主要是简单的结合了自编码网络特性与对抗损失的原理,在生成网络上采用的是编码与解码的网络结构,但是修复后的图像存在较明显的水印现象上并未得到好的处理。而本文提出的方法在静脉图像的修复上取得了较好的结果,在水印方面有了一定的淡化效果,在手背静脉图像结构重建的过程中也加入感知损失以及风格损失,确保了细节语义以及高层信息与原始图像更为接近,证明了其在手背静脉图像修复有效性。

图6 对比实验结果

Fig.6 Comparisons with existing works

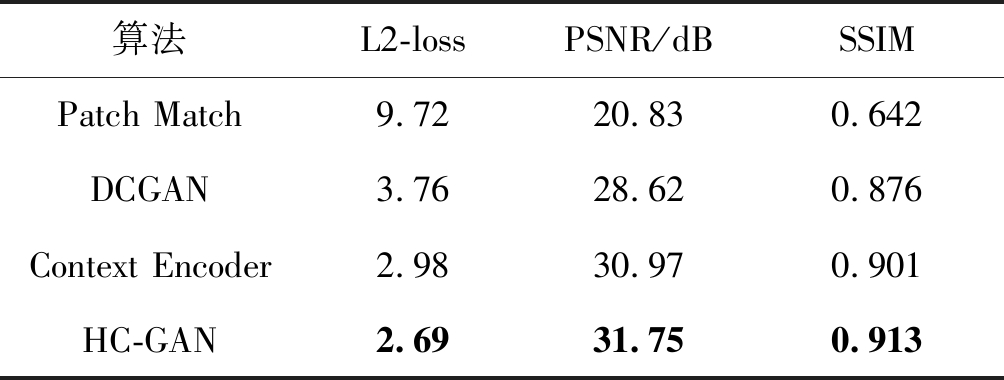

表6 PSNR与SSIM评价指标

Tab.6 PSNR and SSIM

算法L2-lossPSNR/dBSSIMPatch Match9.7220.830.642DCGAN3.7628.620.876Context Encoder2.9830.970.901HC-GAN2.6931.750.913

在本文对修复图像的结果进行评价上,除了对经典算法的对比外还使用了使用较多的定量评估方法进行质量评价。而在图像生成或者修复方面有相关的评价标准,应用最多的客观评价指标分别是平均L2损失、PSNR[27]、SSIM[28]。表6显示了比较结果,通过与已有算法进行对比,可以看出,在这些指标的平均值上,本文的方法优于其他的修复方法。

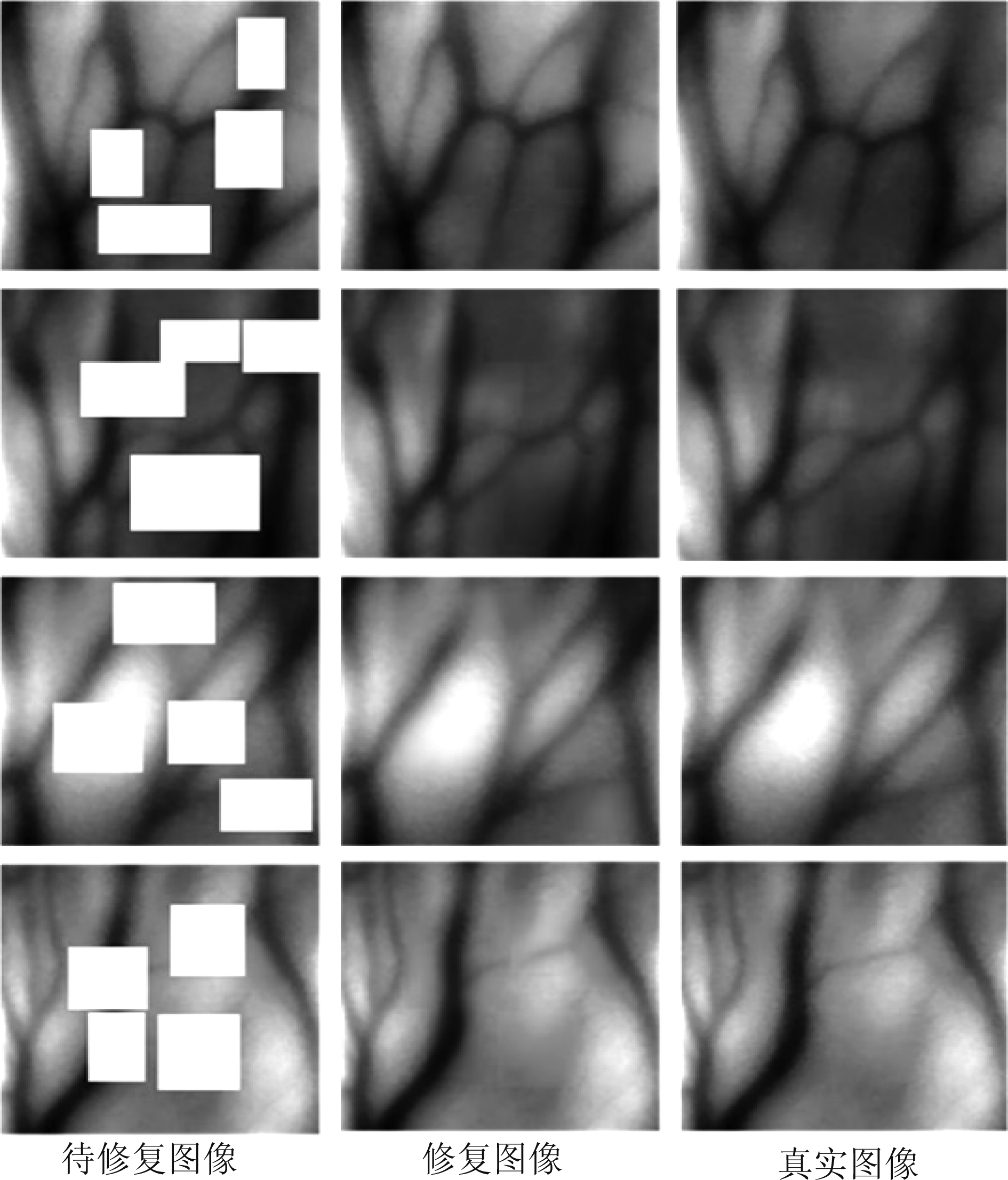

图7 多个不同大小缺失的修复效果

Fig.7 Inpainting of multiple missing of different sizes

同时,如图7所示,本文方法在多个缺失区域,以及大小、位置不同的情况下,依然有不错的修复结果。

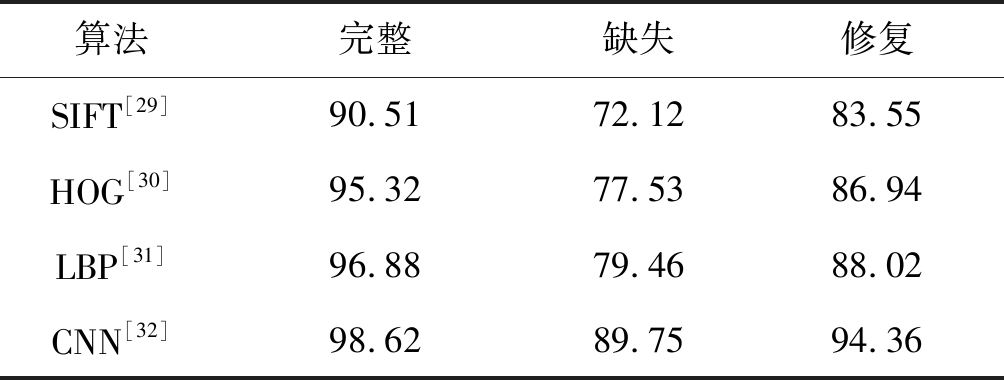

表7 Rank-One识别结果

Tab.7 Rank-One recognition rate %

算法完整缺失修复SIFT[29]90.5172.1283.55HOG[30]95.3277.5386.94LBP[31]96.8879.4688.02CNN[32]98.6289.7594.36

为了验证修复后的手背静脉图像相较于缺失的手背静脉图像在静脉识别方面的有效性,本文分别在多个识别算法上对缺失图像与修复图像进行了识别对比,缺失图像选择的是如图6所示的固定大小缺失块,其识别结果如表7所示。从表中可以看出,修复后的手背静脉图像在多种识别算法上的Rank-One识别结果相较于缺失的手背静脉图像都有较大提升,验证了修复后的手背静脉图像在身份识别提升方面的有效性。

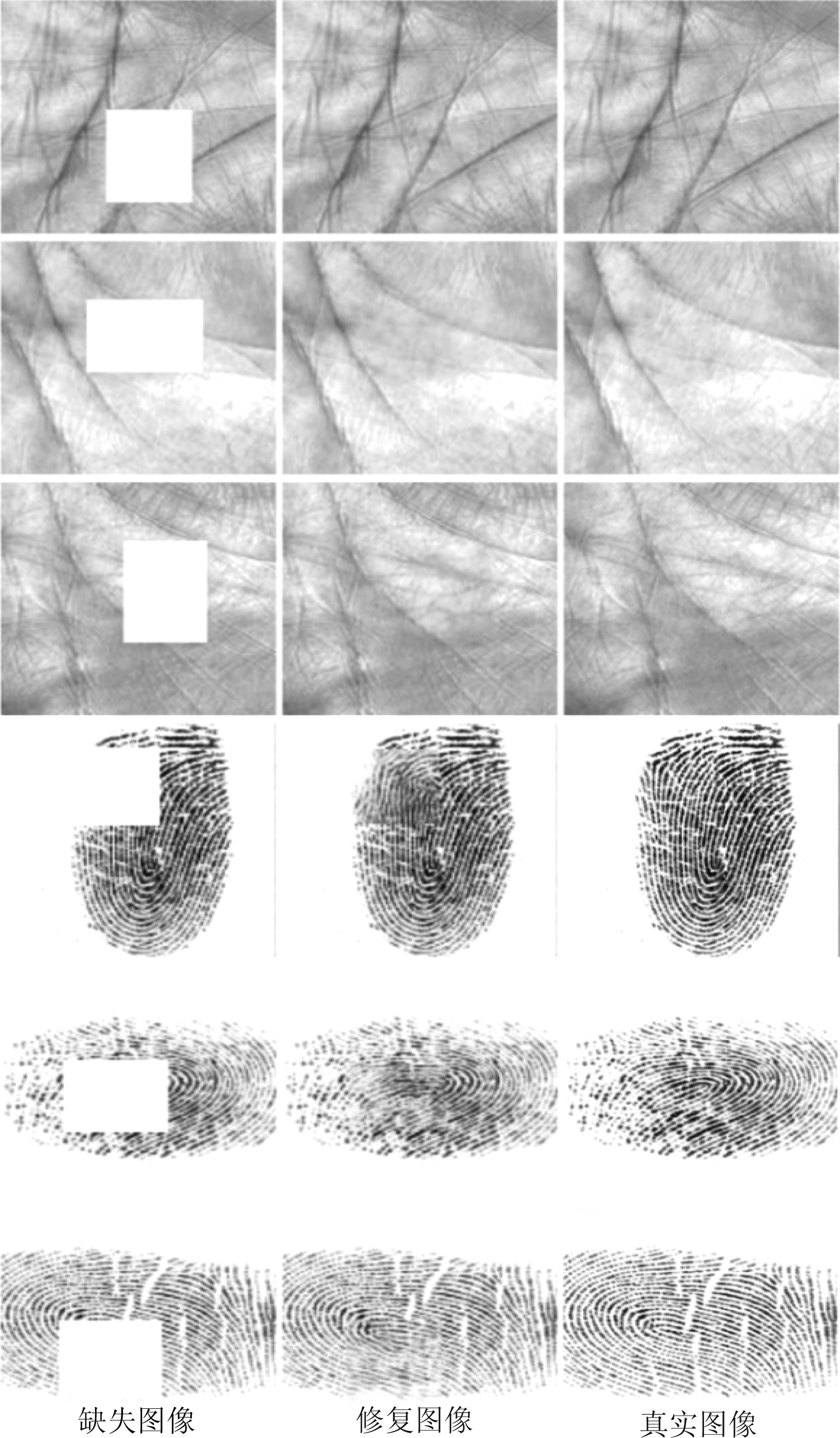

此外,本文对非静脉源的掌纹与指纹的修复进行了修复测验,以验证本文方法的泛化性。在两个开源数据集上分别进行了修复实验,修复效果如图8所示。从图中可以看出,掌纹整体信息平滑,复杂性不高,本文算法在提取上下文信息方面具有一定的优势,对于掌纹缺失信息整体上具有较好的修复,细节修复效果也较为明显,水印也淡化效果较好。此外,从图8中可以看出,指纹几何信息丰富细节较多,虽然在指纹缺失图像的修复能力上有一定的下降,如指纹信息丰富以及线条密集的区域存在一定水印,但是本文算法能够有效地利用了指纹图像上下文信息以及指纹分割图像的信息,对与缺失指纹图像的信息也得到了较为完整的修复。

图8 掌纹与指纹缺失图像修复结果

Fig.8 Results of finger-print and palm-print

4 结论

本文提出分层级联生成对抗网络用于手背静脉图像修复。该算法针对静脉图像信息的分布特点,以编码与解码为基础网络框架,通过级联并列分层网络有效融合了不同静脉图像特征信息。此外,为保证生成修复图像的质量,网络采用空洞卷积核与局部注意力网络模块,提高了网络学习静脉图像上下文信息的能力;引入对抗损失与感知损失,提高了图像质量优化约束能力。本文提出的手背静脉修复算法生成的修复图像在视觉效果与评价指标方面优于其他算法,其修复图像的识别效果较于缺失图像也有了较大提升;在非静脉图像源的掌纹数据集与几何信息丰富的指纹图像数据集上进行泛化验证,其修复效果也有良好的表现。

[1] Wang Xuansheng, Zeng Weibin, Zheng Hongying, et al. A Two-step Feature Extraction Algorithm for Face Recognition[C]∥ICCDE 2020: 2020 The 6th International Conference on Computing and Data Engineering. Sanya China, 2020: 154-158.

[2] 甘俊英, 戚玲, 项俐. 轻量化多特征融合的指纹分类算法研究[J]. 信号处理, 2019, 35(5): 888- 896.

Gan Junying, Qi Ling, Xiang Li, et al. Research on Lightweight Multi-feature Fusion Fingerprint Classification Algorithm[J]. Journal of Signal Processing, 2019, 35(5): 888- 896.(in Chinese)

[3] Mu ktar D, Jamel S, Ramli S N, et al. 2D legendre wavelet filter for iris recognition feature extraction[C]∥Proceedings of the 3rd International Conference on Cryptography, Security and Privacy, New York. United States. IEEE, 2019: 174-178.

[4] Ahmed S, EL Sayed, M I Roushdy, et al. Masked SIFT with align-based refinement for contactless palm-print recognition[J]. Iet Biometrics, 2019, 8(2): 150-158.

[5] Biswas S, Solanki S S. Speaker recognition: an enhanced approach to identify singer voice using neural network[J]. International Journal of Speech Technology, 2020(4): 1-13.

[6] Guillemot C, Le Meur O. Image Inpainting: Overview and Recent Advances[J]. IEEE Signal Processing Magazine, 2014, 31(1): 127-144.

[7] Chen Qiaochuan, Li Guangyao, Xie Li, et al. Structure guided image completion using texture synthesis and region segmentation[J]. Optik, 2019, 18(5): 896-909.

[8] Yu Jiahui, Lin Zhe, Yang Jimei, et al. Generative Image Inpainting with Contextual Attention[EB/OL]. arXiv: 1801.07892, 2018.01.

[9] Oord A V D, Kalchbrenner N, Kavukcuoglu K. Pixel Recurrent Neural Networks[EB/OL]. arXiv: 1601.06759, 2016.01.

[10] Shivkumar V. Analysis of retinal vessel networks using quantitative descriptors of vascular morphology[J]. Dissertations & Theses-Gradworks, 2012: 150-164.

[11] Al-Diri B, Hunter A, Steel D, et al. Joining retinal vessel segments[C]∥IEEE International Conference on Bioinformatics & Bioengineering, Athens, Greece: IEEE, 2008: 1- 6.

[12] Caliva F, Hunter A, Chudzik P, et al. A fluid-dynamic based approach to reconnect the retinal vessels in fundus photography[C]∥2017 39th Annual International Conference of the IEEE Engineering in Medicine and Biology Society (EMBC), Seogwipo: IEEE, 2017: 360-364.

[13] 贾桂敏, 李振娟, 杨金锋, 等. 手指静脉红外图像血管网络修复新方法[J]. 红外与激光工程, 2019, 48(4): 319-325.

Jia Guimin, Li Zhenjuan, Yang Jinfeng, et al. Novel vascular network restoration method for finger-vein IR images[J]. Infrared and Laser Engineering, 2019, 48(4): 319-325.

[14] 李振娟, 贾桂敏, 杨金锋, 等. 手指静脉图像血管网分形修复方法[J]. 信号处理, 2019, 35(8): 1334-1342.

Li Zhenjuan, Jia Guimin, Yang Jinfeng, et al. Vascular Network Restoration Method for Finger-vein Images Based on Fractal[J]. Journal of Signal Processing, 2019, 35(8): 1334-1342.(in Chinese)

[15] Goodfellow I J, Pouget-Abadie J, Mirza M, et al. Generative Adversarial Networks[J]. Advances in Neural Information Processing Systems, 2014(3): 2672-2680.

[16] Yu F, Koltun V. Multi-Scale Context Aggregation by Dilated Convolutions[J]. arXiv: 1511.07122[cs], 2016.

[17] Buades A, Coll B, Morel J. A non-local algorithm for image denoising[C]∥2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition, San Diego, CA, USA: IEEE, 2005: 60- 65.

[18] Wang Xiaolong, Girshick R, Gupta A, et al. Non-local Neural Networks[C]∥2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). IEEE,2018.

[19] Zhang Han, Goodfellow I, Metaxas D, et al. Self-Attention Generative Adversarial Networks[EB/OL]. arXiv: 1805.08318, 2018.05.

[20] Iizuka S, Simo-Serra E, Ishikawa H. Globally and locally consistent image completion[J]. ACM Transactions on Graphics, 2017, 36(4): 1-14.

[21] Justin J, Alexandre A, Li Feifei. Perceptual Losses for Real-Time Style Transfer and Super-Resolution[EB/OL]. arXiv: 1603.08155[cs], 2016.03.

[22] Database P P. PolyU Palmprint database[EB/OL]. http:∥www.comp.polyu.edu.hk/~biometrics/MultispectralPalmprint/MSP.htm.

[23] Singh O P, Dey S, Samanta D. Fingerprint indexing using minutiae-based invariable set of multidimensional features[J]. International Journal of Biometrics, 2014, 6(3): 272-303.

[24] Barnes C, Shechtman E, Finkelstein A, et al. PatchMatch: a randomized correspondence algorithm for structural image editing[J]. ACM Transactions on Graphics, 2009, 28(3): 1326-1330.

[25] Radford A, Metz L, Chintala S. Unsupervised Representation Learning with Deep Convolutional Generative Adversarial Networks[EB/OL]. arXiv: 1511.06434.2016, 2015.11.

[26] Pathak D, Krähenbühl P, Donahue J, et al. Context Encoders: Feature Learning by Inpainting[C]∥2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, NV: IEEE, 2016: 2536-2544.

[27] Yoo J C, Ahn C W. Image matching using peak signal-to-noise ratio-based occlusion detection[J]. Image Processing, IET, 2012, 6(5): 483- 495.

[28] Otero D, La Torre D, Michailovich O, et al. Optimization of Structural Similarity in Mathematical Imaging[EB/OL]. arXiv: 2002.02657, 2020.02.

[29] Rathgeb C, Wagner J, Busch C. SIFT-based iris recognition revisited: prerequisites, advantages and improvements[J]. Pattern Analysis & Applications, 2019, 22(3): 889-906.

[30] Li Fei, Li Xiaoxia, Zhou Yingyue, et al. Finger vein recognition based on improved HOG features and sparse representation[J]. Transducer and Microsystem Technologies, 2018, 37(11): 38- 44.

[31] Wu Ling, Liu Sheng. Comparative analysis and application of LBP face image recognition algorithms[J]. International Journal of Communication Systems, 2019(12): 3970-3977.

[32] Pan Zaiyu, Wang Jun, Shen Zhengwen, et al. Multi-Layer Convolutional Features Concatenation With Semantic Feature Selector for Vein Recognition[J]. IEEE Access, 2019(7): 90608-90619.