1 引言

基于光学遥感图像的飞机检测一直是遥感目标识别领域的研究热点,无论是在民用领域还是军用领域,飞机都是一种十分重要的战略目标。随着光学遥感图像分辨率的提高,单幅遥感图像的尺寸显著增大,使得相应的飞机检测数据处理技术难以适应资源受限下星上在轨处理的需求。

为了实现光学遥感图像中的飞机目标检测,研究学者们相继提出许多有价值的目标检测方法[1-12]。这些检测方法通常分为两大类:传统目标检测方法和深度学习目标检测方法。传统的遥感图像目标检测算法[1- 4]采用的特征大多数是局限于“像素级”初级手工特征,在复杂背景干扰下(例如云、光照等)很难具有良好的表征力度与可分性,容易造成虚警。近年来,随着深度学习的发展,深度学习目标检测方法被广泛应用于遥感图像目检测领域中[5-11]。例如赵丹新等人[5]采用了基于ResNet-101预训练模型的SSD框架来克服遥感影像中目标方向、拍摄角度及场景的多样性导致飞机目标检测精度不高的问题;戴伟聪等人[7]提出遥感图像飞机的改进YOLOv3实时检测算法;徐月丽等人在Faster RCNN基础上增加多层特征融合模块来解决飞机小目标的检测问题[8]。然而这类方法都采用基于ImageNet数据库上预训练网络模型作为检测的骨干网络。该方法存在以下缺点:(1)基于ImageNet分类数据库的预训练模型(VGG16, DenseNet121,ResNet101等)往往参数量大,计算复杂度高,难以直接在资源受限下的星上部署;(2)直接将这些预训练模型用于检测任务中,导致其模型结构灵活性差,难以改变网络结构,限制其应用场合。

考虑到星载平台资源受限和飞机尺寸小的难点,本文提出一种具有检测率高、计算复杂度低等特点的轻量级飞机目标深度学习检测方法,本文的工作主要包含以下两点:(1)以SSD的目标检测框架[12]为基础,采用了密集连接双卷积通道和Inception模块的初始单元来设计轻量化骨干基础网络,该网络具有强梯度流、多尺度特征重复利用和计算效率高的特点;(2)在轻量化骨干网络基础上,利用残差模块和反卷积构成多尺度特征融合的预测定位模块。该模块具有融合浅层特征空间分辨率高和高层特征判别能力强的优势,来增强网络特征表达能力,以达到提高飞机小目标检测精度的目的。

2 本文检测方法

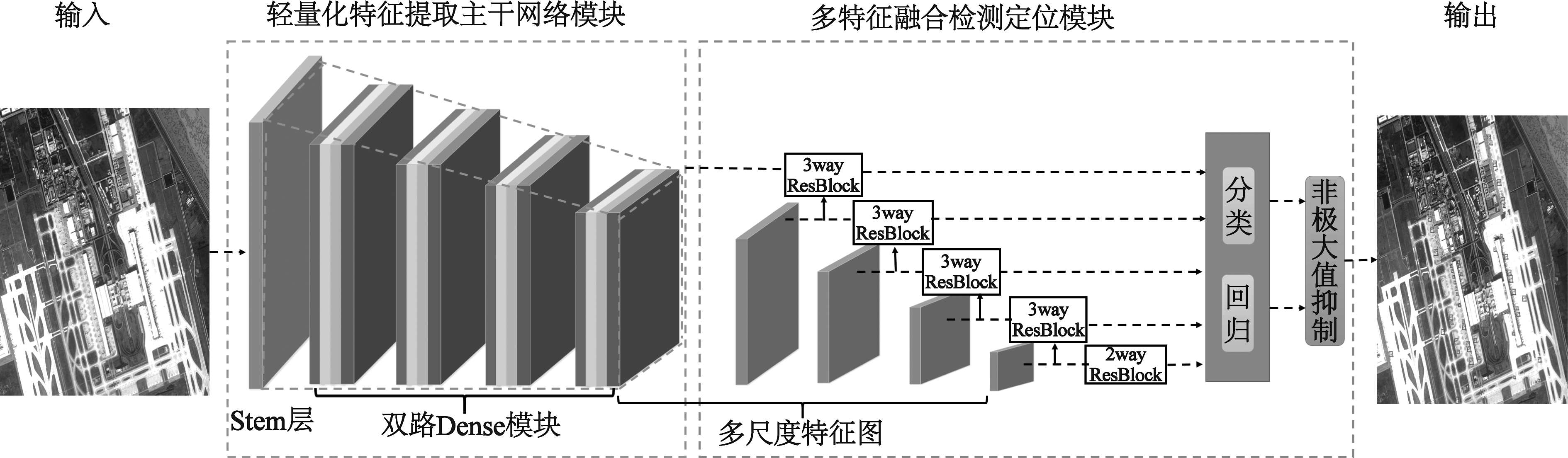

本文的检测网络结构如图1所示,该检测网络由两个模块组成:主干特征提取模块和检测定位模块。主干特征提取模块遵循了DenseNet[13]网络沿通道维度串联的结构特点,使得每一层与它的所有后续层直接连接,特征可重复利用,不需要学习冗余的特征,从而降低参数量,保持网络精简高效。并且在其基础上增加了双路卷积通道方式,从而得到不同尺度的感受野;检测定位模块沿用了SSD多尺度锚点框检测机制,并在其基础上加入3way-ResNet模块,把多尺度特征进行融合,增强特征的表达能力,从而检测多尺度飞机目标。

2.1 轻量化特征提取主干网络

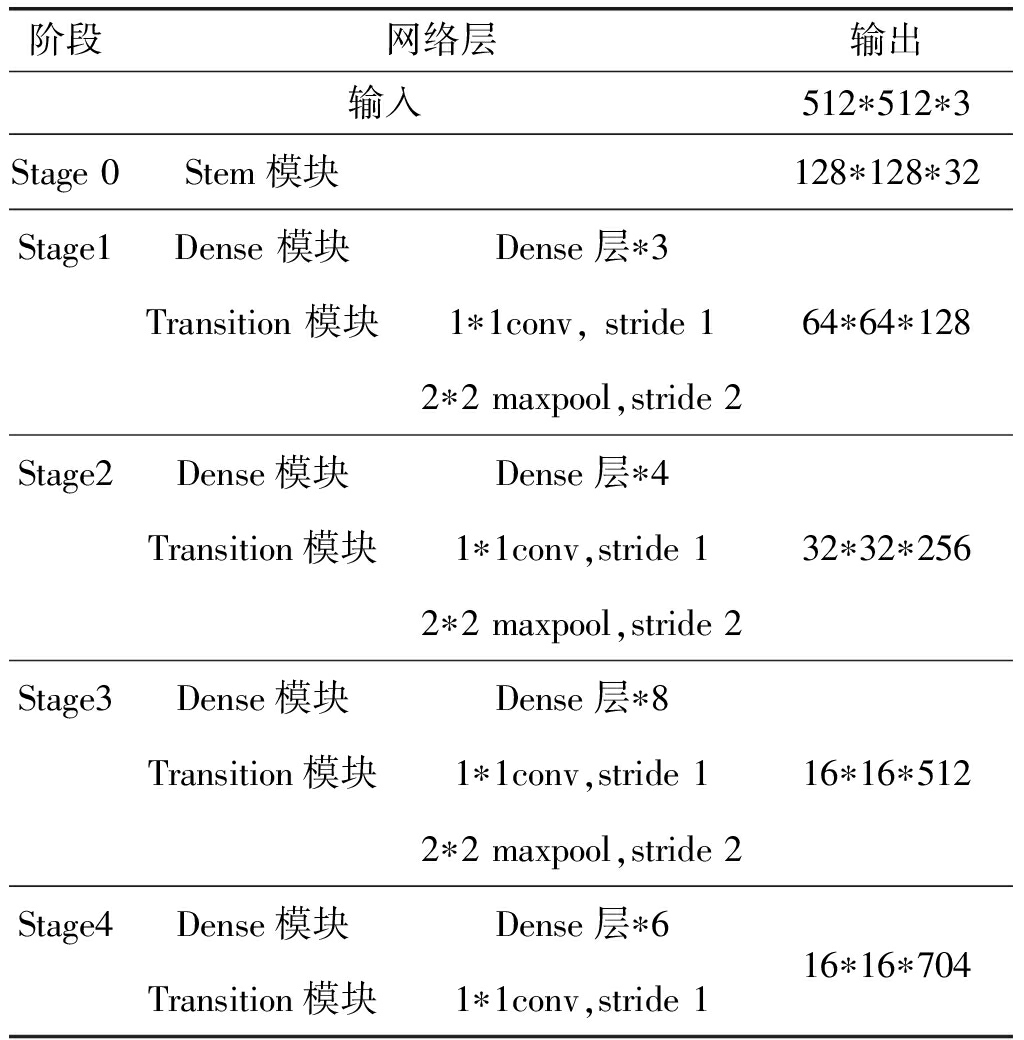

本文的骨干网络由三部分构成:Stem模块、双路卷积密集连接(Two-way Dense)模块和传输层(Transition Layer),其网络结构参数列表如表1所示。下面我们将分别来介绍:

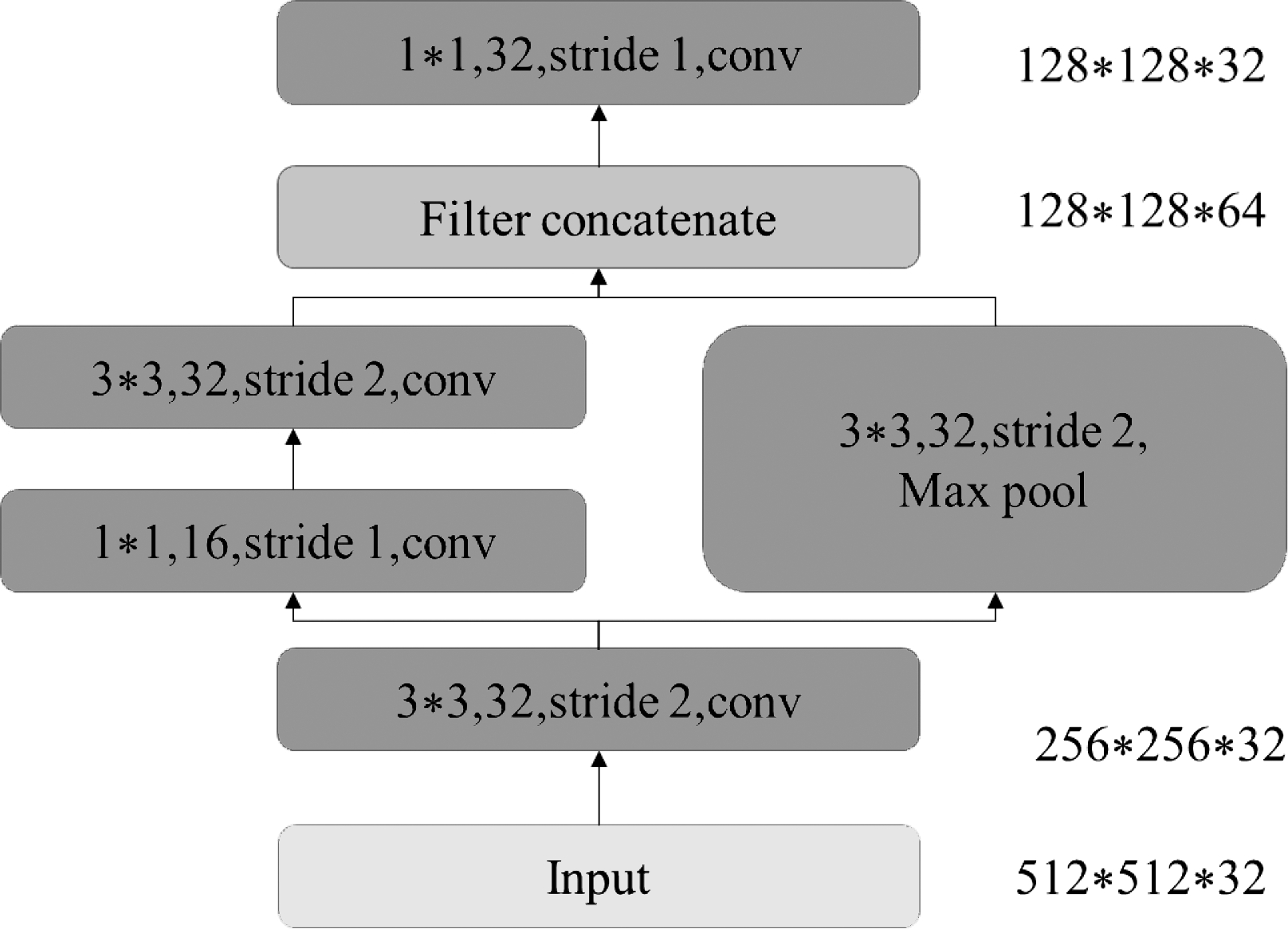

Stem模块:受多尺度卷积的Inceptionv4[14]结构启发,我们在Two-way Dense模块前,设计了一种精简有效的Stem模块,其示意图如图2所示。Stem模块借鉴了Inception多尺度的思想,其结构中包含了3*3卷积和最大池化,增加了网络对不同尺度的适应性,并且增加1*1的卷积操作用于降低通道维数的同时也提高了网络表达能力。因此,与传统在初始层的基础上逐层增加网络层数方法相比,Stem模块在不增加计算复杂度的前提下,能够有效提高特征表达能力。

图1 轻量化检测模块网络结构示意图

Fig.1 The Lightweight aircraft detection network architecture

表1 主干网络结构参数列表

Tab.1 The backbone network structure parameters

阶段网络层输出输入512∗512∗3Stage 0Stem模块128∗128∗32Stage1Dense 模块Dense层∗3Transition 模块1∗1conv, stride 164∗64∗1282∗2 maxpool,stride 2Stage2Dense模块Dense层∗4Transition模块1∗1conv,stride 132∗32∗2562∗2 maxpool,stride 2Stage3Dense模块Dense层∗8Transition模块1∗1conv,stride 116∗16∗5122∗2 maxpool,stride 2Stage4Dense模块Dense层∗616∗16∗704Transition模块1∗1conv,stride 1

图2 stem模块示意图

Fig.2 The stem block structure

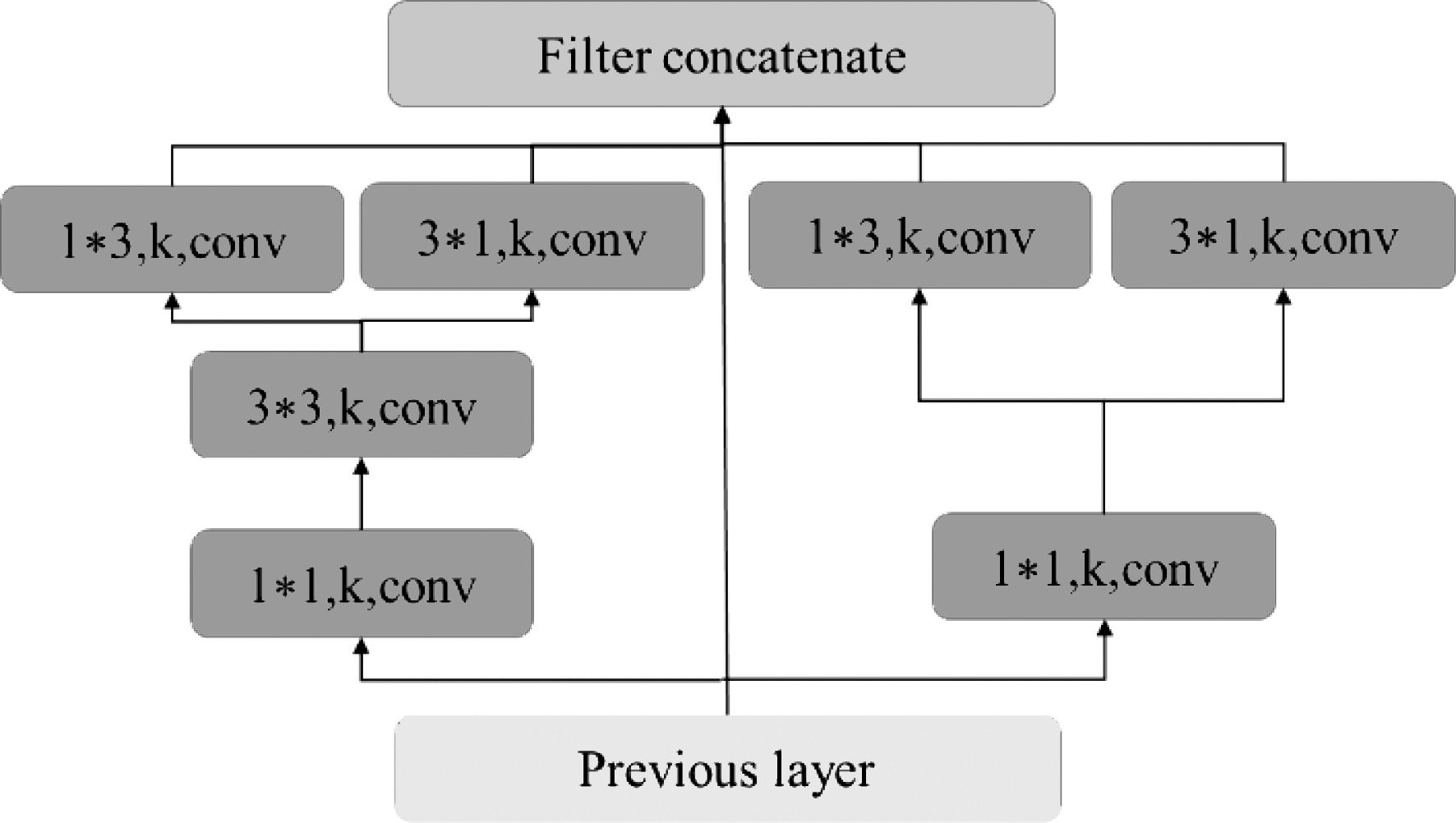

Two-way Dense模块:我们借鉴Inceptionv3网络[13]多通道卷积结构和空间非对称卷积的思想设计两层密集连接层,来获得多尺度的感受野。一路卷积通道使用了小尺度3*3卷积核来提取尺寸小的飞机目标特征,其中为了降低3*3卷积的计算复杂度,我们将3*3卷积分成非对称卷积核:1*3和3*1卷积;另一路卷积通道使用了两层堆积式的3*3卷积核来学习尺度大的飞机视觉模板,其中最后的3*3卷积也采用了非对称卷积核方式。Two-way Dense模块的示意图如图3所示。

图3 Two-way Dense模块示意图

Fig.3 The Two-way Dense block structure

Transition模块:Transition模块的主要作用是保证特征图下采样的同时,并使用1*1卷积操作降低Two-way Dense模块传递的特征通道数。在本文的网络设计中,Transition模块包含批量BN层和1*1卷积层,接着是2*2平均池化层。

2.2 多尺度特征融合的检测模块

为了适应多尺度飞机目标的检测,本文继承SSD目标检测的多尺度特征检测结构,在轻量化特征提取主干网络之后构建多种尺度的卷积层来用于分类和检测。在这里,为了减少计算量,本文采用4种尺度特征图(32*32,16*16,8*8,4*4)做检测。考虑到SSD目标检测方法虽然能够检测到多尺度目标,但是具有高分辨率的浅层特征不具有充分的特征表达能力且每种尺度特征图的检测互相独立,导致对尺度小的目标往往检测效果不佳。

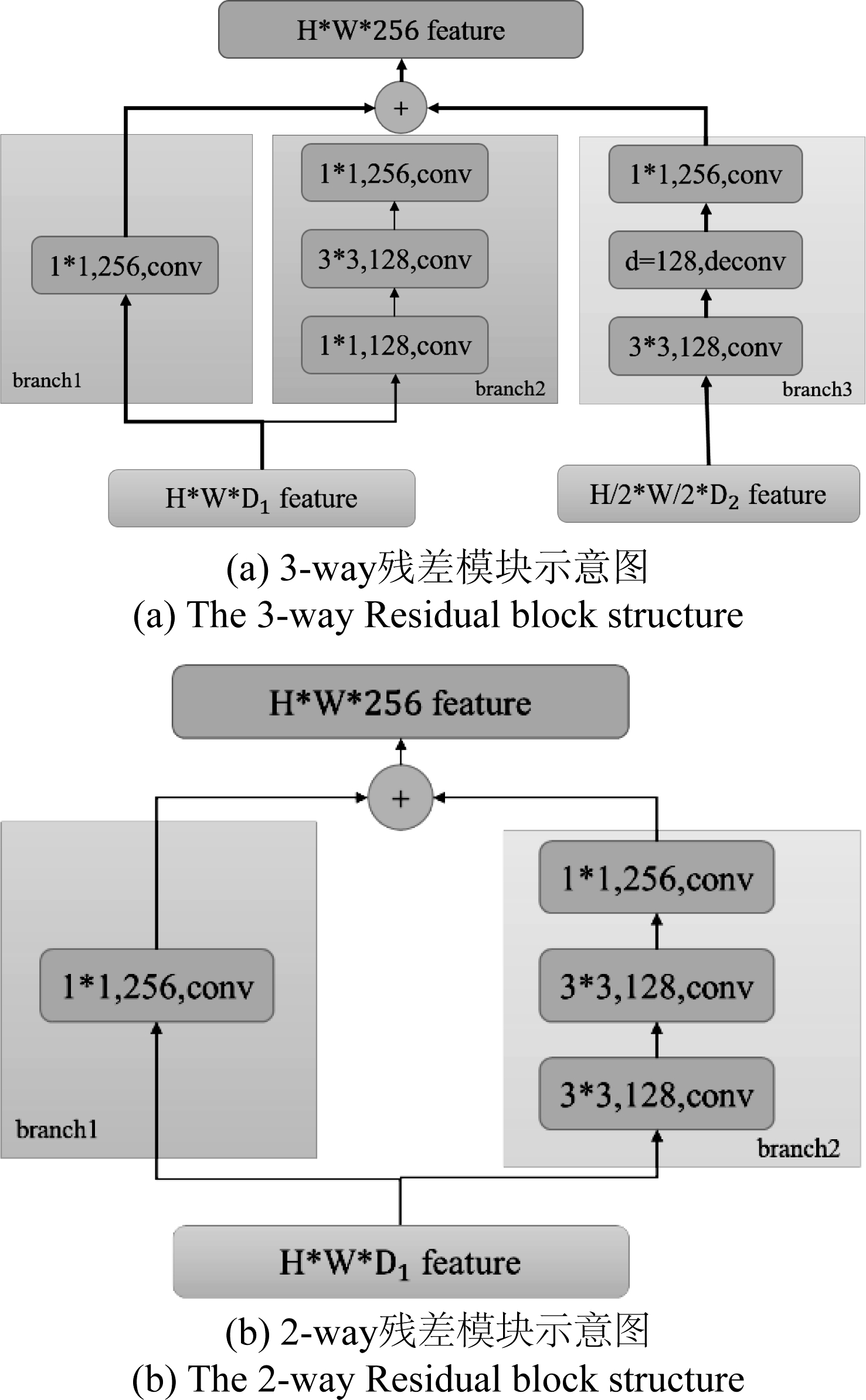

针对上述问题,我们采用了残差模块和反卷积模块构成了多尺度特征融合模块(3-way 残差模块),并且将其嵌入到检测模块的每种尺度特征下,该模块的示意图如图4所示。3-way 残差模块分为branch1,branch2和branch3三条支路,其中branch1采用1*1卷积核作为残差模块的快捷连接,该结构能够缓解梯度消失问题,保持从预测损失函数传来的梯度能够直接进入主干网络中;为了增强浅层特征的表达能力,本文使用了3*3卷积核作为残差模块branch2支路。branch2支路具有较高的感受野,能够提取小目标的周围环境信息,提升小目标的检测性能;branch3支路里面包含3*3卷积和反卷积,其作用将浅层特征与之接近的高层特征进行融合,增强高空间分辨率浅层特征的表达能力,使得目标与背景易于区分。

图4 残差模块示意图

Fig.4 Residual block structure

3 实验与分析

3.1 数据集与训练参数

本文从谷歌地球上收集1001张2 m分辨率机场场景的光学遥感图像来建立数据库,其中每张图像的大小为4000*4000。我们选取700张图像进行训练,用300张图像来验证本文提出算法的性能。为了方便训练,大尺度的机场场景图像均被切成512*512像素的切片,并且将含有飞机目标的切片作为训练数据来进行网络训练。

本文的算法所使用的深度学习框架为CAFFE框架,训练与测试所用的平台是Ubuntu16.04,Titan XP GPU。实验中,本文模型训练的初始学习率为0.005,梯度下降的方式选取随机梯度下降,动量为0.9,权值衰减率为0.0005,每次处理32张512*512的切片,最大迭代次数为12万次。

3.2 实验结果与分析

3.2.1 探究模型主要结构参数对检测性能的影响

为了展示本文算法所采用的策略对飞机目标检测性能的影响,本文分别针对定位特征图的选取、3-way残差模块以及用于预测的卷积核尺寸做了充分的实验。并且,我们采用了模型运算次数(FLOPS),参数量(parameters),检测率和虚警率四种指标来考核各个设计对性能的影响。这四种指标的公式分别如下式所示:

检测率![]()

(1)

虚警率![]()

(2)

(3)

![]()

(4)

式(3)与式(4)中,D代表神经网络所具有的网络层数,l代表神经网络的第l个卷积层,Ml代表神经网络第l个卷积层的输出特征图的边长,Kl代表神经网络第l个卷积层的卷积核的边长,Cl代表神经网络第l个卷积层的输出通道数,Cl-1代表神经网络第l个卷积层的输入通道数。

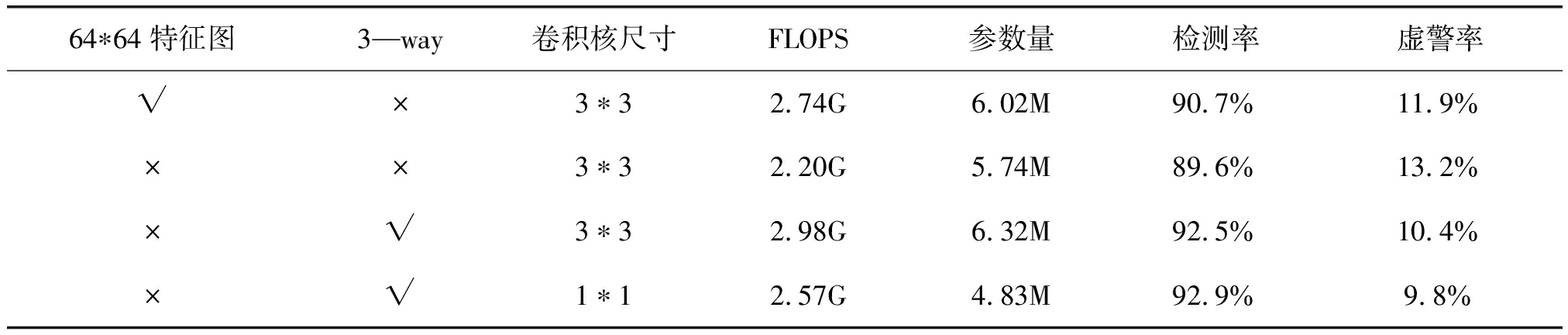

(1)不同设计选择对性能的影响:实验结果如表2所示,从表2中看出,与不加3-way残差模块相比,检测网络加入3-way残差模块之后,虽然会增加少量的计算复杂度,但性能会提高将近3%左右;通过对比发现,不加入64*64特征图的检测性能与加入64*64特征图检测相比,计算复杂度低,且性能相当。主要是由于64*64特征图在网络中深度较浅,判别能力弱,对飞机目标检测性能贡献度不高;在用于预测的卷积核大小设计方面,使用1*1卷积核与使用3*3的卷积核性能相当,但计算复杂度比使用3*3的网络要低,因此在本文中,选择1*1作为用于预测的卷积核。

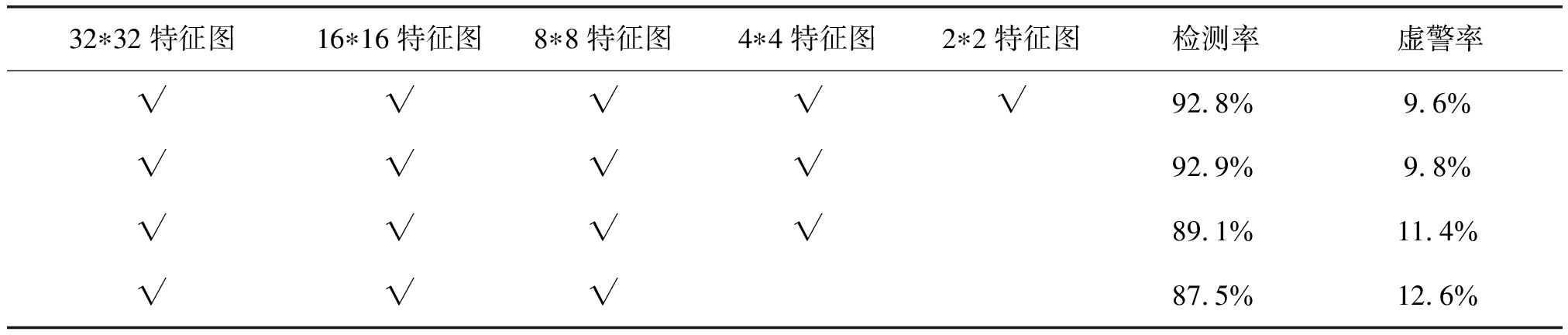

(2)不同特征层对性能的影响:由表3的实验结果可以看出,选择32*32,16*16,8*8,4*4这四组特征层进行定位时,检测的性能达到最佳。再增加特征层并没有带来性能的提升,在两米分辨率下,飞机的图像像素小于30*30像素,在2*2特征层上几乎没有空间信息保留,无法准确定位。额外融合特征层反而带来候选框的冗余,因此本文算法中所选择的特征层是合理的。

表2 各种设计选择对性能的影响

Tab.2 Effects of various design choices and components on performance

64∗64特征图3—way卷积核尺寸FLOPS参数量检测率虚警率√×3∗32.74G6.02M90.7%11.9%××3∗32.20G5.74M89.6%13.2%×√3∗32.98G6.32M92.5%10.4%×√1∗12.57G4.83M92.9%9.8%

表3 不同特征图的选择对性能的影响

Tab.3 Effect of selection of different feature maps on performance

32∗32特征图16∗16特征图8∗8特征图4∗4特征图2∗2特征图检测率虚警率√√√√√92.8%9.6%√√√√92.9%9.8%√√√√89.1%11.4%√√√87.5%12.6%

3.2.2 与其他目标检测模型进行比较

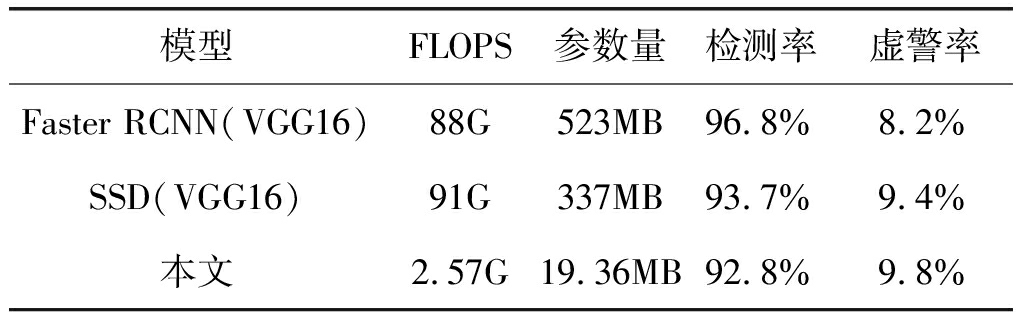

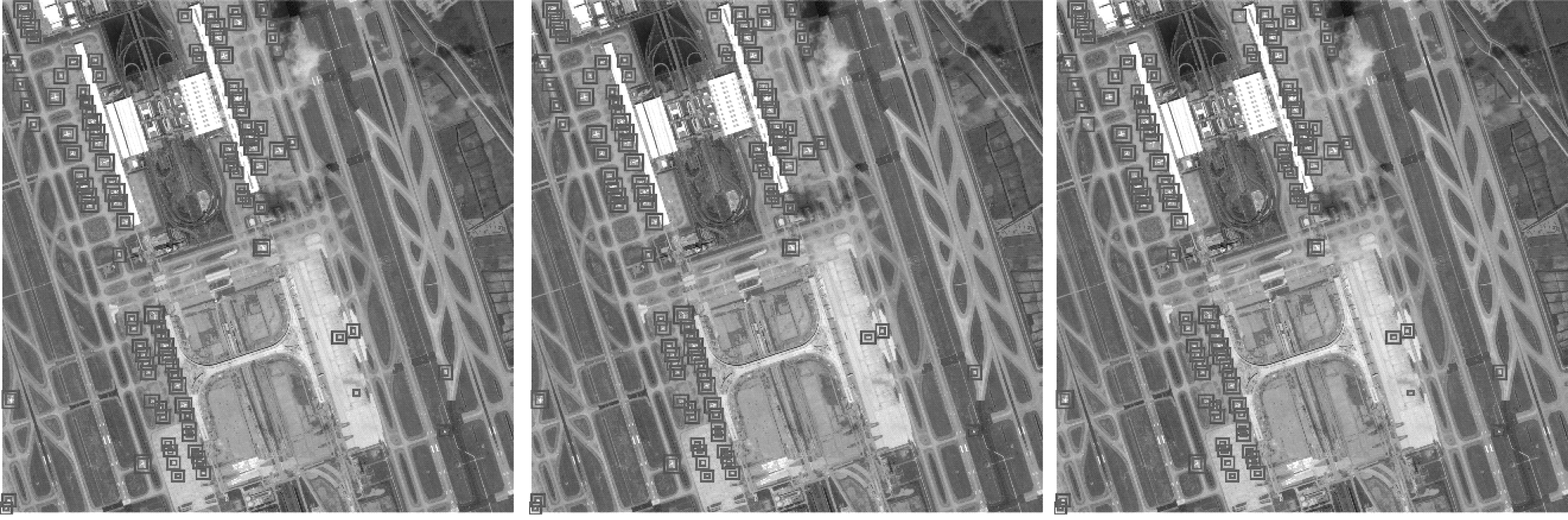

为了证明本文提出的轻量化检测网络的有效性,本文与当前主流的深度学习目标检测方法如Faster Rcnn、SSD(VGG16)进行比较。使用相同的测试数据集分别对这两种方法进行训练和测试,检测结果如表4和图5所示。

表4 与经典深度学习目标检测模型的比较

Tab.4 Comparison with classic deep learning

object detection model

模型FLOPS参数量检测率虚警率Faster RCNN(VGG16)88G523MB96.8%8.2%SSD(VGG16)91G337MB93.7%9.4%本文2.57G19.36MB92.8%9.8%

从表4和图5不同模型检测结果可以看出,本文所提出的检测模型计算复杂度比上述四种方法的计算复杂度低,且检测性能与SSD(VGG16)、 Faster Rcnn(VGG16)接近。本文方法的计算复杂度与SSD(VGG16)相比,在保持飞机目标检测性能前提下,计算复杂度实现了近30倍的压缩。

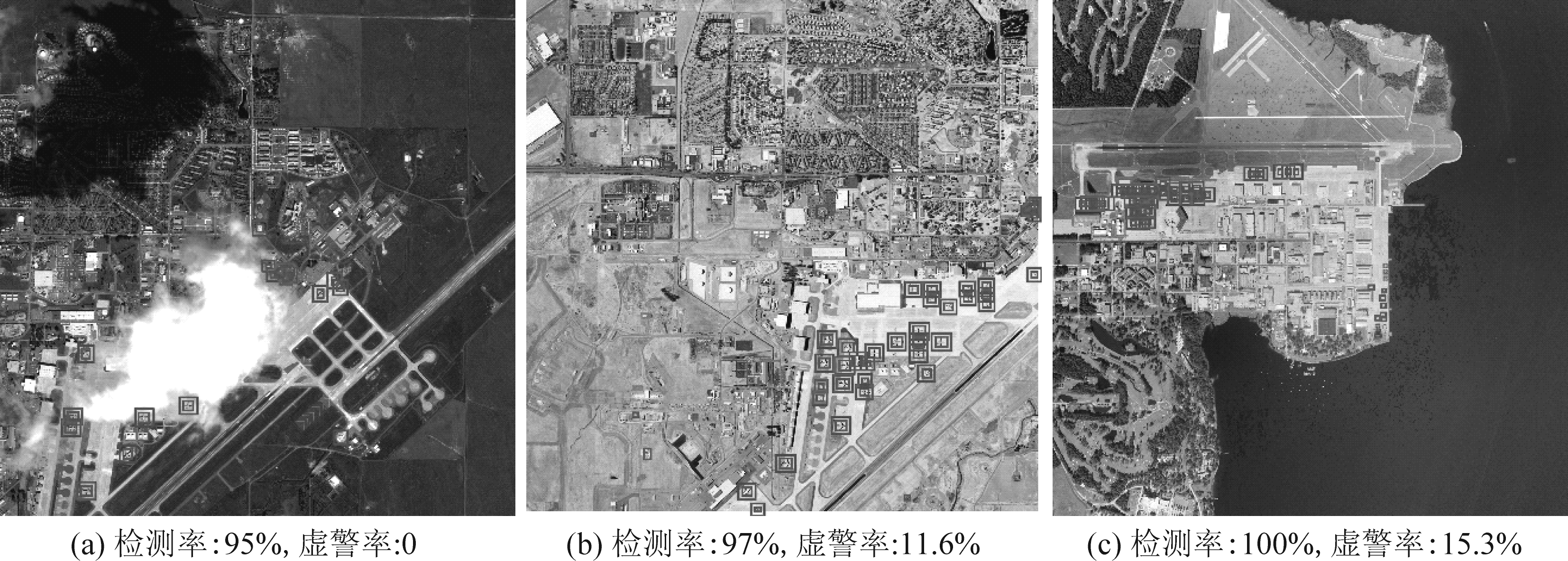

3.2.3 检测结果展示

为了直接展示本文提出算法的检测性能,本文在多种不同机场场景进行测试,测试结果如图6所示。由检测结果可以看出,本文提出的模型在云干扰场景,飞机密集停靠的区域以及稀疏停靠的场景具有较好的检测性能,实验结果证明了本文设计的模型具有一定的有效性。

图5 各个方法的检测结果。(红色:groudtruth;绿色:检测结果)

Fig.5 Test results for each method.(red: groudtruth; green: detect result)

图6 本文的检测结果图

Fig.6 The detection result of our method

4 结论

面向飞机目标检测星上处理应用,本文提出了一种轻量化的飞机目标检测深度学习模型的新思路。该模型首先利用DenseNet的密集连接结构和双路卷积模块构成具有高效、轻量化的基础骨干网络,之后利用残差结构和反卷积构成特征融合模块,以便于多尺度飞机目标定位。实验结果表明,本文的目标检测模型与当前的主流深度学习目标检测方法相比,不仅计算复杂度低,且飞机检测的准确率与其接近。

[1] 姚远, 姜志国, 张浩鹏. 基于层次化分类器的遥感图像飞机目标检测[J]. 航天返回与遥感, 2014, 35(5): 88-94.

Yao Y, Jiang Z G, Zhang H P. Remote Sensing Image Aircraft Target Detection Based on Hierarchical Classifier[J]. Space Revolving and Remote Sensing, 2014, 35(5): 88-94.(in Chinese)

[2] 李士进, 仇建斌, 於慧. 基于视觉单词选择的高分辨率遥感图像飞机目标检测[J]. 数据采集与处理, 2014, 29(1): 60- 65.

Li S J, Qiu J B, Yu H. Aircraft Target Detection Based on High Resolution Remote Sensing Image Based on Visual Word Selection[J]. Data Acquisition and Processing, 2014, 29(1): 60- 65.(in Chinese)

[3] 曾接贤, 付俊, 符祥. 特征点和不变矩结合的遥感图像飞机目标识别[J]. 中国图象图形学报, 2014, 19(4): 592- 602.

Zeng J X, Fu J, Fu X. Aircraft Target Recognition of Remote Sensing Images Combined with Feature Points and Invariant Moments[J]. Journal of Image and Graphics, 2014, 19(4): 592- 602.(in Chinese)

[4] 吴喆, 曾接贤, 高琪琪. 显著图和多特征结合的遥感图像飞机目标识别[J]. 中国图象图形学报, 2017, 22(4): 532-541.

Wu Z, Zeng J X, Gao Q Q. Aircraft target recognition in remote sensing images based on saliency images and multi-feature combination[J]. Journal of Image and Graphics, 2017, 22(4): 532-541.(in Chinese)

[5] 赵丹新, 孙胜利. 基于ResNet的遥感图像飞机目标检测新方法[J]. 电子设计工程, 2018, 26(22): 164-168.

Zhao D X, Sun S L. A new method for aircraft target detection based on ResNet for remote sensing image[J]. Electronic Design Engineering, 2018, 26(22): 164-168.(in Chinese)

[6] 于丽, 刘坤, 于晟焘. 基于密集卷积神经网络的遥感飞机识别[J]. 计算机工程与应用, 2018, 54(19): 179-185.

Yu Li, Liu Kun, Yu Shengtao. Remote sensing aircraft recognition based on densely connected convolution neural network[J]. CEA, 2018, 54(19): 179-185.(in Chinese)

[7] 戴伟聪, 金龙旭, 李国宁, 等. 遥感图像中飞机的改进YOLOv3实时检测算法[J]. 光电工程, 2018, 45(12): 180350.

Dai W C, Jin L X, Li G N, et al. Improved YOLOv3 Real-Time Detection Algorithm for Aircraft in Remote Sensing Images[J]. Optoelectronic Engineering, 2018, 45(12): 180350.(in Chinese)

[8] 王金传, 谭喜成, 王召海, 等. 基于Faster R-CNN深度网络的遥感影像目标识别方法研究[J]. 地球信息科学学报, 2018, 20(10): 1500-1508.

Wang J C, Tan X C, Wang Z H, et al. Research on Remote Sensing Image Target Recognition Method Based on Faster R-CNN Depth Network[J]. Journal of Earth Sciences, 2018, 20(10): 1500-1508.(in Chinese)

[9] Yang Y, Zhuang Y, Bi F, et al. M-FCN: Effective Fully Convolutional Network-Based Airplane Detection Framework[J]. IEEE Geoscience and Remote Sensing Letters, 2017: 1-5.

[10] Yang J, Zhu Y, Jiang B, et al. Aircraft detection in remote sensing images based on a deep residual network and Super-Vector coding[J]. Remote Sensing Letters, 2018, 9(3): 229-237.

[11] Xu Y, Zhu M, Peng X, et al. Rapid Airplane Detection in Remote Sensing Images Based on Multilayer Feature Fusion in Fully Convolutional Neural Networks[J]. Sensors, 2018, 18(7).

[12] Shen Z, Liu Z, Li J, et al. DSOD: Learning Deeply Supervised Object Detectors from Scratch[C]∥ICCV, 2017: 1937-1945.

[13] Szegedy C, Vanhoucke V, Ioffe S, et al. Rethinking the Inception Architecture for Computer Vision[C]∥CVPR, 2016: 2818-2826.

[14] Szegedy C, Ioffe S, Vanhoucke V, et al. Inception-v4, Inception-ResNet and the Impact of Residual Connections on Learning[C]∥CVPR, 2016.