1 引言

织物产品的颜色设计在纺织服装生产环节中有着举足轻重的地位,历来受到研究人员的重视。随着计算机视觉和多媒体技术的迅猛发展,面料设计师开始借助于色彩转移[1-5]技术来完成繁重的织物图像颜色风格设计任务。色彩转移是近年来计算机视觉领域中的一个新兴研究方向,它是基于参考颜色和目标图像合成结果图像的重要技术。在色彩转移过程中,参考颜色为结果图像提供颜色风格信息,目标图像为结果图像提供结构信息,而新合成的结果图像则同时具有参考颜色的风格特征和目标图像的结构特征。其中,参考颜色可以由参考图像、颜色主题和主观定义等多种方式提供。设计师利用色彩转移技术设计织物颜色风格时,通常先初步设计一个织物图像(称为原织物图像),然后选择合适的参考颜色并将其转移到原织物图像,由此得到设计好的织物图像。传统的织物图像色彩转移方法往往存在算法复杂度高、结果图像不能很好地保留原织物图像的层次感和细节等问题。

针对上述问题,文中结合显著颜色提取和图像分解提出了一种新的织物图像防溢出色彩转移方法。仿真结果表明,相对于传统方法,文中所提方法不仅具有简单、高效的特点,而且在保护织物图像的层次感和细节方面有着更好的表现。

2 相关工作

文献[5]中, Reinhard首次提出了一种色彩转移方法。为了减少不同颜色通道间的相互干扰, 该方法将参考图像和目标图像从颜色通道相关性较强的RGB空间转换到颜色通道近似独立的lαβ空间,并通过一组简单的线性变换得到合成图像的lαβ值,以此达到色彩转移的目的。文献[6]利用情感信息和纹理特征来引导参考图像与目标图像的匹配,较好地实现了参考图像的颜色和纹理向目标图像的转移。然而,整体色调相似的参考图像,其颜色统计特性往往存在较大差异,上述方法通常需要花费较多的精力来选择参考图像以得到满意的效果。近年来,深度学习技术也被部分学者用于色彩转移。例如,文献[7]设计了一种基于视觉语义引导的全卷积神经网络来完成色彩转移任务。虽然基于深度学习的方法能够取得较好的效果,但对应的网络通常结构较为复杂且需要收集大规模的样本进行训练。因此,这类方法一般比较耗时。此外,文献[8-9]中,结果图像的颜色由用户主观定义。由于织物图像的图案通常较为复杂且包含大量纹理细节,多数用户往往没有足够的审美知识,难以正确地使用颜色所包含的内在语义来表达相应的情感。

为了更好地规范颜色的内在含义,文献[10]详细地讨论了单一颜色的语义,文献[11]进一步系统地探讨了不同颜色组合所包含的内在语义,并提出了颜色主题的概念。一个颜色主题通常由几种固定的颜色等比组成,它能够用来表达某种特定的语义,如冷暖、情绪、时尚、季节等。目前,研究人员已经建立起了众多的颜色主题数据库[11]。考虑到颜色主题能够较好地表达各种颜色组合所包含的内在语义,近年来,面料设计师在设计织物图像的颜色风格时,色彩转移所需要的参考颜色大都采用数据库中的颜色主题。因此,文中重点关注基于颜色主题的织物图像色彩转移问题。

文献[12]结合图像分割,在变分[13]框架下提出了一种基于颜色主题的织物图像色彩转移方法,该方法包括3个阶段。在第一阶段,利用改进的MFRC图像分割模型[14]将原织物图像分割成N个区域,同时得到各区域的颜色均值和每个像素点偏离相应区域颜色均值的偏场函数。其中,各分割区域的颜色均值被看做是原织物图像的N个主要颜色。在第二阶段,从颜色主题数据库选择合适的颜色主题,以亮度排序为准则用颜色主题中的N个颜色替换原织物图像的N个主要颜色,得到新的分割图。最后,由新的分割图和偏场函数重构出色彩转移后的织物图像。由于织物图像中存在大量的纹理细节,一定程度上影响了图像分割效果,导致该方法得到的结果图像不同程度地存在细节模糊的问题。为此,文献[15]在文献[12]方法的基础上引入图像分解,提出了一种经典的织物图像色彩转移方法。与文献[12]方法不同的是,文献[15]的方法在第一阶段将图像分解与分割耦合成一个统一的模型,并由此得到原织物图像的纹理部分、卡通部分的N区域分割图、卡通部分各分割区域的颜色均值和偏场函数。其中,卡通部分N个分割区域的颜色均值被近似地看作原织物图像的N个主要颜色。在第二阶段,将新的颜色主题以亮度排序为准则替换卡通部分N个分割区域的颜色均值,得到新的卡通部分分割图。在第三阶段,由原织物图像的纹理部分、新的卡通部分分割图和偏场函数重构得到结果图像。该方法的核心是将织物图像的纹理部分提取出来,而仅对织物图像的卡通部分进行色彩转移,以此来达到保护结果图像细节的目的。该方法虽然取得了一定的效果,但仍然存在部分瑕疵有待改进。

图1所示是N=5时文献[15]方法进行织物图像色彩转移的示例。图1(a)是原织物图像,图1(c)是从图1(a)提取的5种主要颜色,图1(d)是名为“Enchante”的颜色主题,图1(b)是用图1(d)所示颜色主题进行色彩转移的结果图像,图1(e)和( f )分别是图1(a)和(b)左下角区域的局部放大图。

图1 文献[15]方法进行色彩转移的示意图

Fig.1 The color transfer results obtained from the work in [15]

由图1(c)可知,文献[15]方法提取的主要颜色差异性较小,原织物图中一些显著区域的颜色并没有提取出来。相较于图1(a),图1(b)并没有很好地反映出原织物图像的层次结构,一些显著区域在图1(b)中没能得到很好的体现。造成上述问题的原因主要是该方法在第一阶段提取的是原织物图像的几种最主要颜色,而这些颜色之间往往比较接近,区分度较小,从而给图像分割带来不利影响,并容易导致结果图像的层次感与原织物图像的存在较大差异。比较图1(e)和( f )可知,图1( f )的左上角区域中出现了明显的细节模糊。这主要是因为该方法在第三阶段重构织物图像的时候没有处理好像素值溢出的问题,从而导致结果图像的部分区域出现了细节丢失。另外,该方法在第一阶段将图像分解与分割耦合在一个统一的模型里,其复杂度相对较高,完成一次色彩转移需要较多的时间。

3 文中新方法

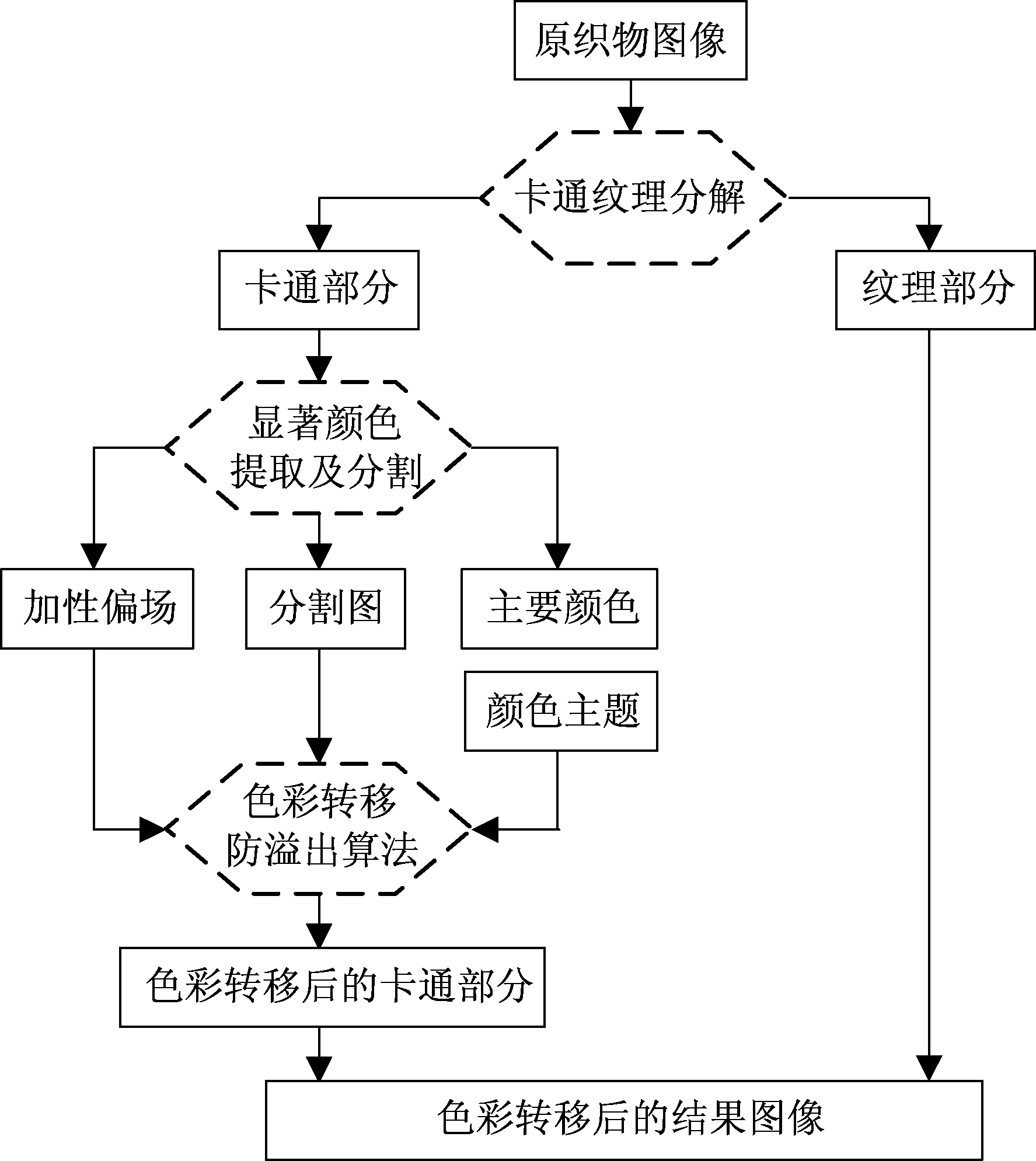

针对文献[15]方法存在的算法复杂度高、不能很好地保留原织物图像的层次感和细节等问题,文中提出了一种更加简单、高效的色彩转移新方法。与文献[15]方法不同的是,新方法中的图像分解与图像分割是分步进行的,这样可以有效地降低算法的复杂度。并且,新方法在图像分割阶段引入显著颜色提取策略,得到原织物图像更具代表性的主要颜色和分割区域,以使色彩转移结果图像的层次感更加忠实于原织物图像。另外,新方法采用了一种防溢出色彩转移算法,以更好地保持结果图像的细节。新方法的总体框架如图2所示。

(1)利用图像分解技术将原织物图像分解成纹理部分和卡通部分;(2)对原织物图像的卡通部分进行显著颜色提取,以得到的N个显著颜色为中心,将原织物图像的卡通部分分割成N个不同区域,同时得到加性偏场(原织物图像的卡通部分与对应分割图的差值);(3)从颜色主题数据库中选择合适的颜色主题,并由颜色主题、原织物图像的卡通部分分割图和加性偏场,利用色彩转移防溢出算法,得到色彩转移后的织物图像卡通部分;(4)由原织物图像的纹理部分和色彩转移后的卡通部分重构得到色彩转移后的结果图像。

图2 文中所提新方法的总体框架

Fig.2 The overall framework of the newly proposed method

3.1 图像分解

织物图像中通常包含大量的纹理细节,它们的存在将会给色彩转移过程中的图像分割带来不利影响[15]。另外,色彩转移本身也会对结果图像的纹理细节造成一定的损失[15]。为了更好地保护结果图像的细节,文中新方法保留了文献[15]中的图像分解策略。图像分解能够将图像f∈Rn分解成相应的纹理部分和卡通部分,即

f=u+v

(1)

式(1)中,u,v∈Rn,u为卡通部分,对应图像的主要轮廓,v为纹理部分,对应图像的细节信息。为了能够快速、高效地将原织物图像f分解成卡通部分u和纹理部分v,文中采用文献[16]所提改进的VO彩色图像分解模型,即

(2)

式(2)中,λ与γ是两个调节参数,||·||1为l1范数,||·||p为lp范数, 为梯度算子。另外,div g为原织物图像的纹理部分,即

为梯度算子。另外,div g为原织物图像的纹理部分,即

v=div g=- Tg

Tg

(3)

在图像分解模型(2)中,第一项主要起平滑作用,用于刻画原织物图像的分段光滑部分(卡通部分);第二项用于惩罚图像的纹理结构,以保证原织物图像的纹理部分v逼近于div g;另外,第三项可以让原织物图像逼近卡通部分与纹理部分之和,即

f≈u+v=u+div g

(4)

通常,纹理部分的像素值非常小,卡通部分包含了图像的绝大部分颜色特征,从卡通部分提取的主要颜色可以近似地看作是原织物图像的主要颜色[15]。

3.2 显著颜色提取及分割

文中利用显著颜色提取方法[9]得到原织物图像更具代表性的主要颜色和分割区域,以使结果图像更好地保持原织物图像的层次结构。对于lαβ格式的彩色图像,假设需要提取的显著颜色个数为N。

(1)将彩色图像的lαβ值分别归一化至[0,1],并统计每个通道的直方图。为了能够对图像进行快速聚类,设定每个通道内直方图柱的个数均为16。如此,彩色图像在lαβ空间共有163=4096个直方图柱。分别统计每个直方图柱的像素数量km和其对应的颜色均值dm,其中m∈[1,4096]。

(2)选择包含像素数量最多的直方图柱,将其颜色均值作为初步选择的第一个显著颜色dM1,并计算dM1与余下4095个颜色均值dm的距离,找到与dM1距离最大的颜色均值作为初步选择的第二个显著颜色dM2。其中,dM1与dm之间的距离定义为

(5)

式(5)中,σ为调节参数,wM1,n为权值,它等于第m个直方图柱所包含的像素数量。另外,OM1,m为dM1与dm在lαβ空间的欧几里得距离,即

(6)

(3)计算余下的颜色均值与dM1、dM2的距离,从中找到距离最大的颜色均值作为初步选择的第三个显著颜色dM3。通过这种方式依次类推,可以得到初步选择的第N个显著颜色dMN。

(4)以初步选择的N个显著颜色为中心对彩色图像进行聚类,可以得到对应的N个分割区域(N色分割图x),每个分割区域的颜色为该区域内所有像素的颜色均值,最后输出的N个显著颜色即为这N个分割区域的颜色均值。

由式(5)可知,显著颜色提取方法中定义的颜色距离既考虑了两种颜色的绝对距离(欧几里得距离),同时又考虑了这两种颜色所属直方图柱的像素数量。因此,这种方法能够较好地提取彩色图像中较为显著的颜色。利用上述方法可以得到原织物图像卡通部分u的主要颜色dS(包含N个显著颜色dS1,dS2,…,dSN)和对应的N区域分割图x。由u和x可以得到加性偏场y(用于重构结果图像),即

y=u-x

(7)

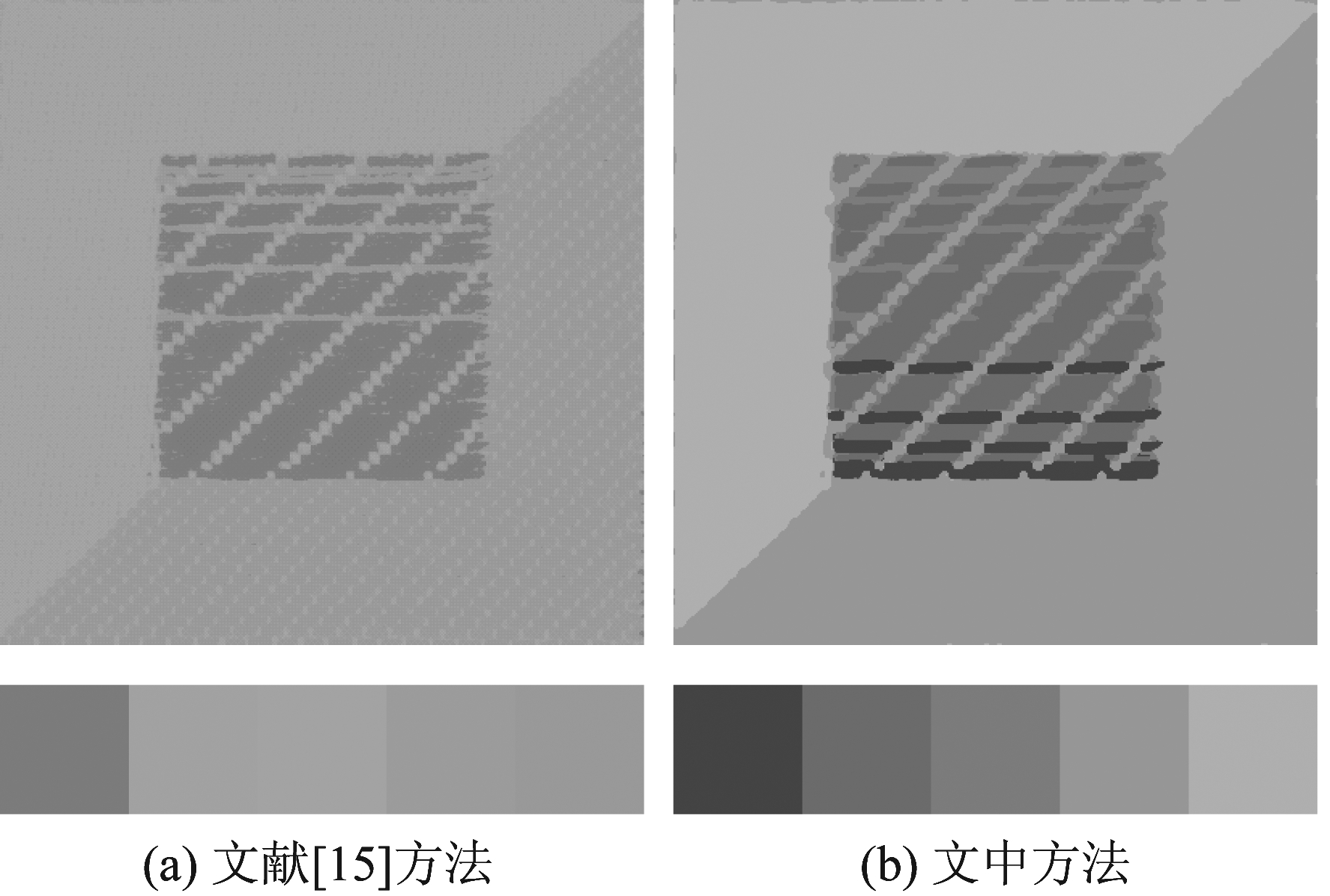

图3(a)和(b)是N=5时分别用文献[15]方法和文中方法从图1(a)提取的主要颜色和对应的分割图。

图3 N=5时提取的原织物图主要颜色和对应的分割图

Fig.3 The extracted main colors and the corresponding segmentation diagram of the original fabric image with N=5

显然,相比于图3(a),图3(b)中的5种颜色能够更好地体现图1(a)的主要颜色特征,并且图3(b)中5色分割图的层次感更加贴近于图1(a)。这说明,文中所用方法得到的主要颜色和分割图能够更好地反映原织物图的颜色风格和层次结构,这将使结果图像的层次感更加忠实于原织物图像。

3.3 防溢出色彩转移策略

如前所述,色彩转移过程中用到的颜色主题dT包含N个颜色dT1,dT2,…,dTN。理论上,用该颜色主题中的N个颜色以亮度排序的方式替换原织物图像卡通部分分割图x中的N个颜色dS1,dS2,…,dSN,然后将其与加性偏场y和纹理部分v一起重构,即可得到色彩转移后的结果图像。然而,由于原织物图像的主要颜色dS与颜色主题dT之间存在一定的差异,如此重构可能出现像素值溢出的问题,这将导致结果图像的部分细节含糊不清。为了有效地解决像素值溢出问题,文中采用了一种新的防溢出色彩转移策略,以有效地保护色彩转移结果图像的细节。

设原织物图像卡通部分分割图x中的第n个主要颜色dSn与颜色替换后对应颜色之间的实际位移为![]() 加性偏场y在k通道第n个分割区域的最大值为

加性偏场y在k通道第n个分割区域的最大值为![]() 最小值为

最小值为![]() 其中k∈(l,α,β)。于是,求解满足不溢出条件的颜色位移可以转化为如下带约束的优化问题。

其中k∈(l,α,β)。于是,求解满足不溢出条件的颜色位移可以转化为如下带约束的优化问题。

(8)

式(8)中,![]() 为k通道像素值的理论范围。考虑到重构图像时还需叠加原织物图像的纹理部分(其像素值通常非常小),所以式(8)中k通道的像素值范围比理论范围略小。由式(8)可知,约束条件可以保证色彩转移后的卡通部分像素值不溢出。并且,如此得到的颜色位移Δhn可使颜色替换后的新颜色最接近颜色主题的颜色。由带约束的最小化问题(8)可以很容易地求出所有分割区域的颜色位移Δhn(n=1,2,…,N)。因此,颜色替换后的N色分割图x*中第n个区域的颜色等于

为k通道像素值的理论范围。考虑到重构图像时还需叠加原织物图像的纹理部分(其像素值通常非常小),所以式(8)中k通道的像素值范围比理论范围略小。由式(8)可知,约束条件可以保证色彩转移后的卡通部分像素值不溢出。并且,如此得到的颜色位移Δhn可使颜色替换后的新颜色最接近颜色主题的颜色。由带约束的最小化问题(8)可以很容易地求出所有分割区域的颜色位移Δhn(n=1,2,…,N)。因此,颜色替换后的N色分割图x*中第n个区域的颜色等于

(9)

于是,色彩转移后的卡通部分u*等于颜色替换后的N色分割图x*与加性偏场y之和,即

u*=x*+y

(10)

最后,结果图像f*可以由色彩转移后的卡通部分u*和原织物图像的纹理部分v得到,即

f*=u*+v

(11)

4 实验与分析

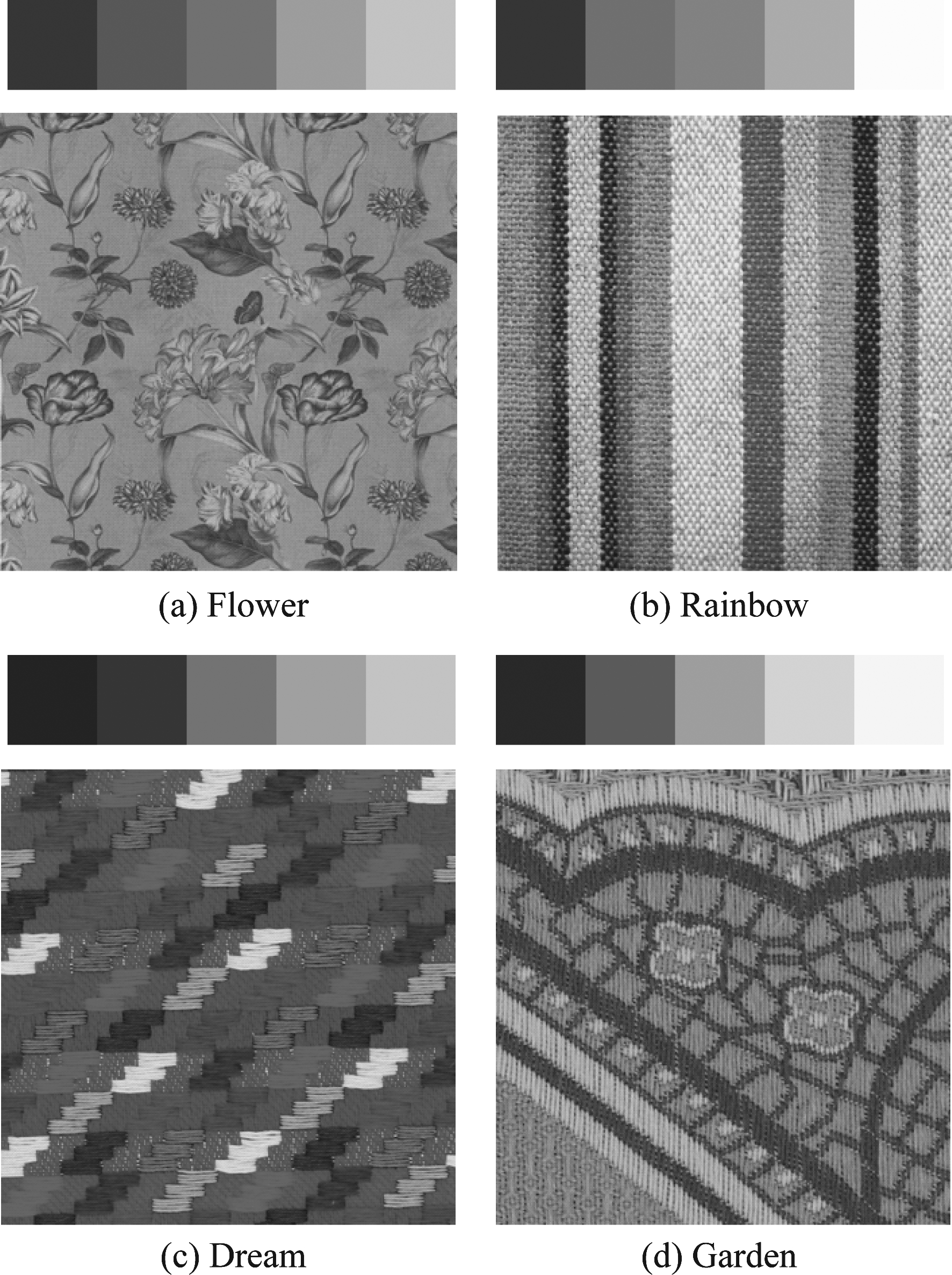

文中采用了不同的织物图像和颜色主题进行了多个色彩转移实验,以验证文中所提新方法的有效性。在这些实验中,所用原织物图像的大小均为400×400,提取的主要颜色数目N=5,所有的颜色主题均来自Mturk数据库。为了方便起见,在后面的内容中,文献[15]的方法用“HAN方法”表示。图4(a)~(d)所示是用于测试的4组颜色主题和原织物图像。其中,织物图像的名称依次为“Flower”、“Rainbow”、“Dream”和“Garden”。

图4 用于测试的颜色主题和原织物图像

Fig.4 Color theme and original fabric images for testing

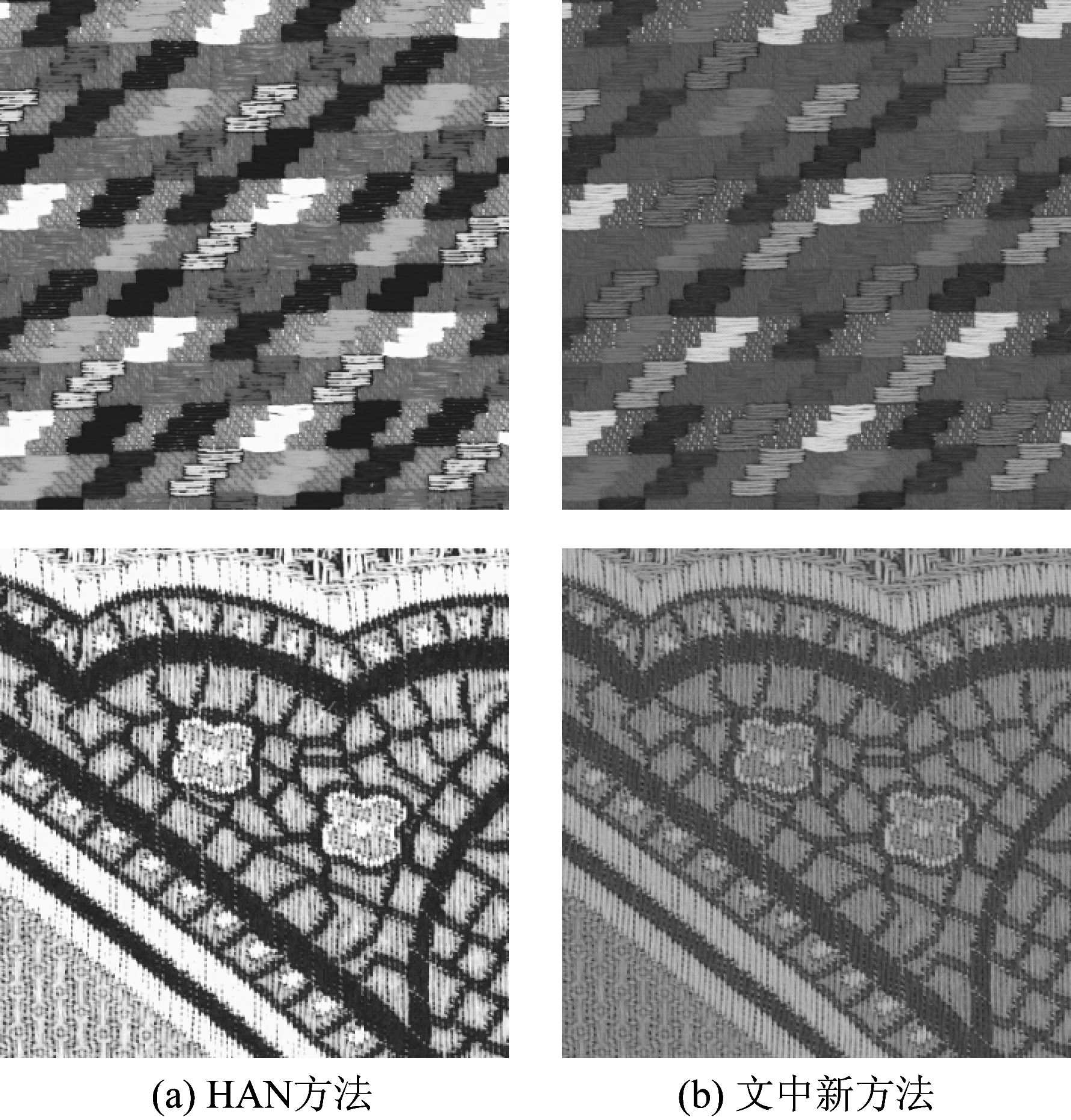

为了证明文中新方法在保护原织物图像层次结构方面的有效性,图5选用了层次感较鲜明的织物图像“Flower”和“Rainbow”进行了色彩转移实验。图5(a)与(b)分别为HAN方法与文中新方法得到的结果图像。由图5可知,相比于图4(a)所示的原织物图像“Flower”,HAN方法得到的结果图像看上去层次单一且缺乏立体感,而文中新方法得到的结果图像则较好地保持了原织物图像“Flower”的层次结构,整个画面看上去更加自然和谐。另外,相比于图4(b)所示的原织物图像“Rainbow”,HAN方法得到的结果图像明显存在层次感不足的问题,部分相邻颜色条之间的区分度非常小,且一些颜色条内部出现了不协调的杂色点,以至于影响了结果图像的视觉效果。而文中方法得到的结果图像较好地保持了原织物图像“Rainbow”的层次结构,各颜色条之间界限分明,区分度较高。

图5 不同方法结果图像的层次感比较

Fig.5 Layering comparison of the resulting images obtained from different method

为了证明文中新方法在保护织物图像细节方面的有效性,图6选用了小细节较多的织物图像“Dream”和“Garden”进行了色彩转移实验。图6(a)与(b)分别为HAN方法与文中新方法得到的结果图像。由图6可知,相比于图4(c)所示的原织物图像“Dream”,HAN方法得到的结果图像存在很多不同颜色的“斑块”区域,在这些“斑块”区域内部织物图像的细节大量丢失。相比于图4(d)所示的原织物图像“Garden”,HAN方法得到的结果图像部分区域显得过亮或者偏暗,而且在这些区域内部不同程度地存在着细节模糊的问题。上述细节模糊现象主要是由于HAN方法没有处理好色彩转移过程中的像素值溢出而导致的。相反地,由图6(b)可知,文中新方法得到的结果图像则有效地保持了原织物图像的细节,整个画面显得更加清晰细腻。这主要是因为新方法采用的防溢出色彩转移策略较好地避免了由于像素值溢出而导致的细节丢失问题。

图6 不同方法结果图像的细节比较

Fig.6 Details comparison of the resulting images obtained from different method

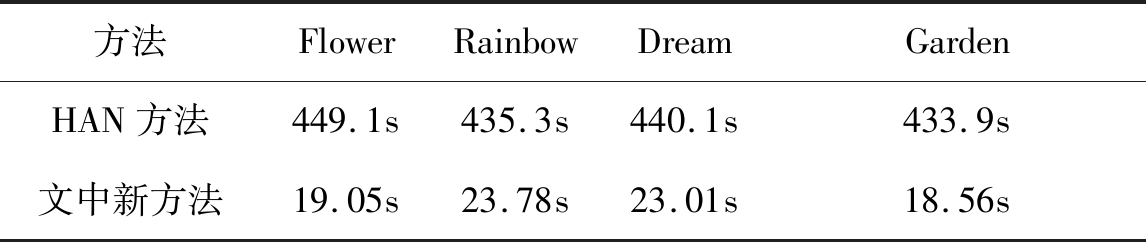

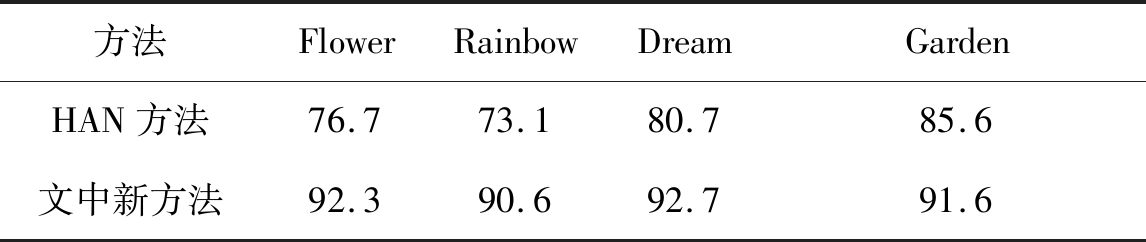

目前,色彩转移方面还没有公认的客观评价指标。因此,文中采用业内常用的平均运行时间和用户评分来进一步说明新方法的有效性。表1给出了图4~6所示的4组实验中HAN方法和文中新方法的平均运行时间。由运行时间统计结果可知,文中方法极大地提高了色彩转移的运行效率,完成一次色彩转移所需的时间不到HAN方法所需时间的10%。另外,文中邀请了10位志愿者对上述4组实验的结果图像进行百分制评分(最后得分等于所有志愿者评分的平均值),结果如表2所示。由表2所示的用户评分结果可知,相比于HAN方法,文中方法得到的结果图像明显具有更好的视觉效果。

表1 运行时间统计

Tab.1 Statistics of runtime

方法FlowerRainbowDreamGardenHAN方法449.1s435.3s440.1s433.9s文中新方法19.05s23.78s23.01s18.56s

表2 用户评分

Tab.2 User ratings

方法FlowerRainbowDreamGardenHAN方法76.773.180.785.6文中新方法92.390.692.791.6

5 结论

在织物图像的色彩转移过程中,为了更好保留原织物图像的层次感和细节,文中提出了一种基于显著颜色提取的防溢出色彩转移新方法。该方法通过显著颜色提取来得到原织物图像更具代表性的主要颜色和分割区域,使生成的结果图像在层次感方面能够更加接近原织物图像。另外,该方法通过防溢出色彩转移策略来避免结果图像出现像素值溢出,以更好地保护结果图像的细节。仿真结果表明,相对于传统方法,文中所提新方法不仅能够更有加效地保持织物图像的层次感和细节,而且还极大地提高的了运行效率。如何结合深度学习来设计更加高效的色彩转移方法将是后期研究的重点。

[1] Yang Y, Zhao H, You L, et al. Semantic portrait color transfer with internet images[J]. Multimedia Tools and Applications, 2017, 76(1): 523-541.

[2] Gu X, He M, Gu X. Thermal image colorization using Markov decision processes[J]. Memetic Computing, 2016, 9(1): 15-22.

[3] Xie B, Xu C, Han Y, et al. Color transfer using adaptive second-order total generalized variation regularizer[J]. IEEE Access, 2018, 6(3): 6829- 6839.

[4] Yang C N, Tung T C, Wu F H, et al. Color transfer visual cryptography with perfect security[J]. Measurement, 2017, 9(5): 480- 493.

[5] Reinhard E, Adhikhmin M, Gooch B, et al. Color transfer between images[J]. IEEE Computer Graphics and Applications, 2001, 21(5): 34- 41.

[6] Liu S G, Pei M. Texture-aware emotional color transfer between images[J]. IEEE Access, 2018, 6(6): 31375-31386.

[7] Liu T, Wei Y, Zhao Y, et al. Magic-wall: Visualizing room decoration[C]∥Proc. of ACM International Conference on Multimedia, 2017: 429- 437.

[8] Wen C L, Hsieh C H, Chen B Y, et al. Example-based multiple local color transfer by strokes[J]. Computer Graphics Forum, 2008, 27(7): 1765-1772.

[9] Chang H, Fried O, Liu Y, et al. Palette-based photo recol-oring[J]. Acm Transactions on Graphics, 2015, 34(4): 1-11.

[10] Ou L C, Luo M R, Woodcock A, et al. A study of color emotion and color preference[J]. Color Research & Application, 2004, 29(3): 232-240.

[11] Solli M, Lenz R. Color emotions for multi-colored images[J]. Color Research & Application, 2011, 36(3): 210-221.

[12] Han Y, Zheng D J, Baciu G, et al. Fuzzy region competition-based auto-color-theme design for textile images[J]. Textile Research Journal, 2013, 83(6): 638- 650.

[13] 张智勇, 常侃, 陈诚, 等. 应用残差总变分及低秩表示的视频去噪算法[J]. 信号处理, 2016, 32(5): 558-566.

Zhang Zhiyong, Chang Kan, Chen Cheng, et al. A video denoising algorithm using residual total variation and low-rank representation[J]. Journal of Signal Processing, 2016, 32(5): 558-566.(in Chinese)

[14] Li F, Ng M K, Zeng T Y, et al. A multiphase image seg-mentation method based on fuzzy region competition[J]. Siam Journal on Imaging Sciences, 2010, 3(3): 277-299.

[15] Han Y, Xu C, Baciu G, et al. Cartoon and texture decomposition based color transfer for fabric images[J]. IEEE Transactions on Multimedia. 2017, 19(1): 80-92.

[16] Ng M K, Yuan X, Zhang W. Coupled variational image decomposition and restoration model for blurred cartoon-plus-texture images with missing pixels[J]. IEEE Transactions on Image Processing, 2013, 22(6): 2233-2246.