1 引言

膀胱癌是泌尿系统最常见的肿瘤,位居人类恶性肿瘤的第五位,居致死性肿瘤的第十二位,膀胱肿瘤切除后的复发率高达约60%[1]。全球范围内每年新增病例约为430000,每年死亡人数约16500[2]。对磁共振影像(Magnetic Resonance Imaging,MRI)中的肿瘤组织和膀胱壁组织实现精确的分割有助于做出准确的病理分期,为病灶区域的体积计算提供了定量分析的依据,进而为辐射剂量计算和治疗计划提供帮助,是医院存在的普遍需求,具有一定的应用价值。

医学影像病灶区域的分割是当前国内外学者的研究热点,研究者对传统的算法不断改进[3]。传统的分割算法有区域增长算法、基于图谱[4]的方法、模糊C-均值聚类算法(Fuzzy C-Means,FCM)和基于水平集的方法等。区域增长算法对种子初始化敏感,同时对噪声较敏感,容易产生过分割。基于图谱的方法假定测试集目标的形状和训练集目标的形状相似,由于膀胱形状在患者之间的差异很大,同一患者的不同切片之间也有所不同,所以基于图谱的方法不能用于膀胱肿瘤和膀胱壁的分割。Duan等人[5]提出了用于T1加权MRI图像的耦合水平集框架,实现对膀胱内外壁的分割,使用了改进的Chan-Vese模型[6]找到内部和外部边界,然后构造一个耦合模型来分割它们。然而,由于复杂的外部强度分布,难以定位外边界,且由于两个零水平集之间没有应用距离约束,因此可能发生重叠或交叉。2014年Qin等[7]提出了自适应形状先验约束的水平集(adaptive shape prior constrained level sets,ASPCLS)方法,该方法将初始约束,如梯度信息、区域性信息、最小壁厚等引入到模型中,分割膀胱内外壁的效果相对较好。在此基础上,邵希等人[8]采用基于空域信息的模糊C均值(fuzzy C-means with spatial information,sFCM)算法对整个疑似肿瘤区域进一步提取,实现对肿瘤的分割。该方法比较适合医学图像中存在不确定性和模糊性的特点,但该方法对于面积小的目标,效果不理想,且对膀胱壁和肿瘤的分割需分步进行。而近年来,深度学习在计算机视觉领域的巨大成功,激发了国内外学者将其应用于医学图像分析[9]。2014年, Long等人在卷积神经网络(Convolutional Neural Network,CNN)结构[10]的基础上提出了完全卷积网络(Fully Convolutional Networks,FCN)[11],在抛弃了全连接层的之后能对图像进行像素级的分类。但FCN在对图像进行分割时,由于下采样部分的池化层会导致信息丢失,因此上采样部分将特征恢复到原图像大小的过程会出现像素定位不精确。针对此问题,有研究者于2015年提出U-Net网络[12],与FCN网络不同的是,U-net使用跳连(skip connection)结构将下采样层与上采样层相连,这使得U-net网络的像素定位更加准确。U-net网络提出后,在医学图像分割领域表现非常优秀,目前很多应用在医学图像分割的神经网络都将U-net作为基础的网络框架,Brosch等人[13]使用U-net网络对脑部MRI中的脑白质病灶进行分割,该网络结构在训练数据较少的情况下仍得到了很好的分割结果。然而,目前将深度神经网络应用于膀胱图像分割的研究很少。

由于本研究的关于膀胱肿瘤的MRI图像中存在复杂的噪声和伪影,且目标边缘很模糊,同时存在部分容积效应和类别不平衡问题,所以上述的传统方法并不适用。另外,由于需要同时对膀胱壁和膀胱肿瘤两个不同大小、不同形状的目标进行分割,且膀胱壁和膀胱肿瘤各自也存在大小不一、形状各异和位置不固定的特点,甚至很多患者的膀胱肿瘤组织与膀胱壁组织互相渗透、浑然一体[14],要将两者精确分割出来,需要很好地结合各个层次的特征信息,在这一点上U-net的效果较为突出,所以本研究将利用U-net作为基础网络框架,用残差块(Residual block)[15]作为特征提取子模块,结合空洞卷积(dilated convolution)[16]来设计一个并行的分支网络,从而提取不同层次、不同尺度的特征,更精确地分割出膀胱壁和膀胱肿瘤。基于数据集较小的原因,本研究将对数据集进行扩充,通过对原始图像加入高斯噪声、调节图像的亮度和采用各向异性扩散滤波[17]的方法来分别进行数据增强。

2 网络框架

2.1 总体框架

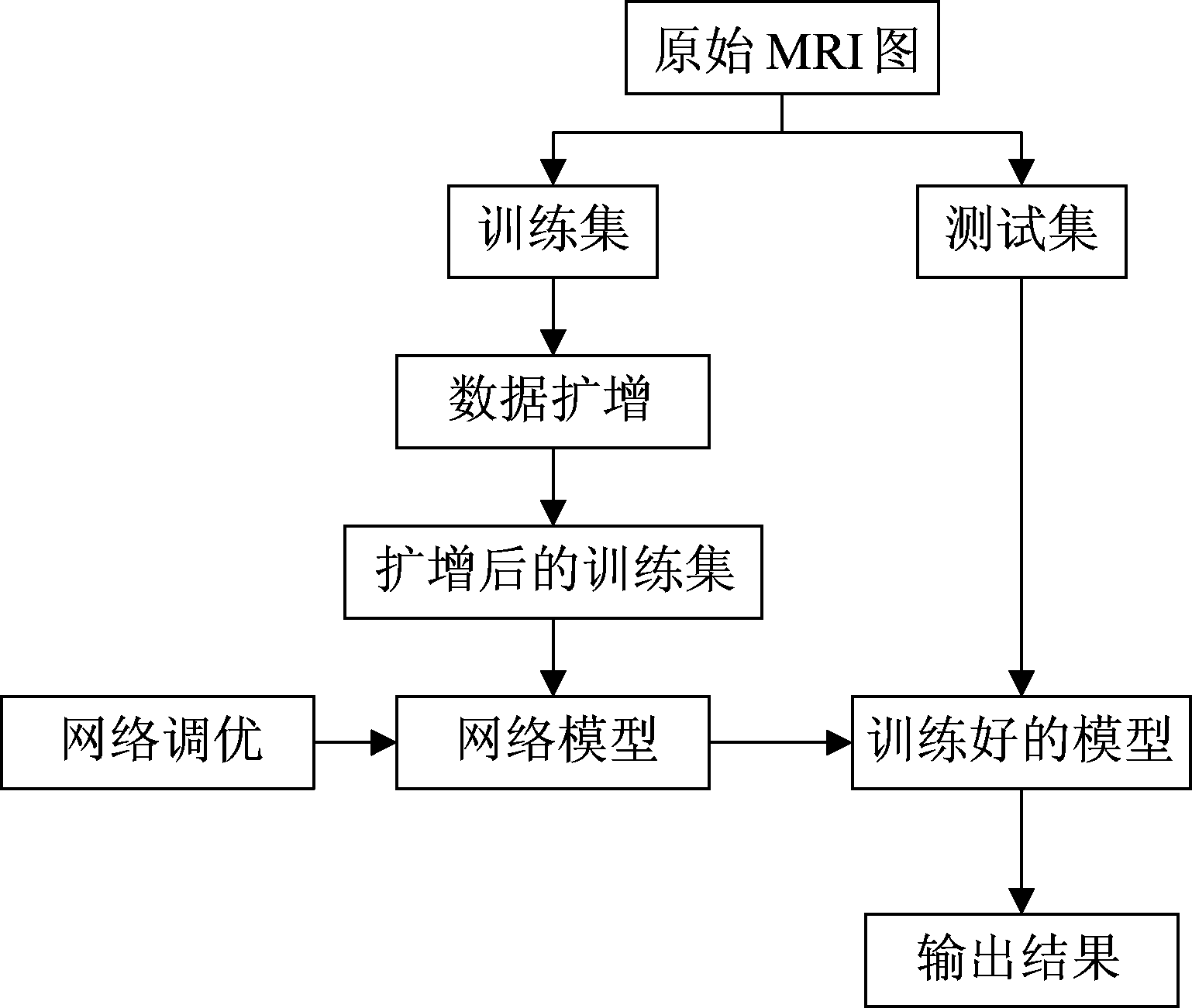

本文提出方法的总体框架如图1所示,首先对原始的膀胱MRI图像训练集进行数据扩增,得到扩增后的训练集,再将其输入到搭建好的网络模型中进行训练,经过参数调优后得到训练好的模型,最后再将测试集输入到训练好的网络模型中进行测试,得到分割的结果图。

图1 总体框图

Fig.1 Overall block diagram

2.2 本文设计的网络框架

U-net的上采样阶段与下采样阶段采用了相同数量层次的卷积操作,且使用跳连结构将下采样层与上采样层相连,使得下采样层提取到的特征可以直接传递到上采样层,这种设计结构很大程度上减轻了信息丢失。本文方法用U-net作为基础网络框架,在下采样阶段,区别于U-net用普通的卷积结构来提取特征,本文方法用残差块(Residual block)作为特征提取子模块,残差子模块将模块的输入与模块的输出进行特征融合,这样能够起到深度监督和特征复用的作用[18],为了更好的提取不同层次的特征,采用空洞卷积结构将网络进行分支,通过控制空洞卷积的扩充率来获取不同感受野的特征图,再将其输入到不同分支的下采样网络部分,最后各分支的特征融合之后进行上采样,输出分割结果。其中,为了对各层次特征的更好提取,在下采样阶段采取较大卷积核(5×5卷积核),在上采样阶段采取较小卷积核(3×3卷积核)。本文的网络Multiscale-Resunet如图2所示。

图2 本文设计的网络

Fig.2 Network designed in this paper

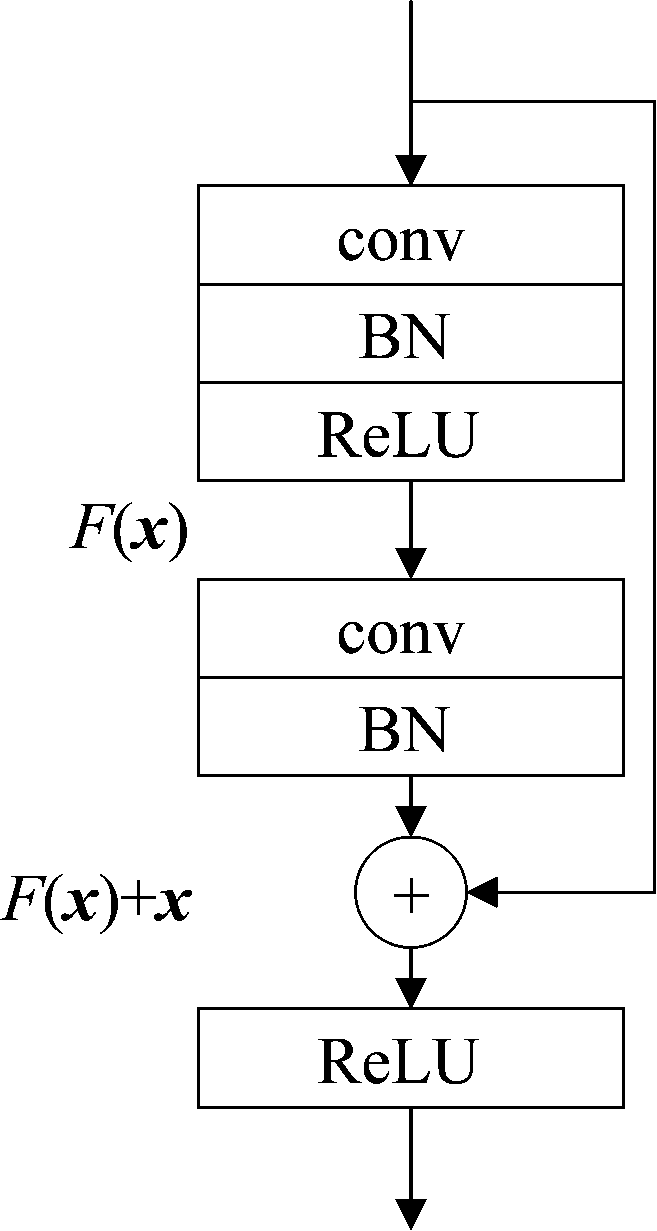

2.3 残差子模块部分

神经网络的每一层分别对应于提取不同层次的特征信息,网络越深的时候,提取到的不同层次的信息会越多,对于医学图像分割问题,最后的分割结果需要较深的网络来提取更加抽象的像素分类特征,而深度网络往往会遇到梯度消失的问题,导致分割精度到达一定值便会饱和甚至降低。这是反向传播算法[19]存在的普遍问题,这种问题对于Sigmoid激活尤为严重,故后来深度网络均使用ReLU激活来缓解这个问题,但即使是ReLU激活也无法避免由于网络单元本身输出的尺度关系,在极深度条件下成百上千次的连乘带来的梯度消失。直到2015年何凯明等人提出的残差网络(Resnet)结构从本源上杜绝了梯度消失的问题,图3是本文用到的残差网络的基本单元结构。

图3 残差网络单元

Fig.3 Residual network unit

从图3可以看出,该残差结构单元有两个卷积层,输入与第二个卷积层的输出通过一个短连接(shortcut)进行特征矩阵逐值相加。所以该结构的的输出H(x)为:

H(x)=F(x)+x

(1)

式(1)中的x为残差单元的输入,F(x)为:

F(x)=W2σ(W1x)

(2)

由式(1)可知,当F(x)的值为0时,H(x)与x的值相等,这意味着,卷积网络极深时,当权重训练到使结果达到最优,后面多余的层不会使精度下降。所以网络只需要去拟合F(x)=0即可,训练起来更加容易。从另一个角度来看,这种短连接是在用先验知识来辅助网络训练出更优的输出结果。

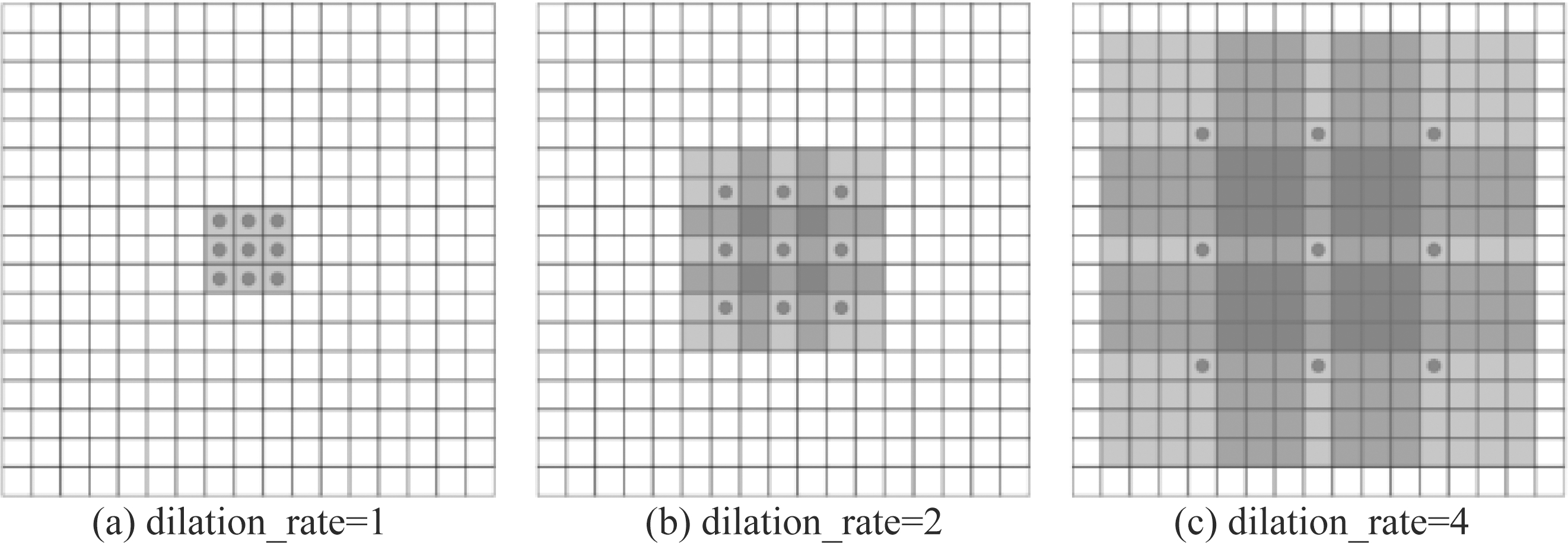

2.4 空洞卷积-横向多尺度特征提取

卷积操作在特定场景如图像语义分割下存在一定的问题,比如,卷积之后往往通过池化操作降低计算量,同时增大感受野,再通过反卷积(上采样)扩充图像到原始大小,这中间过程会丢失很多信息,特别是空间结构信息,另一个问题是小的物体信息无法复原重建。而在空洞卷积中,避免了使用池化操作的同时增大了感受野,不需要压缩图像的分辨率,保留了图像内部的数据结构,可以取得比卷积更好的分割效果。另外,空洞卷积中多了一个扩充率(dilation_rate)参数,用来控制扩张(空洞填充)的大小。由于本研究分割的目标大小形状各异,需要结合不同尺度的特征[20],故本文通过控制空洞卷积的扩充率参数来对特征图提取不同感受野的特征,再将其分别输入到不同分支的U-net网络,从而达到提取不同尺度特征的目的。空洞卷积的示意图如图4所示。在图4中,除红色点之外,空洞的权重值均设为0,扩充率参数越大,同等卷积核大小对应的感受野越大。扩充卷积对普通卷积的改进就是为了获得更大的感受野。图(a)是普通的卷积,感受野是3×3,相当于不扩充,dilation_rate=1;图(b)是扩张卷积,感受野是7×7,dilation_rate=2;图(c)是扩张卷积,感受野是15×15,dilation_rate=4。而本文设计的网络分别将空洞卷积的扩充率设为1和2,从而将网络进行分支下采样。

3 实验方法

3.1 数据扩增

本研究所用数据集为2018年中国大学生计算机设计大赛提供的2200张MRI膀胱影像图,其中, 2000张图像作为训练集,200张图像作为测试集,测试集的图像来源于与训练集不同的患者。由于训练集太小,难以训练出好的网络权重,故对2000张图像的训练集进行扩增,扩增的方法尽量使训练集多样化,避免出现严重的过拟合现象。本文分别对2000张原图加入高斯噪声、调节亮度和进行各向异性扩散滤波,三种方法分别扩增2000张图片,使训练集增加到8000张。下面主要对各向异性扩散滤波算法进行介绍。

图4 空洞卷积

Fig.4 Dilated convolution

各向异性扩散滤波主要是用来平滑图像的,能去除掉一些大的噪声和伪影,同时克服了高斯模糊的缺陷,能够较好保留图像的边缘,使边缘特征突出,由于膀胱壁和膀胱肿瘤的边缘较为模糊,故该算法有利于神经网络对边缘特征的学习。

各向异性扩散滤波算法根据公式(3)进行迭代计算,主要是判断当前像素值和邻近像素值的关系,若两者之间的关系大于一定的阈值则判为边界,停止扩散。

It+1=It+λ(cNx,y N(It)+cSx,y

N(It)+cSx,y S(It)+

S(It)+

cEx,y E(It)+cWx,y

E(It)+cWx,y W(It))

W(It))

(3)

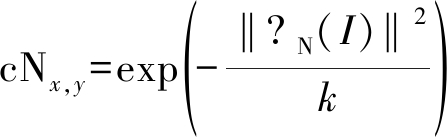

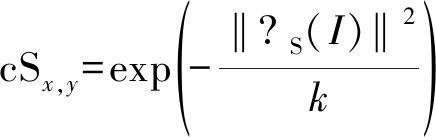

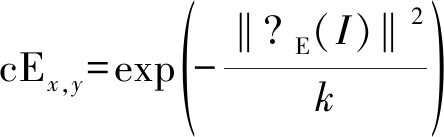

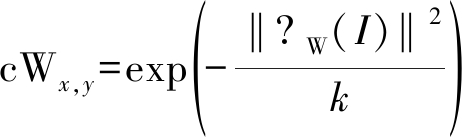

其中I为图像的像素矩阵,t为迭代数,四个散度表达式▽N(It)、▽S(It)、▽E(It)和▽W(It)就是在四个方向对当前像素值求偏导,而cNx,y、cSx,y、cEx,y、和cWx,y则是四个方向上的导热系数,公式如下:

(4)

(5)

(6)

(7)

对图像进行各向异性扩散滤波时,需要先设定t、λ和k三个参数的值,λ、k的值越大则图像越平滑,越不易保留边缘,λ、k的值越小,则边缘锐化程度较高。根据实验经验,本文将λ的值设为0.15,k的值设为15。

经过加高斯噪声、调节亮度和各向异性扩散滤波三种方法的数据扩增后,训练集相对来说更具丰富性,有利于减轻过拟合现象。图5展示了原始图分别经过三种方法处理后的效果。

图5 数据增强的效果

Fig.5 The effect of data augmentation

3.2 训练

本文设计的卷积网络选用交叉熵函数作为训练的损失函数,并用Adam优化器来训练损失函数从而更新网络的权重值,交叉熵损失函数的表达如下:

(8)

其中,x代表样本像素,n代表样本像素的总数,y为当前像素对应的标签,a为通过网络前向传播后计算出来的标签。

本文所进行的实验采用批梯度下降法对网络进行训练,batch_size(批大小)设为5。根据多次实验观察和调试经验,将学习率lr设为0.00005较合适,若学习率设置过大,梯度会在最小值附近来回震荡,导致模型无法收敛,若学习率设置过小,收敛过程会十分缓慢。另外将epoch设为15时能够收敛到最佳的模型,若epoch过大则会过拟合,反之则尚未收敛到最佳,故将epoch设为15。

3.3 评价标准

本研究采用Dice相似性系数(Dice similarity coefficient,DSC)来评价算法最后分割结果的精确度。DSC计算的是两个区域的相似程度。其定义为:

(9)

其中,A代表人工标注的图,B代表神经网络的预测图。

4 实验结果及分析

本文所有实验的测试集均为200张原始图像,batch_size为5,学习率为0.00005,epoch为15,采用Dice相似性系数作为评价标准。

4.1 评估数据扩增

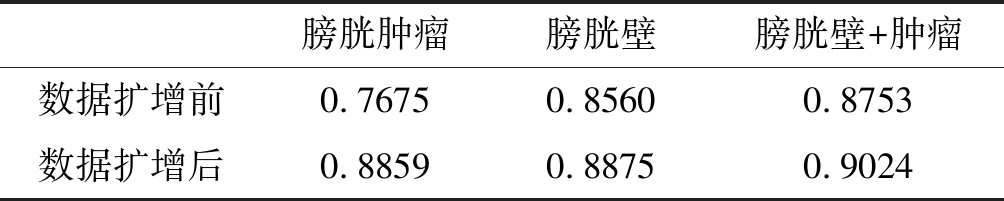

本文实验1是评估数据扩增对分割结果的影响,实验中选用U-net网络,通过两组实验来进行对比。第一组实验的训练集是2000张原始图像,第二组实验的训练集是经过数据扩增后的8000张图像。从而得出膀胱肿瘤、膀胱壁和膀胱内外边界之间区域(膀胱壁+肿瘤)的分割准确率。表1为两组实验的结果。

表1 实验1结果

Tab.1 The result of experiment 1

膀胱肿瘤膀胱壁膀胱壁+肿瘤数据扩增前0.76750.85600.8753数据扩增后0.88590.88750.9024

从表1的结果可以看出,经过数据扩增后,三个区域的分割精度均有较大的提升,膀胱肿瘤的分割准确率从76.75%提升到88.59%,膀胱壁的分割准确率从85.60%提升到88.75%,膀胱壁+肿瘤的分割准确率从87.53%提升到90.24%。

4.2 评估Resnet子模块

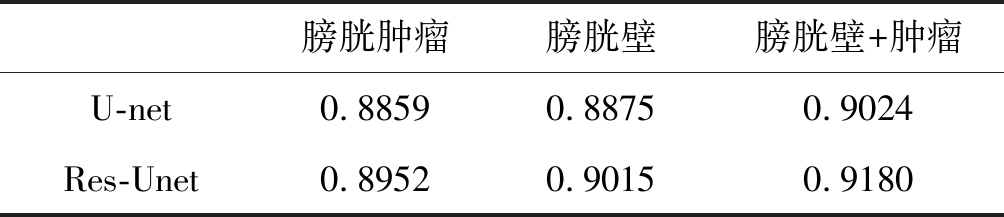

本文实验2是评估Resnet子模块替代普通卷积结构对分割结果的影响,通过两组实验来进行对比。第一组实验选取的训练网络是普通卷积结构的U-net网络,第二组选取的加入残差网络作为特征提取模块的Res-Unet网络。两组实验的训练集均是经过数据扩增后的8000张图像。表2为两组实验的结果。

表2 实验2结果

Tab.2 The result of experiment 2

膀胱肿瘤膀胱壁膀胱壁+肿瘤U-net0.88590.88750.9024Res-Unet0.89520.90150.9180

从表2的结果可以看出,相对于U-net网络,加入残差模块的Res-Unet网络可以达到更高的分割准确率。膀胱肿瘤的分割准确率从88.59%提升到89.52%,膀胱壁的分割准确率从88.75%提升到90.15%,而膀胱壁+肿瘤的分割准确率从90.24%提升到91.80%。

4.3 评估下采样分支结构

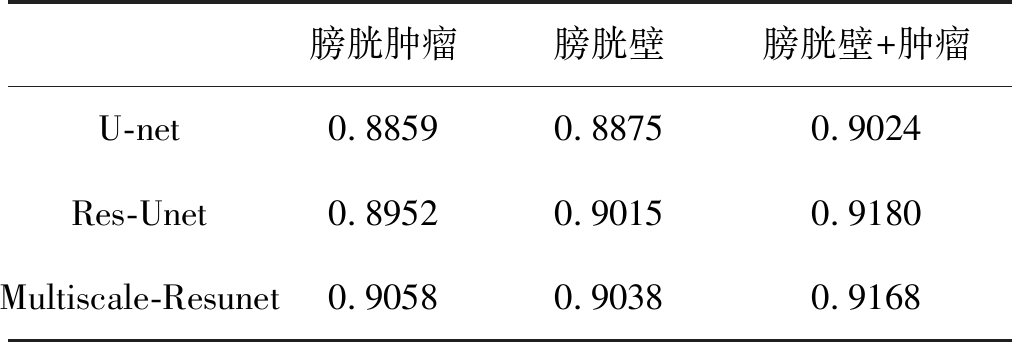

本文实验3是评估利用空洞卷积将网络进行分支下采样对分割结果的影响,通过三组实验来进行对比。第一组实验选取的训练网络是普通卷积结构的U-net网络,第二组选取的加入残差网络作为特征提取模块的Res-Unet网络,第三组选取的网络是在Res-Unet基础上进行分支下采样从而提取多尺度特征的Multiscale-Resunet网络。三组实验的训练集均是经过数据扩增后的8000张图像。表3为三组实验的结果。

表3 实验3结果

Tab.3 The result of experiment 3

膀胱肿瘤膀胱壁膀胱壁+肿瘤U-net0.88590.88750.9024Res-Unet0.89520.90150.9180Multiscale-Resunet0.90580.90380.9168

从表3的结果可以看出,相对于Res-Unet网络,进行分支下采样的网络对膀胱肿瘤的分割精度有所提升,大约提高了一个百分点,而对于其余的两个分割目标,分割精度相当,基本保持不变。而相对于U-net网络,本研究设计的网络Multiscale-Resunet优势较为明显,膀胱肿瘤的分割准确率从88.59%提升到90.58%,膀胱壁的分割准确率从88.75%提升到90.38%,而膀胱壁+肿瘤的分割准确率从90.24%提升到91.68%。

最后,将本文实验结果同数据集所属大赛的高精度方法进行比较,如表4。

表4 与其他高精度方法对比

Tab.4 Comparison with the other best method

膀胱肿瘤膀胱壁膀胱壁+肿瘤其他方法0.90270.91230.9263本文方法0.90580.90380.9168

根据表4所显示,本文方法对膀胱肿瘤的分割性能略显优势,而对膀胱壁的分割则仍有提高的空间,但综合所有实验结果可以看出,本文方法能够同时对膀胱肿瘤和膀胱壁进行准确高效的分割。本文方法针对MRI膀胱图像,克服了光学膀胱镜检测膀胱肿瘤有创及存在视觉盲区等缺点,与医师手动分割结果高度吻合,为膀胱肿瘤的早期检测、术前诊断和病理分期提供了有效无创的手段。本文所设计的网络最终的分割效果如图6所示。

图6 本文方法对膀胱图像的分割效果

Fig.6 The result of our method

5 结论

本文综合考虑了全卷积网络FCN、U-net网络和残差网络的优点和不足,提出以U-net网络为基础网络框架,以残差块作为特征提取器并利用空洞卷积进行横向多尺度特征提取的Multiscale-Resunet网络,因为深度神经网络在浅层提取了较多的作为目标定位依据的特征和细节特征,但语义信息相对较少,而深层特征中保留了更多的作为目标分类依据的抽象语义信息,却丢失了很多的位置信息, U-net本身存在的长连接能够使网络深层抽象信息与底层细节信息共享,用底层信息补充分割细节,本文加入的残差模块结构,类似于以先验知识来辅助更深层的网络进行训练,不仅提高了特征的利用率,也减轻了梯度消失。同时,本文设计的分支下采样结构,从输入端提取不同感受野的特征图,有利于多目标的分割。本文通过对原始图像加噪、调节亮度和各向异性扩散滤波解决了因数据集太小容易导致过拟合的问题。实验结果表明,本文提出的基于深度全卷积网络的分割方法能够达到较高的分割准确率,分割精度较U-net有较大提升,有较高的医疗应用价值。

[1] Ferlay J, Soerjomataram I, Dikshit R, et al. Cancer incidence and mortality worldwide: sources, methods and major patterns in GLOBOCAN 2012[J]. International Journal of Cancer, 2015, 136(5): E359-E386.

[2] Grasso M. Bladder Cancer: A Major Public Health Issue[J]. European Urology Supplements, 2008, 7(7): 510-515.

[3] 童云飞, 李锵, 关欣. 改进的多模式脑肿瘤图像混合分割算法[J]. 信号处理, 2018, 34(3): 340-346.

Tong Yunfei, Li Qiang, Guan Xin. An Improved Multi-Modal Brain Tumor Segmentation Hybrid Algorithm[J]. Journal of Signal Processing, 2018, 34(3): 340-346.(in Chinese)

[4] Cao Y, Yuan Y, Li X, et al. Segmenting images by combining selected atlases on manifold[C]∥International Conference on Medical Image Computing and Computer-Assisted Intervention. Springer, Berlin, Heidelberg, 2011: 272-279.

[5] Duan C, Liang Z, Bao S, et al. A coupled level set framework for bladder wall segmentation with application to MR cystography[J]. IEEE Transactions on Medical Imaging, 2010, 29(3): 903-915.

[6] Chan T F, Vese L A. Active contours without edges[J]. IEEE Transactions on Image Processing, 2001, 10(2): 266-277.

[7] Qin X, Li X, Liu Y, et al. Adaptive shape prior constrained level sets for bladder MR image segmentation[J]. IEEE Journal of Biomedical and Health Informatics, 2014, 18(5): 1707-1716.

[8] 邵希, 石宇强, 刘岩, 等. 基于磁共振成像的膀胱肿瘤自动检测系统的开发[J]. 中国医学装备, 2018, 15(1): 2-5.

Shao Xi, Shi Yuqiang, Liu Yan, et al. The development of automatic detecting system for bladder tumor based on MRI[J]. Chinese Medical Equipment, 2018, 15(1): 2-5.(in Chinese)

[9] Cernazanu-Glavan C, Holban S. Segmentation of bone structure in X-ray images using convolutional neural network[J]. Adv. Electr. Comput. Eng, 2013, 13(1): 87-94.

[10] LeCun Y, Boser B, Denker J S, et al. Backpropagation applied to handwritten zip code recognition[J]. Neural Computation, 1989, 1(4): 541-551.

[11] Long J, Shelhamer E, Darrell T. Fully convolutional networks for semantic segmentation[C]∥Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2015: 3431-3440.

[12] Ronneberger O, Fischer P, Brox T. U-net: Convolutional networks for biomedical image segmentation[C]∥International Conference on Medical Image Computing and Computer-assisted Intervention. Springer, Cham, 2015: 234-241.

[13] Brosch T, Tang L Y W, Yoo Y, et al. Deep 3D convolutional encoder networks with shortcuts for multiscale feature integration applied to multiple sclerosis lesion segmentation[J]. IEEE Transactions on Medical Imaging, 2016, 35(5): 1229-1239.

[14] 肖丹, 刘洋, 张国鹏, 等. 基于厚度特征模糊 C 均值算法的膀胱肿瘤疑似区域三维分割方法研究[J]. 医疗卫生装备, 2015, 36(3): 1- 4.

Xiao Dan, Liu Yang, Zhang Guopeng, et al. Fuzzy C-means algorithm using wall thickness feature for 3D bladder tumor suspected region segmentation[J]. Chinese Medical Equipment Journal, 2015, 36(3): 1- 4.(in Chinese)

[15] He K, Zhang X, Ren S, et al. Deep residual learning for image recognition[C]∥Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2016: 770-778.

[16] Yu F, Koltun V. Multi-scale context aggregation by dilated convolutions[J]. arXiv Preprint arXiv: 1511. 07122, 2015.

[17] Tang J, Sun Q, Liu J, et al. An adaptive anisotropic diffusion filter for noise reduction in MR images[C]∥2007 International Conference on Mechatronics and Automation. IEEE, 2007: 1299-1304.

[18] Huang G, Liu Z, Van Der Maaten L, et al. Densely connected convolutional networks[C]∥Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2017: 4700- 4708.

[19] Yu X, Efe M O, Kaynak O. A general backpropagation algorithm for feedforward neural networks learning[J]. IEEE Transactions on Neural Networks, 2002, 13(1): 251-254.

[20] Moeskops P, Viergever M A, Mendrik A M, et al. Automatic segmentation of MR brain images with a convolutional neural network[J]. IEEE Transactions on Medical Imaging, 2016, 35(5): 1252-1261.