1 引言

无线电陆空通话是飞行员与空中交通管制员之间进行语音通信的重要方式,对航空器的安全有效运行有着重要的作用[1-3]。针对陆空通话用语的特点,国际民航组织及各国民航管理机构不断完善空中交通的通话标准。但是,由于陆空对话成员之间存在着语种、口音、语义表达和理解方式等差异,同时受工作强度、精神压力、情绪等因素的影响,无线电陆空通话失误也时有发生。在实际的飞行过程中,一个很小的通话失误就可能会造成致命的飞行事故。陆空通话失误类型主要有内容不正确、用语不规范、信息纰漏、复诵错误或无复诵[4- 6],文本主要针对陆空通话中飞行员是否对管制员发送的指令进行了正确的复诵进行研究,实现陆空通话复诵语义自动校验,可以降低管制员的工作强度,提高校验精度,对民航运输安全具有重要意义。

对飞行员复诵内容是否与管制员指令的语义一致进行校验,与自然语言处理中的句子匹配工作有很多的相似之处。自然语言句子匹配任务旨在判别给定的两句话是否匹配,该任务本质上是比较两个句子并确定两个句子之间的关系[7],在信息检索,自动问答,机器翻译,对话系统等任务中都有着重要的应用。传统的方法主要是依靠设计者的先验知识手工地选取特征[8,9],进而对句子进行匹配,其结果好坏过分依赖于特征选取的质量的高低,并且对于不同领域的数据泛化能力差,缺少对数据深层语义信息的学习能力。近年来,以RNN、CNN为主提出的诸多深度学习模型被引入到自然语言句子匹配任务中,深度学习方法能够自动地学习到更多复杂的深层语义特征。2016年,H.Palangi等人提出使用LSTM网络将一个句子压缩表示为一个抽象的语义向量来解决信息检索任务[10];2015年,复旦大学的邱锡鹏等人同样使用了卷积神经网络的结构来进行文本的表达,然后提出使用神经张量网络作为相似度度量方法来建模两个文本间的关系,提出了CNTN模型[11]。2016年,万圣贤等人提出了多视角循环神经网络(MV-LSTM),从词、短语、句子等多个级别上对两个文本进行了匹配,提取了更细粒度的匹配特征[12];2016年庞亮等人提出了MatchPyramid模型,该模型将两个文本更早的进行了交互,可以得到包含所有细粒度的匹配信息,避免了在一段文本抽象成一个向量表达时细节的匹配信息丢失[13]。深度学习模型能够提取到句子对间深层语义匹配关系并对其进行有效的学习建模,更好的完成自然语言句子匹配任务。

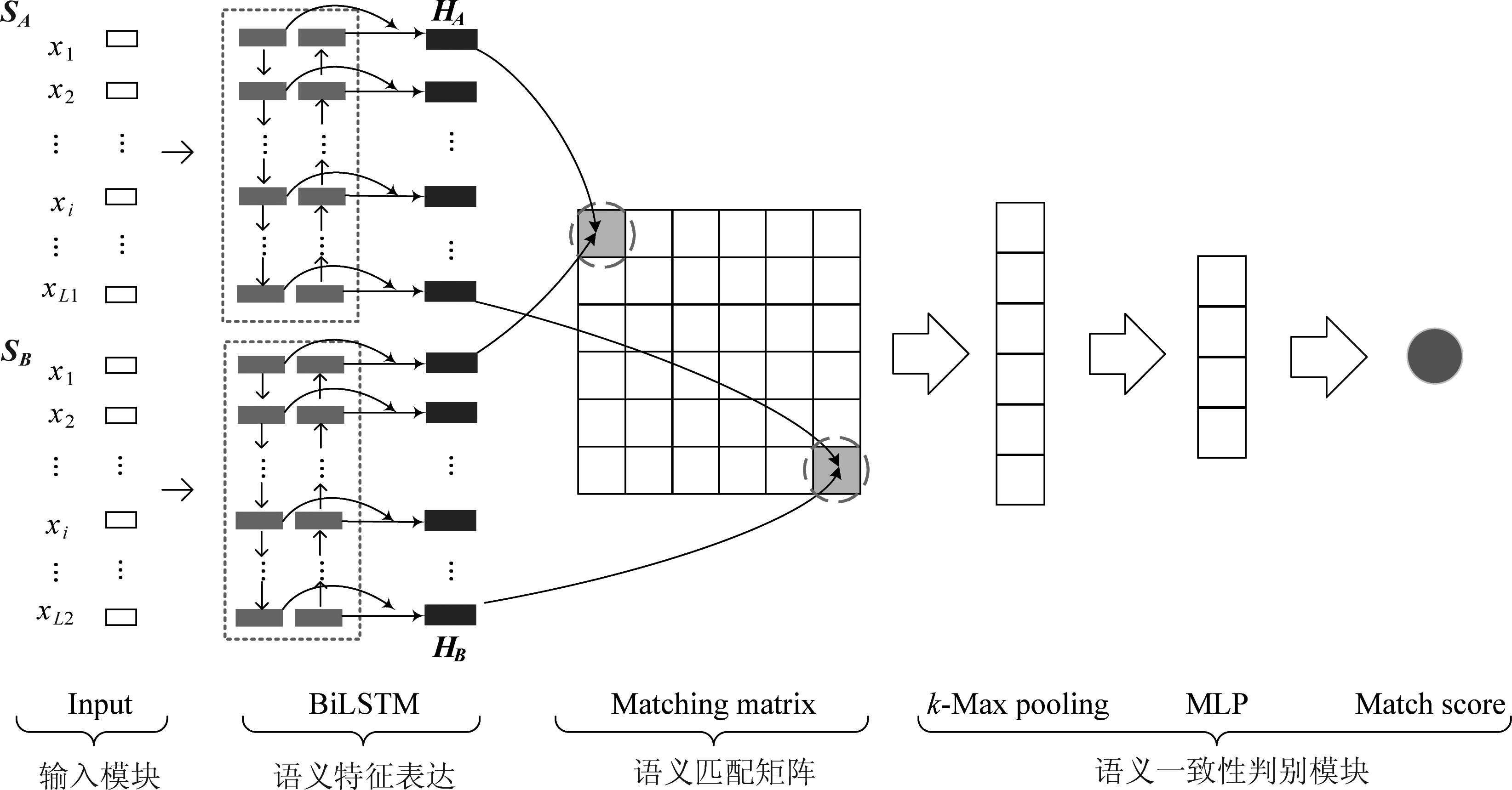

陆空通话复诵语义自动校验任务区别于普通的自然语言句子匹配任务之处在于,陆空通话用语有着严格的标准,要求语言标准化、程序化,语义单一化,通话内容简洁明了,收到指令后,飞行员只对关键的操作性指令进行复诵。基于这些特点,本文提出了陆空通话复诵语义自动化校验BiLSTM模型,将管制员发送的指令序列和飞行员复诵指令序列分别输入到两个并行的BiLSTM网络中进行句子特征提取,得到BiLSTM各个时刻的输出;然后对每个时刻的输出进行交互生成匹配矩阵,提出使用神经张量网络来计算向量间的匹配度从而得到匹配矩阵;最后使用动态k-Max池化方法自动的选出k个显著匹配特征并输入到MLP网络中得到匹配分数实现陆空通话复诵语义一致性自动判别。该方法是将陆空通话复诵句子对中每个词表示为含有丰富上下文信息的特征向量,并对其交互匹配得到指令和复诵指令间每个时刻的匹配特征,有利于最终的复诵匹配校验工作。

2 BiLSTM的基本原理

循环神经网络(RNN)在处理序列问题上尤为突出,它打破了传统神经网络结构输入-隐层-输出的模式,引入了定向循环,从而能够更好地处理输入序列间的前后关联问题。长短时记忆循环神经网络(LSTM)是RNN的一种变形结构,能够解决传统RNN存在的长距离依赖与梯度消失问题[14]。同RNN相同,LSTM当前时刻的输出不仅与当前时刻的输入有关,还与前一时刻隐层的输出有关,不同的是LSTM在RNN的隐层结构中加入了LSTM单元。LSTM单元包括输入门、输出门、和遗忘门三个门单元和一个记忆单元,记忆单元是LSTM网络的核心,用于存储某时间段的历史信息。正是这种结构使得LSTM网络能够提取到更长距离的特征信息。给定句子输入序列X={x(1),x(2),...,x(t),...,x(T)},x(t)表示序列中第t个词的词向量表示,h(t)表示对应t时刻的隐层输出。o(t), f(t),i(t),c(t)分别为t时刻输出门、遗忘门、输入门和记忆单元的状态向量,则LSTM网络在t时刻时其内部记忆单元状态如公式(1)~(6)所示:

i(t)=σ(W1x(t)+Wrec1h(t-1)+bi)

(1)

f(t)=σ(W2x(t)+Wrec2h(t-1)+bf)

(2)

o(t)=σ(W3x(t)+Wrec3h(t-1)+bo)

(3)

l(t)=tanh(W4x(t)+Wrec4h(t-1)+bl)

(4)

c(t)=f(t)*c(t-1)+i(t)*l(t)

(5)

h(t)=o(t)*tanh(c(t))

(6)

其中,Wi和Wreci(i =1, 2, 3, 4)分别是输入门、遗忘门、输出门和记忆单元的输入和输出的连接权值矩阵,σ(·)是sigmoid激活函数,bi、bf、bo、bl是偏置项。

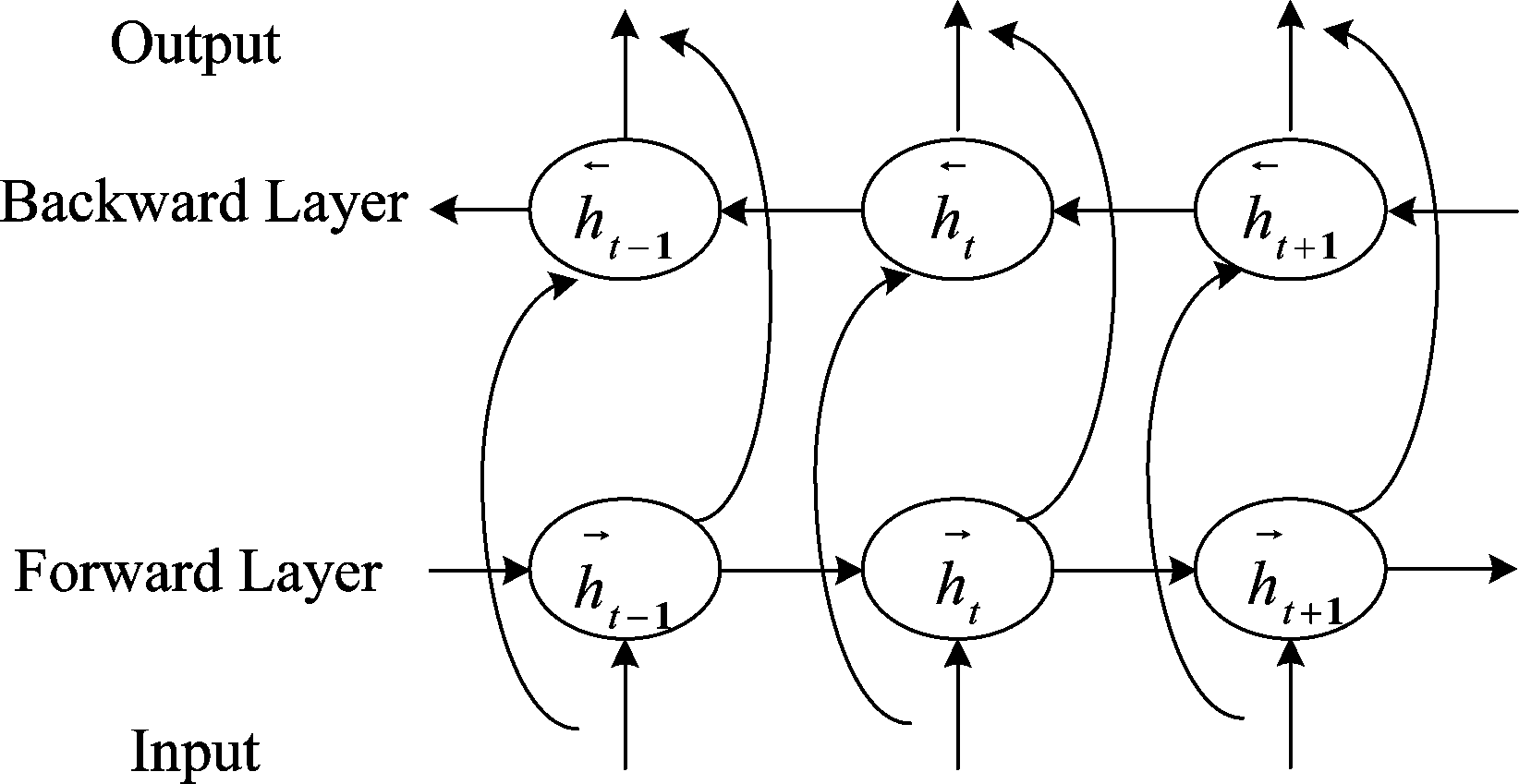

单向的LSTM是从前向后进行训练的,在t时刻无法学习到该时刻之后的语义信息,所以会存在位置偏见的问题,即后面的词会比前面的词更重要。但在陆空通话复诵语义一致性自动校验任务中指令和复诵指令中从前到后所有词都是同等重要的。所以,本文提出使用双向的长短时记忆循环网络(BiLSTM)来提取句子语义特征。BiLSTM的网络结构图如图1所示,是两个相反方向的LSTM的组合,一个正向的LSTM网络和一个反向的LSTM网络分别从首尾两个方向对输入序列进行处理,正向LSTM用来捕获上文的特征信息,而反向LSTM用于捕获下文的特征信息,输出是两个LSTM输出的组合,每个时刻的输出包含了对应输入序列中那个时刻完整的过去和未来的上下文信息。相比单向的LSTM网络,BiLSTM能够提取到每个时刻更丰富的语义信息,从而能构造出更好的句子特征表达。

图1 BiLSTM的网络结构图

Fig.1 The basic structure of BiLSTM

3 陆空通话复诵语义自动化校验BiLSTM模型

本文提出的陆空通话复诵语义自动化校验BiLSTM模型基本架构如图2所示,该模型由四个模块组成:输入模块、句子语义特征表达模块、语义匹配矩阵模块、语义一致性判别模块。

3.1 输入模块

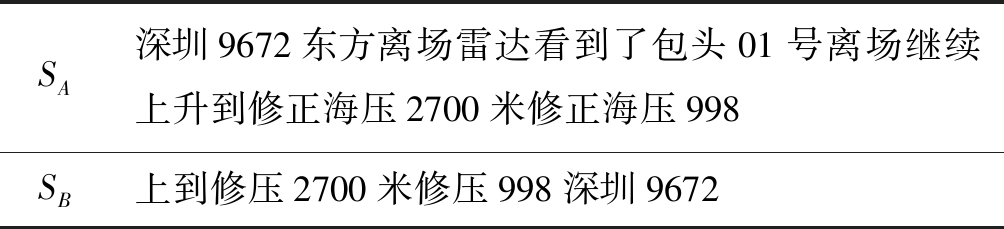

该模块的作用是对陆空通话复诵语料库进行预处理,经过分词、制作词表、生成词向量,从而将句子中的每个词表示为固定维度的词向量。在无线电陆空通话过程中,飞行员在复诵指令时只对指令中的关键信息进行复诵,如表1所示为陆空通话复诵语料库中一个简单的例子,可以看出陆空通话复诵语料库具有的一个特点是复诵指令句子长度一般小于指令句子长度,基于这个特点本文设定输入序列长度分别为管制员发送指令句子文本中最长长度L1和飞行员复诵句子文本中的最长长度L2,对小于最长长度的句子进行补零,即通过该模块可以得到管制员发送的指令序列![]() ...,

...,![]() 和飞行员复诵的指令序列

和飞行员复诵的指令序列![]() ...,

...,![]() 为句子第i个词的词向量表示。本文实验中用到的词向量分别为one-hot词向量和word2vec词向量。

为句子第i个词的词向量表示。本文实验中用到的词向量分别为one-hot词向量和word2vec词向量。

图2 陆空通话复诵语义自动化校验BiLSTM模型

Fig.2 Automatic semantic verification of BiLSTM model for Readbacks in Radiotelephony Communication

表1 陆空通话复诵文本例子

Tab.1 A example of Aviation Radiotelephony Communication readback corpus

SA深圳9672东方离场雷达看到了包头01号离场继续上升到修正海压2700米修正海压998SB上到修压2700米修压998深圳9672

3.2 句子语义特征表达模块

句子特征表达模块是由两个并行的BiLSTM组成,分别对管制员发送的指令序列SA和飞行员复诵的指令序列SB进行特征提取,得到新的句子语义特征表达序列HA、HB,对于陆空通话指令句子中第t个词来说,输入到BiLSTM网络后得到该时刻的输出如式(7)~(9)所示。

...,L

(7)

![]() ...,2,1

...,2,1

(8)

![]() ...,L

...,L

(9)

![]() 是前向LSTM网络在t时刻的输出向量,其包含了t时刻前的所有历史信息,

是前向LSTM网络在t时刻的输出向量,其包含了t时刻前的所有历史信息,![]() 为反向LSTM网络在t时刻的输出向量,其包含了t时刻之后的所有历史信息,ht是

为反向LSTM网络在t时刻的输出向量,其包含了t时刻之后的所有历史信息,ht是![]() 和

和![]() 拼接起来的结果,即BiLSTM网络在t时刻的输出向量,所以BiLSTM的输出向量中包含了前向和反向两方面的特征信息,更适合对陆空通话指令和复诵指令序列进行特征提取。最终得到管制员发送的指令序列和飞行员的复诵指令序列的新特征向量表示

拼接起来的结果,即BiLSTM网络在t时刻的输出向量,所以BiLSTM的输出向量中包含了前向和反向两方面的特征信息,更适合对陆空通话指令和复诵指令序列进行特征提取。最终得到管制员发送的指令序列和飞行员的复诵指令序列的新特征向量表示![]() ...,

...,![]() 和

和![]() ...,

...,![]()

3.3 语义匹配矩阵

通过BiLSTM网络分别对指令SA和复诵指令SB进行特征提取后,得到新的特征向量序列HA、HB,对其进行交互匹配,即计算HA序列中每个时刻的向量与HB序列中每个时刻的向量间的匹配得分,从而生成一个陆空通话指令和复诵指令间的匹配矩阵。本文提出使用神经张量网络来生成匹配矩阵。

神经张量网络是利用多个线性张量层来代替标准的线性神经网络,将两个向量从多个维度上关联起来,对两个向量间的关系有着更细致的表达能力,并且可以根据数据库的大小、复杂程度调整张量层的数目。Socher R等人提出使用神经张量网络来推理两个实体间的关系并取得了很好的结果[15],所以本文实验中,提出引入了神经张量网络层来计算两个向量间的匹配分数,具体计算公式如式(10)所示:

(10)

其中,u、ν分别是两个BiLSTM网络某时刻输出的向量表示,R(u,ν)表示计算得到的u、ν两向量间的匹配分数,i∈[1,2,...,c]为张量层参数,c为切片的个数,Wuv和b是线性部分参数和偏置项。f是一个非线性函数,表达式为: f(z)=max(0, z)。

3.4 陆空通话语义一致性判别模块

为了更好地实现陆空通话复诵语义校验任务,模型训练要尽可能使正样本的匹配分数接近于1,同时负样本的匹配分数接近于0。而陆空通话指令与复诵指令句子对间的匹配结果更多依赖的是具有显著特点的交互特征,所以通过语义匹配模块得到匹配矩阵后,文本采用动态k-Max池化,自动抽取出前k个显著的匹配特征,使模型的泛化性更好。最后,经过动态k-Max池化得到的特征向量p输入到全连接网络(MLP)中获得最终的匹配分数s,具体的计算过程如公式(11)和(12)所示:

q=h(Wqp+bq)

(11)

s=Wsq+bs

(12)

其中Wq和Ws是MLP网络中的参数矩阵,bq和bs是相应的偏置项,h(·)=tanh(·)为激活函数,q为计算出的隐层输出,s为MLP网络的输出结果,即陆空通话指令和复诵指令对间最终的匹配分数。

4 实验与分析

4.1 陆空通话复诵语料库

目前还没有公开的陆空通话复诵语料库,本实验中使用的语料库是由专业的空管人员从大量的陆空通话录音中挑选出的复诵类型语句对组成的,并依照空中交通管制无线电陆空通话标准对文本进行了进一步的校验整理和正负样本标注。语料库的大小为2442对,其中正样本数为1326对(陆空通话指令句子与复诵句子语义一致),负样本数为1116对(陆空通话指令句子与复诵句子语义不一致),在训练过程中,随机抽取500对样本作为测试集,剩余样本作为训练集进行训练。

4.2 实验设置及结果分析

4.2.1 模型设置

实验中使用的one-hot词向量和word2vec词向量维度分别为1027和50。指令和复诵指令的输入长度L1、L2分别为30,25。BiLSTM网络中设置前向和反向的输出维度均为32,即输出1*32的向量序列,则BiLSTM最终的输出为1*64的向量序列,神经张量网络中切片数量c取值为5,语义匹配矩阵大小为30*25。动态k-Max池化中k值设为20,为了避免模型出现过拟合,在训练过程中加入了Dropout,值设置为0.3,模型优化使用了Adam方法,设置学习率的大小为0.001。目标函数使用交叉熵损失函数,如式(13)所示。

(13)

其中θ是模型的参数,n表示样本的总数,yi是第i个样本的真实标签0或1,si表示第i个样本中陆空通话指令和复诵指令句子间的匹配分数。

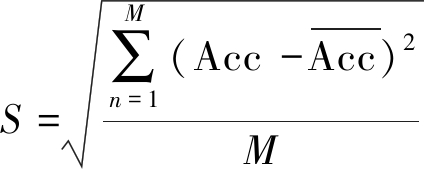

本文使用平均测试精度![]() 和标准差(S)作为模型的评价准则,其计算公式分别如式(14)和式(15)所示。N为总测试样本数,Nacc为测试样本中分类正确的样本数,M为进行随机试验的总次数,

和标准差(S)作为模型的评价准则,其计算公式分别如式(14)和式(15)所示。N为总测试样本数,Nacc为测试样本中分类正确的样本数,M为进行随机试验的总次数,![]() 为M次实验的平均测试精度。

为M次实验的平均测试精度。

(14)

(15)

4.2.2 实验结果与分析

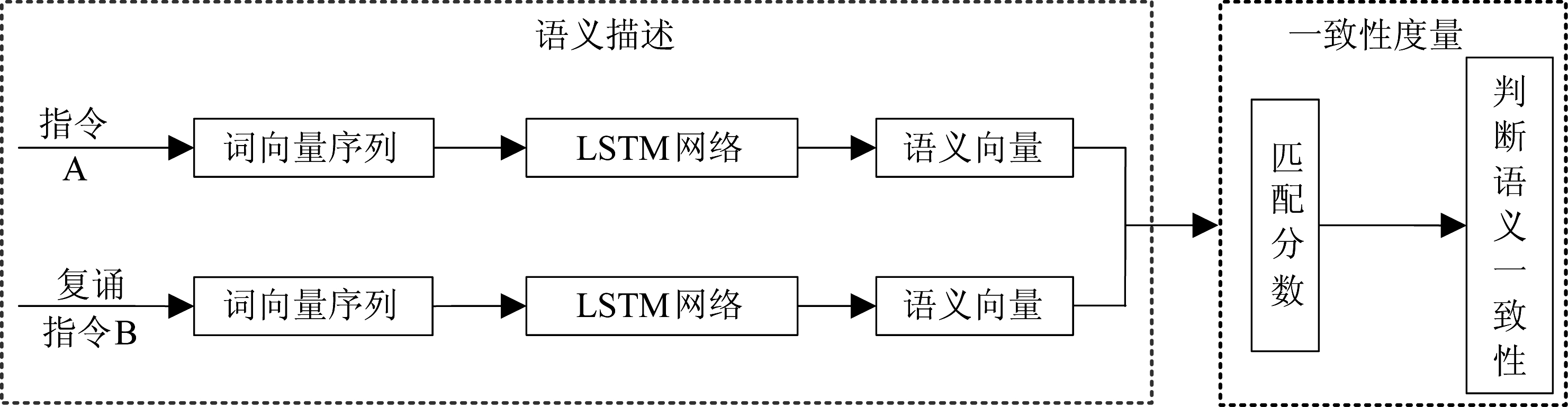

为了比较本文提出的方法的性能,本文对比了传统双通道LSTM句子语义匹配模型(Siamese-LSTM)[16]在陆空通话复诵语义一致性自动校验任务上的实验结果。图3为利用传统Siamese-LSTM模型进行陆空通话复诵语义校验的流程图。该模型是使用两个共享权值的LSTM网络将陆空通话指令和复诵指令句子对映射到同一语义空间,分别得到两个语义向量来作为整个句子的表达,然后直接计算两个语义向量间的匹配分数得到指令和复诵指令间的匹配分数,从而判别复诵语义是否一致。在原文献中计算匹配分数采用的是余弦相似度方法,作为对比,文本实验添加了使用神经张量网络层来计算的匹配分数。

图3 基于传统Siamese-LSTM的陆空通话复诵一致性校验流程图

Fig.3 Procedure for readback consistency verification of Aviation Radiotelephony Communication based on Siamese-LSTM

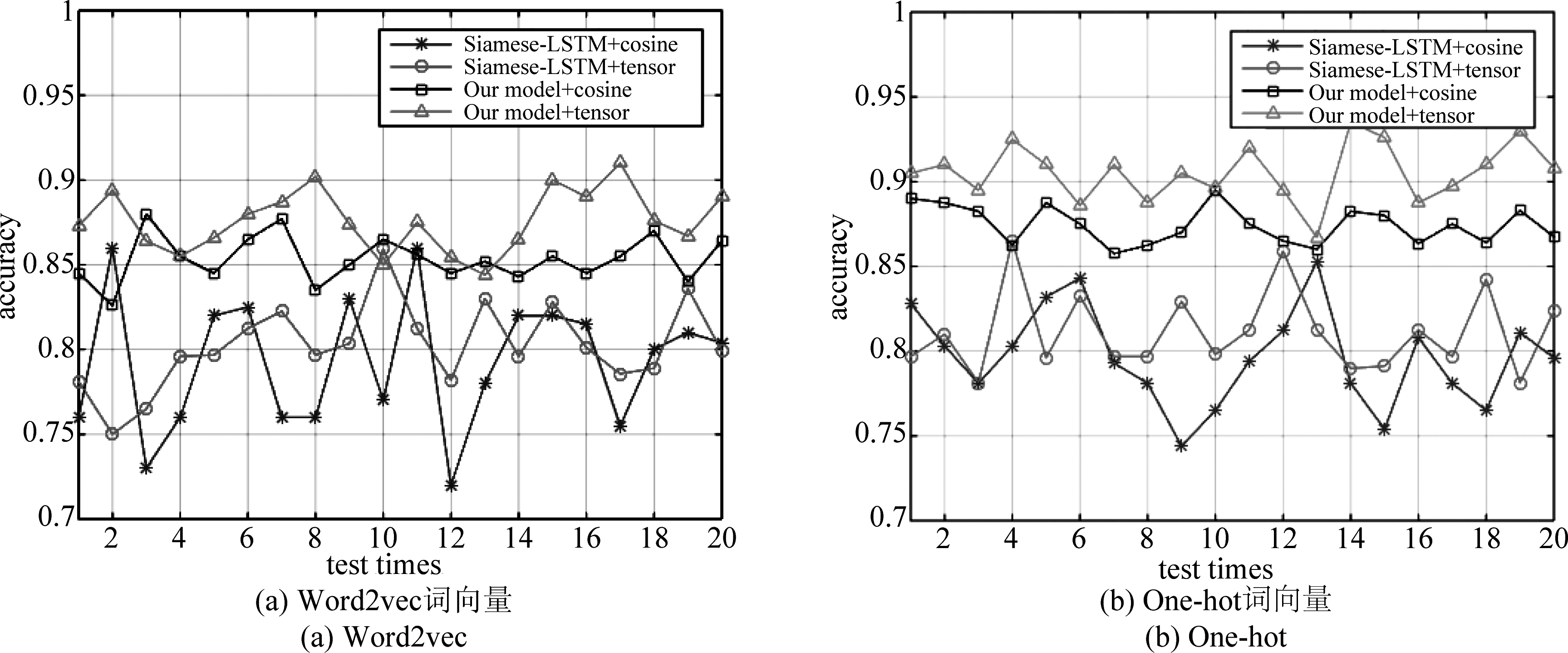

图4 样本测试精度图

Fig.4 Picture of 20 times test accuracy

为了验证本文提出方法的有效性、判别精度及稳定性,本文分别对两个模型进行了20次完整的训练和测试实验,每次实验都是按4∶1的比例随机划分训练集和测试集,并且都使用余弦相似度(cosine)和神经张量网络(tensor)两种方法来生成语义匹配矩阵和计算匹配分数,最后计算出两个模型不同方法的平均测试精度和标准差。图4展示了两个模型分别以word2vec词向量和one-hot词向量作为模型输入得到的20次测试集语义校验精度对比结果图。

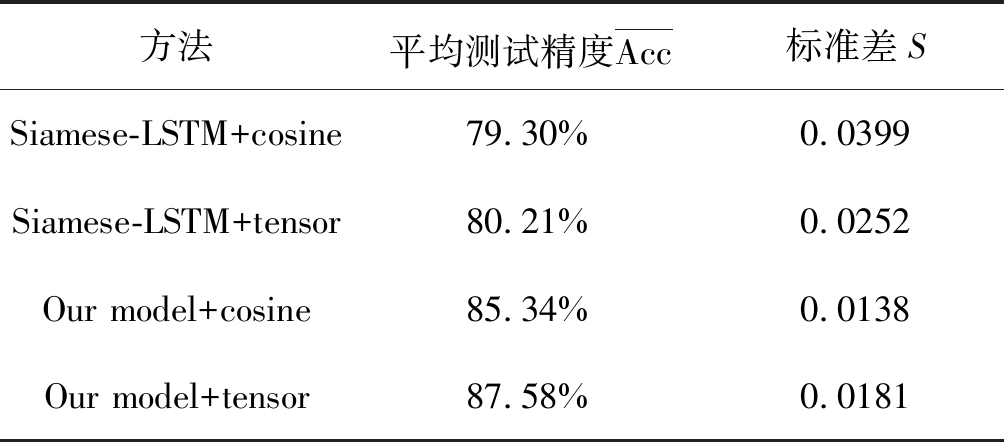

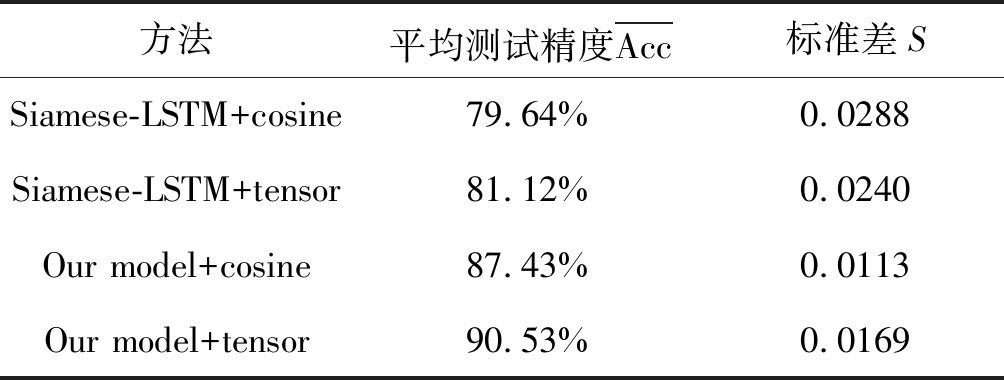

图(a)为利用word2vec词向量进行训练得到的测试结果对比图,图(b)为利用one-hot词向量训练得到的测试结果对比图。表2和表3中给出了word2vec词向量和one-hot词向量分别作为模型输入时,本文方法与传统Siamese-LSTM模型的实验结果的平均测试精度和标准差。

表2 word2vec 的实验结果

Tab.2 The experimental results of word2vec

方法平均测试精度Acc标准差SSiamese-LSTM+cosine79.30%0.0399Siamese-LSTM+tensor80.21%0.0252Our model+cosine85.34%0.0138Our model+tensor87.58%0.0181

表3 one-hot的实验结果

Tab.3 The experimental results of one-hot

方法平均测试精度Acc标准差SSiamese-LSTM+cosine79.64%0.0288Siamese-LSTM+tensor81.12%0.0240Our model+cosine87.43%0.0113Our model+tensor90.53%0.0169

实验结果显示,本文提出的方法在陆空通话复诵语义自动校验任务中是有效的,并且在准确度和稳定性方面都是优于传统Siamese-LSTM模型的,精度可达90.53%。主要由于模型中引入了语义交互匹配思想,不再像传统双通道模型只是在句子级别对语义特征进行匹配,而是同时在词级别、句子级别进行了匹配,得到更细粒度的匹配特征;同时利用神经张量网络作为语义匹配方法,可以更准确描述陆空通话指令和复诵指令间的语义关系。在陆空通话复诵语义校验任务中,one-hot词向量作为输入比word2vec向量作为输入取得了更好的实验结果,主要的原因是目前使用的陆空通话复诵语料库数据量较小,word2vec词向量不能够充分的得到训练,同时基于陆空通话复诵语料库语言结构的特殊性,每条样本主要是由几个指令动词短语组合而成,词间的语义联系并没有普通语料库紧密。

5 结论

在航空运输过程中,由于飞行员没有对管制员下达的指令进行正确的复诵并且管制员未能及时准确地对复诵语义进行校验而导致的飞行事故并不少见。目前民航系统主要依靠管制员对飞行员返回的复诵指令进行人工的校验,在实际飞行任务中,受多种外界因素的影响,很容易出现管制员对飞行员的复诵指令未校验或校验错误的情况。本文提出一种新方法实现对陆空通话复诵语义自动校验,可以节省人力,并在一定程度上提高了校验精度。该方法是通过BiLSTM网络将陆空通话指令中每个词表达为含有丰富上下文信息的特征向量,并在词级别和句子级别对指令和复诵指令进行交互匹配,得到指令间的语义匹配矩阵,然后再自动的抽取出显著的匹配特征进行语义校验。该模型的优点引入语义交互匹配的思想,不仅能够捕捉到句子内部以及句子上下文的语义信息,又可以充分地捕捉到指令和复诵指令间的匹配特征,从而更好地实现陆空通话复诵语义自动校验。为验证本文提出的方法性能,在陆空通话复诵语料库上进行了一系列相关实验,并与传统的双通道LSTM模型进行了对比。实验结果证明,本文提出的方法在陆空通话复诵语义自动校验任务上是有效的并取得了良好的效果。

[1] 王万乐, 赵琦. 空中交通管制员无线电陆空通话[M]. 北京: 北京交通大学出版社, 2016.

Wang Wanle, Zhao Qi. Radiotelephony Communications for Air Traffic Controllers[M]. Beijing: Beijing Jiaotong University Press, 2016.(in Chinese)

[2] 董昱廷.陆空通话对飞行安全影响的分析[J]. 移动信息, 2016(6): 162- 163.

Dong Yuting. Analysis of Radiotelephony Communication Impact on Flight Safety[J]. Journal of Mobile Information, 2016(6): 162- 163.(in Chinese)

[3] 崔振新, 杜晓雨. 中国民航安全信息传播效果分析[J]. 安全与环境工程, 2016, 23(2): 71-74.

Cui Zhenxin, Du Xiaoyu. Analysis of Communication Effects of Civil Aviation Safety Information in China[J]. Safety and Environmental Engineering, 2016, 23(2): 71-74.(in Chinese)

[4] 吴欣. 空中交通无线电陆空通话错误解析[J]. 通讯世界, 2016(15): 85- 85.

Wu Xin. Error Analysis of Aviation Radiotelephony Communication[J]. Telecom World, 2016(15): 85- 85.(in Chinese)

[5] 黄隐. 空中交通无线电陆空通话错误分析[J]. 军民两用技术与产品, 2016(20): 283-283.

Huang yin. Error Analysis of Air Aviation Radiotelephony Communication[J]. Dual Technologier and Products, 2016(20): 283-283.(in Chinese)

[6] Chaturvedi Arvind K, Craft Kristi J, Hickerson Jeffery S, et al. Ethanol and Drugs Found in Civil Aviation Accident Pilot Fatalities, 1989-2013[J]. Aerospace Medicine and Human Performance, 2016, 87(5): 470- 476.

[7] Wang Zhiguo, Hamza W, Florian R. Bilateral Multi-Perspective Matching for Natural Language Sentences[J]. Proceedings of the Twenty-Sixty International Joint Conference on Artificial Intelligence, 2017(25): 4144- 4150.

[8] 姜莹, 俞一彪. 采用特征分类直方图均衡化的鲁棒性语音识别[J]. 信号处理, 2011,27(6): 896-900.

Jiang Ying, Yu Yibiao. Robust Speech Recognition Using Histogram Equalization of Classified Features[J]. Signal Processing, 2011,27(6): 896-900.(in Chinese)

[9] 王蒙蒙, 关欣, 李锵. 基于鲁棒音阶特征和测度学习SVM的音乐和弦识别[J]. 信号处理, 2017, 33(7): 943-952.

Wang Mengmeng, Guan Xin, Li Qiang. Musical Chord Recognition Based on Robust Pitch Class Profile and Metric Learning Support Vector Machine[J]. Journal of Signal Processing, 2017, 33(7): 943-952.(in Chinese)

[10] Palangi H, Li Deng, Shen Yelong, et al. Deep sentence embedding using long short-term memory networks: analysis and application to information retrieval[J]. IEEE/ACM Transactions on Audio Speech & Language Processing, 2016, 24(4): 694-707.

[11] Qiu Xipeng, Huang Xuanjing. Convolutional neural tensor network architecture for community-based question answering[C]∥International Conference on Artificial Intelligence, 2015: 1305-1311.

[12] Wan Shengxian, Lan Yanyan, Guo Jiafeng, et al. A deep architecture for semantic matching with multiple positional sentence representations[C]∥Thirtieth AAAI Conference on Artificial Intelligence, 2016: 2835-2841.

[13] Pang Liang, Lan Yanyan, Guo Jiafeng, et al. Text Matching as Image Recognition[J]. AAAI Conference on Artificial Intelligence, 2016,2793-2799.

[14] Hochreiter S, Schmidhuber J. Long short-term memory[J]. Neural Computation, 1997(9): 1735-1780.

[15] Socher R, Chen Danqi, Manning C, et al. Reasoning with neural tensor networks for knowledge base completion[C]∥International Conference on Neural Information Processing Systems, 2013: 926-934.

[16] Jia Guimin, Lu Yujun, Lu Weibin, et al. Verification method for Chinese aviation radiotelephony readbacks based on LSTM-RNN[J]. Electronics Letters, 2017, 53(6): 401- 403.