1 引言

在银行、机场和保密机构等敏感场所内对人体目标进行身份验证和识别具有非常重要的意义。近些年来,基于光学和红外视频数据的身份认证研究发展迅速,利用光学和红外传感器获得的信息进行人体步态识别、跟踪已经得到很多的应用,尤其是近年来,深度学习理论应用于目标识别和跟踪取得了巨大进展。文献[1]利用9层卷积神经网络对在野外采集的4000幅人脸样本识别,准确率达到了97.35%。文献[2]基于SVM分类器识别夜晚及复杂噪声环境下人体红外图像特征,识别正确率达到了71%~90%。但是这种被动成像的方式受环境影响大,在伪装条件下识别率波动较大。由于雷达身份认证技术具有不直接接触人体、不涉及人身侵犯、被监测者不容隐藏和伪装,并且能够实现远距离识别的优势,近几年来开始受到重视。其中,基于雷达目标微多普勒效应的身份认证是一个重要的研究方向。

所谓“微多普勒效应”,指的是雷达目标或目标结构中的旋转、振动、摆动等微小运动对雷达回波信号产生多普勒频率调制的物理现象[3-7]。微多普勒效应是目标精细运动特征在雷达回波中的反映,被认为是目标的独特特征,人体微动特征包含了人体运动状态和身体姿态的有效信息。通过分析人体回波微多普勒效应并提取相应的微动特征,可为人体目标的认证与识别提供重要依据[8]。

自从V.C Chen博士首次利用雷达信号提取人体微动特征并应用于救援、监测、安保等领域,国内外许多学者使用雷达传感器分析人体微动特征,并开展了许多人体步态识别的研究[9-12]。而这些方法大部分集中在基于信号处理和谱图分析的方法,直接从信号中提取可参数化表征的物理特征。随着深度学习理论在各个领域取得显著的成果。2016年,加州大学的Youngwook教授利用卷积神经网络进行人体目标检测和人体行走/跑步态分类[13]。荷兰代尔夫特大学的Trommel利用14层卷积神经网络进行多人与单人区分,用以验证深度学习进行人体微动步态识别的有效性[14]。这些研究大都是针对可分性较好的人体运动类型辨别(行走/跑步等)来开展研究的,而身份认证需要提取差异较小的微动特征,提取微动信号特征的本质就是对其分布函数的无限逼近。高精度的拟合数据分布需要深层次的网络结构和大规模的训练样本,随着层数的堆叠,再加上大量训练样本难以获取,容易使网络发生“过拟合”。

本文针对不同人的同一步态的微动信号难以区分的问题,构建深度网络对不同人的走路步态进行学习,提取出不同人的微动特征,进而实现身份认证。该方法首先分析人体运动姿态在雷达信号中的微动表征,通过构建人体微动深度卷积神经网络,用完备的MNIST数据集预训练模型,提高了识别精度。

2 人体微多普勒效应分析

人体运动是典型的非刚体铰接式运动[15],由身体各部位的关联运动组合而成,其运动形式极其复杂,身体的运动基本上是一个轻微的身体摇摆和头部运动的反映,来回摆动的胳膊和腿是主要的微动来源。人体微动特征的强耦合性使得目前很难使用参数化方法表示。“深度学习”是通过多层神经网络模拟人的大脑的学习过程。一方面,微动特征无法用解析模型进行描述,但是深度网络的非线性结构可以无限逼近分布,实现模型构建,另一方面,深度学习的多层卷积层和池化层的结构,可以从学习低级特征逐渐学习出高级特征,实现从大量样本数据中学习数据本质特征。因此可以设计合理的深度神经网络学习微动信号,从而得到人体微动特征。

微动本质上是一种非匀速运动或非刚体运动,目标微动特征信号具有非线性和非平稳的特点,因此对目标微动特征分析和处理核心问题是对时变信号的处理[3]。人体雷达回波信号本是一维的时域信号,直观上很难看出频率变化规律。如果通过傅里叶变换把它变到频域上,虽然可以看出信号的频率分布,但会丢失时域信息,无法看出频率分布随时间的变化规律。为解决此问题,很多时频分析手段应运而生,短时傅里叶变换,小波变换,Wigner分布等都是常用的时频域分析方法。

短时傅里叶变换(STFT)是最早提出的一种时频二维表示方法,它采用加窗的复正弦作为基函数,也称为加窗傅里叶变换。实际应用中常采用它的能谱基于短时傅里叶变换的谱图表示。谱图定义为STFT的模平方,它是二次型时间-频率分布,是信号能量在时间频率平面上的分布。谱图已经在信号检测,语音处理等方面得到了广泛应用。

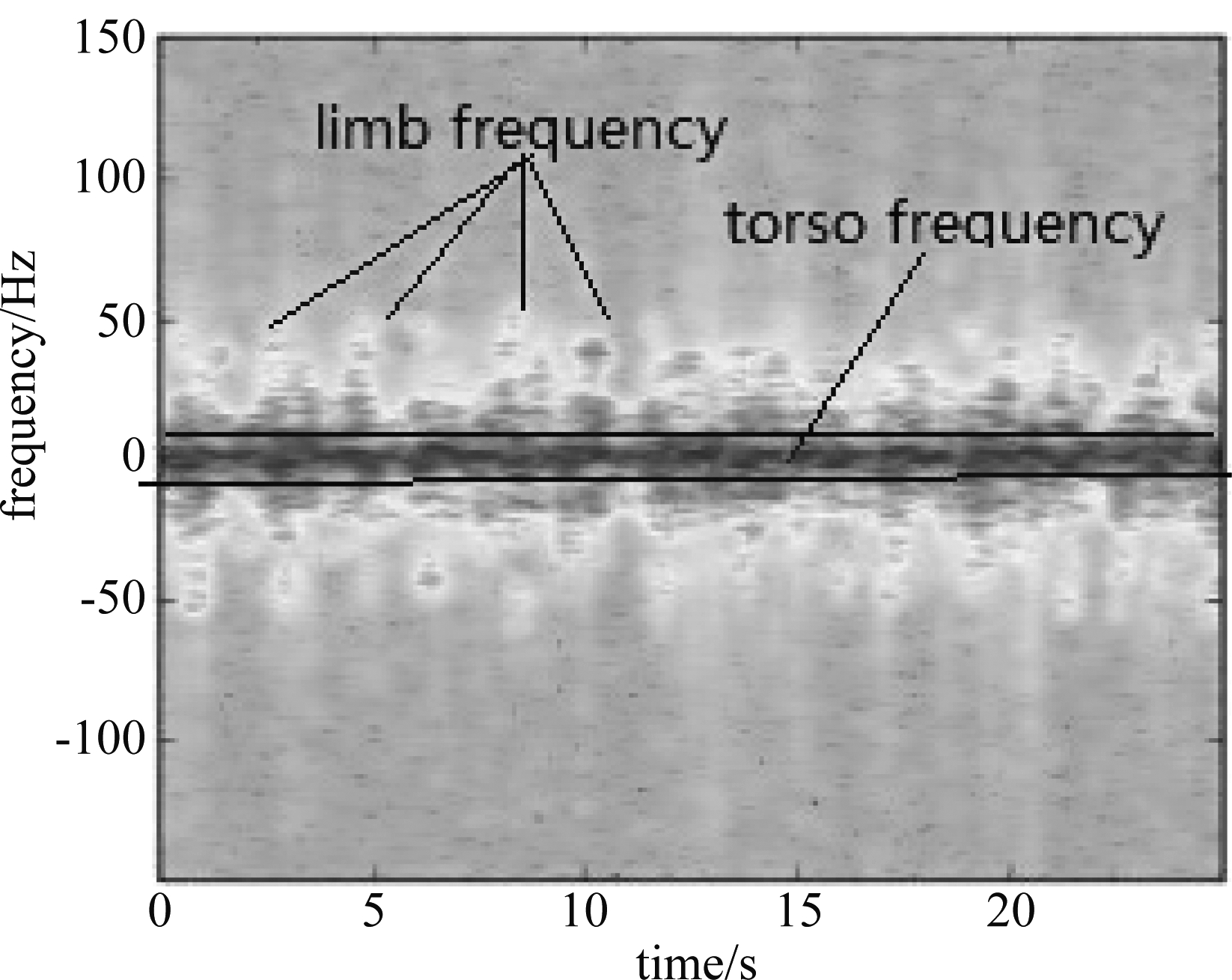

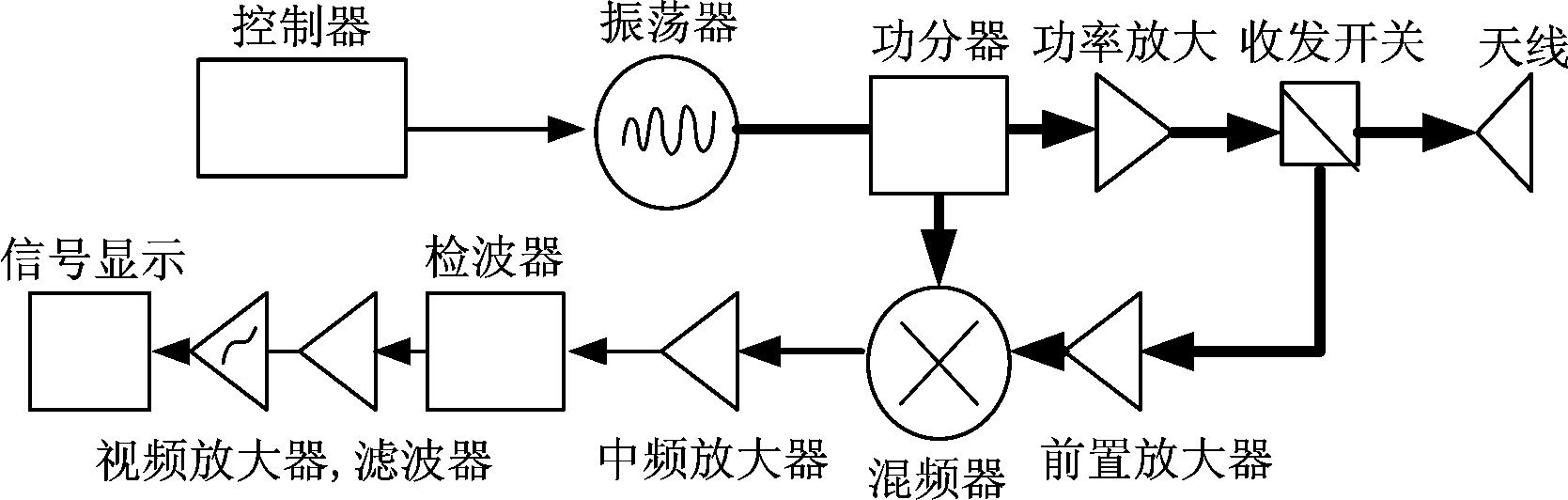

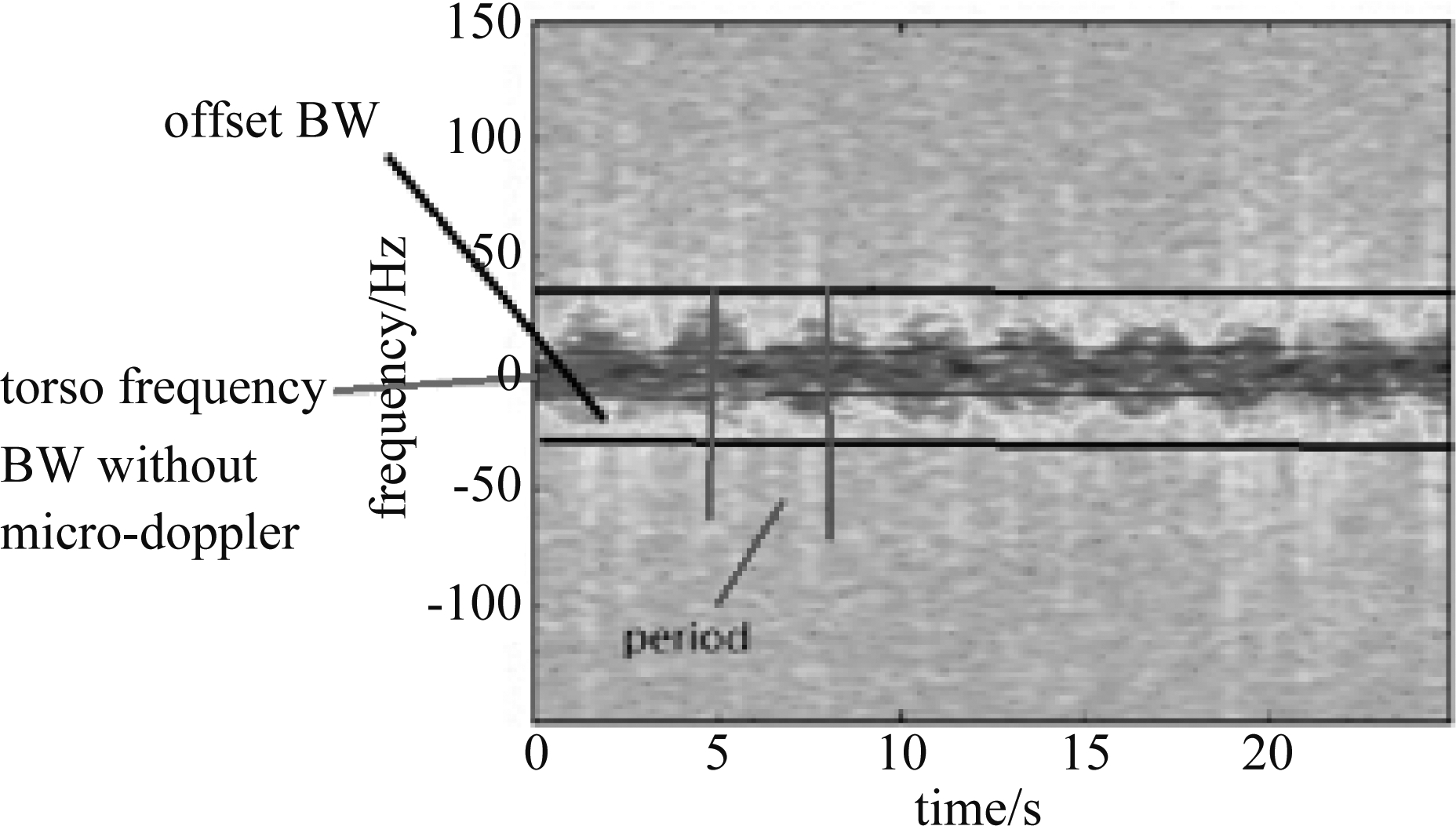

本文使用的测量雷达数据由微波暗室的简易雷达采集。雷达发射信号载频10 GHz,对雷达回波数据做STFT变换得到时间-频率图像如图1所示。图中可以看到人身体微多普勒频移具有微小的锯齿形状,但手臂的微多普勒频移是时变周期曲线。

图1 雷达回波时间-频率图像

Fig.1 Radar echo time-frequency image

不同人的同一姿态下的时频谱图直观上差异较小,但最大峰值和摆动周期等仍存在着细微的差异。卷积神经网络的卷积层有多个卷积核,用这些卷积核对输入图像的局部区域依次做卷积运算,可以得到大量的卷积特征映射图,把这些映射图作为原始图像输入下一层卷积层,再进一步提取更高级的特征,直到学习到可用于进行微动图像分类的特征。基于卷积神经网络抽象的高级特征可以识别不同人的微动特征,进而实现身份认证。

3 卷积神经网络

3.1 网络结构

卷积神经网络是一种深度学习网络,一个卷积神经网络主要包括卷积层、池化层、全连接层和soft-max层。

卷积层(convolutions)是网络的核心,每个卷积层都有多个卷积核。卷积核对图像的局部区域进行卷积变化后再传到后面的网络。每一层卷积都会提取数据中最有效的特征。多层卷积将组合和抽象更高阶的特征。具体运算如公式所示:

xm,i=f(cm*ai+bm,i)

(1)

其中,cm是第m个卷积核,ai是原始图像的第i块局部区域,bm,i代表对应的偏置项参数。f是非线性激活函数,这里采用Relu函数。其函数表达式为:

f(x)=max(x,0)

(2)

池化层(subsampling)的主要作用是对输出做筛选降维,同时不破坏数据的内在联系。池化策略包括中值池化、平均池化和最大池化等。文献[16]证明了最大池化效果好于其他策略,故本文使用最大池化方法。具体的运算过程如式(3)所示:

(3)

其中,xm是对n×n的特征矩阵求得的最大值。

作为分类器的全连接层(full connection)和softmax层将前面学到的特征映射到样本标记空间,然后计算每一类的概率值。

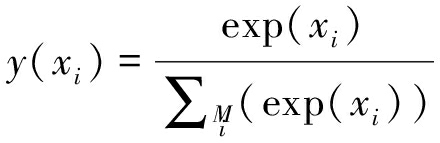

softmax的计算公式如下:

(4)

其中xi是第i类目标的置信度,y(xi)是第i类目标的概率。

3.2 迁移学习和网络预训练

迁移学习主要包含“域”和“任务”的概念。每个域D由特征空间χ以及边际概率分布P(X)组成,且X=x1,...,x2∈χ。给定一个域D={χ,P(X)},一个任务T则可以通过由一个标签空间Y以及一个目标函数f组成。此目标函数可以通过训练集中的带标签数据训练得到,然后用来预测新数据的标签。从概率的角度来看,此目标函数可以被表示为条件概率分布的形式P(y|x)。给定一个源域Ds,一个原任务Ts,一个目标域Dt,一个目标任务Tt,迁移学习的目的是借助源域和原任务提高目标函数f在目标域的分类结果。

迁移学习的思想就是将一个问题上训练好的模型通过简单的调整使其适用于一个新的问题。卷积神经网络分类器之前的层被称之为瓶颈层[13],瓶颈层的作用是提取图像特征,用完备数据集预训练得到CNN分类模型,可以认为瓶颈层已经具备了抽象高级特征的能力,因此,在新的数据集上,可以直接利用这个瓶颈层对图像进行特征提取,然后把提取到的高级特征作为数据来训练一个分类器,从而实现原始图像的分类问题。用MNIST数据作为原任务中的样本集,预训练卷积神经网络,在用人体微动数据集作目标任务中的样本集,在预训练网络基础上再训练一个softmax分类器,最后用人体微动数据集测试网络性能。

4 数据采集与处理

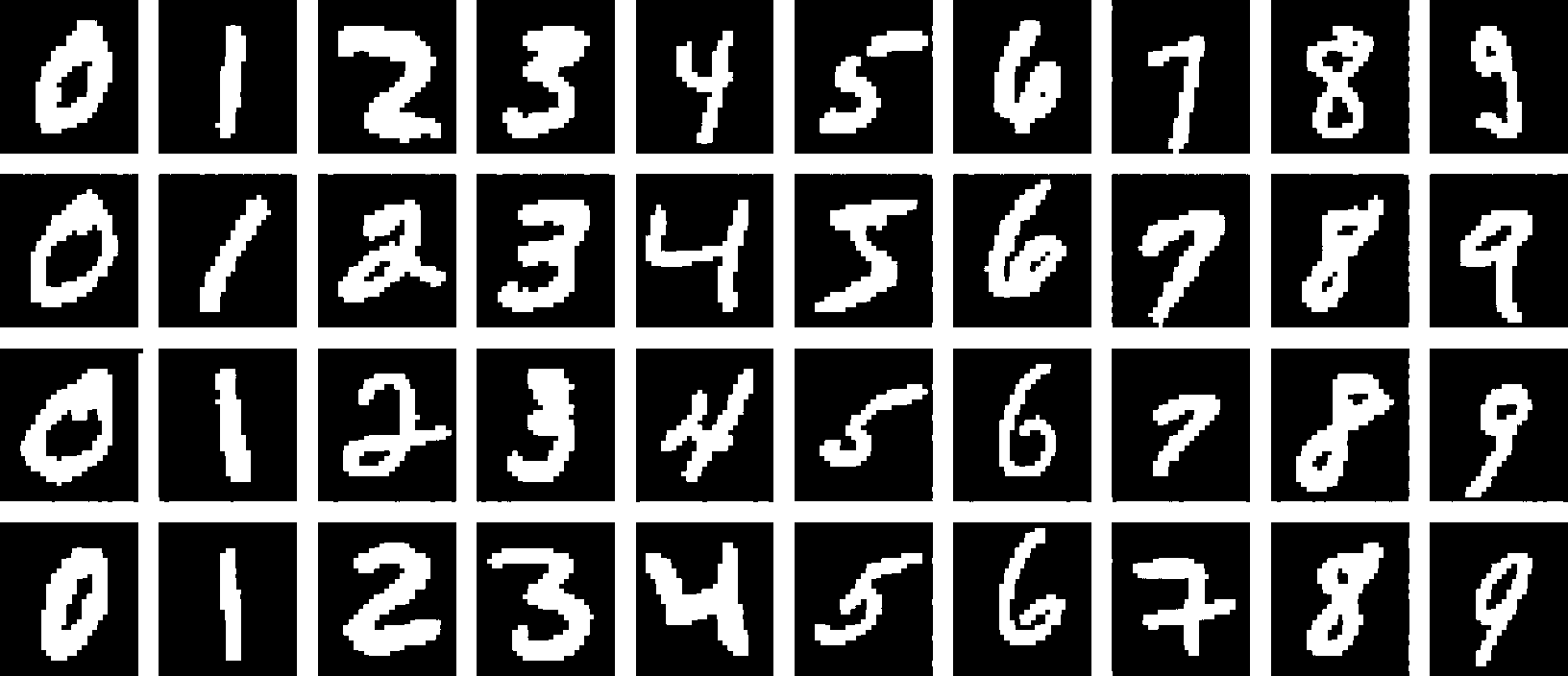

4.1 MNIST数据集使用方法

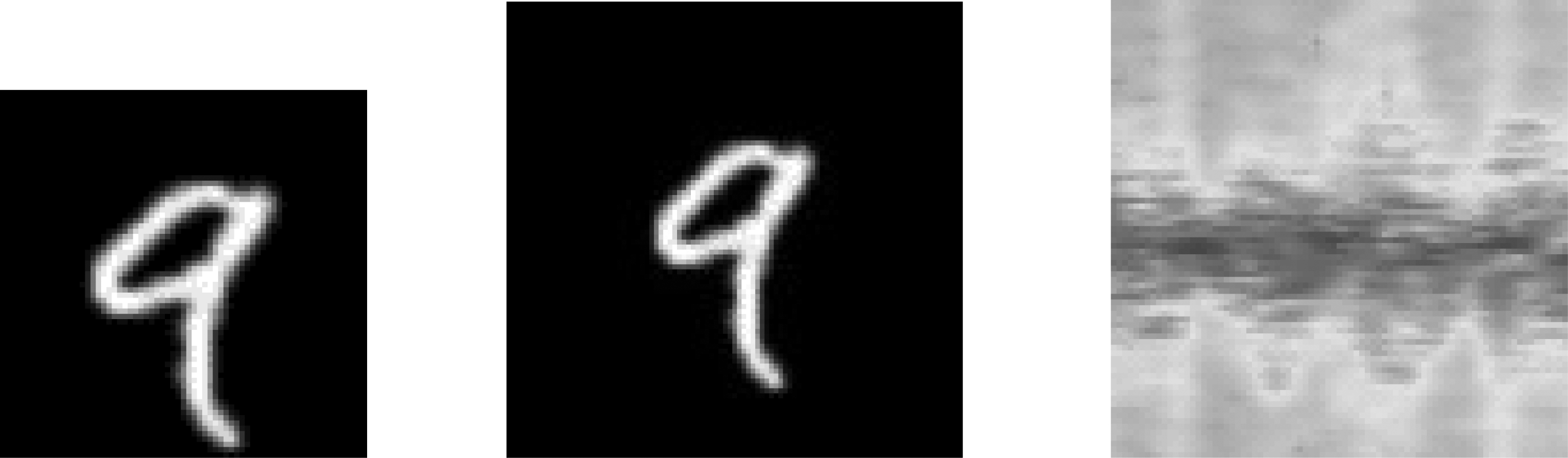

MNIST数据集是一个手写体数字识别数据集。包含了60000张图片作为训练数据,10000张图片作为测试数据。每张图片都代表了0~9中的一个数字。图片大小为28×28,且数字都会出现在图片的正中间。如图2所示。

图2 MNIST数据集样本图

Fig.2 MNIST dataset sample diagram

每幅图都有一个输入值x和一个标签值y,x即图片的像素值,是一个28×28的二维矩阵,矩阵中每个元素取值范围是0~255。y表示图片中数字的大小,取值范围是0~10,实验常用one-hot编码值表示。例如:数字1被编码为(0,1,0,0,0,0,0,0,0,0,0)。

4.2 采集人体微动数据

实验所用的原始数据是在微波暗室中采集的人体雷达回波。采集设备包括矢量射频信号源、射频电路、实时信号分析仪、收发天线等。矢量射频信号源发射载频为10 GHz的单频连续波信号,通过射频电路到发射天线照射被采集者,接收天线收到回波信号显示在示波器是并对原始数据存储。

图3 信号采集系统实验原理图

Fig.3 Microwave darkroom data acquisition scene

实验采集了6个不同人的数据,其性别、体型、走路习惯都存在不同的差异。本次实验只需分辨同一步态下的不同的人,因此,标签信息只需要标记不同人的类别。其他先验特征信息可在以后人体特征刻画、目标还原等研究中使用。

图4 人体微动数据采集实验平台

Fig.4 Human micro-motion data acquisition radar

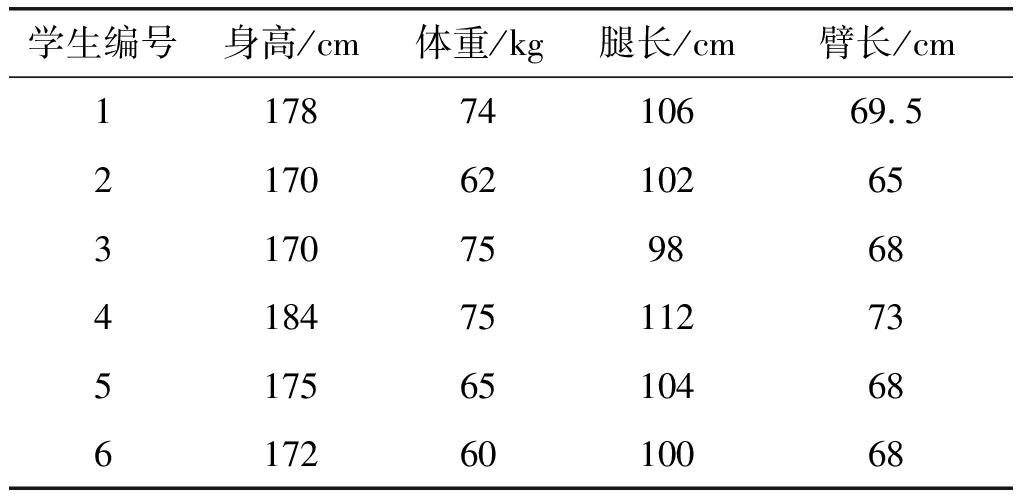

表1 学生身高体重分布

Tab.1 Students’height and weight distribution

学生编号身高/cm体重/kg 腿长/cm臂长/cm11787410669.5217062102653170759868418475112735175651046861726010068

4.3 数据预处理

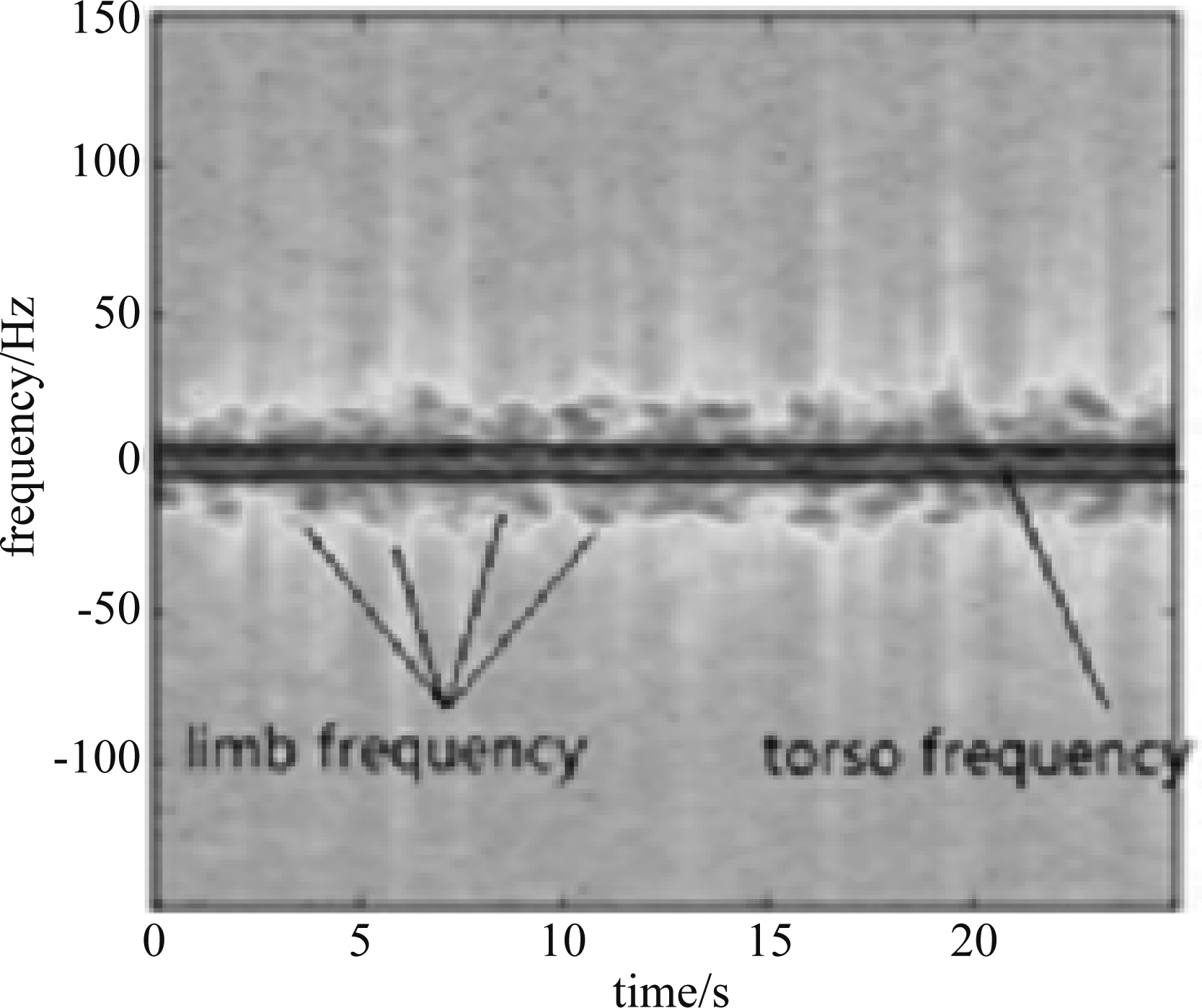

对采集的雷达回波进行短时傅里叶变换,得到人体目标的微动谱图如图5所示。

谱图中回波包含人体各部分肢体雷达回波的叠加,其中中间颜色较深的是躯干回波,它的反射强度最大,频率较小,外围浅色的是人体四肢的雷达回波,具有一定的周期性。识别不同人需要卷积神经网络学习一些表征四肢的协调性、走路习惯等细节特征,这些无法直接在谱图中体现。

图5 原始雷达回波时间-频率图

Fig.5 Original radar echo time-frequency chart

人行走具有周期性,加之谱图中频率较高部分可用信息较少。人体微动谱图数据集中图像的原始尺寸为126×136,图像中包含多个周期的信息。实验中,从每幅图像中截取图像子块作为训练图像,图像子块的像素尺寸为35×35,并包含了人体绝大部分回波信息以及相关位置信息,对图片进行标记后制作数据集,每个样本包括一个像素矩阵x和一个标签值y。首先把同一个人的样本图片放到文件夹中,文件夹用标签值y命名,然后用python读入数据转化成Tfrecord格式的文件。

实验两次训练分别用到了MNIST数据集和人体微动谱图数据集。MNIST数据集中每幅图像的尺寸为28×28,由于两个数据集中的尺寸不同。因此,我们首先在MNIST图像周围填充像素,改变图像的尺寸,使得与微动谱图图像目标尺寸一致。图7是填充后两个数据集图像的示例。

5 实验结果及分析

本实验操作是在ubuntu操作平台上,在Tensorflow框架下运行,主频2.8 Ghz,运行内存8 G,没有使用GPU参与运算。

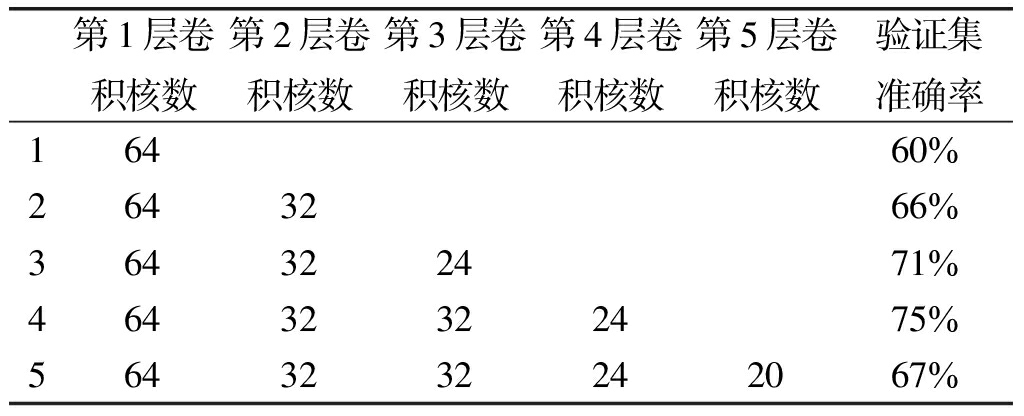

5.1 超参数优化

对于网络结构和参数的优化,采用循环验证方法。把训练数据集D分成两个不相交的子集D1,D2,其中子集D1用于训练模型参数(m,n),m是卷积层数,n是卷积核数目。子集D2用于估计训练后的泛化误差。不断更新超参数并验证准确率。最终找到一组较好分辨效果的参数设置。

图6 人体微动样本图

Fig.6 Human micro-sample map

图7 填充后数据集

Fig.7 Dataset after filling

表2 超参数设置

Tab.2 Hyper-parameter settings

第1层卷积核数第2层卷积核数第3层卷积核数第4层卷积核数第5层卷积核数验证集准确率16460%2643266%364322471%46432322475%5643232242067%

随着隐层层数的增加,网络训练效果更好,分类识别结果更高。当然并不是网络深度越深越好,网络的深度取决于网络模型及输入数据的规模,若数据规模并不大,盲目地增加网络深度,效果提升并不会太大,反而增大了计算量。目前参数调整依靠手动优化,对不同的样本需要重新调试,寻找最优方案困难且费时费力,设计自适应超参数优化研究将是下一步的工作重点。

5.2 不同方法实验对比

为了验证方法的有效性,实验分别做了直接用人体微动数据集训练CNN和用MNIST数据集预训练CNN以及提取谱图结构特征三种方法。

图8 谱图特征示意图

Fig.8 Spectrum features

提取谱图结构特征的方法通过谱图计算躯干多普勒频率、多普勒信号的总带宽(BW)、总多普勒偏移、没有微多普勒的带宽、多普勒信号强度和肢体运动的周期[17]这6项特征值,用一个1×6向量输入softmax分类器。

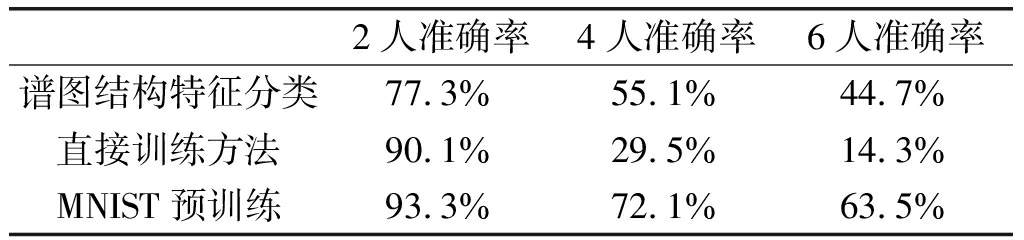

表3 实验结果对比

Tab.3 Comparison of experimental results

2人准确率4人准确率6人准确率谱图结构特征分类77.3%55.1%44.7%直接训练方法90.1%29.5%14.3%MNIST预训练93.3%72.1%63.5%

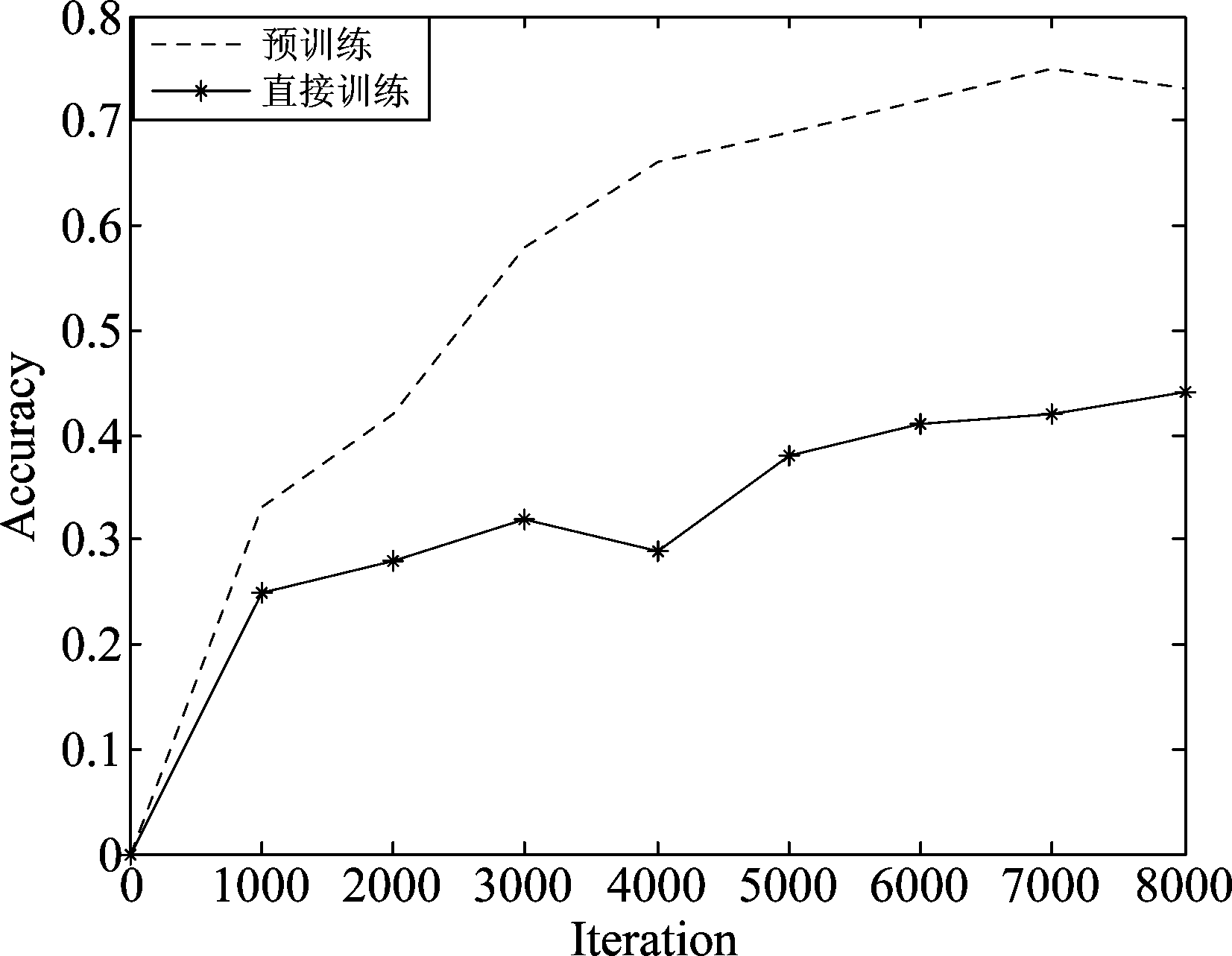

利用谱图结构特征进行分类,对于目标差别明显(比如人、车)的分类问题效果较好[17],但是对于不同人体目标,这些特征信息差异小,导致识别准确率较低。使用卷积神经网络不需要人工提取特征,网络均能自动学习,使用数据集预训练得到的CNN网络,对人体目标身份认证准确率更高,尤其在分类人数增多时,直接训练准确率降低,而预训练的网络4人识别率仍然可以达到72%。直接训练准确率较低是因为:人体微动数据样本较小,直接训练的网络容易“过拟合”,模型的泛化能力差,测试集准确率低于训练结果。

图9 测试集准确率变化对比

Fig.9 Test accuracy comparison

5.3 加噪分析

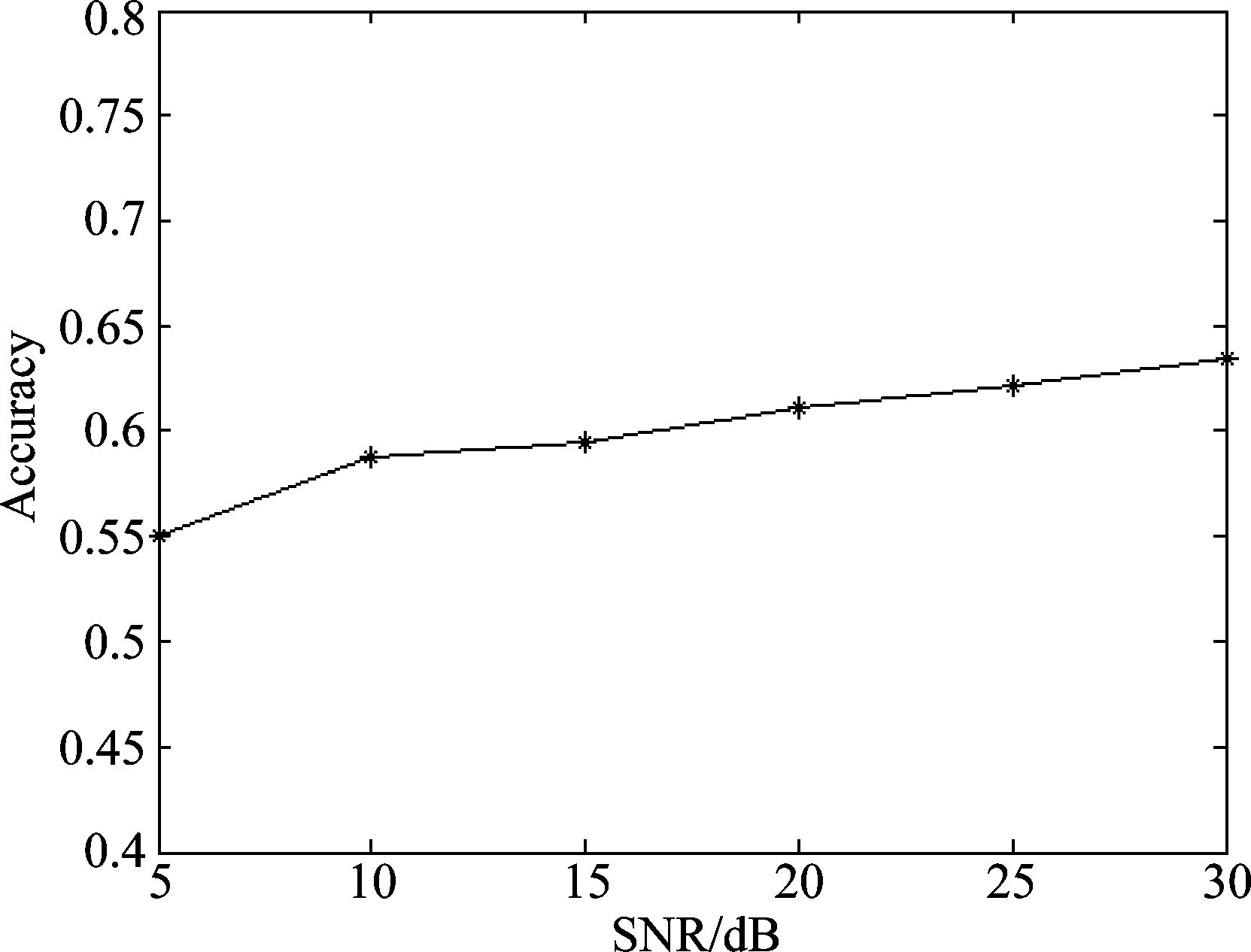

为了进一步验证方法的鲁棒性,进行不同信噪比条件下实验对比。用添加高斯噪声的方法对数据进行加噪处理,其信噪比分别为30 dB,25 dB,20 dB,15 dB,10 dB,5 dB。

图10 测试集准确率随信噪比变化曲线

Fig.10 Accuracy curve with SNR

经过添加高斯噪声后,依然能取得不错的识别效果,虽然随着信噪比的降低,识别准确率有所下降。注入噪声是数据增强一种方法,通过对原始样本加入噪声扰动,可以看作一个人不同的样本数据,把加噪样本加入数据集可以增加标记样本数量。

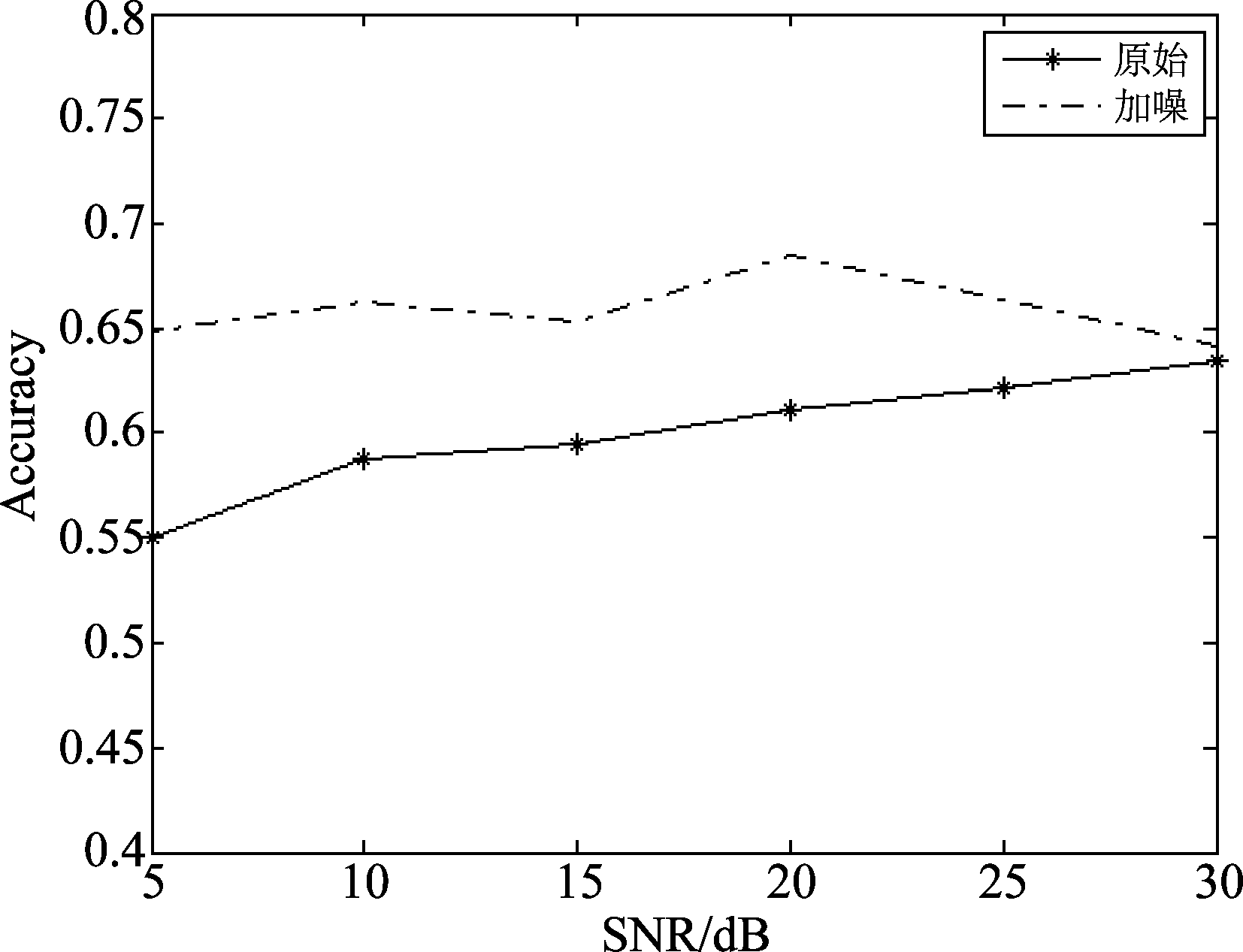

图11 准确率对比

Fig.11 Accuracy comparison

由图11可以看到使用添加噪声的样本之后,分类准确率提高了,因为添加加噪样本,数据集变大,训练的模型泛化能力更强。在添加信噪比20 dB的噪声,6人分辨率达到了最高的68%。

6 结论

人体微动特征是人体独有的特征,本文对人体走路时微动特征进行分析,通过用MNIST数据集预训练卷积神经网络,并对数据加噪扩充了数据集容量,提高了网络泛化能力,解决了小样本集数据过拟合问题,使用卷积神经网络的人体微动特征的时间-频率图像进行分类,实现了较高的准确率。实验证明了方法的有效性。在自适应超参数设置、添加噪声隐层的选择、添加噪声样式和幅度等加噪技巧还需进一步研究。

参考文献

[1] Taigman Y, Yang M, Ranzato M, et al. Deep Face: Closing the Gap to Human-Level Performance in Face Verification[C]∥Computer Vision and Pattern Recognition. IEEE, 2014:1701-1708.

[2] Lu Z, Xu Y C, Dai Z X, et al. A Gait Recognition Based on Link Model of Infrared Thermal Imaging[C]∥International Conference on Control Science and Systems Engineering. IEEE, 2016.

[3] Zhang Q, Luo Y, Chen Y A. Micro-Doppler Characteristics of Radar Targets[M]. Elsevier Press, 2016.

[4] 陈小龙, 关键, 董云龙,等. 稀疏域海杂波抑制与微动目标检测方法[J]. 电子学报, 2016, 44(4):860- 867.

Chen Xiaolong, Guan Jian, Dong Yunlong, et al. Sea Clutter Suppression and Micromotion Target Detection in Sparse Domain[J]. Acta Electronica Sinica, 2016, 44 (4): 860- 867. (in Chinese)

[5] 陈小龙, 关键, 于晓涵,等. 基于短时稀疏时频分布的雷达目标微动特征提取及检测方法[J]. 电子与信息学报, 2017, 39(5):1017-1023.

Chen Xiaolong, Guan Jian, Yu Xiaohan, et al. Radar Micro-Doppler Signature Extraction and Detection via Short-time Sparse Time-frequency Distribution[J].Journal of Electronics & Information Technology, 2017, 39 (5): 1017-1023.(in Chinese)

[6] Chen Y J, Zhang Q, Ma C Z, et al. Micromotion Feature Extraction of Radar Target Using Tracking Pulses with Adaptive Pulse Repetition Frequency Adjustment[J]. Journal of Applied Remote Sensing, 2014, 8(1): 083569(1)- 083569(14).

[7] 郝文涛,张群,罗迎,等.基于特征投影预处理零陷加深的抗主瓣干扰算法[J].空军工程大学学报:自然科学版,2018,19(1),40- 45.

Hao W T, Zhang Q, Luo Y, et al. Mainlobe Jamming Suppression Algorithm Based on Eigen-projection Preprocessing and Augment of Null Depth[J].Journal of Air Force Engineering University: Nature Science Edition,2018,19(1),40- 45.(in Chinese)

[8] Chen V C. Radar Micro-Doppler Signatures-Principle and Applications[J]. Radar N & Hnology, 2012: 1- 4.

[9] 王忠民, 曹洪江, 范琳. 一种基于卷积神经网络深度学习的人体行为识别方法[J]. 计算机科学, 2016, 43(s2): 56-58.

Wang Zhongmin, Cao Hongjiang, Fan Lin. A Method of Human Behavior Recognition Based on Convolution Neural Network Depth Learning[J]. Computer Science, 2016, 43 (s2): 56-58.(in Chinese)

[10] Kim Y, Hao L. Human Activity Classification Based on Micro-Doppler Signatures Using a Support Vector Machine[J]. IEEE Transactions on Geoscience & Remote Sensing, 2009, 47(5): 1328-1337.

[11] Tahmoush D. Review of micro-Doppler signatures[J]. Radar Sonar &Navigation let, 2015, 9(9): 1140-1146.

[12] Javier R, Kim Y. Application of Linear Predictive Coding for Human Activity Classification Based on Micro-Doppler Signatures[J]. IEEE Geoscience & Remote Sensing Letters, 2014,11(10): 1831-1834.

[13] Kim Y, Moon T. Detection and Activity Classification Based on Micro-Doppler Signatures Using Deep Convolutional Neural Networks[J]. IEEE Geoscience & Remote Sensing Letters, 2016, 13(1): 8-12.

[14] Trommel R P, Harmanny R I A, Cifola L, et al. Multi-target Human Gait Classification Using Deep Convolutional Neural Networks on Micro-Doppler Spectrograms[C]∥Radar Conference. IEEE, 2017.

[15] Chen V C, Li F, Ho S S, et al. Micro-Doppler Effect in Radar: Phenomenon, Model and Simulation Study[J]. IEEE Transaction on Aerospace & Electronic Systems, 2006, 42(1): 2-21.

[16] Donahue J, Jia Y, Vinyals O, et al. DeCAF: A Deep Convolutional Activation Feature for Generic Visual Recognition[J]. Computer Science, 2013, 50(1): 1- 647.

[17] Kim Y, Ling H. Human Activity Classification Based on Micro-Doppler Signatures Using a Support Vector Machine[J]. IEEE Transactions on Geoscience & Remote Sensing, 2009, 47(5):1328-1337.